Clear Sky Science · it

Rilevazione della depressione basata sul linguaggio con apprendimento automatico: revisione sistematica e meta-analisi

Perché le tue parole potrebbero rivelare il tuo stato d’animo

La maggior parte di noi condivide frammenti della propria vita per iscritto ogni giorno—tramite messaggi di testo, e-mail o chat online. Questo studio pone una domanda sorprendente: i modelli presenti in quelle parole quotidiane possono aiutare a segnalare quando qualcuno sta lottando con la depressione? Riunendo più di un decennio di ricerche da tutto il mondo, gli autori esaminano quanto bene i programmi informatici siano in grado di individuare segnali di depressione unicamente da ciò che le persone dicono o scrivono e cosa sarebbe necessario perché tali strumenti possano essere utilizzati in sicurezza nella pratica clinica reale.

Raccogliere indizi da molte conversazioni

I ricercatori hanno cercato sistematicamente nelle banche dati mediche e informatiche e hanno identificato 123 studi che cercavano di rilevare la depressione dal linguaggio parlato o scritto usando l’apprendimento automatico. Complessivamente, questi studi hanno utilizzato testi provenienti da oltre 35.000 persone e quasi 60.000 campioni linguistici. Le parole provenivano da contesti diversi: interviste cliniche strutturate in cui si chiedeva alle persone del loro umore e della vita quotidiana; risposte brevi a domande aperte come “Come ti senti oggi?”; chat terapeutiche e sessioni di consulenza testuale; e messaggi quotidiani, e-mail o scritti in stile diario. In tutti i casi, la depressione è stata determinata in modo indipendente—attraverso questionari standardizzati o diagnosi cliniche—quindi i modelli informatici prevedevano un reale esito clinico, non semplicemente deducendolo dal testo stesso.

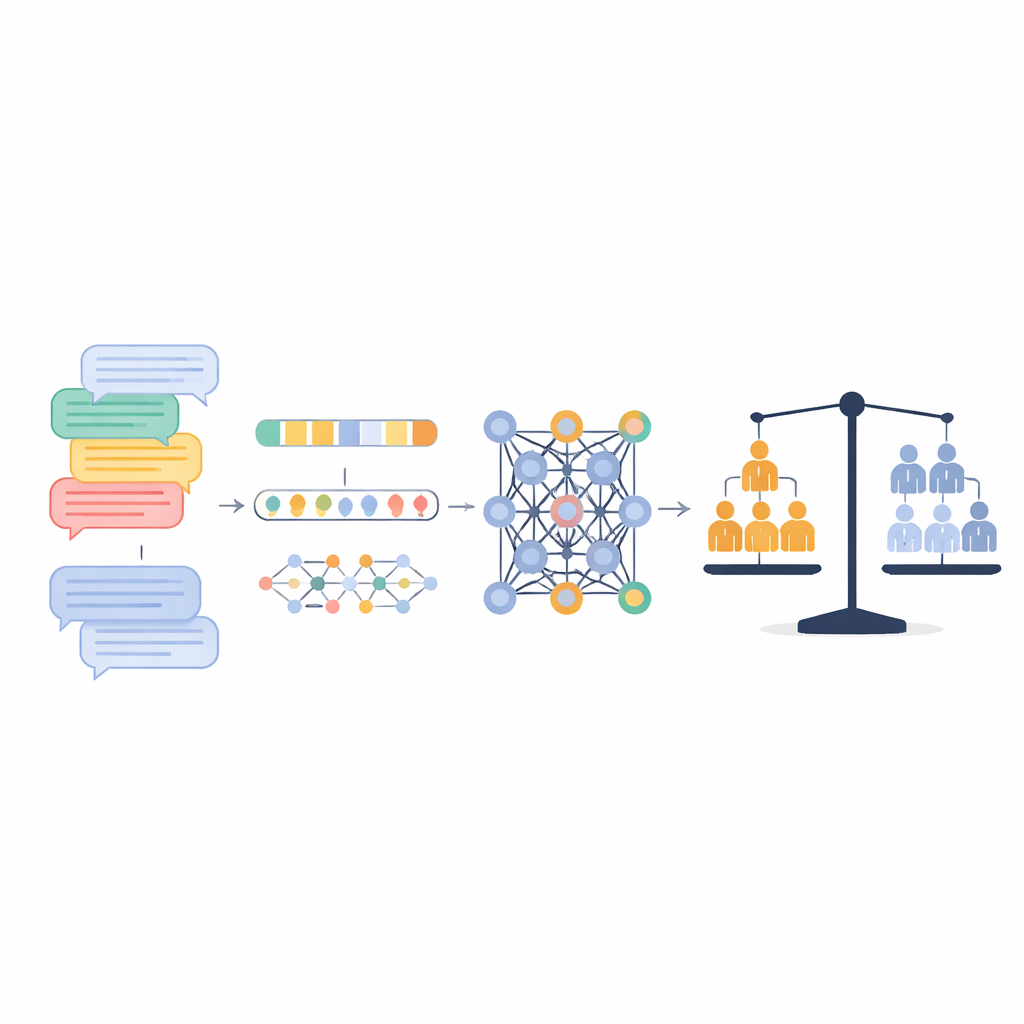

Trasformare le parole in segnali per i computer

Per rendere il linguaggio utilizzabile dagli algoritmi, gli studi hanno convertito il testo in numeri in diversi modi. Alcuni hanno usato conteggi semplici di parole o frasi, come la frequenza di apparizione di certi termini. Altri si sono basati su dizionari che raggruppano parole in categorie psicologiche (per esempio, parole di emozione negativa o parole focalizzate sul sé), trasformando il discorso di ciascuna persona in un profilo di queste categorie. Lavori più recenti hanno utilizzato “embedding” e grandi modelli linguistici come BERT o GPT, che rappresentano parole e frasi come punti densi in uno spazio matematico catturando sfumature di significato e contesto. Su questi input sono stati addestrati diversi tipi di modelli—dalle tecniche classiche come regressione logistica e macchine a vettori di supporto fino a sistemi di deep learning come reti neurali ricorrenti e architetture basate su transformer.

Quanto bene hanno funzionato le macchine

Su 43 set di dati indipendenti adatti per la pooling, i modelli hanno classificato correttamente le persone come depresse o non depresse circa l’80% delle volte. La precisione (quanto spesso un risultato positivo corrispondeva realmente a depressione) è stata in media del 78% e il recall (quante persone depresse sono state correttamente individuate) è stato in media del 76%. Una misura più ampia che bilancia successi e errori, chiamata AUC, si è attestata intorno a 0,79, suggerendo una capacità discriminativa ragionevolmente buona nel complesso. Tuttavia, le prestazioni sono variate ampiamente da studio a studio. I sistemi hanno funzionato meglio quando analizzavano linguaggio proveniente da interviste cliniche strutturate che si concentravano direttamente su umore e sintomi, dove l’accuratezza raggiungeva circa l’84%. Le prestazioni calavano quando i modelli si basavano su conversazioni terapeutiche più libere o chat quotidiane, in cui i segni di depressione sono più sottili e mescolati ad altri argomenti.

Ciò che conta di più: il contesto più della complessità

Quando gli autori hanno analizzato più a fondo perché gli studi differivano, un fattore è emerso costantemente: la fonte del testo. Se il linguaggio proveniva da interviste mirate, domande aperte veloci o conversazioni naturali spiegava più della variazione nell’accuratezza rispetto alla scelta dell’algoritmo o del tipo di caratteristiche. Sorprendentemente, nel piccolo gruppo di studi che ha usato dizionari linguistici costruiti a mano, questi approcci più semplici a volte hanno eguagliato o superato sistemi di deep learning più complessi. I metodi tradizionali di machine learning e i moderni modelli transformer hanno mostrato un’accuratezza complessiva simile, suggerendo che potrebbe esistere un limite imposto da quanto informazione è effettivamente contenuta nei frammenti di linguaggio disponibili, più che dalla sofisticazione del modello stesso.

Promesse, limiti e questioni etiche

Gli autori sostengono che gli strumenti basati sul testo dovrebbero essere considerati ausili per la segnalazione precoce e il monitoraggio, non sostituti dei clinici. I sistemi automatizzati potrebbero aiutare a mettere in evidenza persone che potrebbero beneficiare di un controllo più approfondito, ridurre l’onere dei questionari ripetuti o tracciare i cambiamenti dell’umore nel tempo tra una visita e l’altra. Ma evidenziano anche avvertenze serie: il linguaggio è plasmato dalla cultura, dal genere e dalle circostanze di vita, e modelli addestrati su un gruppo possono fallire su un altro. Molti set di dati sovra-rappresentano certe popolazioni e riutilizzano le stesse fonti di intervista, limitando la generalizzabilità. La maggior parte degli studi ha inoltre riportato solo misure semplici di accuratezza, rendendo difficile valutare i compromessi nel mondo reale tra il non individuare persone bisognose e generare troppe false segnalazioni. Questioni di privacy, consenso informato e bias sono centrali se si intende analizzare conversazioni ordinarie o trascrizioni cliniche in questo modo.

Cosa significa per il futuro dell’assistenza

Per un lettore non specialistico, la conclusione è che i computer sono già abbastanza bravi—ma lontani dall’essere perfetti—a cogliere segni di depressione da come parliamo e scriviamo. In contesti progettati con cura, specialmente interviste strutturate, questi sistemi possono classificare correttamente circa quattro persone su cinque. Tuttavia lo studio mostra che la provenienza del linguaggio e la definizione stessa di depressione contano tanto quanto, o più, delle ultime trovate algoritmiche. Prima che tali strumenti possano essere integrati in sicurezza nell’assistenza sanitaria, i ricercatori avranno bisogno di set di dati più diversi, standard di reportistica più chiari e progetti che mantengano i clinici coinvolti. Usati con attenzione, gli screening basati sul linguaggio potrebbero un giorno fornire un modo a basso attrito per notare prima possibile quando qualcuno sta scivolando in difficoltà.

Citazione: Fisher, H., Jaffe, N.M., Pidvirny, K. et al. Language-based detection of depression with machine learning: systematic review and meta-analysis. npj Digit. Med. 9, 273 (2026). https://doi.org/10.1038/s41746-026-02448-1

Parole chiave: screening della depressione, elaborazione del linguaggio naturale, salute mentale digitale, apprendimento automatico, colloqui clinici