Clear Sky Science · fr

Détection de la dépression à partir du langage par apprentissage automatique : revue systématique et méta-analyse

Pourquoi vos mots peuvent trahir votre humeur

La plupart d’entre nous partagent des fragments de leur vie par écrit chaque jour — par textos, courriels ou discussions en ligne. Cette étude pose une question frappante : les motifs présents dans ces mots quotidiens peuvent-ils aider à repérer lorsqu’une personne souffre de dépression ? En rassemblant plus d’une décennie de recherches du monde entier, les auteurs évaluent dans quelle mesure des programmes informatiques peuvent détecter des signes de dépression uniquement à partir de ce que les gens disent ou écrivent, et ce qu’il faudrait pour que de tels outils soient utilisés en toute sécurité dans la prise en charge réelle.

Collecter des indices à partir de nombreuses conversations

Les chercheurs ont systématiquement exploré des bases de données médicales et informatiques et identifié 123 études qui ont tenté de détecter la dépression à partir du langage parlé ou écrit en utilisant l’apprentissage automatique. Au total, ces études s’appuyaient sur les textes de plus de 35 000 personnes et près de 60 000 échantillons de langage. Les mots provenaient de différents contextes : entretiens cliniques structurés où l’on interrogeait les personnes sur leur humeur et leur vie quotidienne ; réponses courtes à des questions ouvertes comme « Comment vous sentez-vous aujourd’hui ? » ; échanges de thérapie et sessions de conseil par écrit ; et messages quotidiens, courriels ou entrées de type journal intime. Dans tous les cas, la dépression était déterminée de manière indépendante — par des questionnaires standardisés ou des diagnostics cliniques — de sorte que les modèles informatiques prédisaient un véritable résultat clinique, et non une simple conjecture basée uniquement sur le texte.

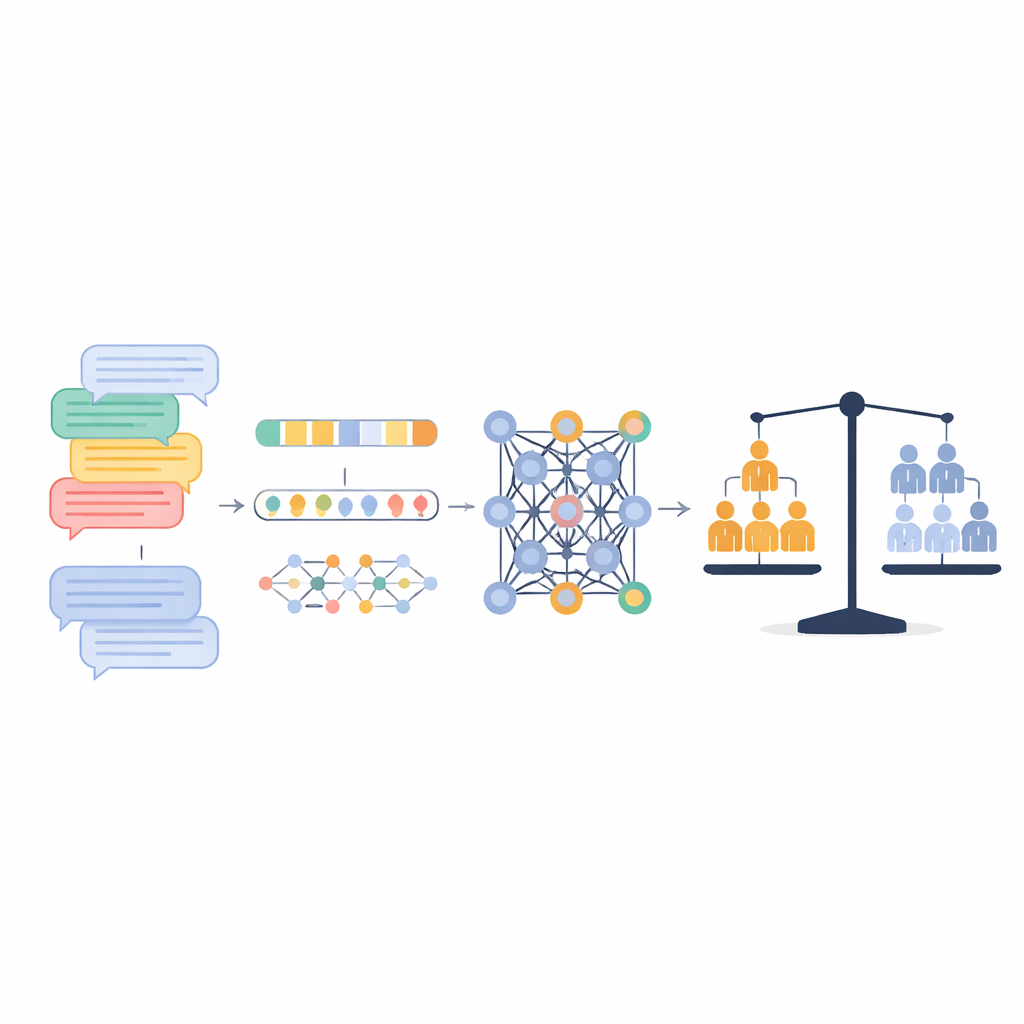

Transformer les mots en signaux pour les ordinateurs

Pour rendre le langage exploitable par des algorithmes, les études ont converti le texte en nombres de plusieurs manières. Certaines ont utilisé de simples comptages de mots ou de phrases, par exemple la fréquence d’apparition de certains termes. D’autres se sont appuyées sur des dictionnaires regroupant les mots en catégories psychologiques (par exemple, mots d’émotion négative ou mots centrés sur soi), transformant le discours de chaque personne en un profil de ces catégories. Des travaux plus récents ont utilisé des « embeddings » et de grands modèles de langage comme BERT ou GPT, qui représentent mots et phrases par des points denses dans un espace mathématique capturant des nuances de sens et de contexte. Sur ces représentations, différents types de modèles ont été entraînés — des techniques classiques comme la régression logistique et les machines à vecteurs de support aux systèmes d’apprentissage profond tels que les réseaux neuronaux récurrents et les architectures basées sur les transformeurs.

Performance des machines

Sur 43 jeux de données indépendants pouvant être combinés, les modèles ont correctement classé les personnes comme dépressives ou non dépressives environ 80 % du temps. La précision (la proportion de résultats positifs réellement dépressifs) était en moyenne de 78 % et le rappel (la part des cas dépressifs correctement identifiés) de 76 %. Une mesure plus large qui équilibre les succès et les erreurs, appelée AUC, tournait autour de 0,79, suggérant une capacité discriminative globalement assez solide. Mais les performances variaient fortement d’une étude à l’autre. Les systèmes fonctionnaient mieux lorsqu’ils analysaient le langage issu d’entretiens cliniques structurés centrés directement sur l’humeur et les symptômes, où la précision atteignait environ 84 %. Les performances diminuaient lorsque les modèles s’appuyaient sur des conversations de thérapie plus libres ou des discussions quotidiennes, où les signes de dépression sont plus subtils et mêlés à d’autres sujets.

Ce qui compte le plus : le contexte plutôt que la complexité

En creusant les raisons des divergences entre études, un facteur est apparu de manière constante : la source du texte. Le fait que le langage provienne d’entretiens ciblés, de brèves questions ouvertes ou de conversations naturelles expliquait davantage la variation de précision que le choix de l’algorithme ou du type de caractéristiques. De façon surprenante, dans le petit groupe d’études qui utilisaient des dictionnaires linguistiques faits main, ces approches plus simples égalent parfois ou surpassent des systèmes d’apprentissage profond plus complexes. Les méthodes d’apprentissage automatique traditionnelles et les modèles transformeurs de pointe affichaient une précision globale similaire, laissant entendre qu’il existe peut‑être un plafond lié à la quantité d’information réellement présente dans les extraits de langage disponibles, plutôt qu’à la sophistication du modèle lui‑même.

Promesses, limites et questions éthiques

Les auteurs soutiennent que les outils basés sur le texte doivent être considérés comme des aides de dépistage précoce et de suivi, et non comme des remplacements des cliniciens. Les systèmes automatisés pourraient aider à signaler des personnes qui mériteraient un examen approfondi, réduire la charge des questionnaires répétés, ou suivre les variations d’humeur entre les rendez‑vous. Mais ils soulignent aussi des mises en garde sérieuses : le langage est façonné par la culture, le genre et les circonstances de vie, et des modèles entraînés sur un groupe peuvent échouer dans un autre. De nombreuses bases de données sur‑représentent certaines populations et réutilisent les mêmes sources d’entretien, ce qui limite la généralisabilité. La plupart des études ont en outre rapporté uniquement des mesures simples de précision, rendant difficile l’évaluation des compromis réels entre laisser passer des personnes dans le besoin et générer trop de faux positifs. Les questions de confidentialité, de consentement éclairé et de biais sont centrales si l’on veut analyser de cette façon des conversations ordinaires ou des transcriptions cliniques.

Ce que cela signifie pour l’avenir des soins

Pour le grand public, la conclusion est que les ordinateurs sont déjà assez bons — mais loin d’être parfaits — pour détecter des signes de dépression à partir de notre façon de parler et d’écrire. Dans des contextes bien conçus, en particulier les entretiens structurés, ces systèmes peuvent classer correctement environ quatre personnes sur cinq. Pourtant, l’étude montre que la provenance du langage et la manière dont la dépression est définie importent autant, sinon plus, que les dernières astuces algorithmiques. Avant que ces outils puissent être intégrés en toute sécurité aux soins de santé, il faudra des jeux de données plus diversifiés, des normes de rapport plus claires et des modèles de conception qui maintiennent les cliniciens dans la boucle. Utilisés avec discernement, les dépistages basés sur le langage pourraient un jour offrir un moyen peu contraignant de détecter plus tôt qu’à l’accoutumée qu’une personne sombre dans la détresse.

Citation: Fisher, H., Jaffe, N.M., Pidvirny, K. et al. Language-based detection of depression with machine learning: systematic review and meta-analysis. npj Digit. Med. 9, 273 (2026). https://doi.org/10.1038/s41746-026-02448-1

Mots-clés: dépistage de la dépression, traitement automatique du langage, santé mentale numérique, apprentissage automatique, entretiens cliniques