Clear Sky Science · es

Detección de la depresión basada en el lenguaje con aprendizaje automático: revisión sistemática y metaanálisis

Por qué tus palabras podrían revelar tu estado de ánimo

La mayoría de nosotros compartimos fragmentos de nuestra vida por escrito cada día —mediante mensajes de texto, correos electrónicos o chats en línea—. Este estudio plantea una pregunta llamativa: ¿pueden los patrones en esas palabras cotidianas ayudar a detectar cuando alguien está padeciendo depresión? Al reunir más de una década de investigación en todo el mundo, los autores examinan qué tan bien los programas informáticos pueden identificar signos de depresión únicamente a partir de lo que las personas dicen o escriben, y qué se necesitaría para que dichas herramientas se usen de forma segura en la atención real.

Recogiendo pistas de muchas conversaciones

Los investigadores buscaron sistemáticamente en bases de datos médicas y de informática y localizaron 123 estudios que intentaron detectar la depresión a partir del lenguaje hablado o escrito usando aprendizaje automático. En conjunto, estos estudios utilizaron textos de más de 35.000 personas y casi 60.000 muestras de lenguaje. Las palabras procedían de distintos contextos: entrevistas clínicas estructuradas en las que se preguntaba a las personas por su estado de ánimo y su vida diaria; respuestas breves a preguntas abiertas como “¿Cómo te sientes hoy?”; chats de terapia y sesiones de texto de asesoramiento; y mensajes cotidianos, correos electrónicos o entradas de estilo diario. En todos los casos, la depresión se determinó de forma independiente —mediante cuestionarios estándar o diagnósticos clínicos—, de modo que los modelos informáticos estaban prediciendo un resultado clínico real, no solo haciendo conjeturas a partir del texto.

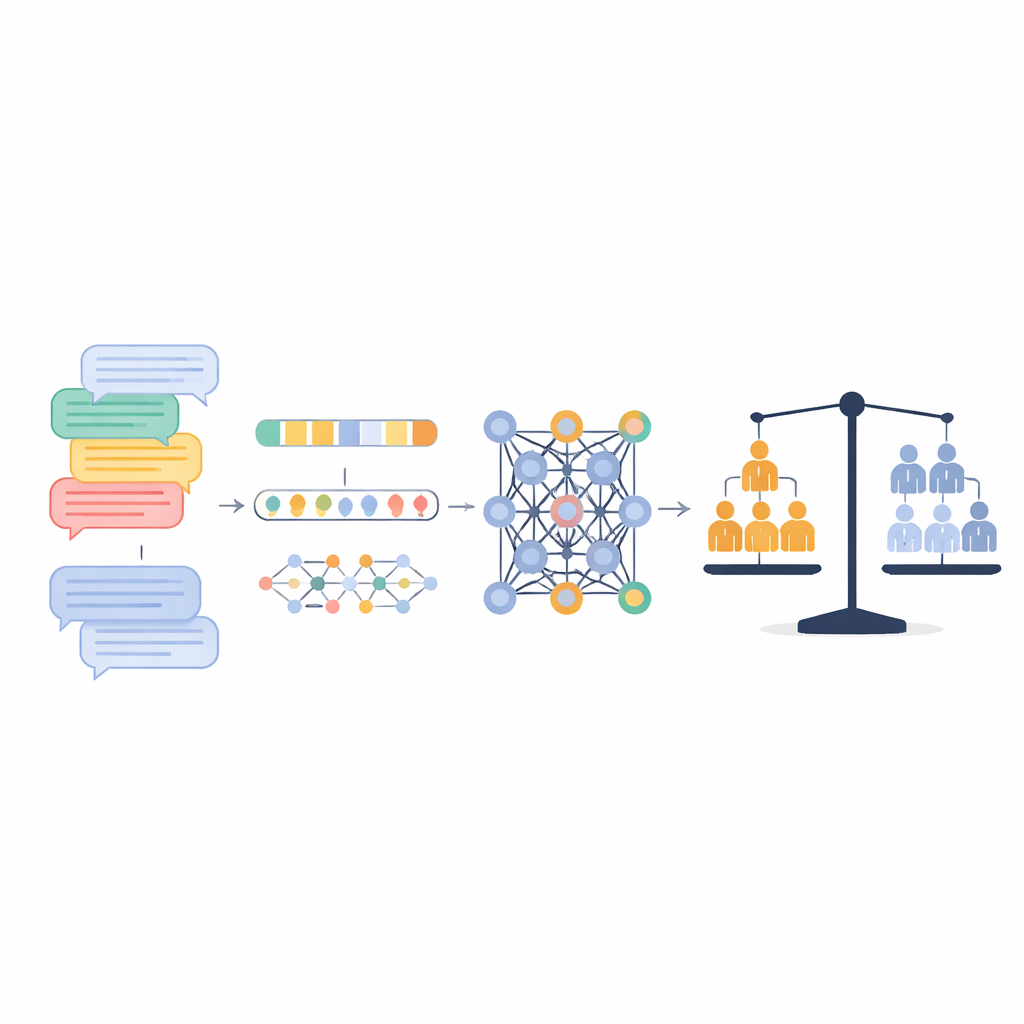

Convertir palabras en señales para los ordenadores

Para hacer el lenguaje utilizable por los algoritmos, los estudios convirtieron el texto en números de varias maneras. Algunos usaron conteos simples de palabras o frases, por ejemplo, con qué frecuencia aparecían ciertos términos. Otros se basaron en diccionarios que agrupan palabras en categorías psicológicas (por ejemplo, palabras de emoción negativa o de enfoque en uno mismo), transformando el habla de cada persona en un perfil de estas categorías. Trabajos más recientes emplearon “embeddings” y grandes modelos de lenguaje como BERT o GPT, que representan palabras y oraciones como puntos densos en un espacio matemático que capturan matices de significado y contexto. Sobre estas entradas se entrenaron distintos tipos de modelos: desde técnicas clásicas como regresión logística y máquinas de vectores de soporte hasta sistemas de aprendizaje profundo como redes neuronales recurrentes y arquitecturas basadas en transformadores.

Qué tan bien lo hicieron las máquinas

En 43 conjuntos de datos independientes aptos para agregación, los modelos clasificaron correctamente a las personas como deprimidas o no deprimidas aproximadamente en el 80% de los casos. La precisión (con qué frecuencia un resultado positivo era realmente depresión) promedió el 78%, y la sensibilidad (qué proporción de casos depresivos se detectaron correctamente) promedió el 76%. Una medida más amplia que equilibra aciertos y fallos, llamada AUC, estuvo alrededor de 0,79, lo que sugiere una capacidad discriminativa razonablemente fuerte en conjunto. Pero el rendimiento varió ampliamente entre estudios. Los sistemas funcionaron mejor cuando analizaron lenguaje procedente de entrevistas clínicas estructuradas centradas directamente en el estado de ánimo y los síntomas, donde la exactitud alcanzó alrededor del 84%. El rendimiento disminuyó cuando los modelos se apoyaron en conversaciones terapéuticas más libres o en chats cotidianos, donde los indicios de depresión son más sutiles y se mezclan con otros temas.

Lo que importa más: el contexto sobre la complejidad

Al profundizar en las razones de la variación entre estudios, un factor destacó de forma consistente: la fuente del texto. Que el lenguaje proviniera de entrevistas focalizadas, preguntas abiertas rápidas o conversaciones naturales explicó más la variación en la exactitud que la elección del algoritmo o el tipo de características. Sorprendentemente, en el pequeño grupo de estudios que usó diccionarios lingüísticos hechos a mano, estos enfoques más simples a veces igualaron o superaron a sistemas de aprendizaje profundo más complejos. Los métodos tradicionales de aprendizaje automático y los modelos transformadores de vanguardia mostraron una precisión global similar, lo que sugiere que puede existir un techo impuesto por la cantidad de información realmente contenida en los fragmentos de lenguaje disponibles, más que por la sofisticación del modelo en sí.

Promesas, límites y cuestiones éticas

Los autores sostienen que las herramientas basadas en texto deben verse como ayudas de alerta temprana y de monitorización, no como sustitutos de los clínicos. Los sistemas automatizados podrían ayudar a señalar a personas que podrían beneficiarse de una evaluación más cercana, reducir la carga de cuestionarios repetidos o rastrear cambios en el estado de ánimo a lo largo del tiempo entre citas. Pero también señalan advertencias serias: el lenguaje está moldeado por la cultura, el género y las circunstancias vitales, y los modelos entrenados en un grupo pueden fallar en otro. Muchos conjuntos de datos sobre-representan determinadas poblaciones y reutilizan las mismas fuentes de entrevistas, limitando la generalizabilidad. La mayoría de los estudios también informó solo medidas simples de exactitud, lo que dificulta juzgar los compromisos en el mundo real entre pasar por alto a personas necesitadas y generar demasiadas falsas alarmas. Las cuestiones de privacidad, consentimiento informado y sesgo son centrales si se pretende analizar la conversación ordinaria o las transcripciones clínicas de esta manera.

Qué significa esto para el futuro de la atención

Para un lector no experto, la conclusión es que los ordenadores ya son bastante buenos —pero lejos de ser perfectos— para detectar signos de depresión por la forma en que hablamos y escribimos. En entornos diseñados con cuidado, sobre todo en entrevistas estructuradas, estos sistemas pueden clasificar correctamente a unas cuatro de cada cinco personas. Sin embargo, el estudio muestra que de dónde proviene el lenguaje y cómo se define la depresión importa tanto como, o más que, los últimos trucos algorítmicos. Antes de que estas herramientas puedan integrarse de forma segura en la atención sanitaria, los investigadores necesitarán conjuntos de datos más diversos, normas de reporte más claras y diseños que mantengan a los clínicos implicados. Usadas con criterio, las pruebas basadas en el lenguaje podrían algún día ofrecer una forma de baja fricción para detectar antes que de otro modo cuando alguien está entrando en un estado de malestar.

Cita: Fisher, H., Jaffe, N.M., Pidvirny, K. et al. Language-based detection of depression with machine learning: systematic review and meta-analysis. npj Digit. Med. 9, 273 (2026). https://doi.org/10.1038/s41746-026-02448-1

Palabras clave: cribado de la depresión, procesamiento del lenguaje natural, salud mental digital, aprendizaje automático, entrevistas clínicas