Clear Sky Science · it

Un quadro reale per il riconoscimento automatizzato dei prodotti e la generazione di cataloghi: dataset, modello e analisi

Scaffali più intelligenti per clienti impegnati

Chiunque abbia cercato una certa confezione di cereali o provato una cassa self-service sa che gli scaffali sono posti affollati e confusi. Questo articolo esplora come i computer possano osservare gli scaffali della spesa quotidiana e riconoscere automaticamente cosa c’è, usando foto ordinarie invece dei codici a barre. L’obiettivo è rendere operazioni come il conteggio dell’inventario, la creazione di cataloghi e persino la ricerca di prodotti tramite telefono più veloci, economiche e meno dipendenti dal lavoro manuale.

Perché gli scaffali sono difficili per i computer

A prima vista, insegnare a un computer a individuare i prodotti potrebbe sembrare semplice: basta mostrargli molte immagini di ogni articolo. In realtà, le scene del supermercato sono disordinate. I prodotti appaiono a molte dimensioni, da primi piani tenuti in mano dal cliente a viste lontane dalle telecamere di sicurezza. Le confezioni sono simili tra loro, si distinguono per piccoli dettagli e possono essere parzialmente nascoste dietro altre. Cambiano le condizioni di illuminazione, gli scaffali vengono riorganizzati e i marchi variano da una regione all’altra. Le raccolte di immagini esistenti per la ricerca spesso evitano queste difficoltà, usando pochi prodotti, illuminazione controllata o solo immagini in primo piano. Questo rende difficile sviluppare sistemi che funzionino davvero nei negozi reali.

Una nuova raccolta di immagini di generi alimentari realistica

Per colmare questa lacuna, gli autori hanno costruito una nuova collezione di immagini chiamata Grocer-Help. Contiene 13.771 fotografie che mostrano circa 4.000 prodotti alimentari distinti raggruppati in 349 classi basate sui marchi. Le immagini provengono da otto negozi in cinque diversi stati dell’India, acquisite con sei tipi di fotocamere mobili. Le scene vanno da primi piani di pochi articoli a viste a distanza di corsie intere e includono caratteristiche quotidiane come riflessi, mosso, sfondi disordinati e parziale occultamento delle etichette. Ogni prodotto in un’immagine è accuratamente segnato con un riquadro, per un totale di oltre 166.000 elementi annotati. Il dataset è suddiviso in tre tipi principali di immagini: close-shot, long-shot e immagini pulite di cataloghi online, che insieme permettono ai ricercatori di studiare come la distanza di ripresa e lo stile di acquisizione influenzino il riconoscimento.

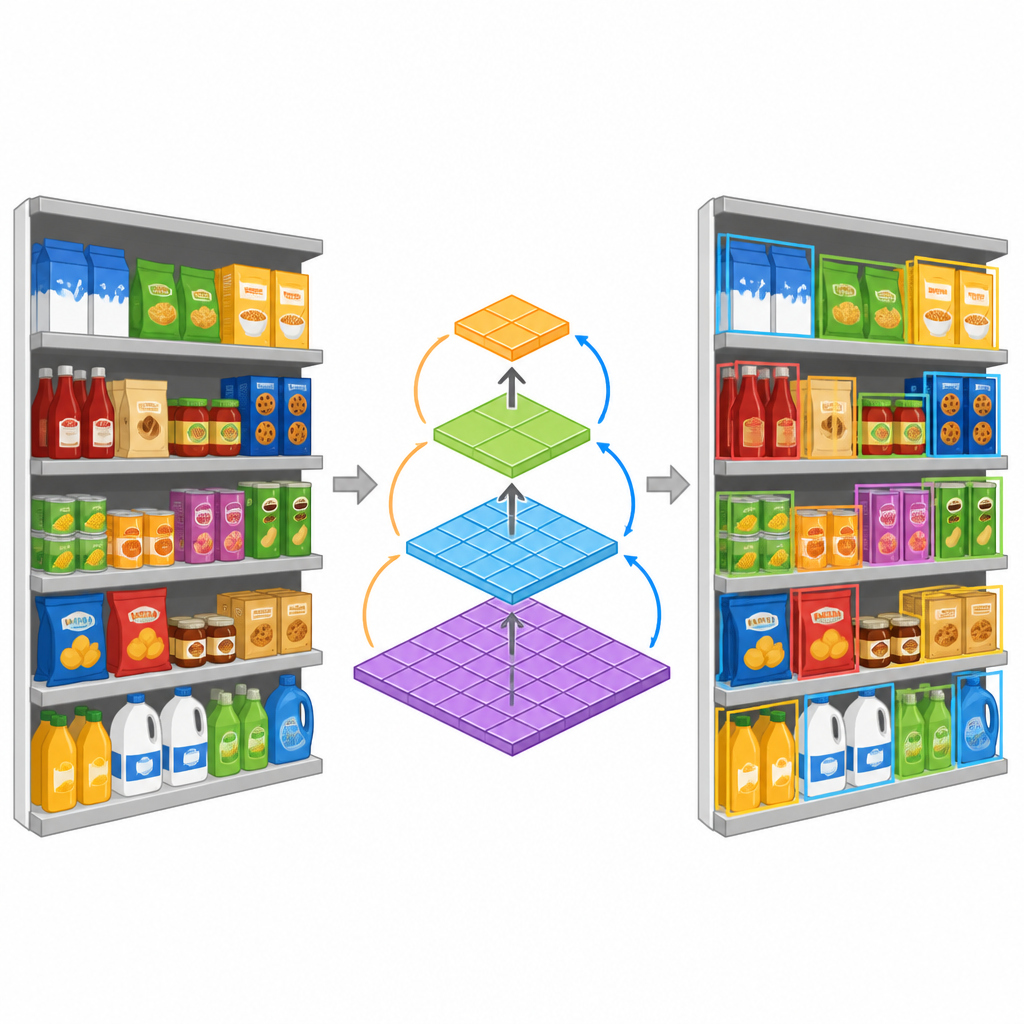

Un modello snello che vede a molte scale

In parallelo al dataset, gli autori introducono un modello di rilevamento compatto progettato per gestire prodotti di molte dimensioni nella stessa scena. Invece di trattare separatamente gli oggetti piccoli e quelli grandi, il modello usa un blocco costruttivo speciale che raccoglie indizi visivi su diverse scale contemporaneamente. Questi indizi sono poi impilati in una piramide di mappe di feature, in cui ogni livello si concentra su diversi livelli di dettaglio. Questo aiuta il sistema a seguire i prodotti dalle viste distanti degli scaffali fino alle sottili differenze tra confezioni simili. Il modello è anche pensato per essere efficiente: utilizza operazioni più leggere in termini di calcolo così da poter girare su dispositivi con potenza limitata, rendendolo più adatto all’uso nei negozi o su hardware consumer.

Test attraverso dataset, negozi e distanze

I ricercatori confrontano il loro modello con sistemi di rilevamento oggetti popolari come varie versioni di YOLO e RetinaNet su diversi dataset di generi alimentari esistenti e su Grocer-Help. Sul nuovo dataset, il loro modello raggiunge un punteggio solido nel trovare correttamente i prodotti usando meno parametri rispetto a molti concorrenti. Ottiene precisione e richiamo particolarmente buoni, cioè è abile sia nell’evitare falsi allarmi sia nel non perdere articoli, sebbene i suoi riquadri risultino talvolta meno precisi quando valutati con regole di sovrapposizione molto severe. Test dettagliati rivelano che le prestazioni dipendono dallo stile di acquisizione: le immagini in primo piano sono le più semplici, le viste a lunga distanza degli scaffali sono più difficili e l’inclusione nelle prove di immagini di catalogo online può danneggiare i risultati perché appaiono molto diverse dalle scene reali dei negozi. I confronti negozio per negozio mostrano inoltre che scaffali ordinati e confezioni a forma di scatola tendono a favorire il rilevatore.

Cosa significa per il retail di tutti i giorni

In termini pratici, questo lavoro mostra come andare oltre la semplice scansione dei codici a barre verso sistemi basati su fotocamera in grado di «vedere» scaffali affollati. Offrendo un ampio dataset realistico e un modello efficiente che gestisce prodotti a diverse dimensioni e punti di vista, lo studio fornisce una base per strumenti pratici come controlli automatici dell’inventario, costruzione di cataloghi basati sugli scaffali e app per lo shopping mobile più intelligenti. Pur restando sfide, specialmente in scene molto affollate e per prodotti visti poche volte durante l’addestramento, Grocer-Help e il modello omni-scala avvicinano il riconoscimento automatico dei prodotti a un uso quotidiano nel retail reale.

Citazione: Sah, M., Mathew, J. & Dayananda, P. A real-world framework for automated product recognition and catalog generation: dataset, model, and analysis. Sci Rep 16, 14834 (2026). https://doi.org/10.1038/s41598-026-42266-9

Parole chiave: riconoscimento prodotti alimentari, rilevamento oggetti, computer vision nel retail, benchmark dataset, automazione inventario