Clear Sky Science · fr

Un cadre réel pour la reconnaissance automatisée de produits et la génération de catalogues : jeu de données, modèle et analyse

Des étagères plus intelligentes pour les clients pressés

Toute personne ayant recherché une boîte de céréales précise ou utilisé une caisse automatique sait que les étagères de magasin sont des lieux encombrés et déroutants. Cet article examine comment des ordinateurs peuvent analyser des étagères d'épicerie ordinaires et reconnaître automatiquement ce qui s'y trouve, en utilisant des photos courantes plutôt que des codes-barres. L'objectif est d'accélérer et de réduire le coût d'opérations comme le comptage des stocks, la création de catalogues et la recherche de produits depuis un téléphone, tout en diminuant la dépendance au travail manuel.

Pourquoi les étagères sont difficiles pour les ordinateurs

À première vue, apprendre à un ordinateur à repérer des produits peut sembler simple : lui montrer beaucoup d'images de chaque article. En réalité, les scènes de supermarché sont désordonnées. Les produits apparaissent à de nombreuses tailles, depuis des prises de vue en gros plan dans la main d'un client jusqu'à des vues éloignées provenant de caméras de sécurité. Les emballages se ressemblent, diffèrent par de petits détails et peuvent être partiellement cachés derrière d'autres. L'éclairage varie, les étagères sont réorganisées et les marques diffèrent selon les régions. Les collections d'images existantes pour la recherche évitent souvent ces difficultés, en utilisant peu de produits, un éclairage contrôlé ou seulement des gros plans. Cela complique le développement de systèmes qui fonctionnent réellement en magasin.

Une nouvelle collection d'images d'épicerie réaliste

Pour combler ce fossé, les auteurs ont construit une nouvelle collection d'images appelée Grocer-Help. Elle contient 13 771 photos montrant environ 4 000 produits d'épicerie distincts regroupés en 349 classes basées sur la marque. Les images proviennent de huit magasins dans cinq États indiens différents, capturées avec six types d'appareils mobiles. Les scènes vont de gros plans de quelques articles à des vues d'ensemble d'allées complètes, et incluent des particularités quotidiennes comme les reflets, le flou de mouvement, des arrière-plans encombrés et le masquage partiel des étiquettes. Chaque produit sur une image est soigneusement annoté par une boîte englobante, pour plus de 166 000 articles annotés. Le jeu de données est divisé en trois principaux types d'images : gros plan, vue lointaine et images propres de catalogues en ligne, ce qui permet aux chercheurs d'étudier comment la distance de prise de vue et le style de capture affectent la reconnaissance.

Un modèle compact qui voit à plusieurs échelles

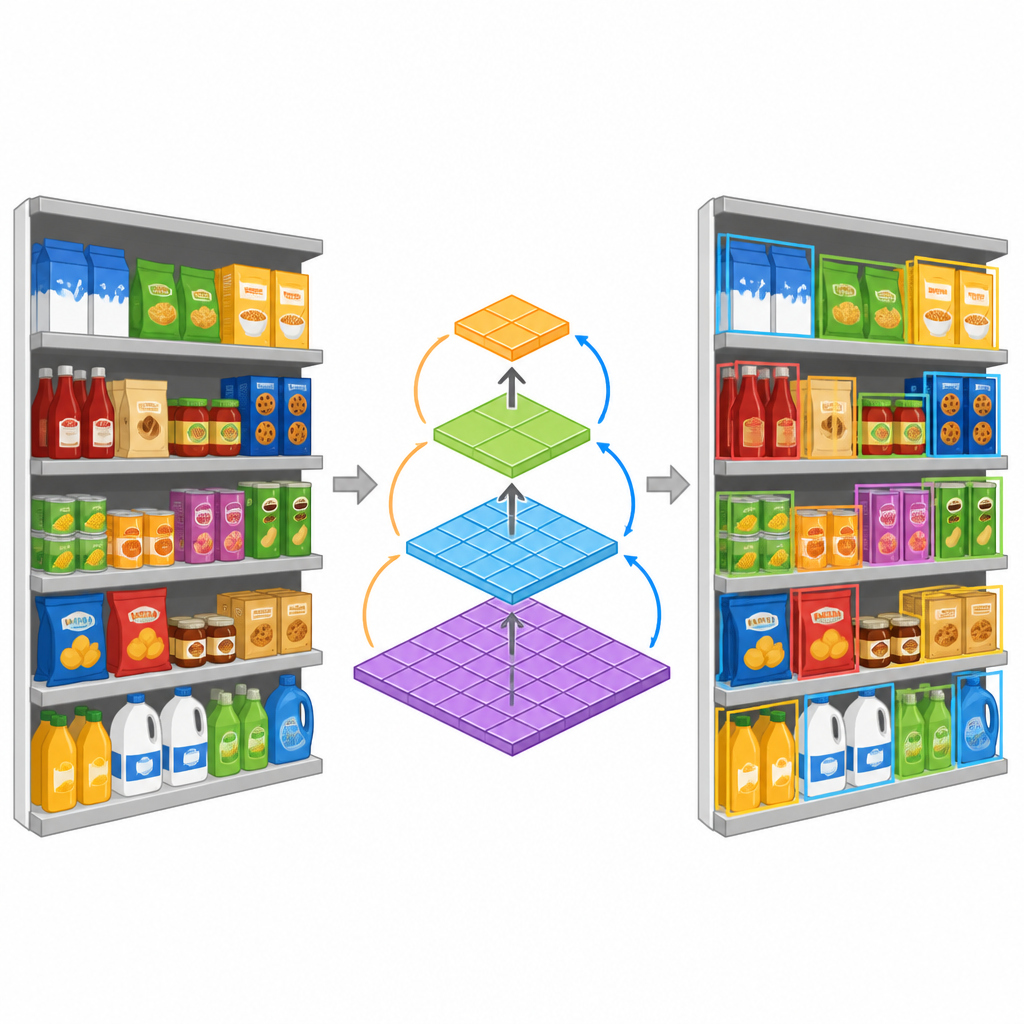

Parallèlement au jeu de données, les auteurs présentent un modèle de détection compact conçu pour traiter des produits de tailles très variées dans une même scène. Plutôt que de traiter séparément les petits et grands objets, le modèle utilise un bloc spécifique qui rassemble des indices visuels sur plusieurs échelles simultanément. Il empile ensuite ces indices en une pyramide de cartes de caractéristiques, chaque couche se concentrant sur différents niveaux de détail. Cela aide le système à suivre les produits depuis des vues d'étagères éloignées jusque dans les différences fines entre emballages similaires. Le modèle est également conçu pour être efficace : il emploie des opérations plus légères afin de pouvoir fonctionner sur des dispositifs aux ressources limitées, le rendant plus adapté à une utilisation en magasin ou sur du matériel grand public.

Tests à travers jeux de données, magasins et distances

Les chercheurs comparent leur modèle à des systèmes de détection d'objets populaires tels que différentes variantes de YOLO et RetinaNet sur plusieurs jeux de données d'épicerie existants et sur Grocer-Help. Sur le nouveau jeu de données, leur modèle atteint un score solide pour la détection correcte des produits tout en utilisant moins de paramètres que de nombreux concurrents. Il obtient une précision et un rappel particulièrement élevés, ce qui signifie qu'il évite bien les fausses alertes et ne manque pas souvent d'articles, bien que ses boîtes soient parfois moins serrées lorsqu'on les juge selon des règles d'intersection très strictes. Des tests détaillés révèlent que les performances dépendent du mode de capture des images : les gros plans sont les plus faciles, les vues d'étagères à longue distance sont plus difficiles, et l'ajout d'images de catalogues en ligne à l'entraînement peut nuire aux résultats car elles diffèrent beaucoup des scènes réelles de magasin. Les comparaisons magasin par magasin montrent aussi que des étagères bien rangées et des emballages en boîte facilitent la détection.

Que cela signifie pour le commerce de détail quotidien

Concrètement, ce travail montre comment dépasser le simple scannage de codes-barres au profit de systèmes basés sur la caméra capables de « voir » des étagères encombrées. En proposant un jeu de données vaste et réaliste et un modèle efficace qui gère les produits à différentes tailles et points de vue, l'étude pose les bases d'outils pratiques comme les contrôles d'inventaire automatiques, la création de catalogues à partir d'étagères et des applications d'achat mobile plus intelligentes. S'il reste des défis, notamment pour les scènes très compactes et les produits peu représentés en formation, Grocer-Help et le modèle omni-échelle rapprochent la reconnaissance automatisée de produits d'une utilisation quotidienne en commerce réel.

Citation: Sah, M., Mathew, J. & Dayananda, P. A real-world framework for automated product recognition and catalog generation: dataset, model, and analysis. Sci Rep 16, 14834 (2026). https://doi.org/10.1038/s41598-026-42266-9

Mots-clés: reconnaissance de produits d'épicerie, détection d'objets, vision par ordinateur commerce, jeu de données référence, automatisation des inventaires