Clear Sky Science · it

Un framework multi-task di deep learning e radiomica per il rilevamento e la classificazione delle strutture anatomiche fetali nelle immagini ecografiche

Perché sono importanti le prime ecografie cerebrali del bambino

I futuri genitori e i clinici desiderano entrambi risposte chiare e precoci sulla salute del nascituro. Le ecografie nei primi tre mesi di gravidanza offrono già una finestra sul cervello e sul volto in sviluppo, dove cambiamenti sottili possono suggerire problemi futuri. Tuttavia interpretare queste immagini granulose è difficile e dipende molto dall’abilità dell’operatore che tiene la sonda. Questo studio esplora come l’intelligenza artificiale moderna possa agire come un paio di occhi esperti in più, individuando e classificando automaticamente piccole strutture nella testa del feto per supportare uno screening più precoce e più coerente.

Vedere oltre l’occhio umano

I ricercatori si sono concentrati su nove caratteristiche chiave del cervello e del volto che i medici controllano di routine tra le 11 e le 14 settimane di gravidanza, incluse parti del cervello, gli spazi fluidici circostanti e marcatori facciali come l’osso nasale e il palato. Modifiche in queste caratteristiche possono segnalare condizioni genetiche o strutturali. Tradizionalmente, anche gli specialisti esperti possono non essere d’accordo su ciò che vedono all’ecografia, e la qualità delle immagini varia da uno studio all’altro. Per affrontare questo problema, il team ha raccolto un ampio e variegato insieme di 4.532 esami ecografici provenienti da nove centri medici, catturando una vasta gamma di apparecchiature, stili di immagine e posizioni fetali. Questa diversità ha permesso di costruire e testare un sistema automatizzato meno dipendente da un singolo ospedale o dispositivo.

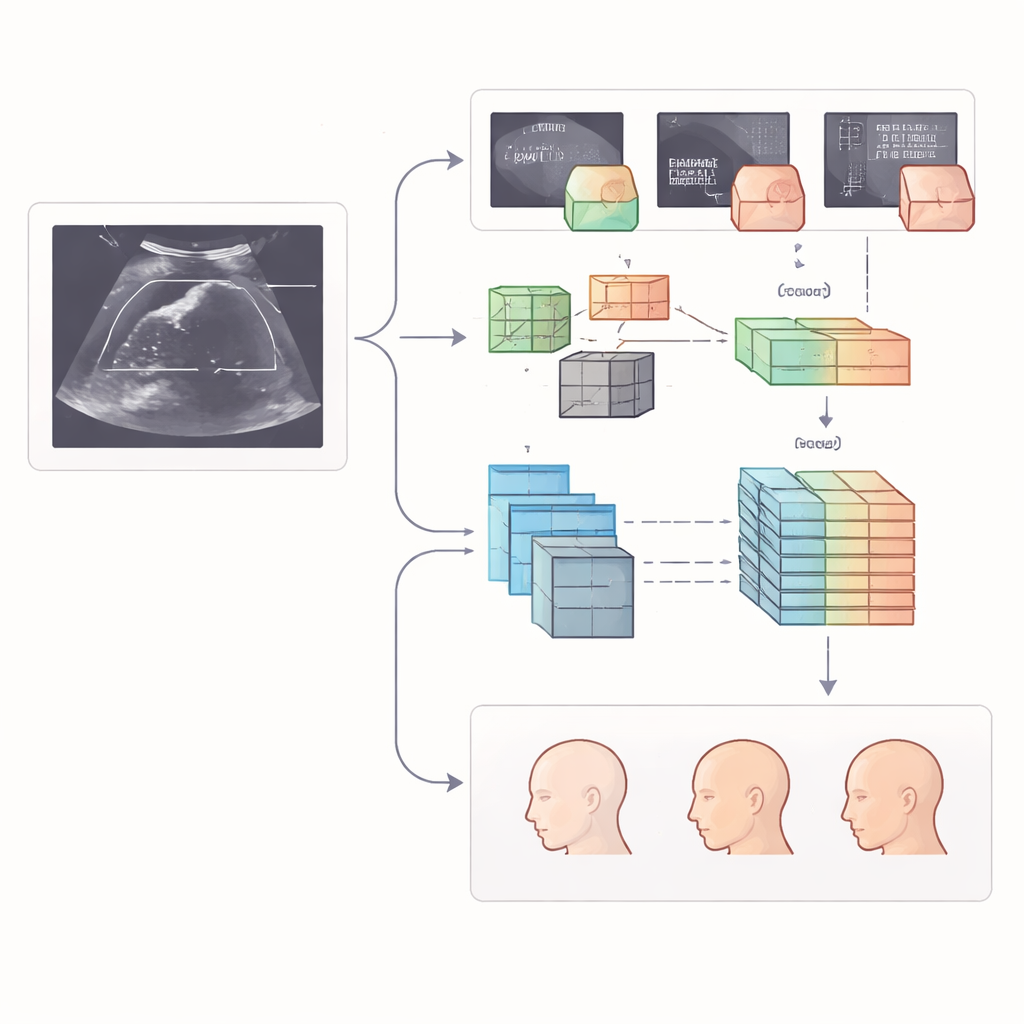

Come funziona la pipeline intelligente

Il cuore dello studio è una pipeline digitale passo-passo che imita, e poi estende, il flusso di lavoro di un esaminatore umano. Per prima cosa, due modelli avanzati di analisi delle immagini esaminano ogni frame ecografico e tracciano riquadri attorno alle nove strutture target, come il mesencefalo o l’osso nasale. Un modello è un rilevatore veloce progettato per individuare rapidamente piccoli oggetti, mentre l’altro sfrutta un’architettura in stile transformer che osserva l’immagine in finestre sovrapposte per catturare sia i dettagli locali sia il contesto più ampio. Una volta individuate le regioni, il sistema analizza il contenuto di ciascun riquadro in due modi complementari: calcola centinaia di misure “radiomiche” artigianali che descrivono texture, luminosità e forma, e lascia che una rete neurale profonda apprenda direttamente dai pixel i propri pattern.

Trasformare caratteristiche grezze in decisioni chiare

Raccogliere migliaia di misure numeriche è utile solo se queste sono affidabili e non ridondanti. Gli autori hanno quindi applicato un filtro in tre fasi. Hanno prima mantenuto solo le caratteristiche stabili attraverso diversi centri e valutatori, poi hanno rimosso misure fortemente sovrapposte e infine hanno usato un metodo che favorisce la sparsità per selezionare il sottoinsieme più informativo. Queste caratteristiche raffinate, derivate sia dalla radiomica sia dal deep learning, sono state poi fornite a un modello specializzato per l’elaborazione di tabelle numeriche. Questo modello impara come le diverse caratteristiche interagiscono, permettendogli di categorizzare ogni struttura in classi clinicamente significative, come normale, borderline o chiaramente anormale, in base al suo aspetto nell’esame.

Quanto bene ha funzionato il sistema

Per verificare se l’approccio reggesse anche al di fuori dei dati di addestramento, il team ha valutato le prestazioni su immagini di test interne e su un set separato di quasi 500 esami provenienti da un altro centro. Il rivelatore basato su transformer si è dimostrato particolarmente accurato nel trovare le regioni anatomiche corrette, spesso corrispondendo ai riquadri etichettati dagli esperti con un’elevata sovrapposizione. Nella valutazione dello stato di normalità di una struttura, i modelli che combinavano caratteristiche radiomiche e pattern appresi tramite deep learning hanno costantemente superato i modelli basati su una sola fonte. Sul set di test esterno più difficile, i migliori modelli combinati hanno classificato correttamente le strutture in circa il 96% dei casi, con una forte capacità di rilevare anomalie sottili come un accorciamento dell’osso nasale o spazi fluidici ristretti dietro il tronco encefalico.

Cosa potrebbe significare per la cura prenatale

Dal punto di vista del pubblico, il messaggio è che i computer possono ora contribuire a rendere le ecografie precoci più coerenti e meno dipendenti dal giudizio di un singolo esperto. Trovando e valutando automaticamente strutture delicate nel cervello e nel volto fetali, questo sistema multi-step potrebbe supportare l’individuazione precoce e più obiettiva di potenziali problemi, anche in cliniche affollate con apparecchiature diverse. Pur riconoscendo che condizioni rare e insolite rappresentano ancora una sfida e che sono necessari ulteriori test nel contesto reale, i risultati suggeriscono che strumenti di IA progettati con cura e addestrati su dati multi-centrici potrebbero un giorno diventare partner di routine nello screening del primo trimestre, offrendo ai genitori informazioni più chiare e ai clinici un supporto decisionale più solido in una fase iniziale critica.

Citazione: Zhou, X., Wan, J., Sun, F. et al. A multi-task deep learning and radiomics framework for fetal anatomical structure detection and classification in ultrasound imaging. Sci Rep 16, 11586 (2026). https://doi.org/10.1038/s41598-026-41635-8

Parole chiave: ecografia fetale, screening prenatale, deep learning, radiomica, sviluppo cerebrale e facciale