Clear Sky Science · de

Ein Multi-Task-Deep-Learning- und Radiomics-Framework zur Erkennung und Klassifikation fetaler anatomischer Strukturen in der Ultraschallbildgebung

Warum frühe Gehirnuntersuchungen beim Baby wichtig sind

Erwartende Eltern und Kliniker wünschen sich frühzeitige, klare Antworten zur Gesundheit des Kindes. Ultraschalluntersuchungen in den ersten drei Schwangerschaftsmonaten bieten bereits einen Einblick in das sich entwickelnde Gehirn und Gesicht, wobei subtile Veränderungen Hinweise auf spätere Probleme geben können. Das Lesen dieser körnigen Bilder ist jedoch schwierig und hängt stark von der Fertigkeit der Person mit der Sonde ab. Diese Studie untersucht, wie moderne künstliche Intelligenz als zusätzliche Expertensicht dienen kann, indem sie automatisch kleine Strukturen im fetalen Kopf erkennt und klassifiziert, um frühere und konsistentere Screenings zu unterstützen.

Mehr sehen als das menschliche Auge

Die Forschenden konzentrierten sich auf neun zentrale Gehirn- und Gesichtsmerkmale, die Ärzte routinemäßig zwischen der 11. und 14. Schwangerschaftswoche überprüfen, darunter Gehirnregionen, die Liquorräume um das Gehirn und Gesichtsmarker wie das Nasenbein und den Gaumen. Veränderungen dieser Merkmale können auf genetische oder strukturelle Befunde hinweisen. Selbst bei erfahrenen Spezialisten gibt es traditionell Meinungsverschiedenheiten darüber, was auf dem Ultraschall zu sehen ist, und die Bildqualität variiert von Klinik zu Klinik. Um dem zu begegnen, sammelte das Team einen großen, diversen Datensatz von 4.532 Ultraschalluntersuchungen aus neun medizinischen Zentren, der eine breite Palette von Geräten, Bildstilen und fetalen Lagerungen abbildet. Diese Vielfalt ermöglichte es, ein automatisiertes System zu entwickeln und zu testen, das weniger an ein einzelnes Krankenhaus oder Gerät gebunden ist.

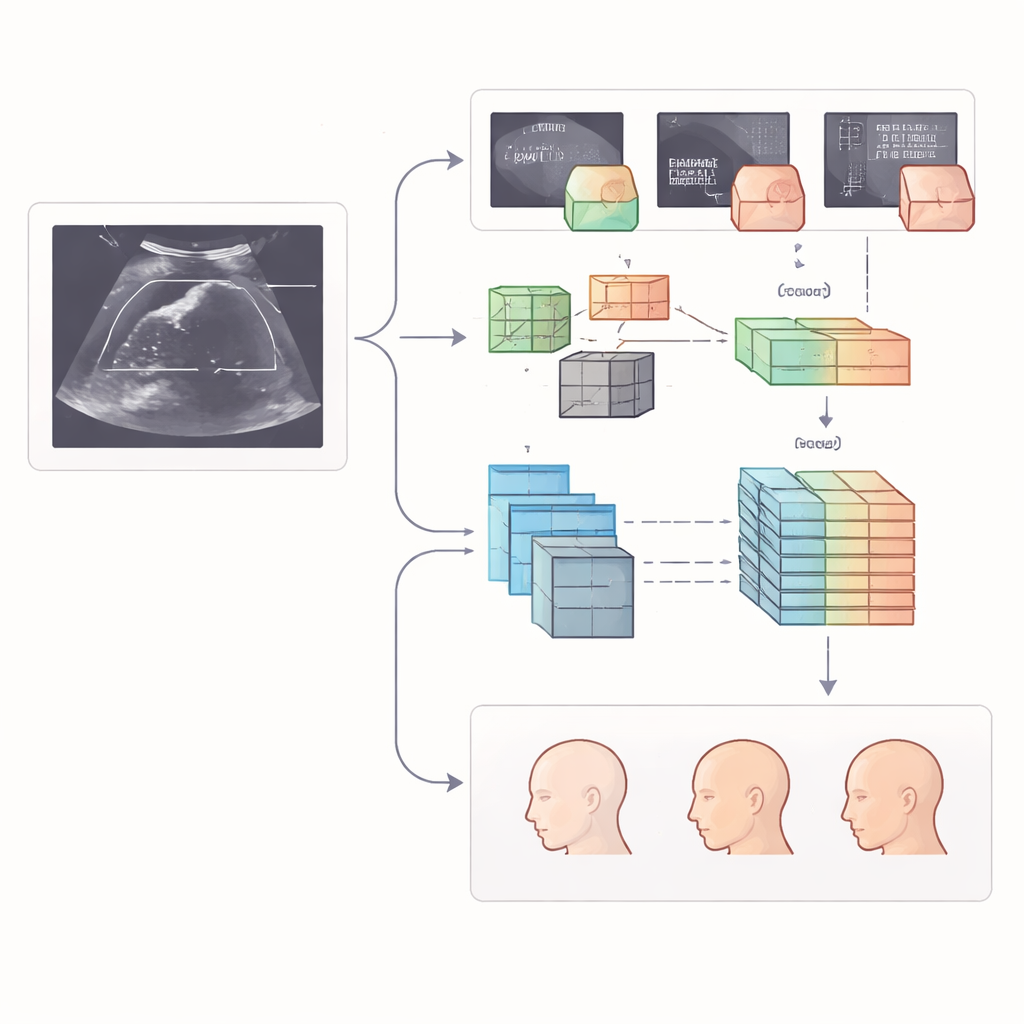

So funktioniert die intelligente Pipeline

Kern der Studie ist eine schrittweise digitale Pipeline, die den Arbeitsablauf eines menschlichen Untersuchers nachahmt und erweitert. Zuerst scannen zwei fortschrittliche Bildanalyse-Modelle jeden Ultraschallframe und zeichnen Begrenzungsboxen um die neun Zielstrukturen, wie etwa das Mittelhirn oder das Nasenbein. Ein Modell ist ein schneller Detektor, der darauf ausgelegt ist, kleine Objekte zügig zu erfassen, während das andere auf einer Transformer-ähnlichen Architektur beruht, die das Bild in überlappenden Fenstern betrachtet, um sowohl lokale Details als auch den größeren Kontext zu erfassen. Sobald die Regionen lokalisiert sind, analysiert das System den Inhalt jeder Box auf zwei sich ergänzende Weisen: Es berechnet Hunderte von handgefertigten „Radiomics“-Messungen, die Textur, Helligkeit und Form beschreiben, und lässt ein tiefes neuronales Netzwerk eigene Muster direkt aus den Pixeln erlernen.

Rohdaten in klare Entscheidungen verwandeln

Das Sammeln von Tausenden numerischer Messwerte ist nur sinnvoll, wenn diese zuverlässig und nicht redundant sind. Die Autoren wendeten daher einen dreistufigen Filter an. Zunächst behielten sie nur jene Merkmale, die über verschiedene Zentren und Gutachter hinweg stabil waren, entfernten dann stark überlappende Messungen und nutzten schließlich eine sparsitätsfördernde Methode, um die informativste Teilmenge auszuwählen. Diese verfeinerten Merkmale, gewonnen aus Radiomics und Deep Learning, wurden anschließend in ein spezielles Modell eingespeist, das für die Verarbeitung tabellarischer Daten ausgelegt ist. Dieses Modell lernt, wie verschiedene Merkmale miteinander interagieren, und kann so jede Struktur in klinisch sinnvolle Kategorien einordnen, etwa normal, grenzwertig oder deutlich auffällig, basierend auf ihrem Erscheinungsbild im Scan.

Wie gut das System abgeschnitten hat

Um zu prüfen, ob der Ansatz über die Trainingsdaten hinaus robust ist, bewertete das Team die Leistung an internen Testbildern sowie an einem separaten Satz von fast 500 Aufnahmen aus einem anderen Zentrum. Der transformer-basierte Detektor erwies sich als besonders genau bei der Lokalisierung der richtigen anatomischen Regionen und stimmte oft sehr stark mit den von Experten gekennzeichneten Boxen überein. Bei der Beurteilung, ob eine Struktur normal ist oder nicht, übertrafen die kombinierten Feature-Modelle—die sowohl Radiomics- als auch tiefgelernte Muster nutzten—konsequent Modelle, die nur auf einer Quelle basierten. Auf dem anspruchsvollsten externen Testdatensatz klassifizierten die besten kombinierten Modelle Strukturen in etwa 96 % der Fälle korrekt und zeigten eine hohe Fähigkeit, subtile Auffälligkeiten wie ein verkürztes Nasenbein oder verengte Liquorräume hinter dem Hirnstamm zu erkennen.

Was das für die pränatale Versorgung bedeuten könnte

Aus laienhafter Perspektive lautet die Botschaft: Computer können inzwischen dazu beitragen, frühe Schwangerschafts-Scans konsistenter zu machen und weniger von der individuellen Beurteilung eines einzelnen Experten abhängig. Indem sie automatisch empfindliche Strukturen im fetalen Gehirn und Gesicht finden und bewerten, könnte dieses mehrstufige System eine frühere, objektivere Erkennung potenzieller Probleme unterstützen—selbst in vielbeschäftigten Kliniken mit unterschiedlicher Ausrüstung. Die Autoren weisen darauf hin, dass seltene und ungewöhnliche Erkrankungen weiterhin eine Herausforderung darstellen und weitere Tests in realen Einsatzszenarien nötig sind, doch deuten ihre Ergebnisse darauf hin, dass sorgfältig entworfene, multi‑zentral trainierte KI‑Werkzeuge eines Tages routinemäßige Partner im Ersttrimester-Screening werden könnten und Eltern klarere Informationen sowie Kliniker stärkere Entscheidungshilfen in einer kritischen frühen Phase bieten.

Zitation: Zhou, X., Wan, J., Sun, F. et al. A multi-task deep learning and radiomics framework for fetal anatomical structure detection and classification in ultrasound imaging. Sci Rep 16, 11586 (2026). https://doi.org/10.1038/s41598-026-41635-8

Schlüsselwörter: fetaler Ultraschall, pränatales Screening, Deep Learning, Radiomics, Gehirn- und Gesichts‑Entwicklung