Clear Sky Science · it

Dataset "Everyday Activity Science and Engineering" per apparecchiare la tavola

Perché apparecchiare la tavola può insegnare ai robot

Apparecchiare la tavola sembra un compito banale, ma in realtà contiene indizi ricchi su come le persone si muovono, pianificano e pensano. Questo studio trasforma quell’azione quotidiana in un esperimento di laboratorio dettagliato, creando un ampio dataset pubblico che può aiutare gli scienziati a costruire robot assistivi più intelligenti e strumenti migliori per comprendere il comportamento umano.

Cogliere un compito semplice in grande dettaglio

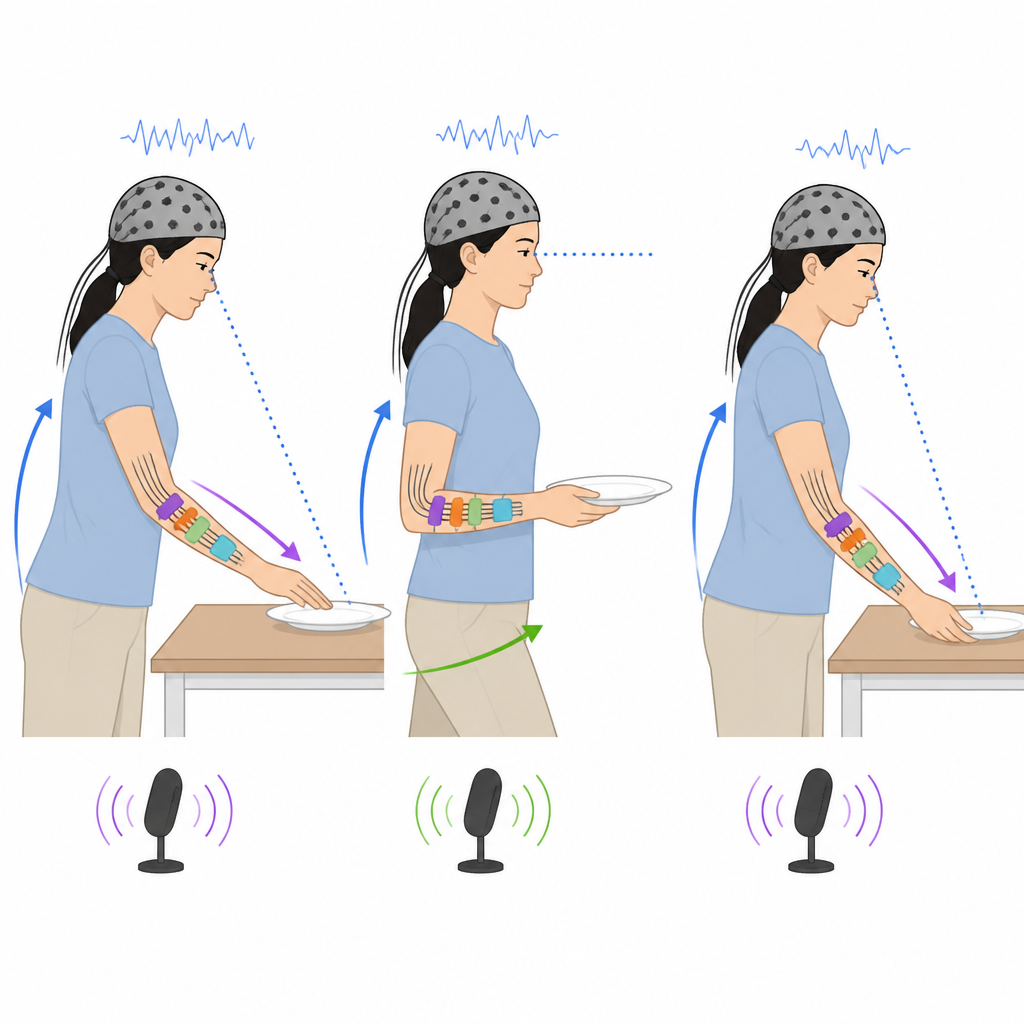

In questo lavoro, i ricercatori hanno chiesto a volontari di apparecchiare un tavolo in una cucina di laboratorio mentre venivano registrati da una serie di sensori. L’attività in sé era familiare: sistemare piatti, tazze e posate per colazioni informali e pranzi formali per diversi numeri di ospiti. Ciò che rende speciale lo studio non è il compito, ma quanto accuratamente è misurato. Ogni partecipante indossava apparecchi leggeri che tracciavano il movimento dell’intero corpo, i movimenti oculari, i muscoli del braccio, la risposta cutanea e l’attività cerebrale, mentre microfoni e più telecamere osservavano e ascoltavano la scena. Questa combinazione offre un quadro denso e sincronizzato nel tempo di ciò che le persone fanno e di come i loro corpi rispondono mentre lo fanno.

Ascoltare pensieri e piani

Per andare oltre il mero movimento, il team ha anche chiesto ai partecipanti di descrivere ciò che stavano facendo. In alcune prove parlavano ad alta voce mentre lavoravano, spiegando scelte come quali oggetti selezionare e dove collocarli sul tavolo. In altre, eseguivano prima il compito in silenzio e poi guardavano un video di sé stessi, commentando le azioni a posteriori. Questi resoconti parlati sono stati registrati e trascritti, quindi codificati con etichette che catturano diversi tipi di pensiero, come pianificazione, individuazione di problemi o spiegazioni di motivi. Combinati con i dati dei sensori, ciò consente ai ricercatori di collegare i processi di pensiero interni ai movimenti e alle decisioni visibili.

Dalle registrazioni grezze a dati utilizzabili

Raccogliere così tante informazioni è tecnicamente impegnativo. Lo studio ha impiegato 22 dispositivi, incluse telecamere per motion capture, sensori indossabili, microfoni e eye tracker, tutti controllati da un sistema informatico centrale. Gli autori hanno sincronizzato con cura il timing di ogni flusso dati in modo che, per esempio, una presa di un piatto vista nel video corrisponda al relativo picco di attività muscolare e a eventuali variazioni nei segnali cerebrali o cutanei. Hanno pulito le registrazioni, corretto frame video mancanti, ritagliato tutti i segnali in un intervallo di tempo comune e li hanno archiviati in formati accessibili. Il team ha inoltre sviluppato strumenti speciali e uno schema di annotazione esteso che suddivide ogni prova in fasi, azioni specifiche e movimenti dettagliati per diverse parti del corpo, oltre a registri per gli oggetti maneggiati.

Cosa contiene la collezione per apparecchiare la tavola

La risorsa risultante, chiamata Everyday Activity Science and Engineering Table Setting Dataset, contiene 78 sessioni registrate, 50 delle quali sono analizzate in dettaglio in questo articolo. Complessivamente corrispondono a circa 300 ore di biosignali e a circa 260 ore di segmenti di attività etichettati. Il dataset si distingue rispetto a sforzi precedenti perché bilancia tre obiettivi difficili da combinare: un numero piuttosto elevato di partecipanti, molte tipologie di sensori e annotazioni dettagliate e multilivello per un compito domestico realistico. Per verificare che i segnali fossero informativi, gli autori hanno eseguito esperimenti di riferimento con apprendimento automatico che hanno usato dati di muscoli, movimento, attività cerebrale e accelerazione per riconoscere automaticamente le diverse fasi del compito, mostrando prestazioni chiaramente migliori del caso, specialmente quando è stato incluso il movimento dell’intero corpo.

Perché questo è importante per gli assistenti di ogni giorno

Per il pubblico generale, il vantaggio di questo lavoro è che costruisce una risorsa condivisa e aperta per sistemi futuri progettati per operare con le persone in contesti naturali, come assistenti da cucina, ausili per la riabilitazione o case intelligenti. Rendendo disponibili gratuitamente registrazioni di alta qualità di un’attività quotidiana semplice ma realistica, insieme a documentazione chiara e codice, gli autori forniscono ai ricercatori un banco di prova comune per studiare come le persone organizzano le proprie azioni e come le macchine potrebbero imparare a interpretarle. In breve, questo articolo mostra come qualcosa di ordinario come apparecchiare la tavola possa diventare una lente potente sul comportamento umano e un passo verso tecnologie più utili e consapevoli delle persone.

Citazione: Meier, M., Hartmann, Y., El Ouahabi, Y. et al. Everyday Activity Science and Engineering Table Setting Dataset. Sci Data 13, 721 (2026). https://doi.org/10.1038/s41597-026-07077-7

Parole chiave: apparecchiare la tavola, attività umana, dataset multimodale, robotica cognitiva, biosignali