Clear Sky Science · fr

Ensemble de données sur la mise de table pour la science et l’ingénierie des activités quotidiennes

Pourquoi la mise de table peut apprendre aux robots

Mettre la table paraît une corvée simple, mais cette activité contient en réalité de nombreux indices sur la façon dont les gens bougent, planifient et pensent. Cette étude transforme cet acte quotidien en une expérience de laboratoire détaillée, en créant un vaste ensemble de données public qui peut aider les chercheurs à concevoir des robots d’assistance plus intelligents et de meilleurs outils pour comprendre le comportement humain.

Capturer une tâche simple avec une grande précision

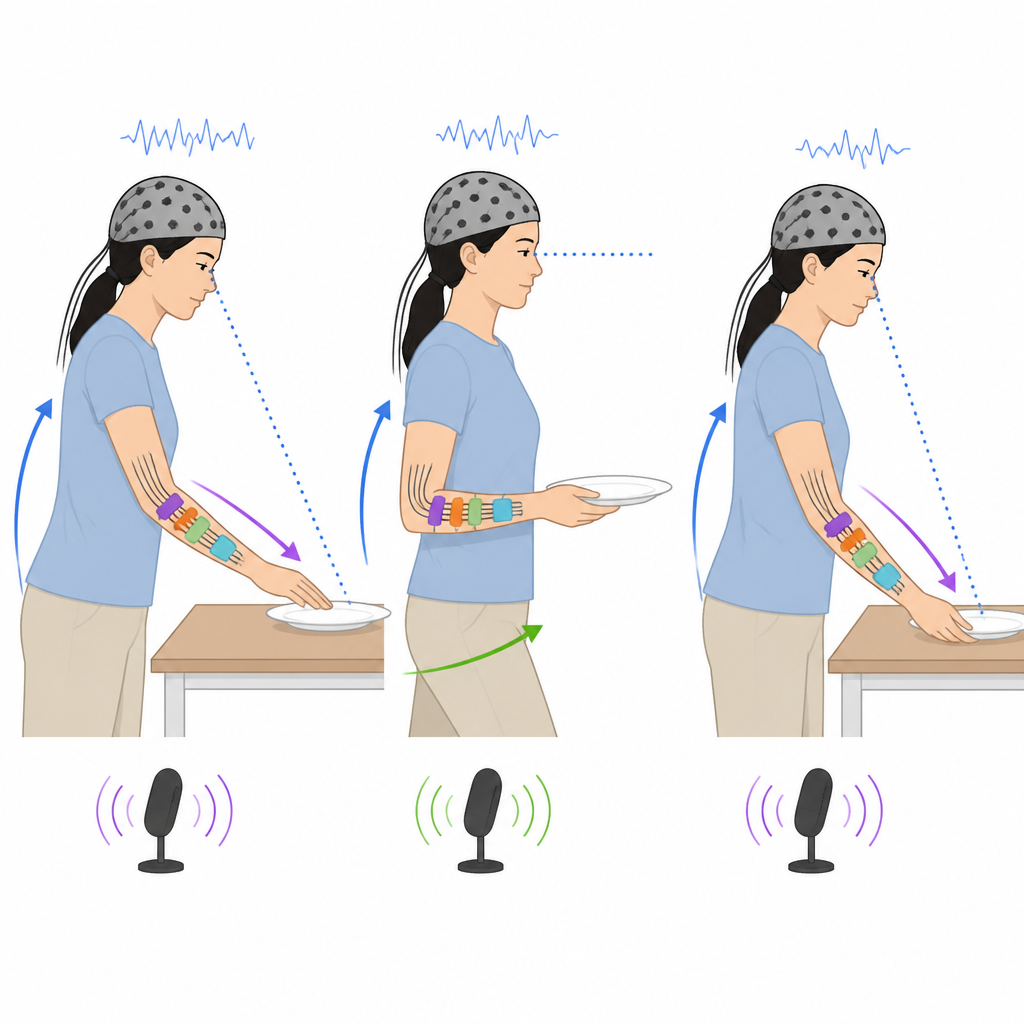

Dans ce travail, les chercheurs ont demandé à des volontaires de mettre un couvert dans une cuisine de laboratoire pendant qu’ils étaient enregistrés par un ensemble de capteurs. L’activité elle-même était familière : disposer assiettes, tasses et couverts pour des petits déjeuners informels ou des déjeuners formels, pour différents nombres d’invités. Ce qui rend l’étude particulière n’est pas la tâche mais la précision des mesures. Chaque participant portait des dispositifs légers qui suivaient le mouvement du corps entier, les mouvements des yeux, les muscles du bras, la conductance cutanée et l’activité cérébrale, tandis que des microphones et plusieurs caméras observaient et enregistraient la scène. Cette combinaison fournit un tableau dense et synchronisé dans le temps de ce que font les personnes et de la façon dont leur corps réagit pendant l’action.

Écouter les pensées et les plans

Pour aller au‑delà des seuls mouvements, l’équipe a également demandé aux participants de décrire ce qu’ils faisaient. Dans certaines sessions, ils parlaient à voix haute pendant qu’ils travaillaient, expliquant des choix comme quels objets sélectionner et où les placer sur la table. Dans d’autres, ils ont d’abord effectué la tâche en silence puis ont regardé une vidéo d’eux‑mêmes, commentant leurs actions après coup. Ces rapports oraux ont été enregistrés et transcrits, puis étiquetés avec des marques reflétant différents types de pensée, comme la planification, la détection de problèmes ou l’explication de motifs. Combinés aux données des capteurs, ces éléments permettent aux chercheurs de relier les processus de pensée internes aux mouvements et décisions visibles.

Des enregistrements bruts à des données exploitables

Collecter autant d’informations est techniquement exigeant. L’étude a utilisé 22 appareils, y compris des caméras de capture de mouvement, des capteurs portables, des microphones et des eye‑trackers, tous pilotés par un système informatique central. Les auteurs ont soigneusement synchronisé le timing de chaque flux de données de sorte que, par exemple, la préhension d’une assiette visible à la vidéo corresponde à la pointe d’activité musculaire et à toute variation des signaux cérébraux ou cutanés. Ils ont nettoyé les enregistrements, corrigé les images vidéo manquantes, tronqué tous les signaux à une même plage temporelle et les ont stockés dans des formats accessibles. L’équipe a aussi développé des outils spécifiques et un schéma d’annotation étendu qui décompose chaque essai en phases, actions précises et mouvements fins pour différentes parties du corps, ainsi qu’en journaux d’objets manipulés.

Ce que contient la collection de mise de table

La ressource résultante, appelée Everyday Activity Science and Engineering Table Setting Dataset, contient 78 sessions enregistrées, dont 50 sont analysées en détail dans cet article. Ensemble, elles représentent environ 300 heures de biosignaux et près de 260 heures de segments d’activité étiquetés. Cet ensemble se distingue des travaux antérieurs car il concilie trois objectifs difficiles à réunir : un nombre relativement important de participants, une grande variété de capteurs et des annotations détaillées et multi‑couches pour une tâche ménagère réaliste. Pour vérifier que les signaux sont informatifs, les auteurs ont réalisé des expériences de référence en apprentissage automatique utilisant des données musculaires, de mouvement, cérébrales et d’accélération pour reconnaître automatiquement différentes étapes de la tâche, montrant des performances nettement supérieures au hasard, en particulier lorsque le mouvement du corps entier était inclus.

Pourquoi c’est important pour les assistants du quotidien

Pour un non‑spécialiste, l’intérêt de ce travail est qu’il constitue une ressource ouverte et partagée pour les systèmes futurs destinés à interagir avec des personnes dans des environnements naturels, comme des assistants de cuisine, des aides à la rééducation ou des maisons intelligentes. En mettant à disposition des enregistrements de haute qualité d’une activité quotidienne simple mais réaliste, accompagnés d’une documentation claire et de code, les auteurs offrent aux chercheurs un banc d’essai commun pour étudier comment les gens organisent leurs actions et comment les machines pourraient apprendre à les interpréter. En bref, cet article montre comment quelque chose d’aussi ordinaire que mettre la table peut devenir une lentille puissante sur le comportement humain et une étape vers des technologies plus utiles et attentives aux personnes.

Citation: Meier, M., Hartmann, Y., El Ouahabi, Y. et al. Everyday Activity Science and Engineering Table Setting Dataset. Sci Data 13, 721 (2026). https://doi.org/10.1038/s41597-026-07077-7

Mots-clés: mise de table, activité humaine, ensemble de données multimodal, robotique cognitive, biosignaux