Clear Sky Science · es

Conjunto de datos de ciencia e ingeniería de la actividad cotidiana: poner la mesa

Por qué poner la mesa puede enseñar a los robots

Poner la mesa parece una tarea sencilla, pero en realidad encierra pistas valiosas sobre cómo se mueven, planifican y piensan las personas. Este estudio transforma ese acto cotidiano en un experimento de laboratorio detallado, creando un gran conjunto de datos público que puede ayudar a los científicos a construir robots asistenciales más inteligentes y mejores herramientas para comprender el comportamiento humano.

Capturar una tarea simple con gran detalle

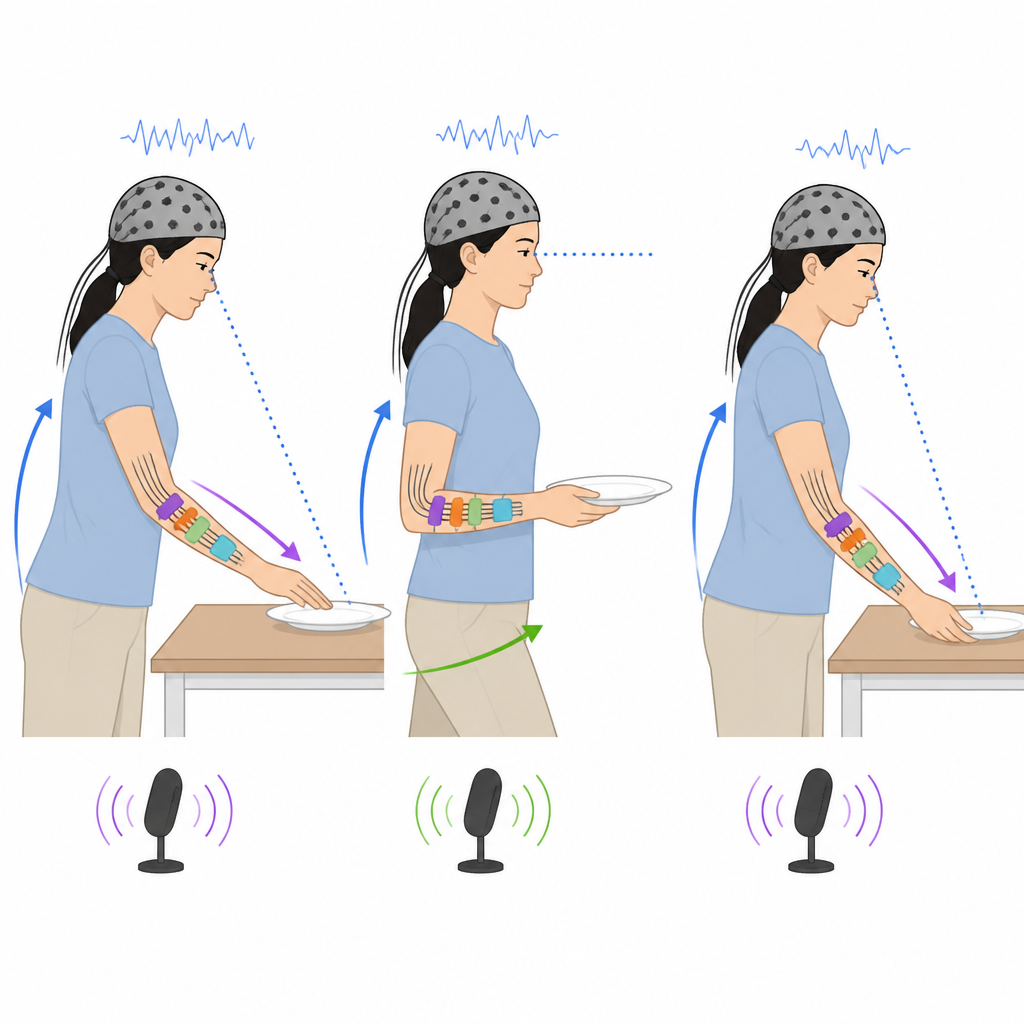

En este trabajo, los investigadores pidieron a voluntarios que pusieran una mesa en una cocina de laboratorio mientras eran registrados por un conjunto de sensores. La actividad en sí era familiar: disponer platos, vasos y cubiertos para desayunos informales y comidas formales, para distintos números de comensales. Lo que hace especial al estudio no es la tarea, sino el cuidado con que se midió. Cada participante llevaba equipo ligero que rastreaba el movimiento de todo el cuerpo, los movimientos oculares, los músculos del brazo, la respuesta de la piel y la actividad cerebral, mientras micrófonos y varias cámaras observaban y escuchaban la escena. Esta combinación ofrece una imagen densa y sincronizada en el tiempo de lo que las personas hacen y de cómo responden sus cuerpos al hacerlo.

Escuchar los pensamientos y planes

Para ir más allá de los movimientos, el equipo también pidió a los participantes que describieran lo que estaban haciendo. En algunas pruebas hablaban en voz alta mientras trabajaban, explicando decisiones como qué artículos elegir y dónde colocarlos en la mesa. En otras, primero realizaron la tarea en silencio y más tarde vieron un vídeo de sí mismos, comentando sus acciones a posteriori. Estos informes hablados se grabaron y transcribieron, y luego se etiquetaron con marcadores que capturan distintos tipos de pensamiento, como planificación, detección de problemas o explicación de motivos. Combinados con los datos de los sensores, esto permite a los investigadores vincular los procesos mentales internos con los movimientos y decisiones visibles.

De las grabaciones crudas a datos utilizables

Recopilar tanta información es técnicamente exigente. El estudio utilizó 22 dispositivos, incluidas cámaras de captura de movimiento, sensores portátiles, micrófonos y rastreadores oculares, todos controlados por un sistema informático central. Los autores sincronizaron cuidadosamente el tiempo de cada flujo de datos para que, por ejemplo, la acción de agarrar un plato vista en vídeo coincida con el pico correspondiente en la actividad muscular y con cualquier cambio en las señales cerebrales o de la piel. Limpiaron las grabaciones, corrigieron fotogramas de vídeo perdidos, recortaron todas las señales a un intervalo temporal común y las almacenaron en formatos accesibles. El equipo también desarrolló herramientas especiales y un esquema de anotación ampliado que divide cada ensayo en fases, acciones específicas y movimientos de alta resolución para distintas partes del cuerpo, además de registros de los objetos manipulados.

Qué incluye la colección sobre poner la mesa

El recurso resultante, llamado Conjunto de datos de ciencia e ingeniería de la actividad cotidiana: poner la mesa, contiene 78 sesiones grabadas, 50 de las cuales se analizan en detalle en este artículo. En conjunto suman alrededor de 300 horas de señales biológicas y unas 260 horas de segmentos de actividad etiquetados. El conjunto de datos destaca frente a esfuerzos anteriores porque equilibra tres objetivos difíciles de combinar: un número relativamente grande de participantes, muchos tipos de sensores y anotaciones detalladas y en múltiples capas para una tarea doméstica realista. Para comprobar que las señales son informativas, los autores realizaron experimentos de referencia de aprendizaje automático que usaron datos musculares, de movimiento, cerebrales y de aceleración para reconocer automáticamente las distintas etapas de la tarea, mostrando un rendimiento claramente mejor que el azar, especialmente cuando se incluía el movimiento de todo el cuerpo.

Por qué esto importa para los asistentes cotidianos

Para el público en general, el valor de este trabajo es que construye un recurso abierto y compartido para futuros sistemas destinados a trabajar con personas en entornos naturales, como asistentes de cocina, ayudas de rehabilitación o viviendas inteligentes. Al poner a disposición grabaciones de alta calidad de una actividad diaria simple pero realista, junto con documentación clara y código, los autores ofrecen a los investigadores un banco de pruebas común para estudiar cómo las personas organizan sus acciones y cómo las máquinas podrían aprender a interpretarlas. En resumen, este artículo muestra cómo algo tan ordinario como poner la mesa puede convertirse en una lente poderosa para observar el comportamiento humano y en un peldaño hacia tecnologías más útiles y conscientes del factor humano.

Cita: Meier, M., Hartmann, Y., El Ouahabi, Y. et al. Everyday Activity Science and Engineering Table Setting Dataset. Sci Data 13, 721 (2026). https://doi.org/10.1038/s41597-026-07077-7

Palabras clave: poner la mesa, actividad humana, conjunto de datos multimodal, robótica cognitiva, señales biológicas