Clear Sky Science · de

Alltägliche Aktivitätswissenschaft und Ingenieurwesen: Datensatz zum Tischdecken

Warum Tischdecken Robotern etwas beibringen kann

Tischdecken wirkt wie eine einfache Aufgabe, enthält aber reichhaltige Hinweise darauf, wie Menschen sich bewegen, planen und denken. Diese Studie verwandelt diese alltägliche Handlung in ein sorgfältig gestaltetes Laborexperiment und erzeugt einen großen öffentlichen Datensatz, der Forschenden helfen kann, intelligentere Assistenzroboter und bessere Werkzeuge zum Verständnis menschlichen Verhaltens zu entwickeln.

Eine einfache Aufgabe in detailreicher Erfassung

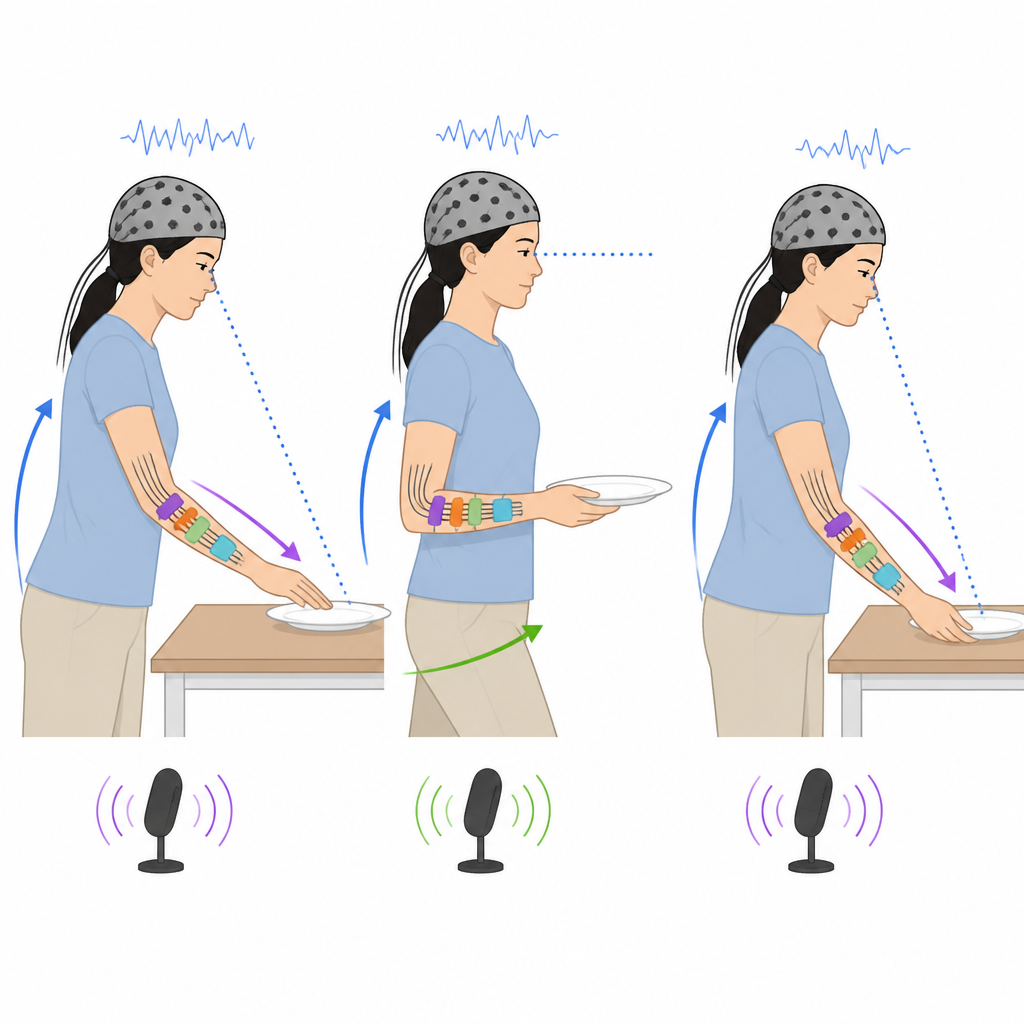

In dieser Arbeit baten die Forschenden Freiwillige, in einer Labor-Küche einen Esstisch zu decken, während eine Reihe von Sensoren aufzeichnete. Die Tätigkeit selbst war vertraut: Teller, Tassen und Besteck für informelle Frühstücke und formelle Mittagessen für unterschiedliche Gästezahlen anzuordnen. Besonderheit der Studie ist nicht die Aufgabe, sondern die Sorgfalt der Messung. Jede Teilnehmerin und jeder Teilnehmer trug leichte Geräte, die die gesamte Körperbewegung, Augenbewegungen, Armmuskulatur, Hautreaktionen und Gehirnaktivität verfolgten, während Mikrofone und mehrere Kameras die Szene beobachteten und aufzeichneten. Diese Kombination liefert ein dichtes, zeitlich synchronisiertes Bild dessen, was Menschen tun und wie ihre Körper darauf reagieren.

In Gedanken und Pläne hineinhören

Um über reine Bewegungen hinauszugehen, baten die Forschenden die Teilnehmenden außerdem, zu beschreiben, was sie tun. In einigen Durchläufen sprachen sie laut während der Arbeit und erklärten Entscheidungen wie welche Gegenstände ausgewählt wurden und wo sie auf dem Tisch platziert werden sollten. In anderen Durchläufen führten sie die Aufgabe zunächst schweigend aus und sahen sich später ein Video von sich selbst an, um die Handlungen nachträglich zu kommentieren. Diese gesprochenen Berichte wurden aufgezeichnet und transkribiert sowie mit Tags versehen, die verschiedene Denkprozesse erfassen, etwa Planung, Wahrnehmung von Problemen oder Begründungen. Zusammengenommen mit den Sensordaten erlaubt dies, innere Gedankenprozesse mit sichtbaren Bewegungen und Entscheidungen zu verknüpfen.

Von Rohaufnahmen zu nutzbaren Daten

So viele Informationen zu sammeln ist technisch anspruchsvoll. Die Studie nutzte 22 Geräte, darunter Motion-Capture-Kameras, tragbare Sensoren, Mikrofone und Eye-Tracker, alles gesteuert von einem zentralen Computersystem. Die Autorinnen und Autoren synchronisierten sorgfältig das Timing aller Datenströme, sodass beispielsweise ein im Video sichtbarer Griff an einem Teller mit dem entsprechenden Muskelaktivitätssignal und etwaigen Veränderungen in Gehirn- oder Hautsignalen übereinstimmt. Sie bereinigten die Aufnahmen, reparierten verlorene Videoframes, kürzten alle Signale auf einen gemeinsamen Zeitbereich und speicherten sie in zugänglichen Formaten. Das Team entwickelte zudem spezielle Werkzeuge und ein erweitertes Annotationsschema, das jeden Versuch in Phasen, spezifische Aktionen und fein granulare Bewegungen verschiedener Körperteile unterteilt sowie Protokolle zu den handhabten Objekten enthält.

Was die Sammlung zum Tischdecken umfasst

Die resultierende Ressource, genannt Everyday Activity Science and Engineering Table Setting Dataset, enthält 78 aufgezeichnete Sitzungen, von denen 50 in diesem Artikel detailliert analysiert werden. Zusammen ergeben sie rund 300 Stunden an Biosignalen und etwa 260 Stunden an gekennzeichneten Aktivitätssegmenten. Der Datensatz hebt sich gegenüber früheren Bemühungen hervor, weil er drei schwer zu kombinierende Ziele ausbalanciert: eine vergleichsweise große Teilnehmerzahl, viele Sensortypen und detaillierte, mehrschichtige Annotationen für eine realistische Haushaltstätigkeit. Um zu prüfen, ob die Signale informativ sind, führten die Autorinnen und Autoren Basis-Maschinenlern-Experimente durch, die Muskel-, Bewegungs-, Gehirn- und Beschleunigungsdaten nutzten, um automatisch verschiedene Stadien der Aufgabe zu erkennen und dabei eine deutlich über Zufall liegende Leistung zeigten, insbesondere wenn die gesamte Körperbewegung einbezogen wurde.

Warum das für alltägliche Helfer wichtig ist

Für Laien liegt der Nutzen dieser Arbeit darin, dass sie eine gemeinsame, offene Ressource für künftige Systeme schafft, die mit Menschen in natürlichen Umgebungen arbeiten sollen, etwa Küchenassistenten, Rehabilitationshilfen oder intelligente Häuser. Indem hochwertige Aufnahmen einer einfachen, aber realistischen Alltagsaktivität frei zugänglich gemacht werden, zusammen mit klarer Dokumentation und Code, geben die Autorinnen und Autoren Forschenden ein gemeinsames Testfeld, um zu untersuchen, wie Menschen ihre Handlungen organisieren und wie Maschinen lernen könnten, sie zu interpretieren. Kurz: Dieser Artikel zeigt, wie etwas Alltägliches wie Tischdecken zu einer kraftvollen Linse auf menschliches Verhalten und zu einem Sprungbrett für nützlichere, menschenorientierte Technologien werden kann.

Zitation: Meier, M., Hartmann, Y., El Ouahabi, Y. et al. Everyday Activity Science and Engineering Table Setting Dataset. Sci Data 13, 721 (2026). https://doi.org/10.1038/s41597-026-07077-7

Schlüsselwörter: Tisch decken, menschliche Aktivität, multimodaler Datensatz, kognitive Robotik, Biosignale