Clear Sky Science · fr

Conceptions avancées de circuits logiques neuronaux utilisant des modèles à décharges : un cadre pour la biocomputation séquentielle

Pourquoi fabriquer des ordinateurs à partir de cellules cérébrales importe

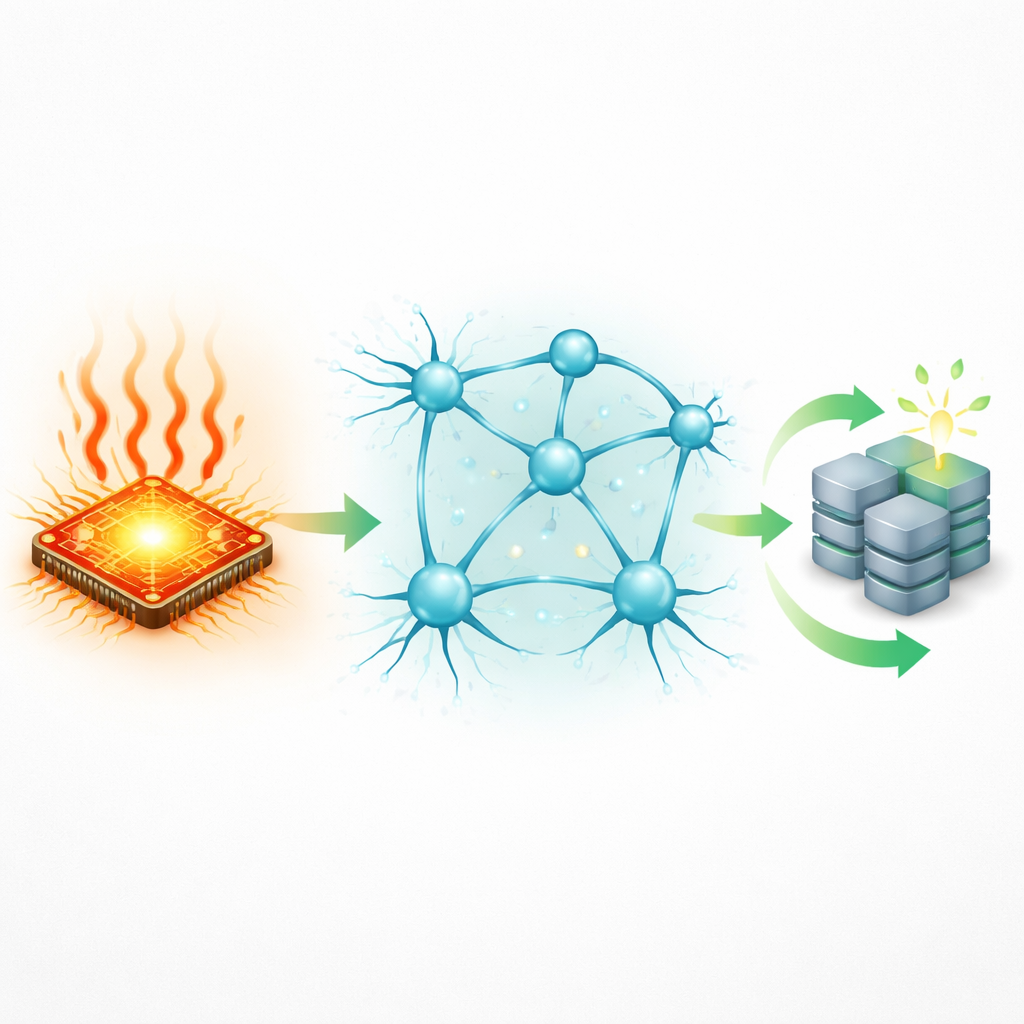

À mesure que nos ordinateurs portables et centres de données gagnent en puissance, ils deviennent aussi plus chauds, plus gourmands en électricité et plus difficiles à miniaturiser. Cet article explore une voie radicalement différente : utiliser des réseaux de cellules nerveuses semblables à celles du cerveau comme éléments de base des ordinateurs du futur. Les auteurs montrent, par des simulations informatiques, comment de petits groupes de neurones modèles peuvent être câblés et réglés pour se comporter comme des composants numériques familiers — portes logiques et cellules mémoire — tout en maîtrisant la consommation d’énergie. Leur cadre pourrait guider de futurs « puces vivantes » fabriquées à partir de neurones réels ou de matériel inspiré du cerveau.

Du silicium surchauffé aux circuits vivants

Les puces en silicium modernes butent sur des limites physiques imposées par la chaleur, la consommation d’énergie et la taille minimale fiable des transistors. Parallèlement, les systèmes biologiques, notamment les neurones, accomplissent déjà des prouesses de traitement de l’information tout en utilisant très peu d’énergie. Les chercheurs s’interrogent donc pour savoir si l’on peut emprunter des idées — voire des matériaux — à la biologie pour construire de nouveaux types d’ordinateurs. Des réseaux neuronaux cultivés en laboratoire ont déjà appris à reconnaître la parole et même à jouer à des jeux vidéo simples, laissant entrevoir que des cellules peuvent être organisées en processeurs d’information utiles. Cependant, jusqu’à présent, il n’existait aucune recette claire et réutilisable pour faire en sorte que ces circuits neuronaux se comportent comme les blocs logiques horodatés et précis utilisés en électronique numérique.

Apprendre aux neurones à décharges à parler en bits

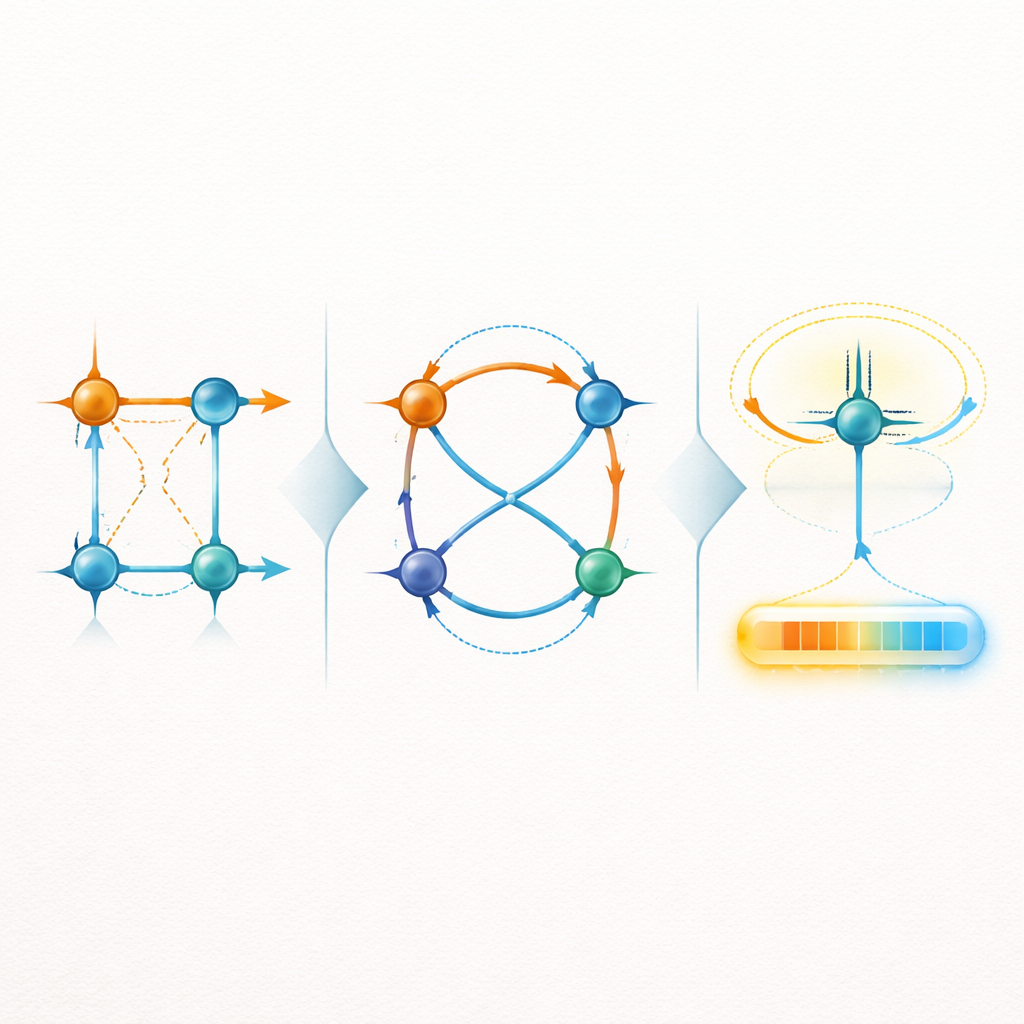

Les auteurs abordent ce défi en concevant des réseaux de neurones à décharges simulés — des modèles mathématiques qui imitent la façon dont les neurones réels envoient de brèves impulsions électriques. Ils considèrent la présence d’un groupe d’impulsions comme un « 1 » numérique et leur absence comme un « 0 ». En choisissant soigneusement les intensités et les timings des connexions entre neurones, ils construisent des versions de portes logiques standards : AND, AND-NOT, NOT et NAND. Ces portes constituent l’alphabet de la logique numérique ; la NAND seule suffit à construire n’importe quelle fonction logique. L’astuce clé consiste à mêler des connexions excitatrices, qui encouragent un neurone à décharger, et des connexions inhibitrices, qui suppriment l’activité. Par exemple, leur porte AND-NOT ne s’active que lorsque l’entrée « go » est active tandis que l’entrée « stop » est silencieuse, reproduisant étroitement la façon dont certains neurones réels pondèrent les signaux entrants.

Faire mémoriser les neurones comme des puces

Au-delà des portes simples, les ordinateurs réels s’appuient sur des circuits capables de se souvenir des entrées passées. L’équipe montre comment assembler leurs portes neuronales en blocs de mémoire numériques classiques. Ils créent un latch SR, qui stocke un bit en réinjectant les sorties de deux portes l’une dans l’autre, ainsi qu’un latch SR commandé qui ne répond que lorsqu’un signal de contrôle supplémentaire est actif. Plus loin, ils conçoivent un bascule D, un élément mémoire standard qui copie son entrée seulement au front montant d’un signal d’horloge. Pour maintenir l’alignement temporel des décharges dans ces réseaux plus complexes, ils introduisent des « tampons neuronaux » — des neurones supplémentaires qui agissent comme des lignes de retard ajustables afin que les signaux arrivant par des chemins différents atteignent une porte à peu près au même moment, réduisant ainsi les erreurs logiques causées par des impulsions mal synchronisées.

Équilibrer activité de type cérébral et consommation d’énergie

Une préoccupation majeure pour tout système de calcul biologique est le coût métabolique : les neurones ont besoin d’énergie pour décharger et pour réinitialiser leur chimie interne. Les auteurs associent leurs modèles à décharges à un modèle énergétique qui suit une mesure abstraite proche du niveau de carburant d’une cellule. Ils mesurent ensuite comment cette variable d’énergie évolue lorsque leurs portes et circuits mémoire fonctionnent. Entre les portes simples et les latchs et bascules plus complexes, la charge énergétique simulée reste dans une fourchette étroite, même lorsque la taille des circuits augmente. Cela suggère que, du moins en principe, une logique et un stockage de type numérique peuvent être réalisés par des neurones sans demande énergétique incontrôlée, à condition que les circuits soient conçus en tenant compte du timing et de l’équilibre excitation–inhibition.

Vers des machines logiques vivantes

En termes simples, l’article soutient que de petits réseaux de neurones peuvent être câblés et réglés pour se comporter comme les interrupteurs marche/arrêt et les petites mémoires à l’intérieur des puces actuelles, tout en restant métaboliquement stables. Le travail est encore virtuel — aucun neurone vivant n’a été utilisé — mais les conceptions sont pensées pour être transplantables sur des plateformes neuronales sur puce réelles et sur du matériel neuromorphique qui imite les neurones à décharges en silicium. En proposant une bibliothèque de composants logiques réutilisables à base de neurones, des règles pour synchroniser leur timing et des estimations de leurs besoins énergétiques, ce cadre fait passer l’idée d’ordinateurs neuronaux d’un concept vague à une réalité ingénierée, où la précision de type numérique et l’adaptabilité biologique pourraient un jour coexister dans le même dispositif de calcul.

Citation: Basso, G., Scherer, R. & Barros, M.T. Advanced neuronal logic circuit designs using spiking models: a framework for sequential biocomputation. npj Unconv. Comput. 3, 20 (2026). https://doi.org/10.1038/s44335-026-00066-4

Mots-clés: biocomputation neuronale, circuits logiques à décharges, mémoire biologique, matériel neuromorphique, informatique économe en énergie