Clear Sky Science · de

Fortgeschrittene neuronale Logikschaltungen mit Spiking-Modellen: ein Rahmenwerk für sequentielle Bioberechnung

Warum es wichtig ist, Computer aus Nervenzellen zu bauen

Während unsere Laptops und Rechenzentren immer leistungsfähiger werden, steigen gleichzeitig ihre Wärmeentwicklung, ihr Energiebedarf und die Schwierigkeiten, sie weiter zu miniaturisieren. Dieses Papier verfolgt einen radikal anderen Weg: Netzwerke gehirnähnlicher Nervenzellen als Bausteine zukünftiger Computer zu nutzen. Die Autorinnen und Autoren zeigen in Computersimulationen, wie kleine Gruppen modellierter Neuronen so verdrahtet und abgestimmt werden können, dass sie sich wie vertraute digitale Komponenten verhalten—Logikgatter und Speicherzellen—und dabei den Energieverbrauch im Griff behalten. Ihr Rahmenwerk könnte als Leitfaden für künftige „lebende Chips“ aus echten Neuronen oder für gehirninspirierte Hardware dienen.

Von heißem Silizium zu lebenden Schaltungen

Moderne Siliziumchips stoßen an physikalische Grenzen, die durch Wärme, Leistungsaufnahme und die minimale zuverlässig herstellbare Transistorgröße gesetzt sind. Gleichzeitig vollbringen biologische Systeme, insbesondere Neurone, bereits erstaunliche Informationsverarbeitungsaufgaben bei sehr geringem Energieaufwand. Forscherinnen und Forscher fragen sich daher, ob wir Ideen oder sogar Materialien aus der Biologie übernehmen können, um neue Computertypen zu bauen. In Labors gezüchtete neuronale Netzwerke haben bereits gelernt, Sprache zu erkennen und einfache Videospiele zu spielen, was darauf hindeutet, dass Zellen zu zielgerichteten Informationsverarbeitern organisiert werden können. Bisher gab es jedoch kein klares, wiederverwendbares Rezept, um diese neuronalen Schaltkreise so arbeiten zu lassen wie die präzisen, getakteten Logikbausteine der digitalen Elektronik.

Spiking-Neurone darin schulen, in Bits zu sprechen

Die Autorinnen und Autoren gehen dieses Problem an, indem sie Netzwerke simulierte Spiking-Neurone entwerfen—mathematische Modelle, die nachahmen, wie reale Neurone kurze elektrische Impulse senden. Sie interpretieren das Auftreten eines Spike-Bursts als digitales „1“ und dessen Ausbleiben als „0“. Durch sorgfältige Wahl der Stärke und des Timings der Verbindungen zwischen Neuronen bauen sie Versionen standardmäßiger Logikgatter: AND, AND-NOT, NOT und NAND. Diese Gatter sind das Alphabet der digitalen Logik; NAND allein genügt, um jede logische Funktion zu konstruieren. Ein wichtiger Trick besteht darin, exzitatorische Verbindungen, die ein Neuron zum Feuern anregen, mit inhibitorischen zu mischen, die Aktivität unterdrücken. Zum Beispiel feuert ihr AND-NOT-Gatter nur, wenn der „Go“-Eingang aktiv ist, während der „Stop“-Eingang still bleibt—eine Funktionsweise, die dem Gewichtungsprinzip realer Neurone bei eingehenden Signalen sehr nahekommt.

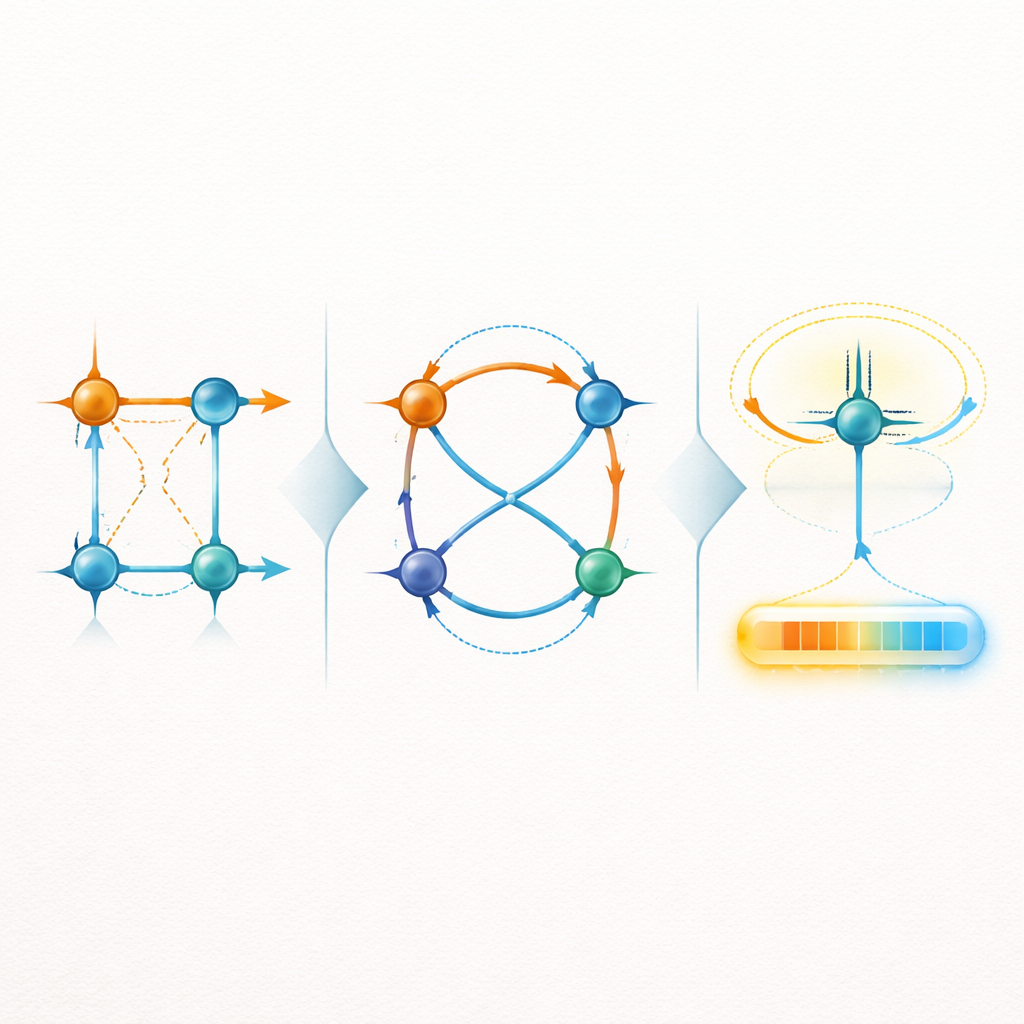

Neurone zum Erinnern bringen wie Computerchips

Über einfache Gatter hinaus verlassen sich reale Computer auf Schaltungen, die vergangene Eingaben speichern können. Das Team zeigt, wie sich ihre neuronalen Gatter zu klassischen Bausteinen digitalen Speichers zusammenfügen lassen. Sie erstellen eine SR-Latch, die ein Bit speichert, indem die Ausgänge zweier Gatter gegenseitig zurückgeführt werden, sowie eine gesteuerte SR-Latch, die nur auf ein zusätzliches Steuersignal reagiert. Weiterhin entwerfen sie einen D-Flip-Flop, ein Standard-Speicherelement, das seinen Eingang nur bei der ansteigenden Flanke eines Taktsignals übernimmt. Um das Timing der Spikes in diesen komplexeren Netzwerken zu synchronisieren, führen sie „neurale Puffer“ ein—zusätzliche Neurone, die wie einstellbare Laufzeitglieder wirken, sodass Signale, die unterschiedlichen Pfaden folgen, nahezu gleichzeitig an einem Gatter ankommen und Logikfehler durch fehlgetimte Spikes verringert werden.

Gleichgewicht zwischen gehirnähnlicher Aktivität und Energieverbrauch

Ein zentrales Problem für jedes biologische Rechnungssystem ist der metabolische Aufwand: Neurone benötigen Energie, um zu feuern und ihre interne Chemie zurückzusetzen. Die Autorinnen und Autoren koppeln ihre Spiking-Modelle mit einem Energiemodell, das eine abstrahierte Größe ähnlich dem Brennstoffvorrat einer Zelle verfolgt. Sie messen, wie sich diese Energievariable verändert, während ihre Gatter und Speicherschaltungen arbeiten. Sowohl bei einfachen Gattern als auch bei komplexeren Latches und Flip-Flops bleibt die simulierte Energiebelastung in einem engen Bereich, selbst wenn die Schaltungen wachsen. Das deutet darauf hin, dass prinzipiell digitale Logik und Speicherung von Neuronen ausgeführt werden können, ohne dass die Energieanforderungen außer Kontrolle geraten—vorausgesetzt, die Schaltungen werden unter Berücksichtigung von Timing und dem Gleichgewicht von Erregung und Hemmung entworfen.

Schritte hin zu lebenden Logikmaschinen

Kurz gesagt argumentiert das Papier, dass kleine Netzwerke von Neuronen so verdrahtet und abgestimmt werden können, dass sie wie die Ein-/Ausschalter und kleinen Speicher heutiger Chips funktionieren, dabei jedoch metabolisch stabil bleiben. Die Arbeit ist noch virtuell—es wurden keine lebenden Neurone verwendet—aber die Entwürfe sind darauf ausgelegt, auf reale Neuron-en-auf-einem-Chip-Plattformen und auf neuromorphe Hardware, die Spiking-Neurone in Silizium nachahmt, übertragbar zu sein. Indem es eine Bibliothek wiederverwendbarer neuronaler Logikkomponenten, Regeln zur Synchronisation ihres Timings und Abschätzungen ihres Energiebedarfs bietet, rückt dieses Rahmenwerk die neuronbasierten Computer von einer vagen Idee zu einer ingenieurtechnisch gestaltbaren Realität, in der digitale Präzision und biologische Anpassungsfähigkeit eines Tages im selben Rechengerät koexistieren könnten.

Zitation: Basso, G., Scherer, R. & Barros, M.T. Advanced neuronal logic circuit designs using spiking models: a framework for sequential biocomputation. npj Unconv. Comput. 3, 20 (2026). https://doi.org/10.1038/s44335-026-00066-4

Schlüsselwörter: neuronal-bioberechnung, spiking-Logikschaltungen, biologischer Speicher, neuromorphe Hardware, energieeffizientes Rechnen