Clear Sky Science · es

Diseños avanzados de circuitos lógicos neuronales usando modelos de disparo: un marco para la biocomputación secuencial

Por qué importa construir ordenadores con células cerebrales

A medida que nuestros portátiles y centros de datos se vuelven cada vez más potentes, también generan más calor, consumen más electricidad y resultan más difíciles de miniaturizar. Este artículo explora un camino radicalmente distinto: usar redes de células nerviosas similares a las del cerebro como bloques constructivos de futuros ordenadores. Los autores muestran, mediante simulaciones por ordenador, cómo pequeños grupos de neuronas modelo pueden conectarse y ajustarse para comportarse como componentes digitales familiares —puertas lógicas y celdas de memoria— manteniendo el consumo energético bajo control. Su marco podría orientar futuros “chips vivos” hechos con neuronas reales o hardware inspirado en el cerebro.

Del silicio sobrecalentado a los circuitos vivos

Los chips de silicio modernos se topan con límites físicos impuestos por el calor, el consumo y el tamaño mínimo fiable de los transistores. Al mismo tiempo, los sistemas biológicos, en particular las neuronas, ya realizan hazañas asombrosas de procesamiento de la información consumiendo muy poca energía. Por ello, los investigadores se preguntan si podemos tomar prestadas ideas o incluso materiales de la biología para construir nuevos tipos de ordenadores. Redes neuronales cultivadas en el laboratorio ya han aprendido a reconocer el habla e incluso a jugar videojuegos sencillos, lo que sugiere que las células pueden organizarse en procesadores de información con propósito. Sin embargo, hasta ahora no existía una receta clara y reutilizable para hacer que estos circuitos neuronales se comporten como los bloques lógicos precisos y sincronizados usados en la electrónica digital.

Enseñar a las neuronas de disparo a hablar en bits

Los autores abordan esto diseñando redes de neuronas de disparo simuladas —modelos matemáticos que imitan cómo las neuronas reales emiten pulsos eléctricos breves—. Tratan la presencia de un estallido de pulsos como un “1” digital y su ausencia como un “0”. Mediante la elección cuidadosa de las intensidades y los tempos de las conexiones entre neuronas, construyen versiones de puertas lógicas estándar: AND, AND-NOT, NOT y NAND. Estas puertas son el alfabeto de la lógica digital; NAND por sí sola basta para construir cualquier función lógica. Un truco clave es mezclar conexiones excitatorias, que favorecen que una neurona dispare, con conexiones inhibitorias, que suprimen la actividad. Por ejemplo, su puerta AND-NOT dispara solo cuando la entrada de “avance” está activa mientras la de “paro” permanece silenciosa, reflejando de cerca cómo algunas neuronas reales ponderan las señales entrantes.

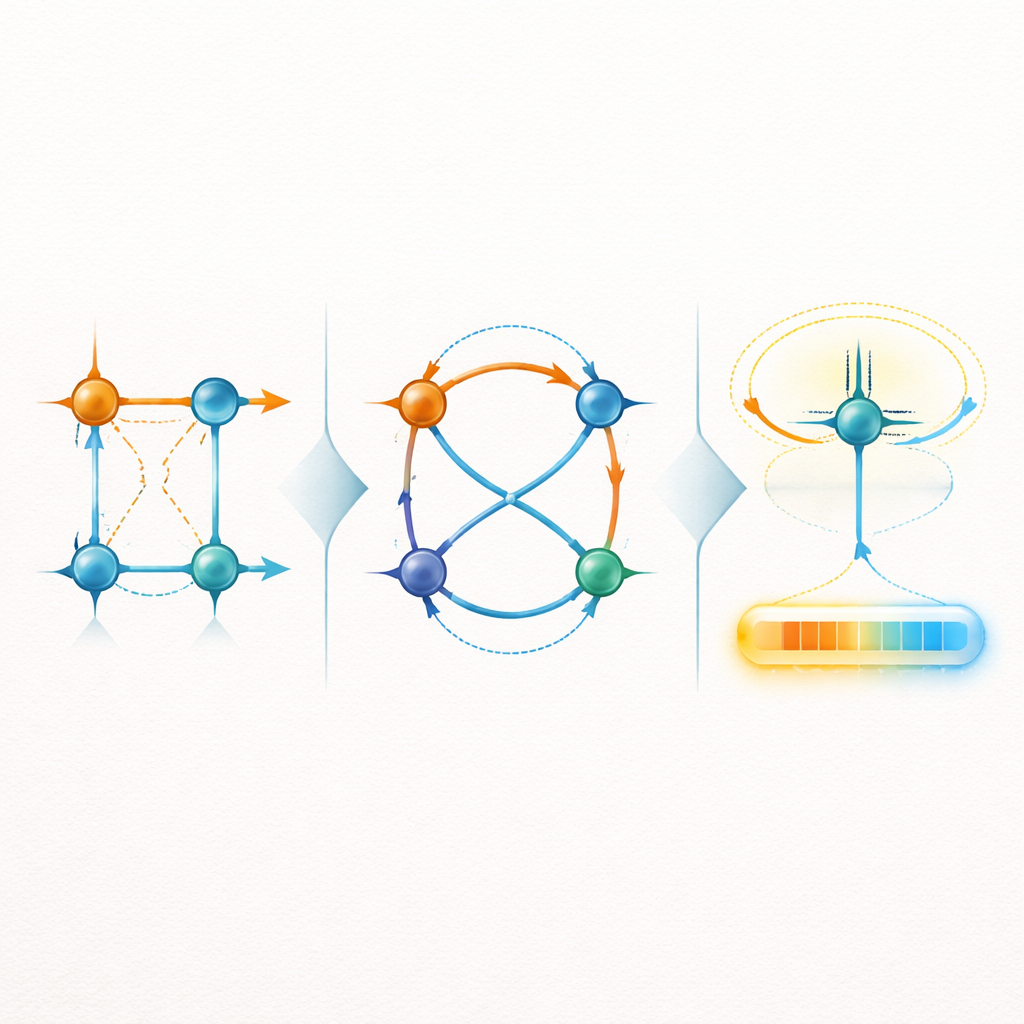

Hacer que las neuronas recuerden como los chips de ordenador

Más allá de las puertas simples, los ordenadores reales dependen de circuitos que pueden recordar entradas pasadas. El equipo muestra cómo ensamblar sus puertas neuronales en bloques de memoria clásicos digitales. Crean un latch SR, que almacena un bit alimentando las salidas de dos puertas de vuelta entre sí, así como un latch SR con compuerta que responde solo cuando está activo un señal extra de control. Avanzando más, diseñan un flip-flop tipo D, un elemento de memoria estándar que copia su entrada únicamente en el flanco ascendente de una señal de reloj. Para mantener la sincronía de los pulsos en estas redes más complejas, introducen “buffers neuronales”: neuronas adicionales que actúan como líneas de retardo ajustables de modo que las señales que llegan por caminos distintos alcancen una puerta casi al mismo tiempo, reduciendo errores lógicos causados por pulsos desincronizados.

Equilibrar la actividad similar al cerebro y el consumo energético

Una preocupación importante para cualquier sistema de computación biológica es el coste metabólico: las neuronas necesitan energía para disparar y para restablecer su química interna. Los autores combinan sus modelos de disparo con un modelo energético que rastrea una medida abstracta similar al nivel de combustible de una célula. Luego miden cómo varía esta variable energética cuando operan sus puertas y circuitos de memoria. Tanto en puertas sencillas como en latches y flip-flops más complejos, la carga energética simulada se mantiene dentro de una banda estrecha, incluso cuando los circuitos aumentan de tamaño. Esto sugiere que, al menos en principio, la lógica y el almacenamiento al estilo digital pueden ser realizados por neuronas sin requerimientos energéticos descontrolados, siempre que los circuitos se diseñen teniendo en cuenta el tiempo y el equilibrio entre excitación e inhibición.

Pasos hacia máquinas lógicas vivas

En términos sencillos, el artículo sostiene que pequeñas redes de neuronas pueden conectarse y ajustarse para comportarse como los interruptores on–off y las pequeñas memorias dentro de los chips actuales, manteniéndose estables desde el punto de vista metabólico. El trabajo sigue siendo virtual —no se usaron neuronas vivas—, pero los diseños están pensados para ser trasplantables a plataformas reales de neuronas en chip y a hardware neuromórfico que imite neuronas de disparo en silicio. Al ofrecer una biblioteca de componentes lógicos reutilizables basados en neuronas, reglas para sincronizar su temporización y estimaciones de sus necesidades energéticas, este marco acerca la idea de ordenadores basados en neuronas desde un concepto vago hacia una realidad ingenierizada, donde la precisión tipo digital y la adaptabilidad biológica podrían algún día coexistir en el mismo dispositivo de cómputo.

Cita: Basso, G., Scherer, R. & Barros, M.T. Advanced neuronal logic circuit designs using spiking models: a framework for sequential biocomputation. npj Unconv. Comput. 3, 20 (2026). https://doi.org/10.1038/s44335-026-00066-4

Palabras clave: biocomputación neuronal, circuitos lógicos de disparo, memoria biológica, hardware neuromórfico, computación de bajo consumo