Clear Sky Science · es

Avanzando en la clasificación de enfermedades de plantas mediante una CNN basada en atención para entrenamiento intra-conjunto y entre conjuntos

Por qué importa detectar hojas enfermas

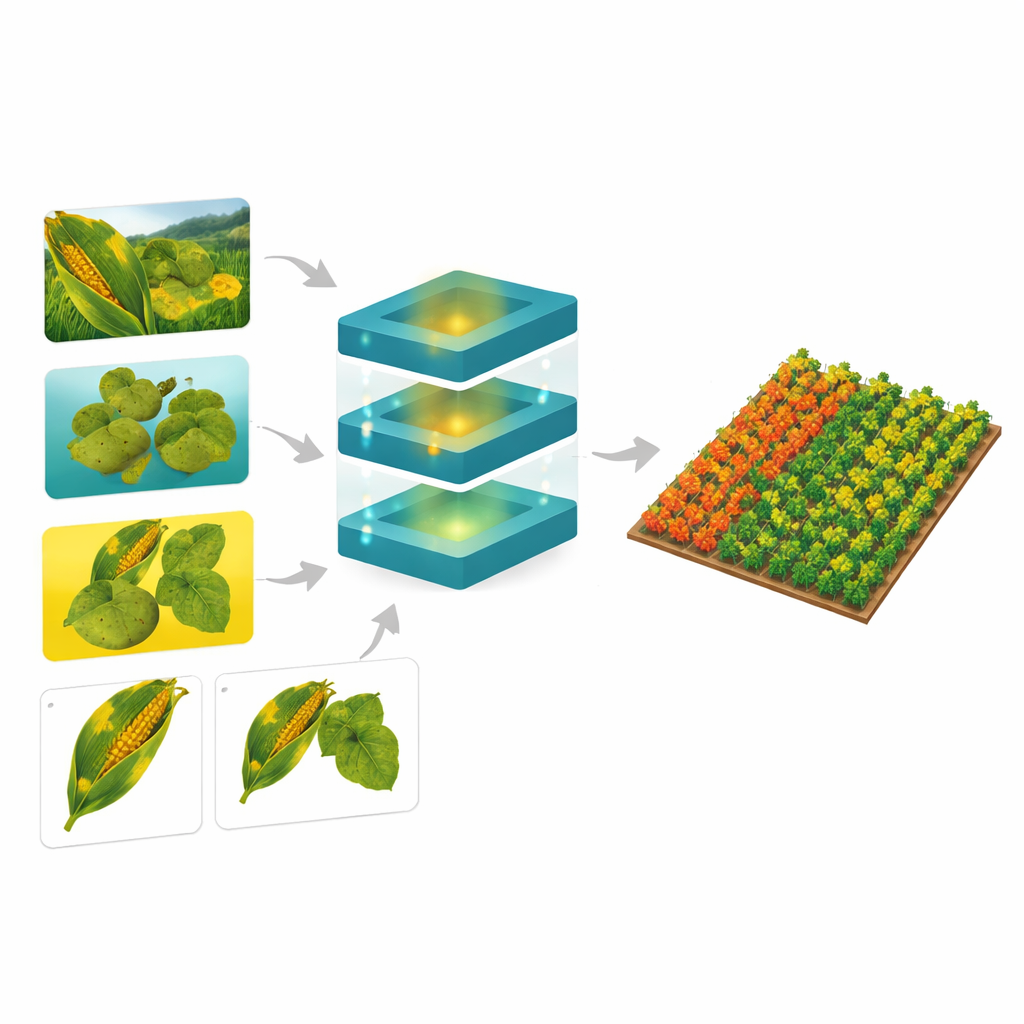

Cultivos alimentarios como el maíz y la patata alimentan a cientos de millones de personas, pero las enfermedades foliares pueden reducir los rendimientos mucho antes de que los agricultores perciban daños visibles. Hoy en día, los teléfonos inteligentes y las cámaras económicas facilitan la recopilación de imágenes de cultivos, pero convertir esas fotos en alertas tempranas fiables sigue siendo difícil. Este estudio explora cómo un tipo más inteligente de sistema de reconocimiento de imágenes puede aprender a detectar enfermedades vegetales no solo en fotos de laboratorio ordenadas, sino también en imágenes del mundo real tomadas en los campos bajo condiciones cambiantes de luz y fondo.

Enseñar a los ordenadores a leer las hojas

Los sistemas modernos de reconocimiento de imágenes suelen basarse en redes neuronales convolucionales, o CNN, que destacan en encontrar patrones en las imágenes: bordes, manchas, formas y texturas. Estas herramientas ya han demostrado que pueden clasificar enfermedades de las plantas con una precisión impresionante cuando se entrenan y prueban en el mismo conjunto de datos cuidadosamente curado. Sin embargo, la mayor parte del trabajo anterior se centró en lo que los autores llaman entrenamiento “intra-conjunto”: el modelo practica y realiza su examen con imágenes muy similares. Cuando un modelo así se encuentra con hojas fotografiadas con otra cámara, en otro país o sobre un fondo desordenado, su rendimiento puede caer bruscamente.

Ayudando al modelo a prestar atención

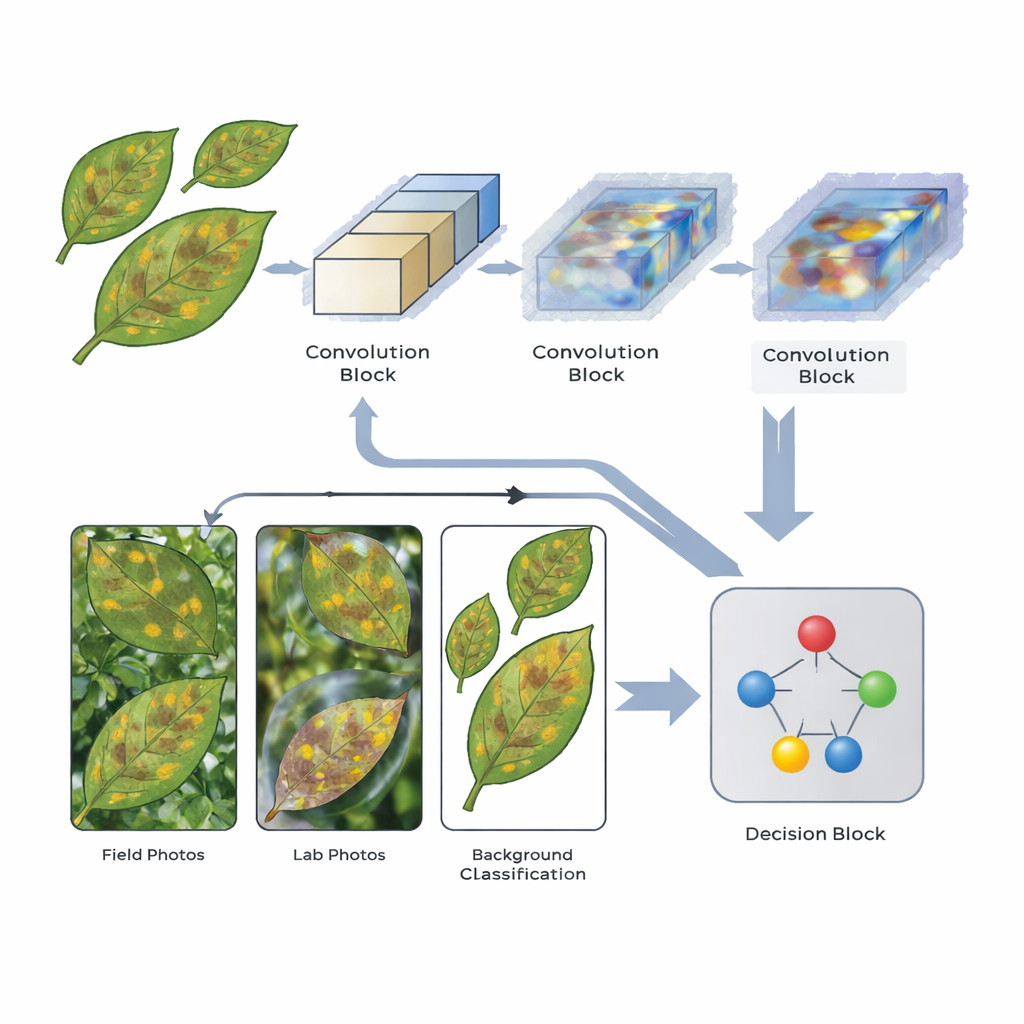

Los investigadores diseñaron una CNN simplificada que incluye mecanismos de atención especiales: componentes que ayudan a la red a concentrarse en las partes más informativas de cada imagen. El modelo procesa cada foto de hoja a través de tres etapas de extracción de características. Tras la segunda y la tercera etapa, capas de atención reponderan las señales internas de modo que se enfatizan los patrones vinculados a manchas y lesiones, mientras que detalles menos relevantes, como el suelo o el cielo de fondo, se atenúan. La arquitectura es intencionadamente ligera, usando tamaños de imagen moderados y una profundidad limitada para que pueda ejecutarse en hardware relativamente modesto, una consideración práctica para el uso agrícola en el mundo real.

Pruebas con muchos tipos de fotos de hojas

Para evaluar la robustez del diseño, el equipo recurrió a cinco colecciones públicas de imágenes de hojas. Estas incluyeron el ampliamente usado conjunto PlantVillage de hojas limpias y centradas; PlantDoc, que contiene fotos de campo más realistas; Digipathos y un conjunto NLB centrado en una enfermedad concreta del maíz; y el conjunto Corn Disease & Severity (CD&S), que ofrece múltiples versiones de cada imagen: fotos de campo originales, hojas con fondo eliminado y hojas colocadas sobre fondos uniformes negros o blancos. El modelo aprendió a reconocer varias enfermedades que afectan al maíz y a la patata, así como hojas sanas, y su rendimiento se evaluó con medidas estándar como precisión, exactitud (accuracy) y recuperación (recall).

Resultados sólidos en casa y fuera

Cuando se entrenó y probó dentro del mismo conjunto de datos, la red basada en atención igualó o superó a muchos métodos anteriores. Alcanzó un 98% de exactitud en la clasificación de enfermedades del maíz y un 99,38% de exactitud en la clasificación de enfermedades de la patata en las imágenes de PlantVillage, y un 98% de exactitud en las imágenes de campo de CD&S. Experimentos más exigentes pidieron al modelo que se entrenara en un conjunto y luego clasificara enfermedades en otro—un desafío “entre conjuntos” más cercano al despliegue real. Aquí, los mejores resultados se obtuvieron cuando el sistema se entrenó con imágenes CD&S a las que se les había eliminado el fondo. En ese escenario alcanzó una exactitud media de alrededor del 82,93% en varios otros conjuntos de datos de maíz, mejorando estudios previos entre conjuntos. El modelo fue menos consistente para imágenes de patata entre conjuntos, pero aun así proporcionó un primer punto de referencia para esa tarea.

Qué significa esto para una agricultura más inteligente

Para el público general, el mensaje central es que la forma en que entrenamos los sistemas de detección de enfermedades importa tanto como los algoritmos que empleamos. Al ayudar a la red a centrarse en los síntomas reales de las hojas en lugar del paisaje circundante, los mecanismos de atención hacen que el sistema sea más capaz de manejar nuevos tipos de imágenes. Aunque el estudio señala que los conjuntos de datos públicos aún no capturan toda la complejidad de las explotaciones reales, sus resultados muestran que un modelo relativamente compacto puede generalizar mejor entre distintas colecciones de imágenes. A largo plazo, herramientas así podrían apoyar a scouts que usen teléfonos o drones para advertir a los agricultores sobre problemas emergentes antes de que se propaguen, contribuyendo a un uso más preciso y menos derrochador de los químicos y a una mejor protección de las reservas alimentarias globales.

Cita: Mahapatra, P., Panda, M., Dash, S.K. et al. Advancing plant disease classification using an attention-based CNN for intra-dataset and cross- dataset training. Sci Rep 16, 10925 (2026). https://doi.org/10.1038/s41598-026-45464-7

Palabras clave: detección de enfermedades en plantas, aprendizaje profundo, CNN con atención, monitorización de la salud de los cultivos, generalización entre conjuntos de datos