Clear Sky Science · zh

ClarityTrack:通过分层关联和环境特定代价匹配实现多目标跟踪

为什么同时跟踪许多移动目标很困难

从自动驾驶汽车到安防摄像头和体育直播,现代摄像系统需要同时跟踪许多人或物体。但现实很复杂:人群会相互穿插、被他人遮挡而消失,或在移动时产生模糊。本文提出了ClarityTrack,一种在拥挤街道或快速舞蹈场景中也能更可靠地保持对多个移动目标“注视”的新方法。

计算机通常如何跟踪物体

大多数跟踪系统先在每帧视频中检测目标,然后尝试将这些检测在时间上连接起来形成平滑轨迹。它们依赖两个主要线索:运动(预测目标下一个位置)和外观(通过深度网络学习到的视觉特征)。现有方法通常用固定配方将这两类线索混合,例如始终以相同的权重结合运动和外观。这在简单场景下可行,但在人员密集、运动不可预测或相机模糊改变外观时会失效。

为什么单一固定配方不足以应对

想象一下观察一个拥挤的人行横道:位置重叠使得基于运动的距离变得不可靠,但衣着和身高仍能区分人。再想象一个舞蹈表演:每个人穿着相似且动作难以预测,此时外观和运动线索都不稳定。论文指出,传统跟踪器忽视了这些差异,把每一帧都当作相同的运动与外观混合比例处理。它们也常常简单地将两类证据相加,而不检查它们是否一致,这会悄然引发身份交换和轨迹中断。

三步策略以实现更清晰的跟踪

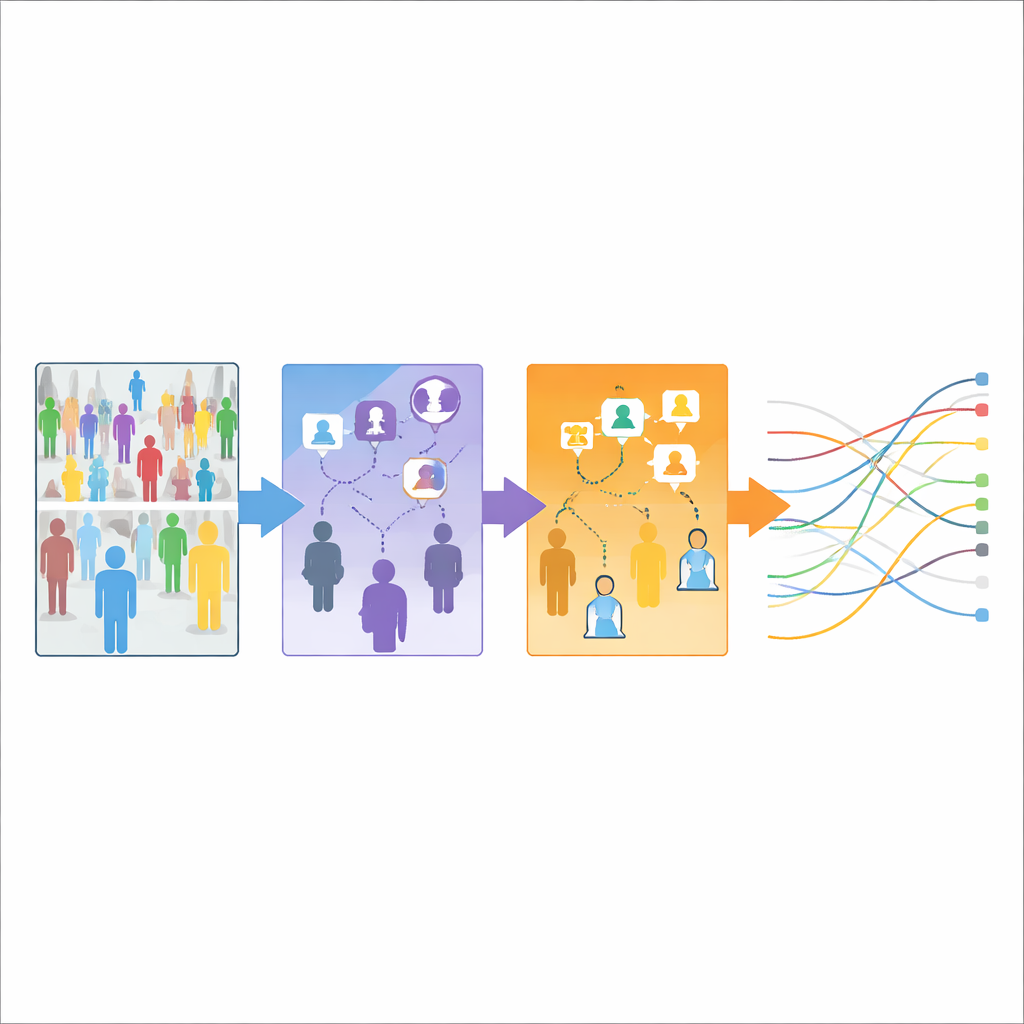

ClarityTrack通过一个由三个按顺序工作的模块组成的规则化设计来应对这些问题。首先,平衡级联关联(Balanced Cascade Association)将检测结果分为高置信度和低置信度两组。对于高置信度检测,它均衡地融合运动和外观,利用两者优势。对于低置信度检测,则退回到更谨慎的仅基于运动的匹配,以避免被模糊或被遮挡的图像误导。其次,条件感知加权匹配(Condition-Aware Matching with Weights)认识到不同视频环境的行为不同。它预先为平衡场景、极度拥挤场景和不稳定、高非线性运动场景各自学习参数集合。对于每一个潜在的跟踪对象与新检测之间的匹配,它会实时决定是保持中性的50:50混合,还是切换到偏重运动或偏重外观的环境调优混合,但仅在满足明确质量条件时才切换。

检查运动与外观是否讲述同一个故事

第三个模块,运动—外观一致性检查(Motion-Appearance Consistency Check),充当运动与外观之间的裁判。对于每一个可能的匹配,它检查预测位置和视觉相似度是否都良好、仅有一方良好或两者都不良好。当两者一致时,它略微降低匹配代价以鼓励该连接;当二者相互矛盾时,它提高代价以抑制可能的错误;当运动失效但外观非常清晰时,它会适度支持将因遮挡或突发运动而重新出现的目标重新连接。这些调整会针对不同环境类型进行不同调优,使系统在极度拥挤场景中保持谨慎,而在混乱运动的舞蹈场景中更愿意重新连接轨迹。

新方法的效果如何

作者在三个广泛使用的基准上测试了ClarityTrack:MOT17(代表典型街道场景);MOT20(代表极度拥挤的人行道);以及DanceTrack(包含成组舞者的复杂动作)。在这些数据集上,ClarityTrack在关键的跟踪质量指标上匹配或超过了现有最佳在线跟踪器,尤其是在衡量身份随时间保持程度的指标上。重要的是,这些改进大多来自更智能的数据关联,而不是更重的神经网络,并且在典型场景下系统仍能达到或超过实时运行速度。

这对日常技术意味着什么

对非专业读者来说,主要结论是:ClarityTrack展示了经过精心调优的简单透明规则,结合对环境的适应,能够媲美或优于那些不透明的一刀切方法。通过区分高低置信度检测、根据场景类型调整策略并显式检查运动与外观的一致性,该方法能在从街头人群到舞池的各类场景中更可靠地分辨“谁是谁”。这种面向环境的跟踪有望使基于摄像头的系统在复杂多变的现实世界中更加安全和值得信赖。

引用: Lee, SE., Yang, HS., Jung, SH. et al. ClarityTrack for multi object tracking via hierarchical association and environment specific cost matching. Sci Rep 16, 10581 (2026). https://doi.org/10.1038/s41598-026-45425-0

关键词: 多目标跟踪, 计算机视觉, 视频监控, 人群分析, 自动驾驶