Clear Sky Science · fr

ClarityTrack pour le suivi multi-objets via association hiérarchique et appariement de coûts spécifiques à l’environnement

Pourquoi suivre de nombreux objets en mouvement est difficile

Des voitures autonomes aux caméras de sécurité en passant par les retransmissions sportives, les caméras modernes doivent suivre simultanément de nombreuses personnes ou objets. Mais la vie réelle est désordonnée : les personnes se croisent, disparaissent derrière d’autres ou deviennent floues en mouvement. Cet article présente ClarityTrack, une nouvelle méthode pour garder des « yeux » numériques sur plusieurs cibles mobiles de façon plus fiable, même dans des rues encombrées ou des scènes de danse rapides.

Comment les ordinateurs suivent généralement les objets

La plupart des systèmes de suivi détectent d’abord les objets dans chaque image vidéo, puis tentent de relier ces détections au fil du temps pour former des trajectoires lisses. Ils s’appuient sur deux indices principaux : le mouvement (où quelque chose est susceptible de se déplacer ensuite) et l’apparence (son aspect, via des empreintes visuelles apprises par des réseaux profonds). Les méthodes existantes combinent généralement ces deux indices en suivant une recette fixe, par exemple en pondérant toujours de la même façon le mouvement et l’apparence. Cela fonctionne dans des scènes simples, mais échoue lorsque la foule devient dense, que le mouvement devient imprévisible ou que le flou de la caméra change l’apparence des personnes.

Pourquoi une seule recette fixe ne suffit pas

Imaginez un passage piéton bondé : les positions se chevauchent, rendant la distance basée sur le mouvement peu fiable, alors que les vêtements et la taille peuvent encore différencier les personnes. Imaginez maintenant une performance de danse : tout le monde porte des tenues similaires et bouge de manière erratique, de sorte que les indices d’apparence et de mouvement sont tous deux instables. L’article montre que les traceurs traditionnels ignorent cette variété, traitant chaque image comme si le même mélange de mouvement et d’apparence devait fonctionner. Ils ont aussi tendance à additionner simplement les deux sources d’information sans vérifier si elles s’accordent réellement, ce qui peut produire silencieusement des échanges d’identité et des trajectoires brisées.

Une stratégie en trois étapes pour un suivi plus clair

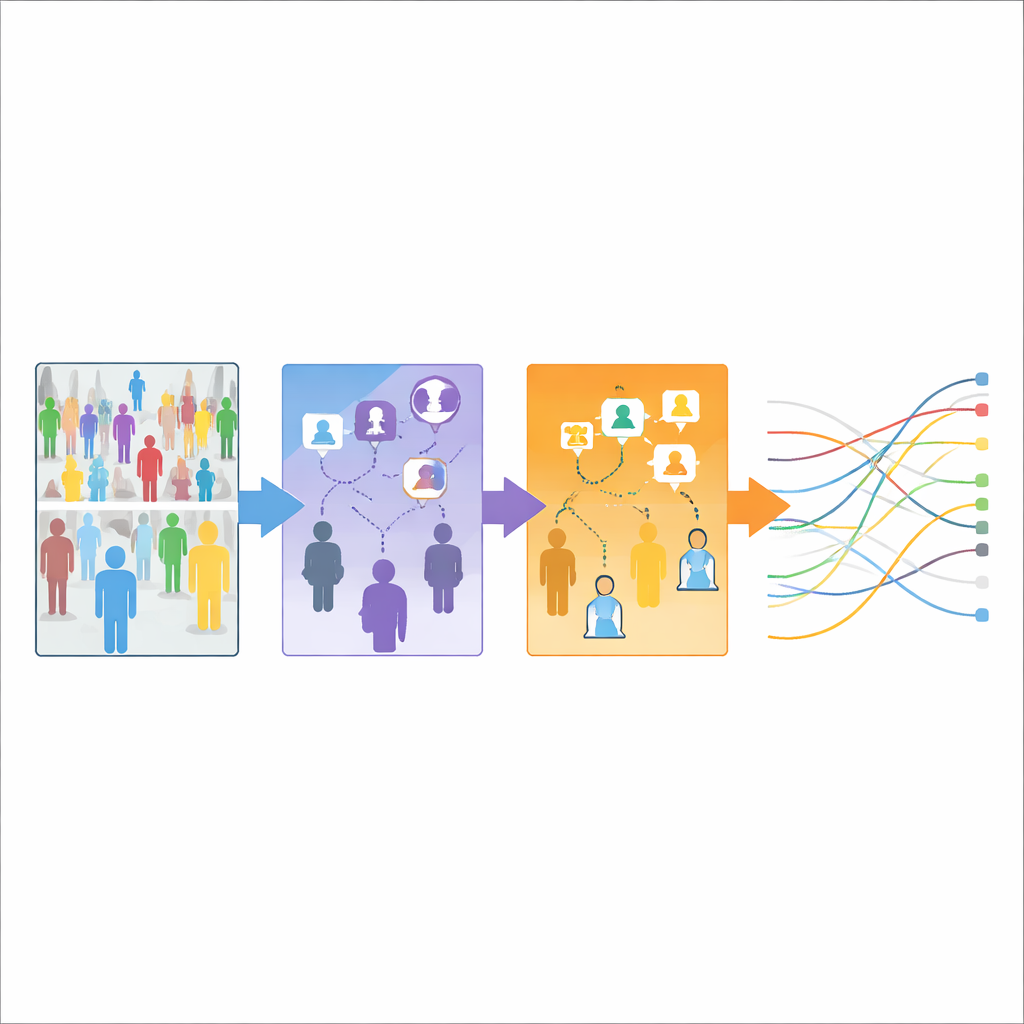

ClarityTrack aborde ces problèmes avec une conception basée sur des règles composée de trois modules fonctionnant en séquence. D’abord, l’Association en Cascade Équilibrée divise les détections en groupes de haute et basse confiance. Pour les détections à haute confiance, elle combine le mouvement et l’apparence de manière équilibrée, tirant parti des deux. Pour les détections à faible confiance, elle revient à un appariement prudent basé uniquement sur le mouvement pour éviter d’être induite en erreur par des images floues ou occultées. Ensuite, l’Appariement Sensible au Contexte avec Pondérations reconnaît que différents environnements vidéo se comportent différemment. Il pré-apprend des ensembles de paramètres séparés pour les scènes équilibrées, les scènes très encombrées et les mouvements instables très non linéaires. Pour chaque appariement potentiel entre un objet suivi et une nouvelle détection, il décide à la volée de conserver le mélange neutre 50:50 ou de passer à un mélange adapté à l’environnement qui favorise soit le mouvement, soit l’apparence, mais uniquement lorsque des conditions de qualité claires sont réunies.

Vérifier si le mouvement et l’apparence racontent la même histoire

Le troisième module, la Vérification de Cohérence Mouvement-Apparence, agit comme un arbitre entre le mouvement et l’apparence. Pour chaque appariement possible, il examine si la position prédite et la similarité visuelle semblent toutes deux bonnes, si une seule est satisfaisante, ou si aucune ne l’est. Lorsque les deux concordent, il diminue légèrement le coût d’appariement pour encourager cette connexion. Lorsqu’elles se contredisent, il augmente le coût pour décourager une erreur probable. Lorsque le mouvement échoue mais que l’apparence est très claire, il soutient doucement le reconnectement d’un objet réapparu après une occultation ou un mouvement soudain. Ces ajustements sont réglés différemment selon chaque type d’environnement afin que le système reste prudent dans les scènes très encombrées mais plus enclin à relier à nouveau des danseurs en mouvement chaotique.

Quelle est l’efficacité de la nouvelle approche

Les auteurs ont testé ClarityTrack sur trois benchmarks largement utilisés : MOT17, représentant des scènes de rue typiques ; MOT20, représentant des trottoirs extrêmement bondés ; et DanceTrack, rempli de groupes de danseurs exécutant des mouvements complexes. Sur ces jeux de données, ClarityTrack a égalé ou dépassé les meilleurs traceurs en ligne existants sur des mesures clés de qualité de suivi, en particulier celles évaluant la conservation des identités dans le temps. Fait important, la plupart de ces gains proviennent d’une association de données plus intelligente plutôt que d’un recours à des réseaux neuronaux plus lourds, et le système fonctionne toujours à une vitesse en temps réel ou supérieure pour des scènes typiques.

Ce que cela signifie pour la technologie au quotidien

Pour les non-spécialistes, l’essentiel est que ClarityTrack montre comment des règles simples et transparentes, lorsqu’elles sont soigneusement adaptées à l’environnement, peuvent rivaliser avec ou améliorer des approches plus opaques et universelles. En séparant les détections haute et basse confiance, en s’adaptant au type de scène et en vérifiant explicitement si le mouvement et l’apparence concordent, la méthode suit qui est qui de façon plus fiable, des foules de rue aux pistes de danse. Ce type de suivi sensible au contexte pourrait rendre les systèmes basés sur la vidéo plus sûrs et plus dignes de confiance dans le monde réel, chaotique et changeant.

Citation: Lee, SE., Yang, HS., Jung, SH. et al. ClarityTrack for multi object tracking via hierarchical association and environment specific cost matching. Sci Rep 16, 10581 (2026). https://doi.org/10.1038/s41598-026-45425-0

Mots-clés: suivi multi-objets, vision par ordinateur, surveillance vidéo, analyse de foule, conduite autonome