Clear Sky Science · de

ClarityTrack für Multi-Object-Tracking mittels hierarchischer Zuordnung und umgebungsspezifischer Kostenanpassung

Warum das Verfolgen vieler bewegter Objekte schwierig ist

Von selbstfahrenden Autos über Sicherheitskameras bis zu Sportübertragungen wird von modernen Kameras erwartet, dass sie viele Personen oder Objekte gleichzeitig im Blick behalten. Die reale Welt ist jedoch unordentlich: Menschen kreuzen sich, verschwinden hinter anderen oder werden beim Bewegen unscharf. Dieses Paper stellt ClarityTrack vor, einen neuen Ansatz, um digitale „Augen“ zuverlässiger auf mehrere bewegte Ziele zu richten, selbst in überfüllten Straßen oder schnellen Tanzszenen.

Wie Computer üblicherweise Objekte verfolgen

Die meisten Tracking-Systeme erkennen zuerst Objekte in jedem Videobild und versuchen dann, diese Erkennungen über die Zeit zu verknüpfen, um glatte Bahnen zu bilden. Sie stützen sich auf zwei Haupthinweise: Bewegung (wo sich etwas voraussichtlich als Nächstes befindet) und Erscheinungsbild (wie es aussieht, anhand visueller Fingerabdrücke, die von tiefen Netzwerken gelernt wurden). Bestehende Methoden kombinieren diese Hinweise meist mit einer festen Rezeptur, zum Beispiel indem sie Bewegung und Erscheinungsbild immer im gleichen Verhältnis gewichten. Das funktioniert in einfachen Szenen, bricht aber zusammen, wenn die Menge dicht wird, die Bewegung unvorhersehbar ist oder Kameraverwischung das Aussehen verändert.

Warum eine feste Rezeptur nicht ausreicht

Stellen Sie sich eine belebte Fußgängerfurt vor: Positionen überlappen, sodass distanzbasierte Bewegungsmaßstäbe unzuverlässig werden, während Kleidung und Körpergröße dennoch zur Trennung beitragen können. Oder denken Sie an eine Tanzaufführung: Alle tragen ähnliche Outfits und bewegen sich erratisch, sodass sowohl Erscheinungsbild- als auch Bewegungsmerkmale instabil sind. Das Paper zeigt, dass traditionelle Tracker diese Vielfalt ignorieren und jeden Frame so behandeln, als würde dieselbe Mischung aus Bewegung und Erscheinungsbild immer funktionieren. Sie neigen außerdem dazu, die beiden Evidenzen einfach zusammenzuzählen, ohne zu prüfen, ob sie tatsächlich übereinstimmen, was unbemerkt Identitätsvertauschungen und gebrochene Trajektorien verursachen kann.

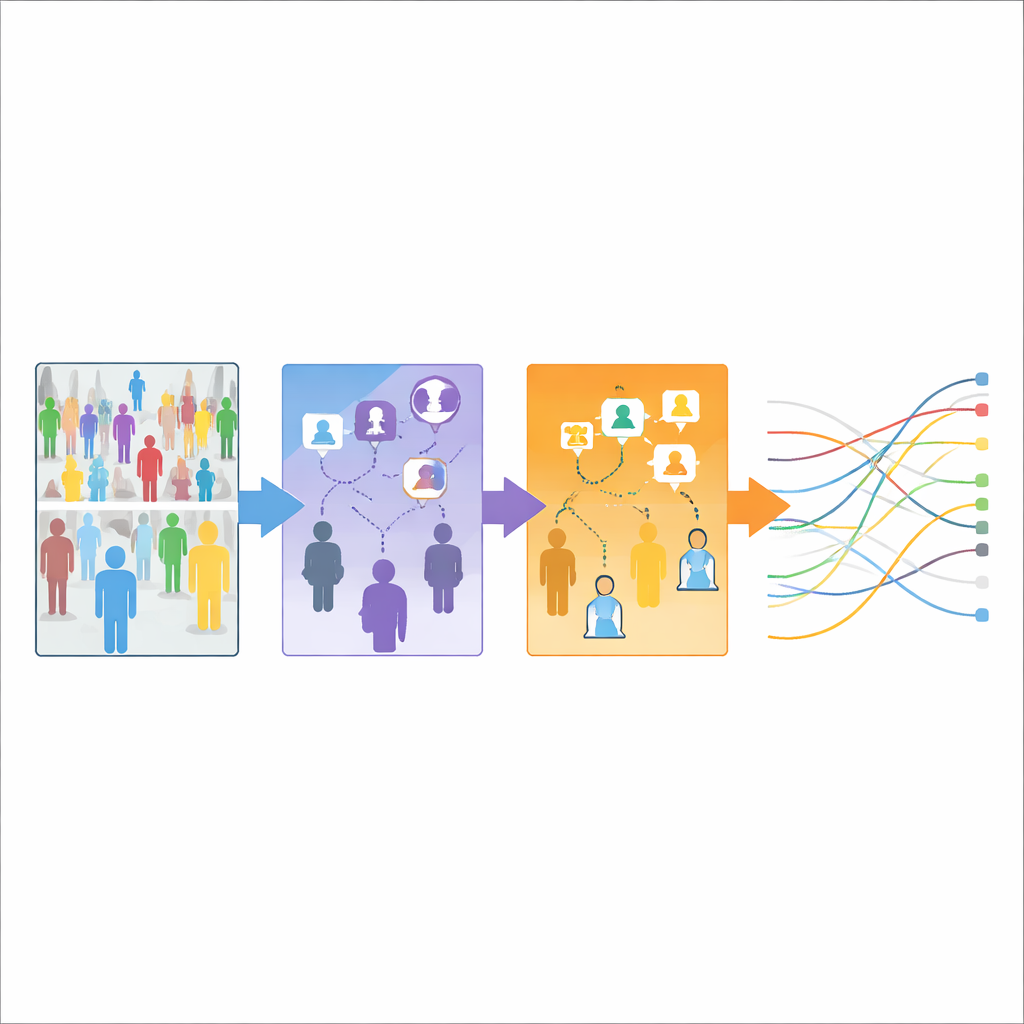

Eine dreistufige Strategie für klareres Tracking

ClarityTrack begegnet diesen Problemen mit einem regelbasierten Design, das aus drei hintereinander arbeitenden Modulen besteht. Zuerst teilt die Balanced Cascade Association die Erkennungen in hoch- und niedrigkonfidente Gruppen. Bei hochkonfidenten Erkennungen werden Bewegung und Erscheinungsbild gleichgewichtig kombiniert, um von beiden zu profitieren. Bei niedrigkonfidenten greift das System vorsichtig auf eine rein bewegungsbasierte Zuordnung zurück, um nicht von verschwommenen oder verdeckten Bildern in die Irre geführt zu werden. Zweitens erkennt das Condition-Aware Matching with Weights, dass verschiedene Videoumgebungen unterschiedlich agieren. Es lernt im Voraus separate Parametersätze für ausgeglichene Szenen, sehr überfüllte Szenen und instabile, hochgradig nichtlineare Bewegungen. Für jede mögliche Zuordnung zwischen einem verfolgten Objekt und einer neuen Erkennung entscheidet es dynamisch, ob die neutrale 50:50-Mischung beibehalten oder zu einer umgebungstauglichen Mischung gewechselt wird, die entweder Bewegung oder Erscheinungsbild bevorzugt — jedoch nur, wenn klare Qualitätsbedingungen erfüllt sind.

Prüfen, ob Bewegung und Aussehen dieselbe Geschichte erzählen

Das dritte Modul, der Motion-Appearance Consistency Check, fungiert wie ein Schiedsrichter zwischen Bewegung und Erscheinungsbild. Für jede mögliche Zuordnung prüft es, ob die vorhergesagte Position und die visuelle Ähnlichkeit beide gut aussehen, nur eine von beiden gut ist oder keine von beiden. Wenn beide übereinstimmen, senkt es leicht die Zuordnungskosten, um diese Verbindung zu begünstigen. Wenn sie widersprüchlich sind, erhöht es die Kosten, um eine wahrscheinliche Fehlerzuordnung zu entmutigen. Wenn die Bewegung versagt, das Erscheinungsbild jedoch sehr klar ist, unterstützt es behutsam das Wiederverbinden eines Objekts, das nach einer Verdeckung oder plötzlichen Bewegung wieder aufgetaucht ist. Diese Anpassungen sind für jeden Umgebungstyp unterschiedlich abgestimmt, sodass das System in sehr überfüllten Szenen vorsichtig bleibt, aber bei chaotischen Tänzern eher wieder verknüpft.

Wie gut der neue Ansatz funktioniert

Die Autoren haben ClarityTrack auf drei weit verbreiteten Benchmarks getestet: MOT17, das typische Straßenszenen repräsentiert; MOT20, das extrem überfüllte Gehwege abbildet; und DanceTrack, das Gruppen von Tänzern mit komplexen Bewegungen enthält. Über diese Datensätze hinweg erreichte ClarityTrack gleichwertige oder bessere Ergebnisse als die besten existierenden Online-Tracker in wichtigen Messgrößen der Tracking-Qualität, insbesondere bei der Bewertung der Identitätskonsistenz über die Zeit. Wichtig ist, dass ein Großteil dieser Verbesserungen aus intelligenterer Datenassoziation statt aus schwereren neuronalen Netzwerken stammt und das System bei typischen Szenen weiterhin in Echtzeit oder schneller läuft.

Was das für Alltagstechnologien bedeutet

Für Nicht-Experten lautet die wichtigste Erkenntnis: ClarityTrack zeigt, wie einfache, transparente Regeln, sorgfältig an die Umgebung angepasst, mit undurchsichtigeren Einheitsansätzen mithalten oder diese verbessern können. Durch die Trennung von hoch- und niedrigkonfidenten Erkennungen, die Anpassung an den Szenentyp und die explizite Prüfung, ob Bewegung und Erscheinungsbild übereinstimmen, verfolgt die Methode zuverlässiger, wer wer ist — von Straßenmengen bis zur Tanzfläche. Solches umgebungsbewusstes Tracking könnte kamerabasierte Systeme in der unordentlichen, sich ständig verändernden realen Welt sicherer und vertrauenswürdiger machen.

Zitation: Lee, SE., Yang, HS., Jung, SH. et al. ClarityTrack for multi object tracking via hierarchical association and environment specific cost matching. Sci Rep 16, 10581 (2026). https://doi.org/10.1038/s41598-026-45425-0

Schlüsselwörter: Multi-Object-Tracking, Computer Vision, Videoüberwachung, Analyse von Menschenmengen, Autonomes Fahren