Clear Sky Science · zh

MSSA:基于记忆且简化的可扩展注意力以增强图像描述

教计算机描述图片

想象一下浏览你的照片库时,每张图片都能自动生成一条生动且准确的句子,说明谁在其中、他们在做什么,以及一切如何相互关联。这就是图像描述技术的愿景:将图像变成文字。本文提出了一种新系统,称为 MSSA,它通过以更细致且具有记忆感知的方式观察图像,帮助计算机生成更丰富、更精确的字幕,同时保持底层机制的高效性。

看到的不只是物体

早期的大多数描述系统先识别出图像的粗略视觉模式,然后将其输入语言模型以组织词语。这些系统在简单场景中表现良好,但常常漏掉细微信息:物体在哪里、它们之间如何相互关联、以及材料或纹理等特征。作者认为单一的高层次图像快照不足以捕捉这些细节。因此,MSSA 框架首先从图像中每个重要区域提取更丰富的视觉线索。它考虑几何信息(物体的位置与大小)、颜色分布、纹理模式、边缘以及捕捉重复结构的频域信号。通过结合这些线索,系统为每个物体构建出更细腻的画像,从而有助于区分例如网球场与棒球场,或一片披萨与一块蛋糕等场景。

让系统在生成时重新聚焦

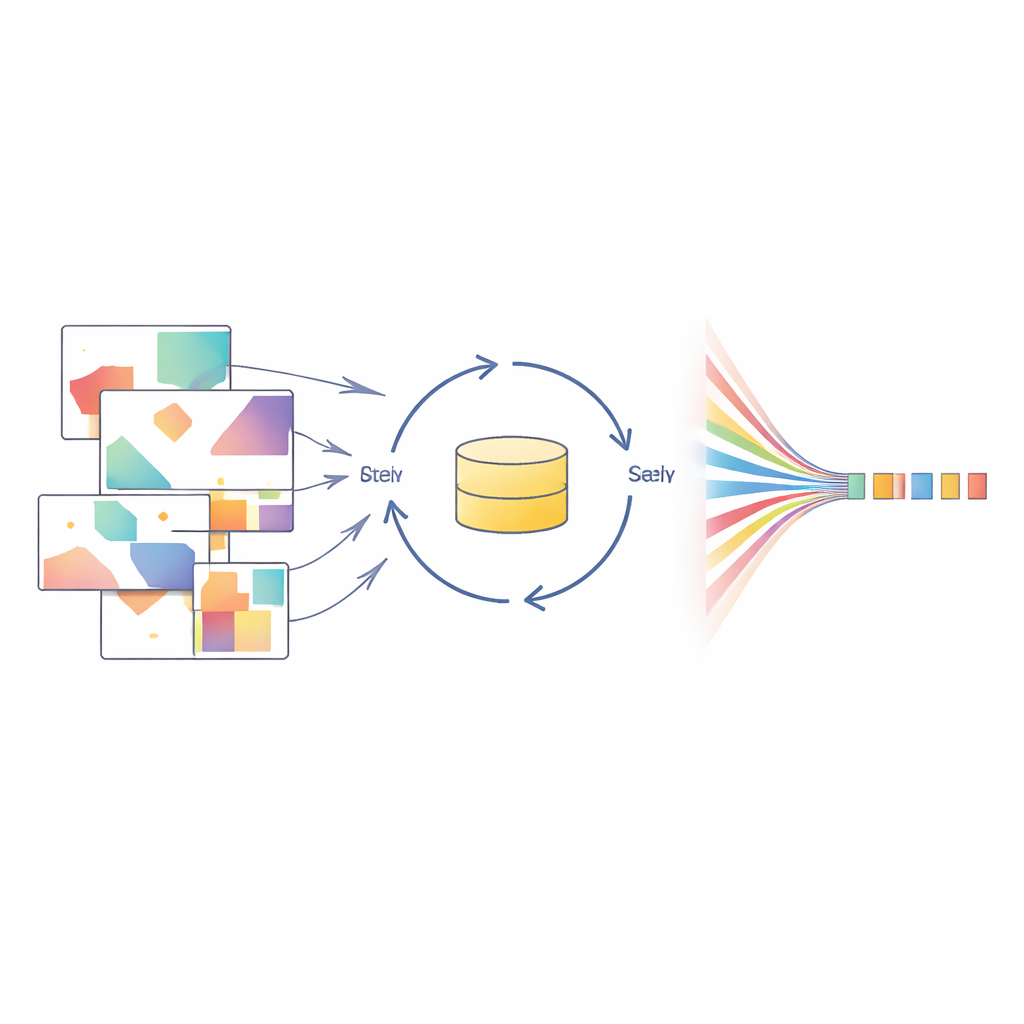

描述是逐字生成的,这带来另一项挑战。如果系统在早期关注了图像中错误的部分,这个错误可能会随着句子生成而不断放大。为了解决这一问题,MSSA 引入了基于记忆的注意力模块。该模块不再对视觉区域进行一次性处理,而是通过一个记忆循环重复访问同一组区域。在每一步,它根据到目前为止“已说出”的字幕内容,细化哪些图像部分最为相关。这一迭代过程帮助模型纠正早期判断错误,在繁忙场景中平衡竞争物体,并使不断发展的句子始终锚定于正确的视觉证据。

简化注意力的计算方式

现代注意力机制负责决定模型应将注意力放在哪儿,但这些机制本身可能变得沉重且复杂。许多系统加入额外的“门”来重新加权数十或数百个内部通道。作者展示了在他们的设置下,这类额外复杂性收益有限。MSSA 使用一种简化的缩放注意力模块,保留注意力的核心思想——将当前的文本状态与图像区域匹配——但移除了一些昂贵的附加项。它采用精简的数学运算来捕捉视觉区域与当前生成词之间的关系,更强调空间精度而非复杂的内部调优。由于注意力会为每个新词重复调用,这种简化减少了计算量和延迟,同时不牺牲描述质量。

与其他描述系统的对比测试

为了验证这些设计选择是否奏效,研究者在广泛使用的 MSCOCO 数据集上评估了 MSSA,该数据集将日常照片与多条人工撰写的描述配对。他们将 MSSA 与多种强基线模型进行比较,涵盖较早的系统以及近期基于注意力和 Transformer 的设计。使用评估语法、与人工描述的相似度以及关键关系捕捉程度等的标准质量度量,MSSA 在大多数情况下稳健地匹配或超越了最先进的基线。重要的是,它在使用简化注意力路径的同时,略微减少了参数数量、每条描述的计算量和生成每句话所需的时间。定性示例显示,MSSA 常能注意到额外的上下文细节——例如桌上的一瓶水、飞机烟雾的方向,或人群中对描述最为重要的那个人——而其他系统要么遗漏,要么误判这些信息。

这对日常图像意味着什么

对非专业读者而言,结论是更好的描述并非仅来自更大的模型,而来自对视觉细节与记忆的更智能利用。通过丰富模型对每个图像区域的“所见”并允许其在生成过程中反复重新聚焦,MSSA 能产生更具人性化的描述:它们提及关键物体、捕捉它们之间的关系,并补充一些小而有意义的细节。同时,其简化的注意力设计避免了不必要的复杂性,在准确性与效率之间提供了实用的平衡。这使得 MSSA 成为从为视障用户提供可访问照片库到更直观的图像搜索与组织等应用的有前景的构建模块。

引用: Hossain, M.A., Ye, Z., Hossen, M.B. et al. MSSA: memory-driven and simplified scaled attention for enhanced image captioning. Sci Rep 16, 11203 (2026). https://doi.org/10.1038/s41598-026-40164-8

关键词: 图像描述, 注意力机制, 多模态学习, 计算机视觉, 深度学习