Clear Sky Science · fr

MSSA : attention mise à l’échelle, simplifiée et pilotée par la mémoire pour améliorer la génération de légendes d’images

Apprendre aux ordinateurs à décrire des images

Imaginez parcourir votre bibliothèque de photos et voir chaque image automatiquement assortie d’une phrase vivante et précise : qui est présent, ce qu’ils font et comment tout s’imbrique. Voilà la promesse de la génération de légendes d’images, une technologie qui transforme des images en mots. Cet article présente un nouveau système, appelé MSSA, qui aide les ordinateurs à produire des légendes plus riches et plus exactes en analysant les images de façon plus détaillée et consciente de la mémoire, tout en conservant une architecture sous-jacente efficace.

Voir plus que de simples objets

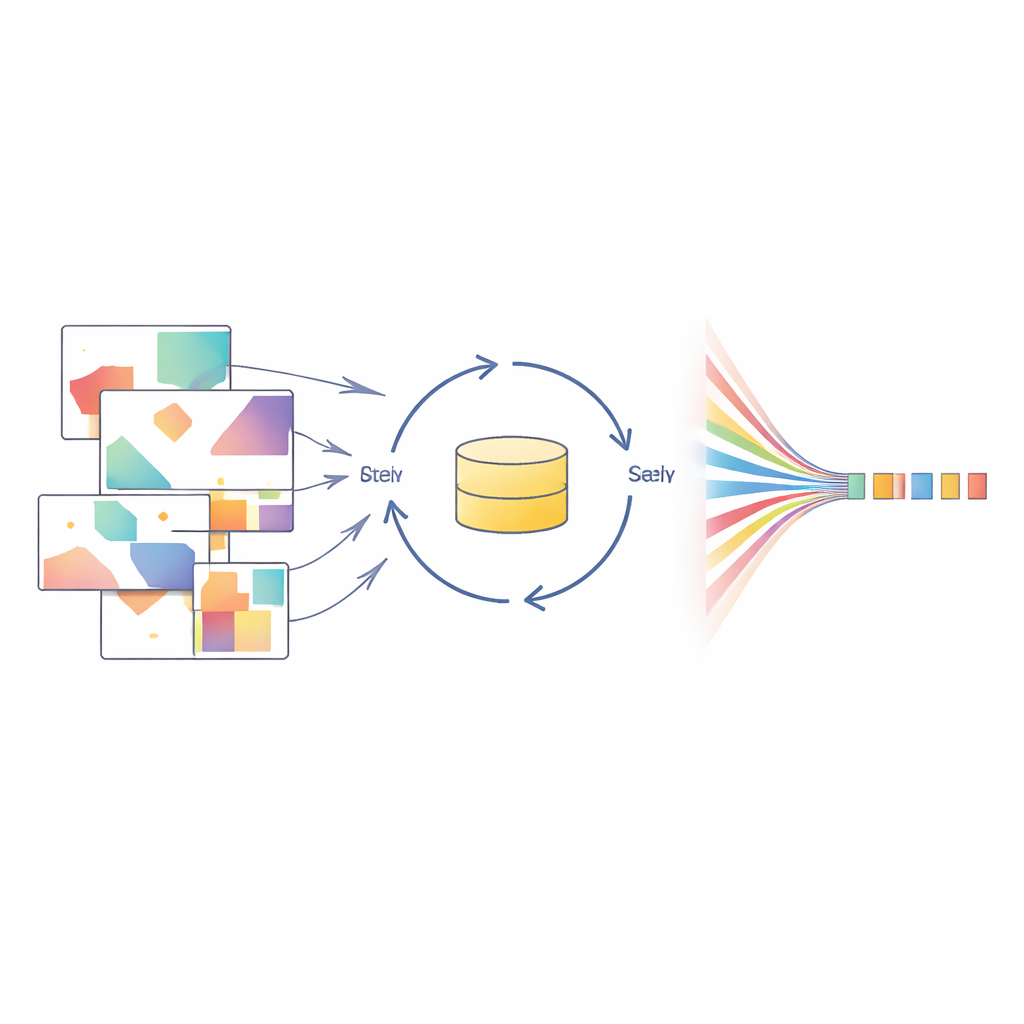

La plupart des systèmes de génération précédents apprenaient à décrire les images en reconnaissant d’abord des motifs visuels globaux, puis en les alimentant dans un modèle de langage qui enchaîne les mots. Ces systèmes fonctionnent bien pour des scènes simples, mais ils ratent souvent des détails subtils : où se situent les éléments, comment ils se relient entre eux et quels matériaux ou textures sont présents. Les auteurs soutiennent qu’un unique instantané de haut niveau d’une image ne suffit pas. Leur cadre MSSA commence donc par extraire un ensemble plus riche d’indices visuels pour chaque région importante d’une image. Il prend en compte la géométrie (où se trouve un objet et quelle est sa taille), les distributions de couleurs, les motifs de texture, les contours et des signaux en fréquence qui captent les structures répétitives. En combinant tous ces indices, le système construit un portrait plus nuancé de chaque objet, ce qui aide à distinguer, par exemple, un court de tennis d’un terrain de baseball ou une part de pizza d’un morceau de gâteau.

Laisser le système se recentrer pendant qu’il écrit

Un autre défi de la génération de légendes est que les descriptions sont produites mot par mot. Si le système porte son attention sur la mauvaise partie de l’image au départ, cette erreur peut s’amplifier au fur et à mesure que la phrase se développe. Pour y remédier, MSSA introduit un module d’attention piloté par la mémoire. Plutôt que d’effectuer une passe unique sur les régions visuelles, ce module utilise une boucle mémoire qui revisite à plusieurs reprises le même ensemble de régions. À chaque étape, il affine les parties de l’image les plus pertinentes, guidé par ce qui a déjà été « dit » dans la légende jusqu’à présent. Ce processus itératif aide le modèle à corriger les jugements précoces erronés, à équilibrer les objets concurrents dans les scènes chargées et à ancrer la phrase en formation sur les preuves visuelles appropriées.

Simplifier le calcul du focus

Les mécanismes d’attention modernes, qui décident où le modèle doit se concentrer, peuvent eux-mêmes devenir lourds et complexes. Beaucoup de systèmes ajoutent des « portes » supplémentaires qui réajustent des dizaines ou des centaines de canaux internes. Les auteurs montrent que, dans leur configuration, cette complexité additionnelle apporte peu d’avantages. MSSA utilise un module d’Attention Mises à l’Échelle Simplifiée qui conserve l’idée centrale de l’attention — faire correspondre un état textuel courant aux régions de l’image — mais supprime certaines surcouches coûteuses. Il emploie des opérations mathématiques épurées pour capturer la relation entre les régions visuelles et le mot en cours de production, en privilégiant la précision spatiale plutôt qu’un réglage interne complexe. Comme l’attention est sollicitée à chaque nouveau mot, cette simplification réduit le calcul et la latence sans sacrifier la qualité des légendes.

Test face à d’autres systèmes de légendes

Pour vérifier si ces choix de conception portent leurs fruits, les chercheurs évaluent MSSA sur le jeu de données largement utilisé MSCOCO, qui associe des photos du quotidien à plusieurs légendes rédigées par des humains. Ils comparent MSSA à un éventail de modèles performants, incluant des systèmes plus anciens ainsi que des architectures récentes basées sur l’attention et les transformers. En utilisant des mesures de qualité standard qui évaluent la grammaire, la similarité aux descriptions humaines et la capture des relations clés, MSSA atteint de manière constante des résultats équivalents ou supérieurs à la plupart des références de pointe. Fait important, il le fait tout en utilisant un parcours d’attention simplifié qui réduit légèrement le nombre de paramètres, la quantité de calcul par légende et le temps nécessaire à la génération de chaque phrase. Des exemples qualitatifs montrent que MSSA remarque souvent des détails contextuels supplémentaires — comme une bouteille d’eau sur une table, la direction de la fumée d’un avion ou quelle personne dans une foule est la plus importante pour la description — que les systèmes concurrents omettent ou interprètent mal.

Qu’est-ce que cela signifie pour les images du quotidien

Pour les non-spécialistes, l’idée principale est que de meilleures légendes ne proviennent pas seulement de modèles plus grands ; elles résultent d’une utilisation plus intelligente du détail visuel et de la mémoire. En enrichissant ce que le modèle « voit » dans chaque région d’image et en lui permettant de se recentrer à plusieurs reprises pendant l’écriture, MSSA peut produire des descriptions qui paraissent plus humaines : elles mentionnent les objets clés, captent leurs relations et ajoutent de petits détails révélateurs. En même temps, sa conception d’attention simplifiée évite les complexités inutiles, offrant un compromis pratique entre précision et efficacité. Cela fait de MSSA un élément prometteur pour des applications allant de bibliothèques de photos accessibles aux personnes malvoyantes à une recherche et une organisation plus intuitives des vastes collections d’images qui façonnent notre vie numérique.

Citation: Hossain, M.A., Ye, Z., Hossen, M.B. et al. MSSA: memory-driven and simplified scaled attention for enhanced image captioning. Sci Rep 16, 11203 (2026). https://doi.org/10.1038/s41598-026-40164-8

Mots-clés: génération de légendes d’images, mécanismes d’attention, apprentissage multimodal, vision par ordinateur, apprentissage profond