Clear Sky Science · de

MSSA: speichergetriebene und vereinfachte skalierte Aufmerksamkeit für verbesserte Bildunterschriften

Computern beibringen, Bilder zu beschreiben

Stellen Sie sich vor, Sie blättern durch Ihre Fotobibliothek und jedes Bild wird automatisch mit einem lebendigen, präzisen Satz beschrieben: wer zu sehen ist, was er oder sie tut und wie alles zueinander passt. Das ist das Versprechen der Bildunterschriftenerstellung, einer Technologie, die Bilder in Worte übersetzt. Dieses Papier stellt ein neues System namens MSSA vor, das Computern hilft, reichhaltigere und genauere Bildbeschreibungen zu erzeugen, indem es Bilder detaillierter und speicherbewusster betrachtet und zugleich die zugrundeliegenden Mechanismen effizient hält.

Mehr sehen als nur Objekte

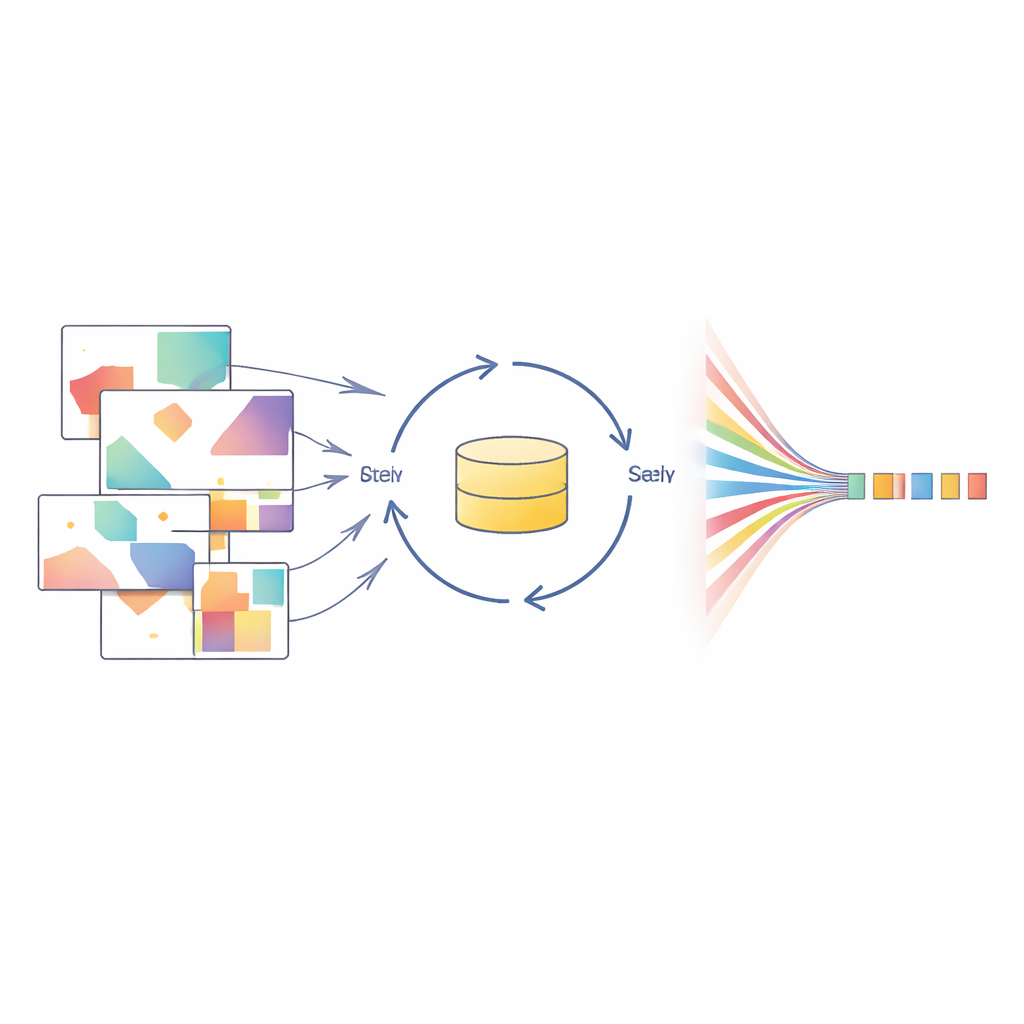

Die meisten früheren Systeme zur Bildunterschriftenerstellung lernten, Bilder zu beschreiben, indem sie zunächst grobe visuelle Muster erkannten und diese dann an ein Sprachmodell weitergaben, das Wortfolgen erzeugt. Diese Systeme funktionieren gut für einfache Szenen, übersehen aber oft subtile Details: wo sich Dinge befinden, wie sie zueinander in Beziehung stehen und welche Materialien oder Texturen vorhanden sind. Die Autoren argumentieren, dass eine einzige, hochstufige Momentaufnahme eines Bildes nicht ausreicht. Ihr MSSA-Framework beginnt daher damit, aus jeder wichtigen Bildregion einen reicheren Satz visueller Hinweise zu extrahieren. Es berücksichtigt Geometrie (wo sich ein Objekt befindet und wie groß es ist), Farbverteilungen, Texturmuster, Kanten und frequenzbasierte Signale, die sich wiederholende Strukturen erfassen. Durch die Kombination all dieser Hinweise baut das System ein nuancierteres Porträt jedes Objekts auf, was zum Beispiel hilft, einen Tennisplatz von einem Baseballfeld oder eine Pizzascheibe von einem Stück Kuchen zu unterscheiden.

Dem System erlauben, sich beim Schreiben neu zu fokussieren

Eine weitere Herausforderung bei Bildunterschriften ist, dass Beschreibungen Wort für Wort erzeugt werden. Wenn das System zu Beginn auf den falschen Bildbereich achtet, kann sich dieser Fehler mit wachsendem Satz verstärken. Um dem entgegenzuwirken, führt MSSA ein speichergetriebenes Aufmerksamkeitsmodul ein. Statt einen einmaligen Durchlauf über die visuellen Regionen zu machen, verwendet dieses Modul eine Speicherschleife, die dieselben Regionen wiederholt besucht. In jedem Schritt verfeinert es, welche Bildteile am relevantesten sind, geleitet von dem, was bisher in der Bildunterschrift „gesagt“ wurde. Dieser iterative Prozess hilft dem Modell, frühe Fehlbewertungen zu korrigieren, konkurrierende Objekte in überfüllten Szenen auszugleichen und den sich entwickelnden Satz an der richtigen visuellen Evidenz verankert zu halten.

Vereinfachung der Art und Weise, wie Fokus berechnet wird

Moderne Aufmerksamkeitsmechanismen, die entscheiden, worauf das Modell achten soll, können selbst schwergewichtig und komplex werden. Viele Systeme fügen zusätzliche „Tore“ hinzu, die Dutzende oder Hunderte interner Kanäle neu gewichten. Die Autoren zeigen, dass diese zusätzliche Komplexität in ihrem Kontext kaum Nutzen bringt. MSSA verwendet ein Vereinfachtes Skaliertes Aufmerksamkeitsmodul, das die Kernidee der Aufmerksamkeit beibehält — das Abgleichen eines aktuellen Textzustands mit Bildregionen —, aber einige der teuren Ergänzungen entfernt. Es nutzt gestraffte mathematische Operationen, um zu erfassen, wie visuelle Regionen und das aktuell entstehende Wort zusammenhängen, und legt dabei Wert auf räumliche Präzision statt auf komplexe interne Feinabstimmung. Da die Aufmerksamkeit für jedes neue Wort wiederholt aufgerufen wird, reduziert diese Vereinfachung die Berechnung und Latenz, ohne die Qualität der Bildunterschriften zu opfern.

Vergleich mit anderen Systemen zur Bildunterschriftenerstellung

Um zu prüfen, ob sich diese Designentscheidungen auszahlen, evaluieren die Forschenden MSSA auf dem weit verbreiteten MSCOCO-Datensatz, der Alltagsfotos mit mehreren menschlich verfassten Bildunterschriften paart. Sie vergleichen MSSA mit einer Reihe starker Modellbaselines, darunter ältere Systeme sowie neuere auf Aufmerksamkeit und Transformern basierende Entwürfe. Anhand standardisierter Qualitätsmaße, die Grammatik, Ähnlichkeit zu menschlichen Beschreibungen und wie gut zentrale Beziehungen erfasst werden, bewährt sich MSSA konstant und übertrifft oder erreicht die Leistung der meisten aktuellen Spitzenmodelle. Wichtig ist, dass es dies mit einem vereinfachten Aufmerksamkeitsweg tut, der leicht die Anzahl der Parameter, den Rechenaufwand pro Bildunterschrift und die Zeit zur Generierung jedes Satzes reduziert. Qualitative Beispiele zeigen, dass MSSA häufig zusätzliche Kontextdetails bemerkt — etwa eine Wasserflasche auf einem Tisch, die Richtung von Rauch hinter einem Flugzeug oder welche Person in einer Menschenmenge für die Beschreibung am wichtigsten ist —, die konkurrierende Systeme entweder übersehen oder falsch interpretieren.

Was das für Alltagsbilder bedeutet

Für Nicht‑Spezialisten lautet die Kernbotschaft: Bessere Bildunterschriften entstehen nicht nur durch größere Modelle, sondern durch klügeren Einsatz visueller Details und Gedächtnis. Indem MSSA bereichert, was das Modell in jeder Bildregion „sieht“, und ihm erlaubt, sich beim Schreiben wiederholt neu zu fokussieren, kann es Beschreibungen erzeugen, die menschlicher wirken: Sie nennen Schlüsselfobjekte, erfassen deren Beziehungen und fügen kleine, aber aufschlussreiche Details hinzu. Gleichzeitig vermeidet das vereinfachte Aufmerksamkeitsdesign unnötige Komplexität und bietet ein praktisches Gleichgewicht zwischen Genauigkeit und Effizienz. Das macht MSSA zu einem vielversprechenden Baustein für Anwendungen von barrierefreien Fotobibliotheken für sehbehinderte Nutzer bis hin zu intuitiverer Suche und Organisation der umfangreichen Bildersammlungen, die unser digitales Leben prägen.

Zitation: Hossain, M.A., Ye, Z., Hossen, M.B. et al. MSSA: memory-driven and simplified scaled attention for enhanced image captioning. Sci Rep 16, 11203 (2026). https://doi.org/10.1038/s41598-026-40164-8

Schlüsselwörter: Bildunterschrift, Aufmerksamkeitsmechanismen, multimodales Lernen, Computer Vision, Tiefes Lernen