Clear Sky Science · ru

Многомерная сравнительная оценка DeepSeek и ChatGPT на экзаменах USMLE и CNMLE для медицинского образования

Почему важны более умные помощники для экзаменов

Будущие врачи по всему миру должны сдавать строгие лицензионные экзамены, прежде чем они смогут лечить пациентов. В то же время мощные чат‑боты на базе больших языковых моделей становятся обычными партнёрами по обучению. В этой статье подробно рассматривается, как две такие системы, DeepSeek и ChatGPT, справляются с медицинскими лицензионными экзаменами, используемыми в США (USMLE) и Китае (CNMLE), и задаётся простой, но важный вопрос: могут ли эти инструменты действительно помочь в подготовке безопасных, хорошо подготовленных врачей — и если да, при каких гарантиях?

Два крупных экзамена, два мощных инструмента

Исследователи сосредоточились на USMLE и CNMLE — национальных экзаменах, которые проверяют широкий спектр медицинских знаний, от базовых наук до клинического принятия решений. Они собрали сотни реальных вопросов: 243 из примера USMLE и 300 из банка вопросов CNMLE, охватывающих такие темы, как внутренние болезни, хирургия, педиатрия, психиатрия и другие. Вопросы, требовавшие анализа медицинских изображений, были удалены, чтобы обе системы решали только текстовые задачи. Затем команда опрашивала по две версии каждой системы — GPT‑4o‑mini для ChatGPT и DeepSeek‑R1 для DeepSeek — на английском и китайском языках, используя простые инструкции, имитирующие то, как реальный студент мог бы просить о помощи при подготовке к экзамену.

Кто отвечал лучше и с какой стабильностью?

Чтобы сравнить инструменты справедливо, исследователи прогнали каждый экзамен три раза для каждой системы и измерили, как часто ответы совпадали с официальным ключом. По вопросам USMLE DeepSeek правильно отвечал примерно в 93% случаев, немного опережая ChatGPT с примерно 90%. У CNMLE DeepSeek также имел преимущество, набрав около 87% против 79% у ChatGPT. DeepSeek превзошёл ChatGPT во всех трёх шагах USMLE, включая самый сложный раздел по клиническому принятию решений, и во всех четырёх блоках CNMLE, особенно в областях, насыщенных базовой наукой и клиническими знаниями на китайском языке. Команда также проверила стабильность инструментов при повторных запусках и обнаружила, что оба демонстрируют высокую согласованность, причём DeepSeek снова оказался немного сильнее.

Думают вслух, но иногда слишком медленно

Современные языковые модели часто показывают ход рассуждений по шагам, как студент, выписывающий логику. Исследователи посчитали количество символов в этих объяснениях как приблизительную меру того, сколько «мышления» продемонстрировала каждая система. По USMLE оба инструмента были похожи, предоставляя рассуждения сопоставимой длины. Однако по CNMLE DeepSeek выдавал заметно более длинные объяснения, что свидетельствует о более глубоких или детализированных цепочках рассуждений при работе со сложными китайскими медицинскими вопросами. Ценой за это была скорость: DeepSeek дольше завершал оба экзамена, особенно CNMLE, тогда как ChatGPT отвечал быстрее. Иными словами, DeepSeek склонялся к большей точности и многословию, тогда как ChatGPT отдавал предпочтение эффективности.

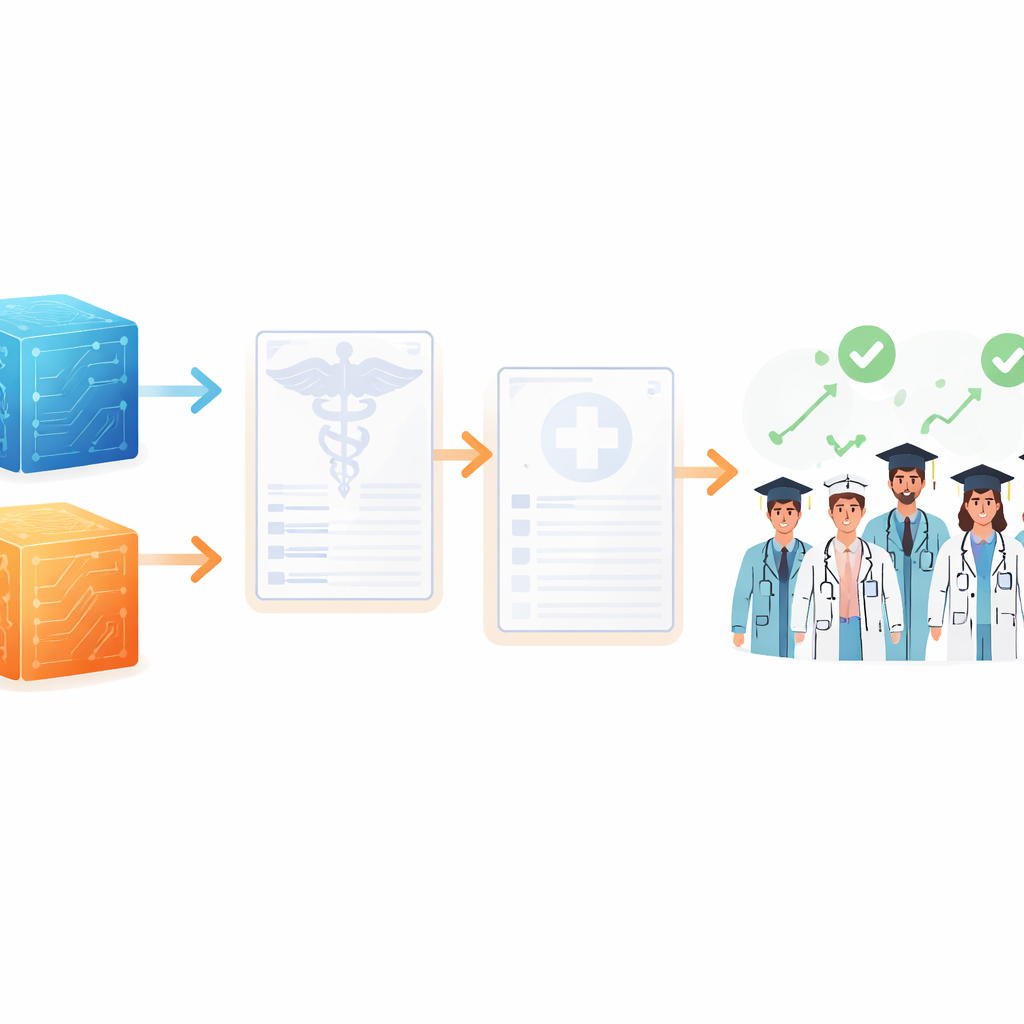

Обещания, подводные камни и новая сетка безопасности

Несмотря на высокие результаты — в среднем выше, чем у многих человеческих участников — обе системы всё ещё допускали существенные ошибки. В некоторых случаях они выбирали правдоподобные, но неверные методы лечения или неправильно интерпретировали тонкие концепты, что является хорошо известной проблемой «галлюцинаций», когда модель уверенно выдумывает или неправильно применяет факты. Вместе с тем они выявляли и неожиданные сильные стороны, например обнаружение некорректных экзаменационных вопросов, у которых вообще не было правильного ответа. Поскольку медицинское образование тесно связано с безопасностью пациентов, авторы утверждают, что эти инструменты нужно рассматривать как помощников, а не как авторитеты. В поддержку более безопасного использования они предлагают техническую «петлю проверки фактов», связывающую модель с тщательно построенным медицинским графом знаний. Когда модель отвечает на вопрос, её утверждения разбираются, проверяются по надёжным источникам, таким как руководства и учебники, и им присваиваются уровни уверенности перед показом обучающимся.

Что это означает для будущей медицинской подготовки

Для неспециалистов посыл одновременно обнадёживающий и предостерегающий. DeepSeek и ChatGPT уже показывают результаты на уровне или выше многих студентов‑медиков на письменных экзаменах, что означает: они могут существенно помогать в учёбе, при выполнении практических вопросов и даже в переработке преподавания в сторону более подробных поэтапных рассуждений. Тем не менее их ошибки — и непрозрачность того, как они приходят к выводам — означают, что они не могут заменить человеческих преподавателей или лицензированных клиницистов. Авторы видят будущее, в котором такие системы выступают как строго контролируемые «ассистент‑тренеры» для студентов‑медиков, встроенные в систему, требующую доказательств, отслеживающую надёжность и сохраняющую за человеком принятие ключевых решений. При осторожной разработке и управлении эти ИИ‑помощники могут постепенно сдвинуть медицинское образование от простого запоминания в сторону более интерактивного, генеративного обучения — не теряя из виду конечную цель: более безопасную помощь реальным пациентам.

Цитирование: Wang, Q., Li, J., Li, X. et al. Multi-metric comparative evaluation of DeepSeek and ChatGPT in USMLE versus CNMLE for medical education. Sci Rep 16, 13880 (2026). https://doi.org/10.1038/s41598-026-40043-2

Ключевые слова: ИИ в медицинском образовании, большие языковые модели, результаты USMLE, китайский медицинский лицензионный экзамен, схема проверки фактов