Clear Sky Science · pl

Wielomiernikowa ocena porównawcza DeepSeek i ChatGPT w USMLE a CNMLE dla kształcenia medycznego

Dlaczego inteligentniejsze narzędzia do przygotowań egzaminacyjnych mają znaczenie

Przyszli lekarze na całym świecie muszą zdać trudne egzaminy licencyjne, zanim będą mogli leczyć pacjentów. Równocześnie potężne chatboty oparte na dużych modelach językowych stają się powszechnymi partnerami do nauki. Ten artykuł przygląda się uważnie, jak dwa takie systemy — DeepSeek i ChatGPT — radzą sobie z egzaminami lekarskimi stosowanymi w Stanach Zjednoczonych (USMLE) i Chinach (CNMLE), i stawia proste, ale istotne pytanie: czy te narzędzia naprawdę mogą pomagać w kształceniu bezpiecznych, dobrze przygotowanych lekarzy — a jeśli tak, to przy jakich zabezpieczeniach?

Dwa duże egzaminy, dwa potężne narzędzia

Naukowcy skupili się na USMLE i CNMLE, krajowych egzaminach sprawdzających szeroki zakres wiedzy medycznej, od nauk podstawowych po podejmowanie decyzji klinicznych. Zebrali setki prawdziwych pytań: 243 z próbnego egzaminu USMLE i 300 z bazy pytań CNMLE, obejmujących takie dziedziny jak choroby wewnętrzne, chirurgia, pediatria, psychiatria i inne. Pytania wymagające analizy obrazów medycznych zostały usunięte, tak aby oba narzędzia mierzyły się wyłącznie z wyzwaniami tekstowymi. Zespół następnie zapytał dwie wersje każdego systemu — GPT‑4o‑mini dla ChatGPT i DeepSeek‑R1 dla DeepSeek — zarówno po angielsku, jak i po chińsku, używając prostych instrukcji naśladujących sposób, w jaki rzeczywisty student mógłby prosić o pomoc podczas przygotowań do egzaminu.

Kto odpowiadał lepiej i jak konsekwentnie?

Aby porównać narzędzia sprawiedliwie, badacze przeprowadzili każdy egzamin trzykrotnie z każdym systemem, a następnie zmierzyli, jak często odpowiedzi zgadzały się z oficjalnym kluczem. W pytaniach USMLE DeepSeek odpowiedział poprawnie około 93% czasu, nieco wyprzedzając ChatGPT z około 90%. DeepSeek utrzymał podobną przewagę w CNMLE, osiągając około 87% wobec 79% ChatGPT. DeepSeek przewyższał ChatGPT we wszystkich trzech etapach USMLE, w tym w najbardziej złożonej części dotyczącej podejmowania decyzji klinicznych, oraz we wszystkich czterech jednostkach CNMLE, szczególnie w obszarach silnie związanych z chińskojęzycznymi naukami podstawowymi i wiedzą kliniczną. Zespół sprawdził również, jak stabilne są narzędzia przy powtarzanych uruchomieniach, stwierdzając, że oba wykazywały wysoką spójność, z lekką przewagą DeepSeek.

Myślenie na głos, ale czasem zbyt wolno

Nowoczesne modele językowe często pokazują rozumowanie krok po kroku, podobnie jak student zapisujący swoje myśli. Badacze policzyli liczbę znaków w tych wyjaśnieniach jako przybliżoną miarę, ile „myślenia” każde z systemów wykazało. W USMLE oba narzędzia były podobne, dostarczając wyjaśnienia o porównywalnej długości. W CNMLE jednak DeepSeek generował zauważalnie dłuższe wyjaśnienia, co sugeruje głębsze lub bardziej szczegółowe ciągi rozumowania przy radzeniu sobie ze złożonymi chińskimi pytaniami medycznymi. Kosztem tego była szybkość: DeepSeek potrzebował więcej czasu na ukończenie obu egzaminów, zwłaszcza CNMLE, podczas gdy ChatGPT odpowiadał szybciej. Innymi słowy, DeepSeek miał tendencję do większej dokładności i bardziej rozbudowanych odpowiedzi, natomiast ChatGPT preferował efektywność.

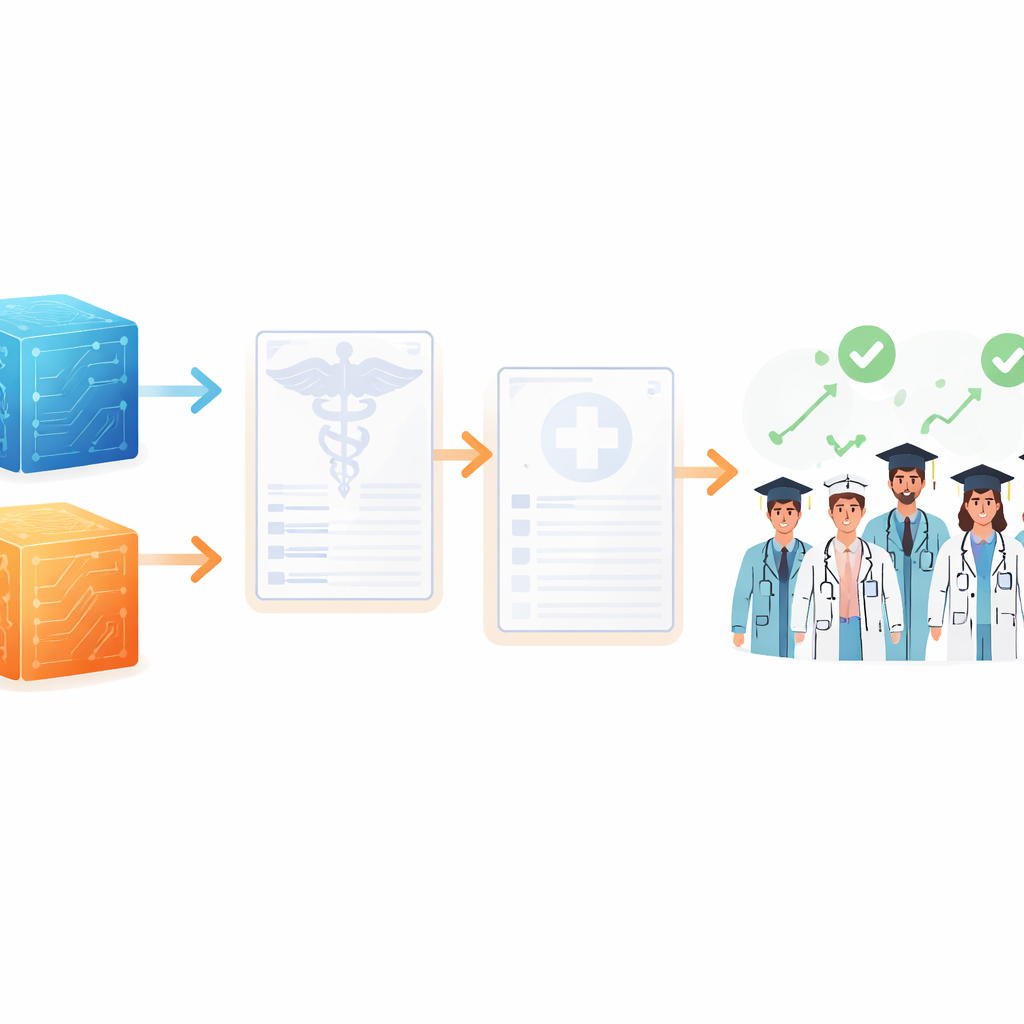

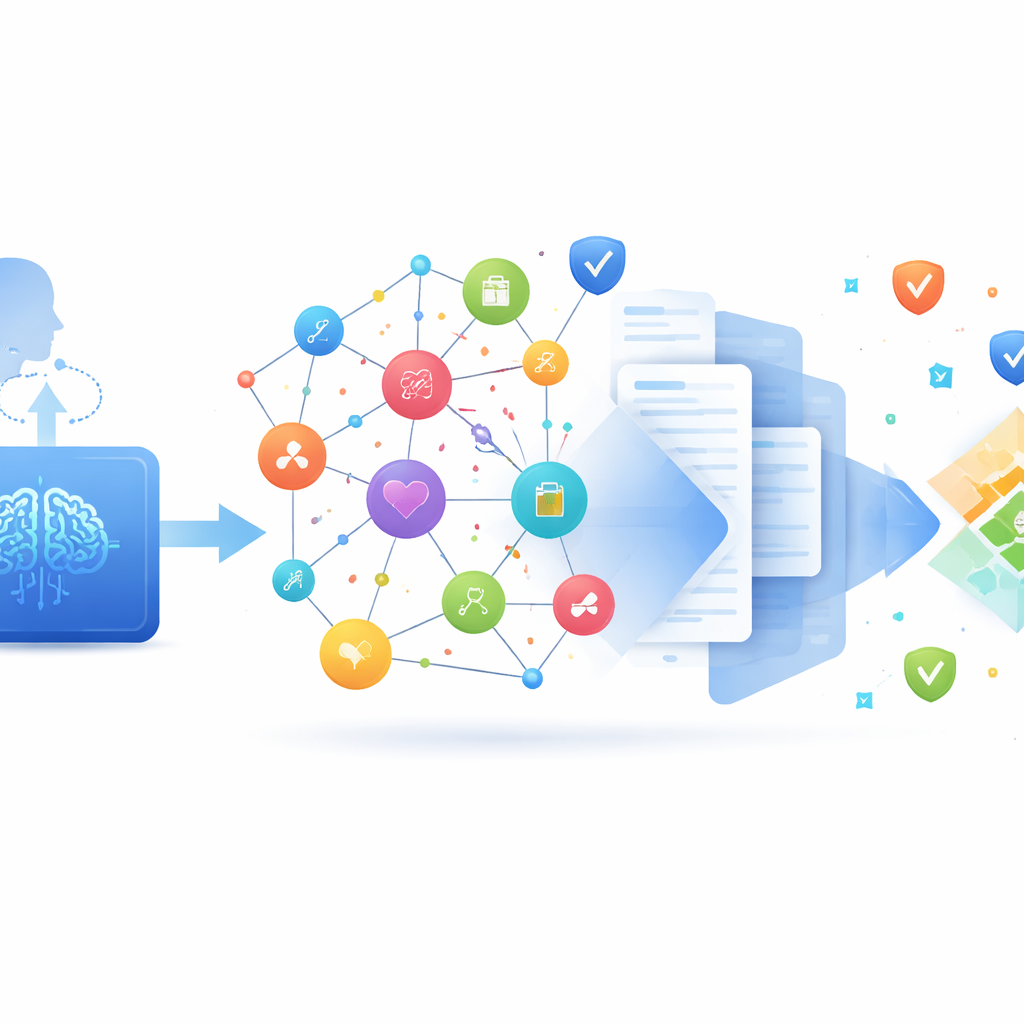

Obietnice, pułapki i nowe zabezpieczenie

Mimo wysokich wyników — wyższych średnio niż wielu ludzkich zdających — oba systemy wciąż popełniały istotne błędy. W niektórych przypadkach wybierały brzmiejące wiarygodnie, lecz błędne leczenia lub źle rozumiały subtelne koncepcje, co jest dobrze znanym problemem zwanym „halucynacją”, kiedy model pewnie wymyśla lub niewłaściwie stosuje fakty. Jednocześnie wykazywały zaskakujące mocne strony, na przykład wykrywanie wadliwych pytań egzaminacyjnych, które w ogóle nie miały poprawnej odpowiedzi. Ponieważ edukacja medyczna jest ściśle powiązana z bezpieczeństwem pacjenta, autorzy argumentują, że te narzędzia trzeba traktować jako pomocników, a nie autorytety. Aby wspierać bezpieczniejsze użycie, proponują techniczną „pętlę weryfikacji faktów”, łączącą model z starannie zbudowanym grafem wiedzy medycznej. Gdy model odpowiada na pytanie, jego twierdzenia byłyby rozbijane, sprawdzane względem zaufanych źródeł, takich jak wytyczne i podręczniki, i przypisywane byłyby im poziomy ufności przed pokazaniem ich uczącym się.

Co to oznacza dla przyszłego kształcenia medycznego

Dla osób niebędących ekspertami przesłanie jest jednocześnie zachęcające i ostrożne. DeepSeek i ChatGPT już teraz osiągają poziom równy lub wyższy niż wielu studentów medycyny na egzaminach pisemnych, co sugeruje, że mogą znacząco wspierać naukę, zadania praktyczne i nawet przeprojektowywanie nauczania wokół bogatszego, krok po kroku rozumowania. Jednak ich błędy — oraz nieprzejrzystość sposobu, w jaki dochodzą do wniosków — oznaczają, że nie mogą zastąpić ludzkich nauczycieli ani licencjonowanych klinicystów. Autorzy wyobrażają sobie przyszłość, w której takie systemy działają jako ściśle nadzorowani „asystenci‑coachowie” dla osób uczących się medycyny, osadzeni w ramach wymagających dowodów, śledzących wiarygodność i utrzymujących ludzkie osądy w roli decydującej. Jeśli zostaną zbudowane i regulowane starannie, te pomocniki AI mogą stopniowo przesunąć edukację medyczną od prostego zapamiętywania ku bardziej interaktywnej, generatywnej nauce — nie tracąc z pola widzenia ostatecznego celu: bezpieczniejszej opieki nad prawdziwymi pacjentami.

Cytowanie: Wang, Q., Li, J., Li, X. et al. Multi-metric comparative evaluation of DeepSeek and ChatGPT in USMLE versus CNMLE for medical education. Sci Rep 16, 13880 (2026). https://doi.org/10.1038/s41598-026-40043-2

Słowa kluczowe: AI w edukacji medycznej, duże modele językowe, wyniki USMLE, chiński egzamin lekarski, ramy weryfikacji faktów