Clear Sky Science · es

Evaluación comparativa multimétrica de DeepSeek y ChatGPT en el USMLE frente al CNMLE para la educación médica

Por qué importan los ayudantes de examen más inteligentes

Los futuros médicos de todo el mundo deben aprobar exigentes exámenes de licencia antes de poder tratar a pacientes. Al mismo tiempo, los potentes chatbots basados en modelos de lenguaje a gran escala se están convirtiendo en compañeros de estudio habituales. Este artículo analiza con detalle cómo dos de esos sistemas, DeepSeek y ChatGPT, afrontan los exámenes de licencia médica utilizados en Estados Unidos (USMLE) y en China (CNMLE), y plantea una pregunta simple con grandes consecuencias: ¿pueden estas herramientas realmente ayudar a formar médicos seguros y bien preparados —y, de ser así, bajo qué salvaguardias?

Dos grandes exámenes, dos herramientas potentes

Los investigadores se centraron en el USMLE y el CNMLE, exámenes nacionales que evalúan un amplio rango de conocimientos médicos, desde ciencias básicas hasta toma de decisiones clínicas. Reunieron cientos de preguntas reales: 243 del examen de muestra del USMLE y 300 del banco de preguntas del CNMLE, abarcando temas como medicina interna, cirugía, pediatría, psiquiatría y más. Se eliminaron las preguntas que requerían ver imágenes médicas para que ambas herramientas se enfrentaran únicamente a retos basados en texto. El equipo consultó después dos versiones de cada sistema —GPT‑4o‑mini para ChatGPT y DeepSeek‑R1 para DeepSeek— tanto en inglés como en chino, usando instrucciones sencillas que imitaron cómo un estudiante real podría pedir ayuda durante la preparación del examen.

¿Quién respondió mejor y con qué consistencia?

Para comparar las herramientas de forma justa, los investigadores ejecutaron cada examen tres veces con cada sistema y luego midieron con qué frecuencia las respuestas coincidían con la clave oficial. En las preguntas del USMLE, DeepSeek respondió correctamente aproximadamente el 93% de las veces, ligeramente por delante de ChatGPT, con cerca del 90%. DeepSeek mantuvo una ventaja similar en el CNMLE, obteniendo alrededor del 87% frente al 79% de ChatGPT. DeepSeek superó a ChatGPT en los tres pasos del USMLE, incluida la sección más compleja de toma de decisiones clínicas, y en las cuatro unidades del CNMLE, especialmente en áreas con gran carga de ciencias básicas y conocimientos clínicos en chino. El equipo también comprobó la estabilidad de las herramientas en ejecuciones repetidas, encontrando que ambas mostraban alta consistencia, con DeepSeek nuevamente algo más sólido.

Pensamiento en voz alta, pero a veces más lento

Los modelos de lenguaje modernos suelen mostrar su razonamiento paso a paso, como un estudiante que escribe su lógica. Los investigadores contaron el número de caracteres en estas explicaciones como una medida aproximada de cuánto “pensamiento” mostraba cada sistema. En el USMLE, las dos herramientas fueron similares, proporcionando razonamientos de longitud comparable. En el CNMLE, sin embargo, DeepSeek produjo explicaciones notablemente más largas, lo que sugiere cadenas de pensamiento más profundas o detalladas al abordar preguntas médicas complejas en chino. La compensación fue la velocidad: DeepSeek tardó más en completar ambos exámenes, especialmente el CNMLE, mientras que ChatGPT respondió más rápido. En otras palabras, DeepSeek tendió a ser más preciso y más prolijo, mientras que ChatGPT favoreció la eficiencia.

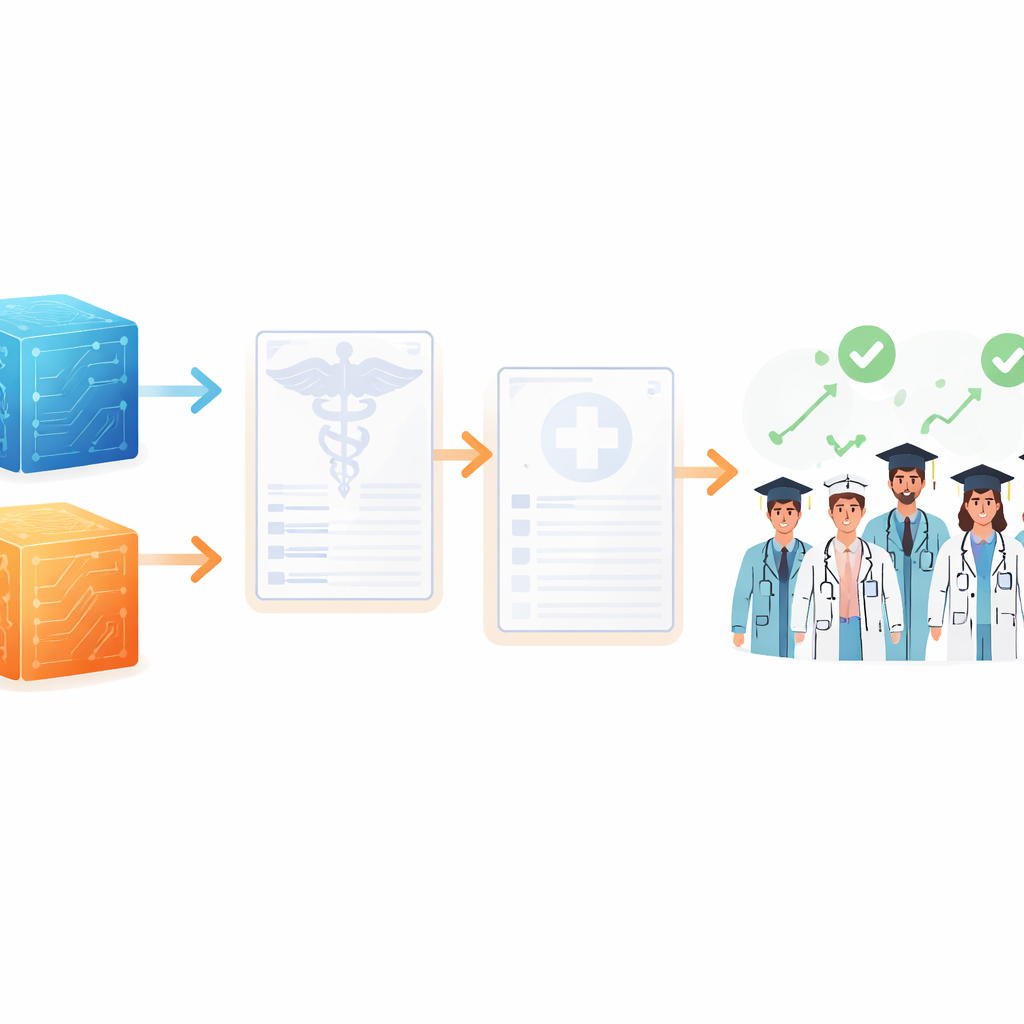

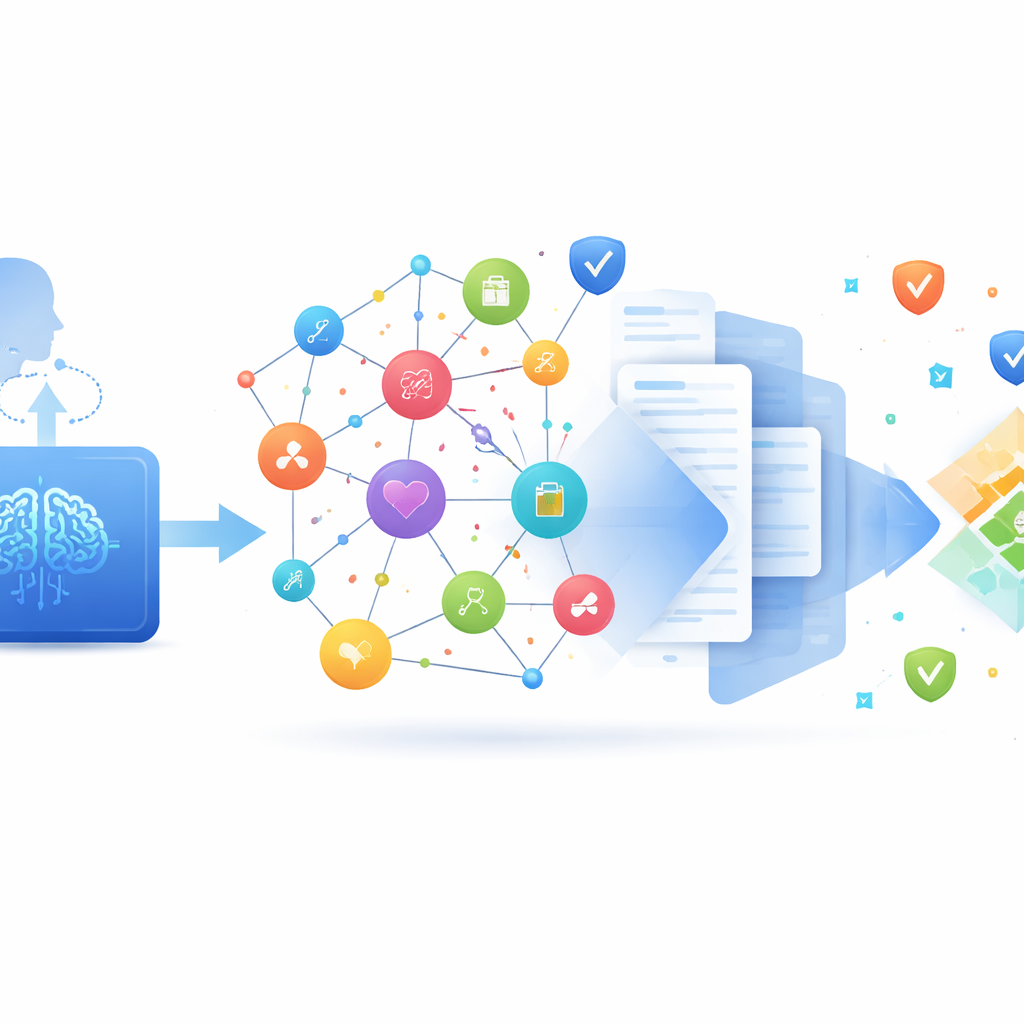

Promesa, riesgos y una nueva red de seguridad

A pesar de sus altas puntuaciones —superiores, en promedio, a las de muchos examinados humanos— ambos sistemas todavía cometieron errores importantes. En algunos casos escogieron tratamientos verosímiles pero incorrectos o malinterpretaron conceptos sutiles, un problema bien conocido llamado “alucinación”, en el que el modelo inventa o aplica hechos de forma confidente pero errónea. Al mismo tiempo, mostraron fortalezas sorprendentes, como detectar preguntas de examen defectuosas que no tenían ninguna respuesta correcta. Dado que la educación médica está estrechamente ligada a la seguridad del paciente, los autores sostienen que estas herramientas deben tratarse como ayudantes, no como autoridades. Para apoyar un uso más seguro, proponen un “bucle de verificación de hechos” técnico que conecte el modelo con un grafo de conocimiento médico cuidadosamente construido. Cuando el modelo responda una pregunta, sus afirmaciones se descompondrían, se contrastarían con fuentes de confianza como guías y libros de texto, y se asignarían niveles de confianza antes de mostrarse a los aprendices.

Qué significa esto para la formación médica futura

Para los no expertos, el mensaje es a la vez alentador y cauteloso. DeepSeek y ChatGPT ya rinden al nivel o por encima del de muchos estudiantes de medicina en exámenes escritos, lo que sugiere que pueden apoyar de forma significativa el estudio, las preguntas de práctica e incluso el rediseño de la enseñanza en torno a un razonamiento más rico y paso a paso. Sin embargo, sus errores —y la opacidad de cómo llegan a sus conclusiones— implican que no pueden reemplazar a los docentes humanos ni a los clínicos con licencia. Los autores se imaginan un futuro en el que tales sistemas actúen como “entrenadores asistentes” estrechamente supervisados para los aprendices de medicina, integrados en un marco que exija evidencia, rastree la fiabilidad y mantenga el juicio humano firmemente a cargo. Si se construyen y gobiernan con cuidado, estos ayudantes de IA podrían desplazar gradualmente la educación médica de la memorización simple hacia un aprendizaje más interactivo y generativo —sin perder de vista el objetivo final: una atención más segura para pacientes reales.

Cita: Wang, Q., Li, J., Li, X. et al. Multi-metric comparative evaluation of DeepSeek and ChatGPT in USMLE versus CNMLE for medical education. Sci Rep 16, 13880 (2026). https://doi.org/10.1038/s41598-026-40043-2

Palabras clave: IA para educación médica, modelos de lenguaje a gran escala, rendimiento en USMLE, examen de licencia médica chino, marco de verificación de hechos