Clear Sky Science · it

Valutazione comparativa multimetrica di DeepSeek e ChatGPT in USMLE vs CNMLE per l'educazione medica

Perché contano strumenti d'esame più intelligenti

I futuri medici di tutto il mondo devono superare esami di abilitazione impegnativi prima di poter curare i pazienti. Allo stesso tempo, potenti chatbot basati su grandi modelli linguistici stanno diventando compagni di studio comuni. Questo articolo analizza da vicino come due di questi sistemi, DeepSeek e ChatGPT, affrontano gli esami di abilitazione medica usati negli Stati Uniti (USMLE) e in Cina (CNMLE), e pone una domanda semplice ma dalle grandi conseguenze: questi strumenti possono davvero aiutare a formare medici sicuri e ben preparati—e se sì, con quali salvaguardie?

Due grandi esami, due strumenti potenti

I ricercatori si sono concentrati su USMLE e CNMLE, esami nazionali che valutano un ampio spettro di conoscenze mediche, dalla scienza di base al ragionamento clinico. Hanno raccolto centinaia di domande reali: 243 dal campione d'esame USMLE e 300 dalla banca domande CNMLE, coprendo argomenti come medicina interna, chirurgia, pediatria, psichiatria e altro. Le domande che richiedevano l'analisi di immagini mediche sono state rimosse affinché entrambi gli strumenti affrontassero solo sfide testuali. Il team ha quindi interrogato due versioni di ciascun sistema—GPT‑4o‑mini per ChatGPT e DeepSeek‑R1 per DeepSeek—in inglese e in cinese, usando istruzioni semplici che imitavano il modo in cui uno studente reale potrebbe chiedere aiuto durante la preparazione all'esame.

Chi ha risposto meglio, e con che coerenza?

Per confrontare gli strumenti in modo equo, i ricercatori hanno eseguito ogni esame tre volte con ciascun sistema, quindi hanno misurato quanto spesso le risposte coincidevano con la chiave ufficiale. Sulle domande USMLE, DeepSeek ha risposto correttamente circa il 93% delle volte, leggermente davanti a ChatGPT con circa il 90%. DeepSeek ha mantenuto un vantaggio simile sul CNMLE, segnando circa l'87% contro il 79% di ChatGPT. DeepSeek ha superato ChatGPT in tutti e tre i passaggi dell'USMLE, inclusa la sezione più complessa sul ragionamento clinico, e in tutte e quattro le unità del CNMLE, specialmente in aree ricche di conoscenze di base e cliniche in lingua cinese. Il team ha anche verificato la stabilità degli strumenti attraverso esecuzioni ripetute, constatando che entrambi mostravano alta coerenza, con DeepSeek di nuovo leggermente più forte.

Ragionare ad alta voce, ma a volte più lentamente

I moderni modelli linguistici spesso mostrano il loro ragionamento passo dopo passo, un po' come uno studente che scrive la propria logica. I ricercatori hanno contato il numero di caratteri in queste spiegazioni come misura approssimativa di quanto “pensiero” ciascun sistema mostrasse. Sull'USMLE, i due strumenti erano simili, offrendo ragionamenti di lunghezza comparabile. Sul CNMLE, tuttavia, DeepSeek ha prodotto spiegazioni notevolmente più lunghe, suggerendo catene di pensiero più profonde o più dettagliate quando affrontava complesse domande mediche in cinese. Il compromesso è stato la velocità: DeepSeek ha impiegato più tempo per completare entrambi gli esami, specialmente il CNMLE, mentre ChatGPT ha risposto più rapidamente. In altre parole, DeepSeek tendeva a essere più accurato e più verboso, mentre ChatGPT privilegiava l'efficienza.

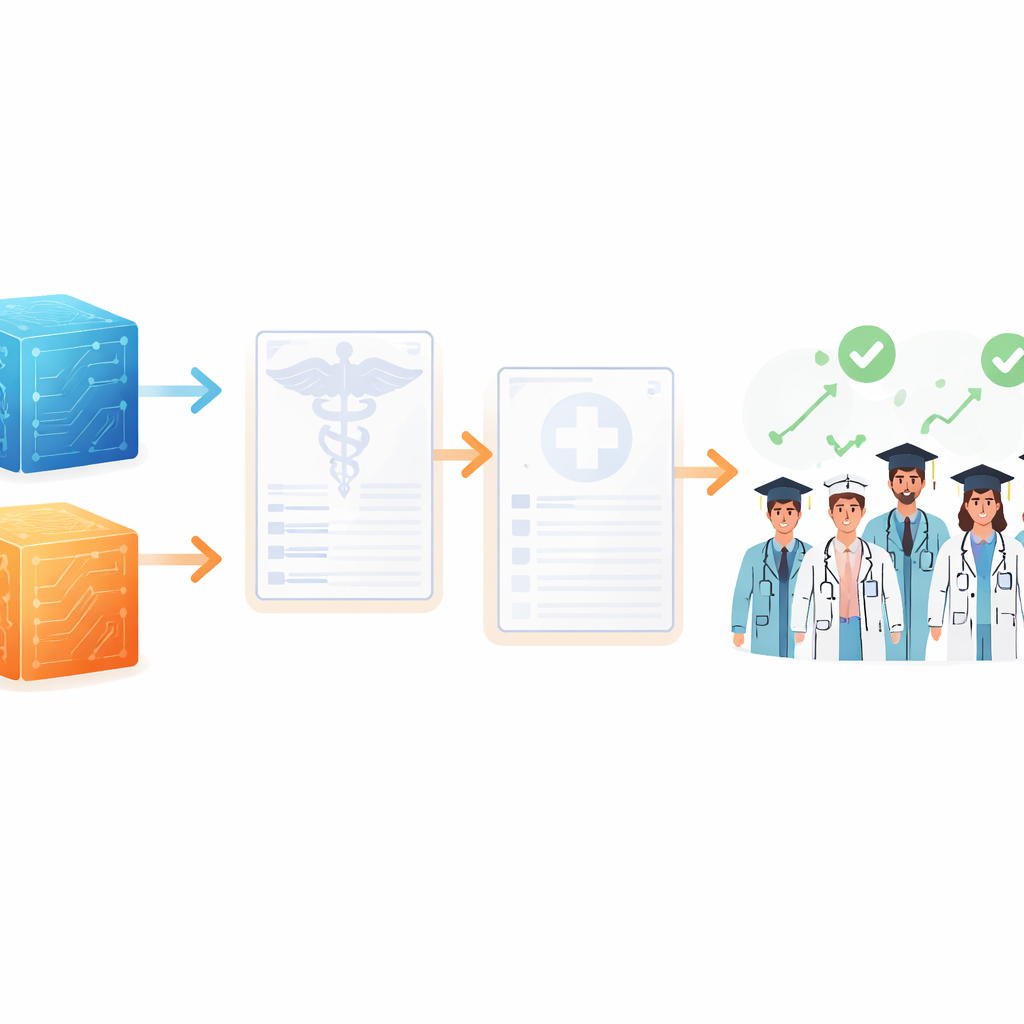

Promesse, rischi e una nuova rete di sicurezza

Nonostante i punteggi elevati—più alti, in media, rispetto a molti candidati umani—entrambi i sistemi hanno comunque commesso errori importanti. In alcuni casi hanno scelto trattamenti plausibili ma sbagliati o hanno frainteso concetti sottili, un problema noto come “allucinazione”, in cui il modello inventa con sicurezza o applica in modo errato fatti. Allo stesso tempo, hanno mostrato punti di forza sorprendenti, come individuare domande d'esame difettose che non avevano alcuna risposta corretta. Poiché l'educazione medica è strettamente legata alla sicurezza del paziente, gli autori sostengono che questi strumenti devono essere trattati come aiutanti, non come autorità. Per favorire un uso più sicuro, propongono un "loop" tecnico di verifica dei fatti che colleghi il modello a un grafo di conoscenze mediche costruito con cura. Quando il modello risponde a una domanda, le sue affermazioni verrebbero scomposte, confrontate con fonti fidate come linee guida e testi di riferimento, e assegnate livelli di confidenza prima di essere mostrate agli apprendenti.

Cosa significa per la formazione medica futura

Per i non esperti, il messaggio è insieme incoraggiante e prudente. DeepSeek e ChatGPT già performano al livello o al di sopra di molti studenti di medicina in esami scritti, suggerendo che possono supportare in modo significativo lo studio, le domande di pratica e persino la riprogettazione dell'insegnamento attorno a un ragionamento più ricco e step‑by‑step. Tuttavia i loro errori—e l'opacità del modo in cui arrivano alle conclusioni—significano che non possono sostituire insegnanti umani o clinici abilitati. Gli autori immaginano un futuro in cui tali sistemi agiscano come “allenatori assistenti” strettamente supervisionati per gli studenti di medicina, inseriti in un quadro che richiede evidenza, traccia l'affidabilità e mantiene il giudizio umano saldamente al comando. Se costruiti e governati con cura, questi aiuti basati su IA potrebbero spostare gradualmente l'educazione medica dalla semplice memorizzazione verso un apprendimento più interattivo e generativo—senza perdere di vista l'obiettivo ultimo: cure più sicure per pazienti reali.

Citazione: Wang, Q., Li, J., Li, X. et al. Multi-metric comparative evaluation of DeepSeek and ChatGPT in USMLE versus CNMLE for medical education. Sci Rep 16, 13880 (2026). https://doi.org/10.1038/s41598-026-40043-2

Parole chiave: IA per l'educazione medica, modelli linguistici di grandi dimensioni, prestazioni USMLE, esame di abilitazione medica cinese, framework di verifica dei fatti