Clear Sky Science · pt

DermaScanAI, uma estrutura híbrida e explicável de deep learning para classificação automatizada de lesões cutâneas usando atenção dupla e fusão de metadados

Por que exames de pintas mais inteligentes importam

O câncer de pele está entre os tipos de câncer mais comuns, e identificá-lo precocemente pode salvar vidas. Ainda assim, muitas pessoas aguardam meses ou anos antes de examinar uma pinta suspeita, e até médicos experientes podem ter dificuldade em avaliar casos complexos. Este estudo apresenta o DermaScanAI, um sistema computacional projetado para ajudar médicos a separar manchas inofensivas das perigosas ao analisar imagens detalhadas da pele e informações básicas do paciente, mostrando também de forma clara o que ele “observou” para chegar à sua decisão.

Ensinando computadores a interpretar imagens da pele

Dermatologistas frequentemente usam um dispositivo portátil chamado dermoscópio para capturar imagens em close de pintas e outras manchas. Essas imagens revelam pequenos padrões de cor e textura que podem indicar câncer, mas também estão cheias de distrações, como pelos, iluminação desigual e diferenças de câmera. O DermaScanAI começa limpando as imagens: remove digitalmente pelos, equaliza brilho e cores e amplia a área da lesão para um tamanho padrão. O sistema então aumenta os dados rotacionando, espelhando e alterando levemente as cores, de modo que o computador veja muitas variações realistas de cada lesão, ajudando-o a lidar melhor com a diversidade do mundo real.

Vendo tanto o detalhe fino quanto a visão geral

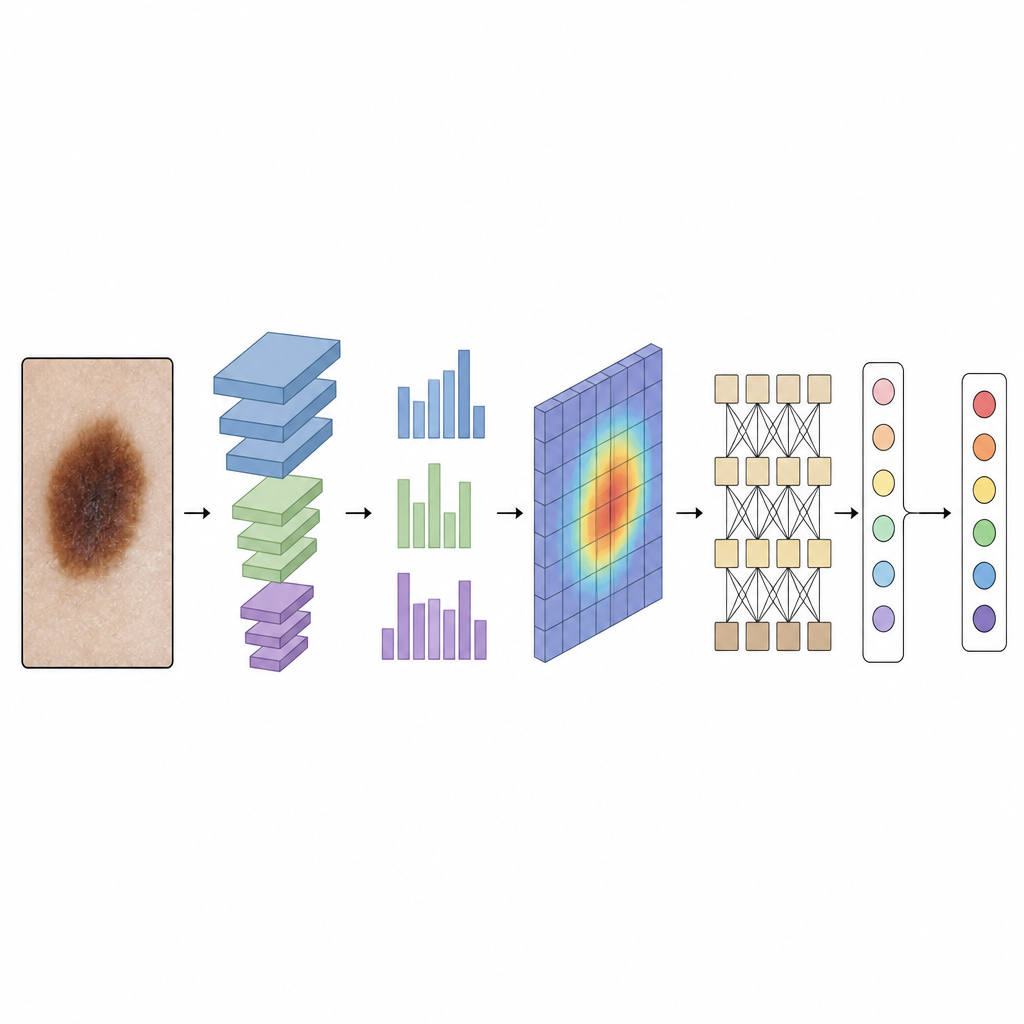

Muitas ferramentas anteriores para câncer de pele focavam apenas em padrões locais pequenos ou apenas na forma geral, o que pode causar confusão quando lesões muito diferentes parecem semelhantes em partes. O DermaScanAI combina dois tipos de reconhecimento de padrões para evitar esse problema. Primeiro, uma rede convolucional moderna, um tipo de mecanismo de processamento de imagem, identifica detalhes finos como bordas, pontos de cor e textura em várias escalas, desde pequenos fragmentos até regiões maiores. Sobre isso, módulos especiais de atenção ajudam o sistema a “aumentar o volume” dos canais de cor e áreas da imagem mais informativos, enquanto atenuam regiões de fundo pouco úteis.

Adicionando contexto global e pistas do paciente

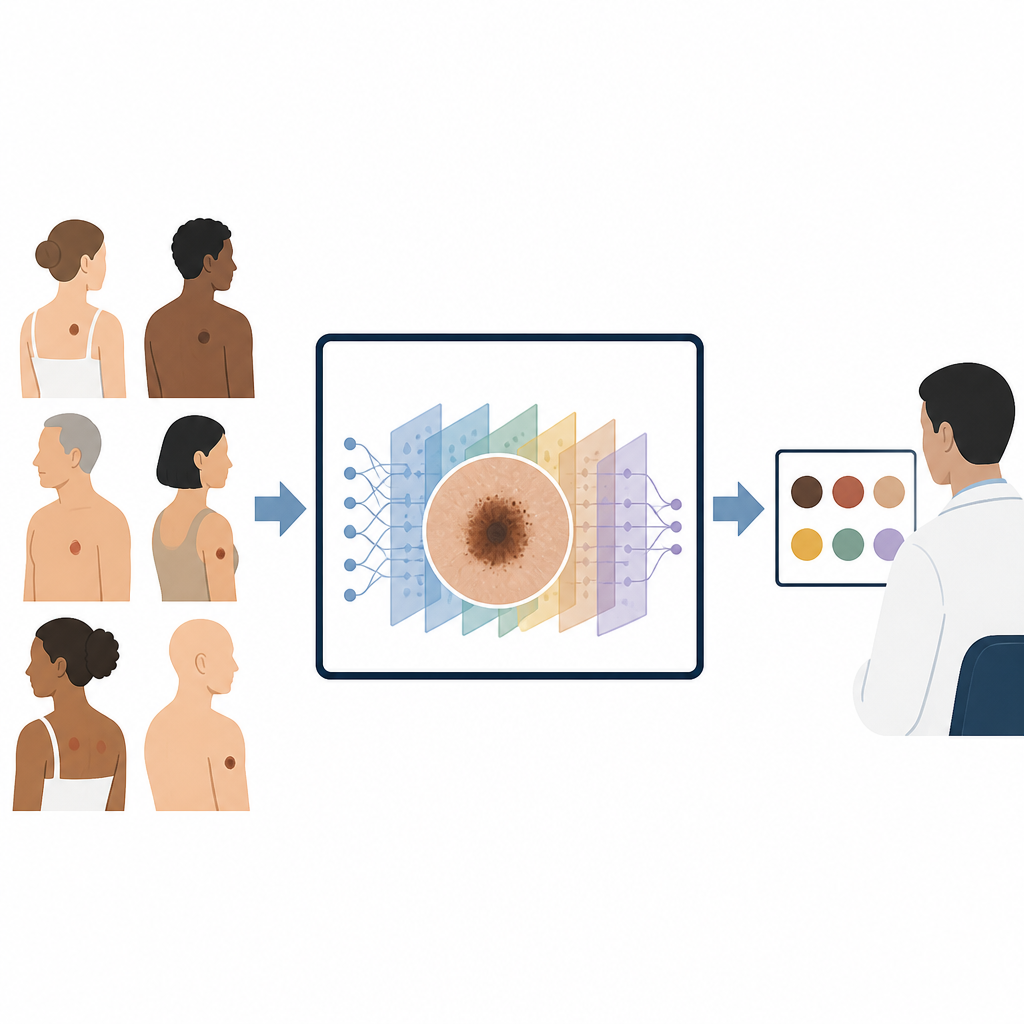

Após focar nas regiões de imagem mais importantes, o DermaScanAI passa as características refinadas para um módulo transformer leve. Essa parte do modelo é boa em relacionar partes distantes da imagem, de modo que pode conectar o centro de uma pinta à sua borda e à pele ao redor. Ao mesmo tempo, o sistema incorpora informações simples do paciente, como idade, sexo e localização corporal da lesão. Essas pistas refletem a prática clínica real, onde uma mancha escura na perna de uma pessoa jovem pode representar um risco diferente do que uma mancha semelhante nas costas de alguém mais velho. Ao fundir características de imagem com esses detalhes básicos antes de tomar uma decisão, o modelo imita a maneira como um dermatologista considera o contexto.

Tornando decisões que os médicos podem inspecionar

Uma barreira importante ao uso de inteligência artificial em clínicas é que muitos sistemas parecem caixas-pretas. Para contornar isso, o DermaScanAI inclui um módulo de explicabilidade. Usando uma técnica chamada Grad-CAM++, ele produz mapas de calor que destacam quais partes da lesão mais influenciaram sua decisão; outro método, SHAP, estima quanto cada peça de informação, incluindo os metadados do paciente, empurrou o resultado para um diagnóstico ou outro. Quando esses mapas de calor são sobrepostos às imagens originais e comparados com contornos de lesões desenhados por especialistas, mostram forte sobreposição, sugerindo que o sistema está focando em regiões de significado médico em vez de ruído aleatório.

Como o sistema se sai

Os pesquisadores testaram o DermaScanAI no HAM10000, uma grande coleção pública de mais de 10.000 imagens dermoscópicas cobrindo sete tipos de lesões cutâneas, incluindo melanoma, pintas comuns e várias condições benignas. Após treinamento e verificação cruzada cuidadosa com múltiplas divisões de dados, o modelo alcançou cerca de 94,8% de acurácia geral, uma pontuação F1 média macro próxima a 92% e uma área sob a curva ROC de 0,962, indicando forte capacidade de separar os tipos de lesão. Ele também manteve precisão razoável quando treinado com apenas uma fração dos dados e teve desempenho favorável em comparação com outros sistemas de ponta baseados exclusivamente em redes convolucionais ou transformers, usando menos recursos computacionais.

O que isso significa para futuros exames de pele

Em termos práticos, este trabalho demonstra que um modelo computacional bem projetado pode classificar diferentes tipos de lesões cutâneas com alta confiabilidade, usar informações simples do paciente para refinar seu julgamento e mostrar aos médicos exatamente onde está “olhando” na pele. O DermaScanAI ainda não é uma ferramenta diagnóstica autônoma: ele precisa de testes em diversos hospitais, câmeras e grupos de pacientes antes de apoiar decisões clínicas reais. Mas oferece um roteiro claro para futuros auxiliares no rastreamento do câncer de pele que sejam ao mesmo tempo precisos e transparentes, potencialmente ajudando médicos a detectar lesões perigosas mais cedo e dando a pacientes e clínicos mais confiança nas decisões tomadas.

Citação: Murali, P., Mazumder, D.H. DermaScanAI an explainable hybrid deep learning framework for automated skin lesion classification using dual attention and metadata fusion. Sci Rep 16, 15130 (2026). https://doi.org/10.1038/s41598-026-46011-0

Palavras-chave: câncer de pele, dermoscopia, deep learning, IA em imagem médica, IA explicável