Clear Sky Science · de

DermaScanAI ein erklärbares hybrides Deep-Learning‑Framework zur automatisierten Klassifikation von Hautläsionen mittels dualer Aufmerksamkeit und Metadatenfusion

Warum intelligentere Muttermal‑Checks wichtig sind

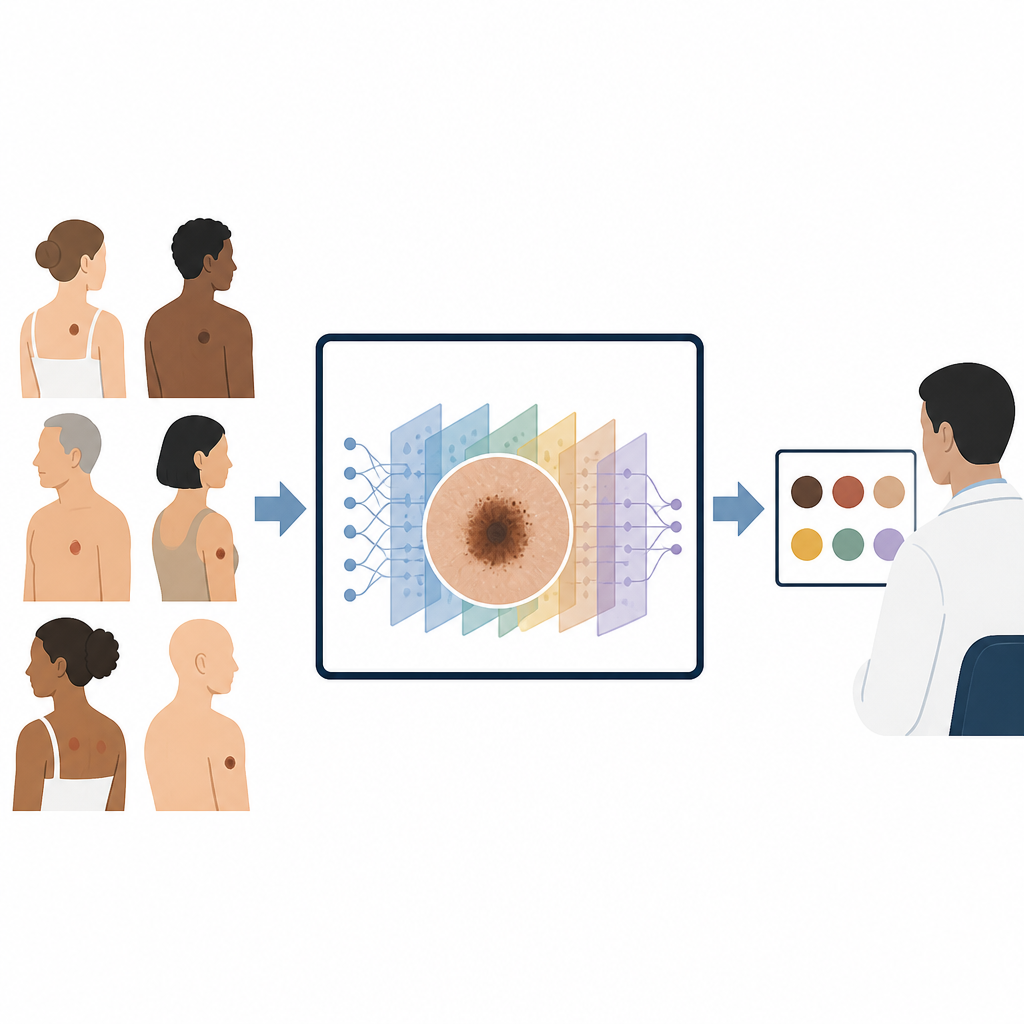

Hautkrebs gehört zu den häufigsten Krebsarten, und eine frühzeitige Erkennung kann Leben retten. Dennoch warten viele Menschen Monate oder Jahre, bevor sie ein verdächtiges Muttermal untersuchen lassen, und selbst erfahrene Ärztinnen und Ärzte tun sich bei schwierigen Fällen oft schwer. Diese Studie stellt DermaScanAI vor, ein Computersystem, das Ärzten dabei helfen soll, harmlose von gefährlichen Stellen zu trennen, indem es detaillierte Hautbilder und grundlegende Patientendaten auswertet und zugleich transparent zeigt, worauf es zur Entscheidungsfindung geachtet hat.

Computern beibringen, Hautbilder zu lesen

Dermatologen verwenden häufig ein handgehaltenes Gerät, das Dermatoskop, um Nahaufnahmen von Muttermalen und anderen Läsionen zu erstellen. Diese Bilder zeigen feine Farb‑ und Strukturmuster, die auf Krebs hindeuten können, sind aber auch voller Störeinflüsse wie Haare, ungleichmäßige Beleuchtung und kamerabedingte Unterschiede. DermaScanAI beginnt mit der Bildbereinigung: Haare werden digital entfernt, Helligkeit und Farben werden ausgeglichen und das Läsionsgebiet wird auf eine Standardgröße vergrößert. Anschließend erhöht das System die Datenmenge durch Spiegeln, Drehen und leichte Farbänderungen, sodass der Rechner viele realistische Varianten jeder Läsion sieht und besser mit der Varianz in der Praxis umgehen kann.

Sowohl feine Details als auch das Gesamtbild erfassen

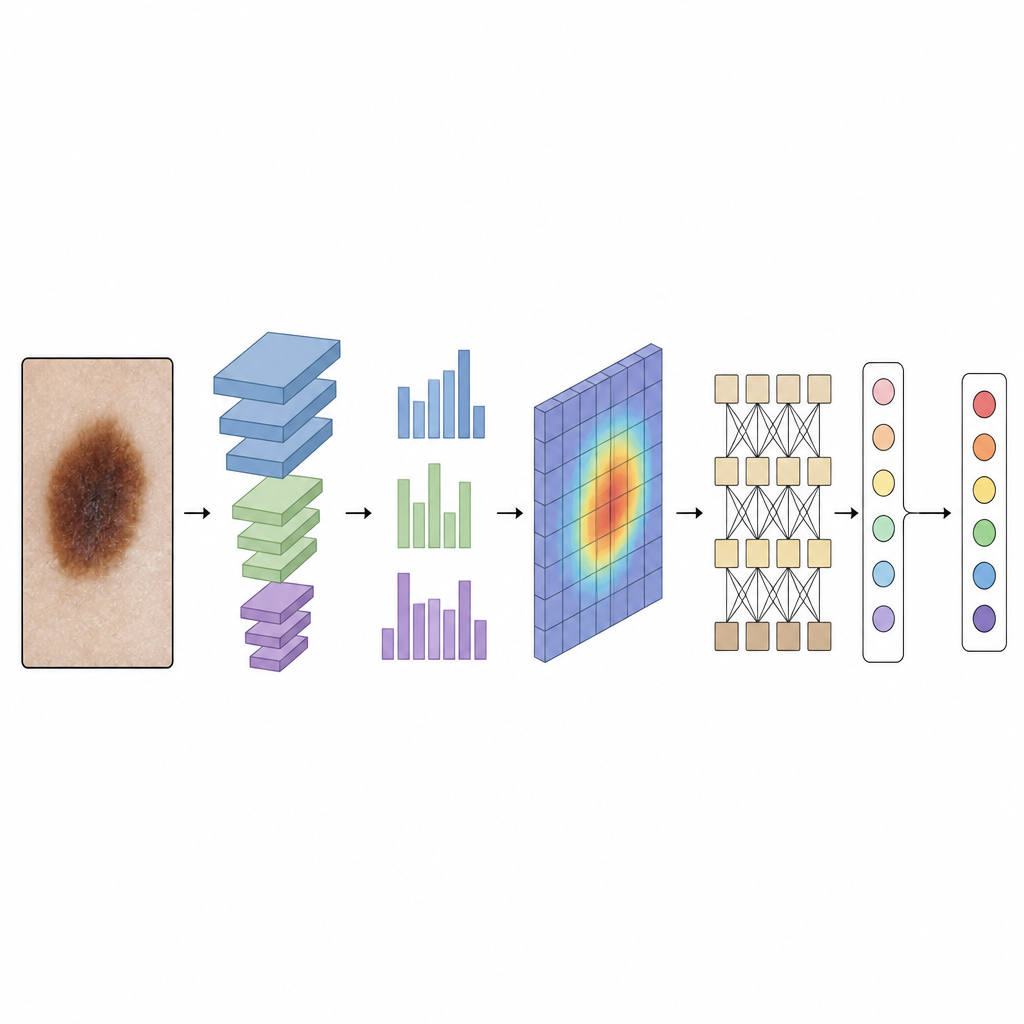

Viele frühere Computerwerkzeuge für Hautkrebs konzentrierten sich entweder nur auf lokale feine Muster oder nur auf die Gesamtform, was zu Verwechslungen führen kann, wenn sehr unterschiedliche Läsionen in Teilen ähnlich aussehen. DermaScanAI kombiniert zwei Arten der Mustererkennung, um dieses Problem zu vermeiden. Zunächst extrahiert ein moderner Faltungsnetzwerk‑Ansatz (Convolutional Network) feine Details wie Kanten, Farbflecken und Textur in mehreren Skalen, von winzigen Partien bis zu größeren Regionen. Zusätzlich helfen spezielle Attention‑Module dem System, die informativsten Farbkanäle und Bildbereiche „lauter zu stellen“ und unwichtige Hintergrundregionen zu dämpfen.

Globale Zusammenhänge und Patientenkontext hinzufügen

Nachdem die wichtigsten Bildbereiche hervorgehoben wurden, übergibt DermaScanAI die verfeinerten Merkmale an ein leichtgewichtiges Transformer‑Modul. Dieser Teil des Modells eignet sich besonders, um entfernte Bildbereiche miteinander zu verknüpfen, sodass etwa der Mittelpunkt eines Muttermals mit seinem Rand und der umliegenden Haut in Beziehung gesetzt werden kann. Gleichzeitig werden einfache Patientendaten wie Alter, Geschlecht und Körperstelle der Läsion eingebracht. Solche Hinweise spiegeln die klinische Praxis wider: Ein dunkler Fleck an einem jungen Bein kann ein anderes Risiko bedeuten als ein ähnlicher Fleck am Rücken einer älteren Person. Durch die Fusion von Bildmerkmalen mit diesen Basisdaten vor der Entscheidungsfindung ahmt das Modell nach, wie eine Dermatologin oder ein Dermatologe Kontext berücksichtigt.

Entscheidungen, die Ärzte nachvollziehen können

Ein großes Hindernis für den Einsatz von KI in Kliniken ist, dass viele Systeme wie Black Boxes wirken. Zur Adressierung dieses Problems enthält DermaScanAI ein Erklärbarkeitsmodul. Mittels Grad‑CAM++ erzeugt es Heatmaps, die hervorheben, welche Teile der Läsion die Entscheidung am stärksten beeinflusst haben; eine weitere Methode, SHAP, schätzt, wie stark einzelne Informationsbestandteile, einschließlich der Patientendaten, das Ergebnis in Richtung einer bestimmten Diagnose verschoben haben. Wenn diese Heatmaps über die Originalbilder gelegt und mit Expertenumrissen der Läsion verglichen werden, zeigen sie eine starke Überschneidung, was darauf hindeutet, dass das System sich auf medizinisch bedeutsame Regionen konzentriert und nicht auf zufälliges Rauschen.

Wie gut das System abschneidet

Die Forschenden testeten DermaScanAI an HAM10000, einer großen öffentlichen Sammlung mit mehr als 10.000 dermoskopischen Bildern, die sieben Arten von Hautläsionen abdecken, darunter Melanom, gewöhnliche Muttermale und mehrere gutartige Zustände. Nach dem Training und sorgfältiger Kreuzvalidierung mit mehreren Datenaufteilungen erreichte das Modell eine Gesamtgenauigkeit von etwa 94,8 %, eine makro‑durchschnittliche F1‑Score nahe 92 % und eine Fläche unter der ROC‑Kurve von 0,962, was auf eine hohe Fähigkeit zur Unterscheidung der Läsionsarten hinweist. Es blieb auch bei Training mit nur einem Teil der Daten relativ genau und schnitt im Vergleich zu anderen führenden Systemen, die rein auf Faltungsnetzwerken oder Transformern basieren, vorteilhaft ab, während es weniger Rechenressourcen benötigte.

Was das für künftige Hautuntersuchungen bedeutet

Einfach gesagt zeigt diese Arbeit, dass ein sorgfältig gestaltetes Computermodell verschiedene Arten von Hautläsionen mit hoher Zuverlässigkeit sortieren, einfache Patientendaten zur Verfeinerung seiner Einschätzung nutzen und Ärzten zeigen kann, wo genau es auf der Haut „hinguckt“. DermaScanAI ist noch kein eigenständiges Diagnosewerkzeug: Es muss noch an vielen Kliniken, mit verschiedenen Kameras und Patientengruppen geprüft werden, bevor es klinische Entscheidungen unterstützen kann. Dennoch bietet es eine klare Blaupause für künftige Hilfen bei der Hautkrebsdiagnostik, die sowohl genau als auch transparent sind und Ärzten helfen könnten, gefährliche Läsionen früher zu erkennen, während Patientinnen, Patienten und Kliniker mehr Vertrauen in die Entscheidungsgründe gewinnen.

Zitation: Murali, P., Mazumder, D.H. DermaScanAI an explainable hybrid deep learning framework for automated skin lesion classification using dual attention and metadata fusion. Sci Rep 16, 15130 (2026). https://doi.org/10.1038/s41598-026-46011-0

Schlüsselwörter: Hautkrebs, Dermatoskopie, Deep Learning, medizinische Bildgebungs‑KI, erklärbare KI