Clear Sky Science · fr

DermaScanAI, un cadre hybride d'apprentissage profond explicable pour la classification automatisée des lésions cutanées utilisant double attention et fusion de métadonnées

Pourquoi des examens de grains de beauté plus intelligents comptent

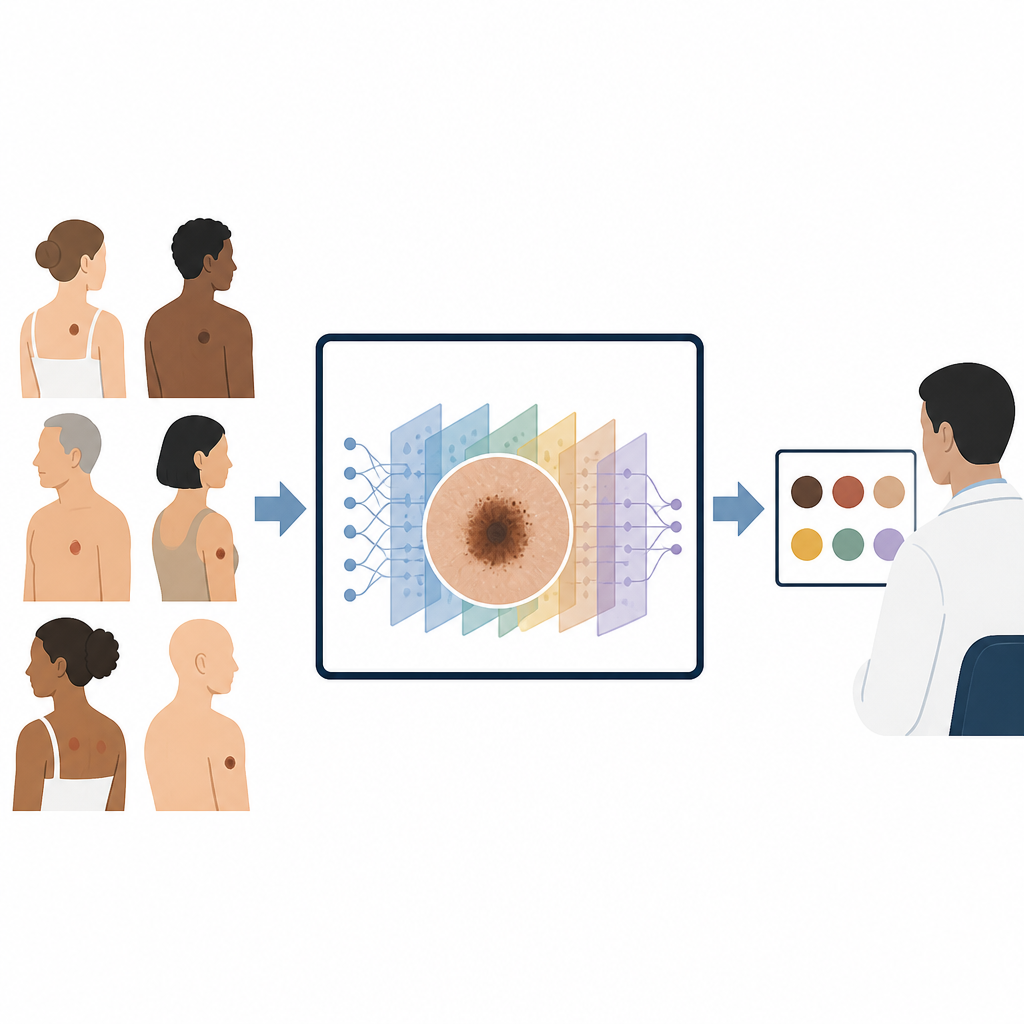

Le cancer de la peau est l’un des cancers les plus fréquents, et le détecter tôt peut sauver des vies. Pourtant, de nombreuses personnes attendent des mois, voire des années, avant de faire examiner un grain de beauté suspect, et même des médecins expérimentés peuvent avoir du mal à juger des cas délicats. Cette étude présente DermaScanAI, un système informatique conçu pour aider les médecins à distinguer les taches bénignes des taches dangereuses en analysant des images détaillées de la peau et des informations de base sur le patient, tout en montrant clairement ce qu’il « a regardé » pour parvenir à sa décision.

Apprendre aux ordinateurs à lire les images de peau

Les dermatologues utilisent souvent un appareil portatif appelé dermoscope pour capturer des images rapprochées de grains de beauté et d’autres taches. Ces images révèlent de minuscules motifs de couleur et de texture qui peuvent suggérer un cancer, mais elles contiennent aussi de nombreuses distractions comme des poils, un éclairage inégal et des différences d’appareil photo. DermaScanAI commence par nettoyer les images : il supprime numériquement les poils, égalise la luminosité et les couleurs, et recadre la zone de la lésion pour l’amener à une taille standard. Le système augmente ensuite les données en effectuant des retournements, des rotations et de légères modifications de couleur afin que l’ordinateur voie de nombreuses variations réalistes de chaque lésion, ce qui l’aide à mieux gérer la variété du monde réel.

Voir à la fois les détails fins et la vue d’ensemble

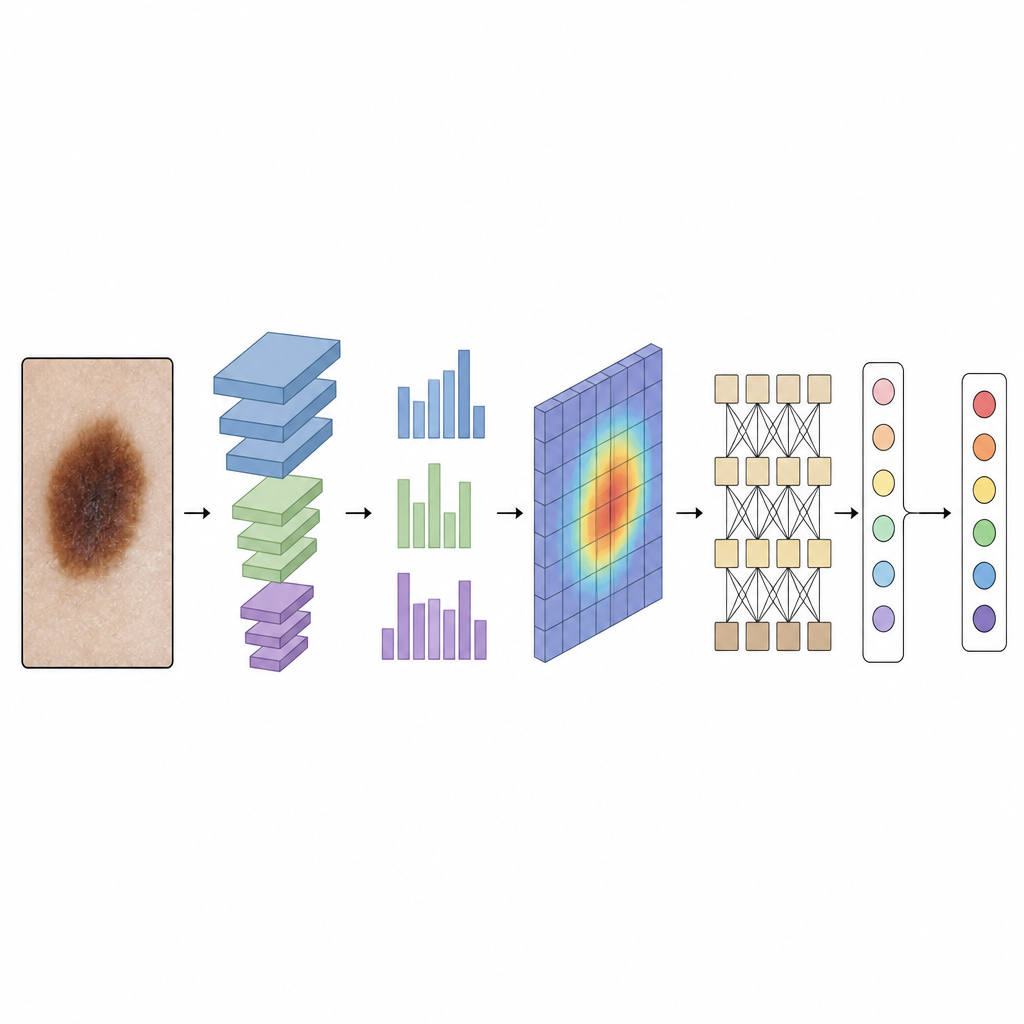

Beaux outils informatiques passés pour le cancer de la peau se concentraient soit sur de petits motifs locaux, soit uniquement sur la forme générale, ce qui peut provoquer des confusions lorsque des lésions très différentes se ressemblent par endroits. DermaScanAI combine deux types de reconnaissance de motifs pour éviter ce problème. D’abord, un réseau convolutionnel moderne, un type de moteur de traitement d’image, extrait des détails fins comme les contours, les points de couleur et la texture à plusieurs échelles, depuis de petits patchs jusqu’à des régions plus larges. Par-dessus cela, des modules d’attention spéciaux permettent au système de « monter le volume » sur les canaux de couleur et les zones d’image les plus informatifs, tout en atténuant les régions de fond peu utiles.

Ajouter le contexte global et des indices patients

Après s’être focalisé sur les régions d’image les plus importantes, DermaScanAI transmet les caractéristiques affinées à un module transformeur léger. Cette partie du modèle est efficace pour relier des parties éloignées de l’image, de sorte qu’elle peut mettre en relation le centre d’un grain de beauté avec sa bordure et la peau environnante. En parallèle, le système intègre des informations simples sur le patient, telles que l’âge, le sexe et l’emplacement corporel de la lésion. Ces indices reflètent la pratique clinique réelle, où une tache sombre sur la jambe d’un jeune peut présenter un risque différent d’une tache similaire sur le dos d’une personne âgée. En fusionnant les caractéristiques d’image avec ces détails élémentaires avant de prendre une décision, le modèle imite la façon dont un dermatologue prend en compte le contexte.

Prendre des décisions que les médecins peuvent examiner

Un obstacle majeur à l’utilisation de l’intelligence artificielle en clinique est que beaucoup de systèmes ressemblent à des boîtes noires. Pour y remédier, DermaScanAI inclut un module d’explicabilité. En utilisant une technique appelée Grad-CAM++, il produit des cartes de chaleur qui mettent en évidence les parties de la lésion ayant le plus influencé sa décision ; une autre méthode, SHAP, estime dans quelle mesure chaque information, y compris les métadonnées patient, a poussé le résultat vers tel ou tel diagnostic. Lorsque ces cartes de chaleur sont superposées aux images originales et comparées aux contours de lésion tracés par des experts, elles montrent un fort recoupement, ce qui suggère que le système se concentre sur des régions médicalement pertinentes plutôt que sur du bruit aléatoire.

Performances du système

Les chercheurs ont testé DermaScanAI sur HAM10000, une large collection publique de plus de 10 000 images dermoscopiques couvrant sept types de lésions cutanées, notamment le mélanome, les grains de beauté communs et plusieurs conditions bénignes. Après entraînement et validations croisées soignées avec plusieurs découpes de données, le modèle a atteint environ 94,8 % de précision globale, un score F1 macro-moyen proche de 92 % et une aire sous la courbe ROC de 0,962, indiquant une forte capacité à séparer les types de lésions. Il est également resté raisonnablement précis lorsqu’il a été entraîné sur une fraction seulement des données, et il s’est montré favorablement comparable à d’autres systèmes de pointe basés uniquement sur des réseaux convolutionnels ou des transformeurs tout en utilisant moins de ressources informatiques.

Ce que cela signifie pour les futurs examens cutanés

En termes simples, ce travail montre qu’un modèle informatique soigneusement conçu peut trier différents types de lésions cutanées avec une grande fiabilité, utiliser de simples informations patient pour affiner son jugement et montrer aux médecins précisément où il « regarde » sur la peau. DermaScanAI n’est pas encore un outil de diagnostic autonome : il doit encore être testé dans de nombreux hôpitaux, avec divers appareils photo et groupes de patients avant d’être utilisé pour appuyer des décisions cliniques réelles. Mais il offre une feuille de route claire pour de futurs assistants contre le cancer de la peau qui seraient à la fois précis et transparents, aidant potentiellement les médecins à détecter plus tôt les lésions dangereuses tout en donnant aux patients et aux cliniciens plus de confiance dans la manière dont ces décisions sont prises.

Citation: Murali, P., Mazumder, D.H. DermaScanAI an explainable hybrid deep learning framework for automated skin lesion classification using dual attention and metadata fusion. Sci Rep 16, 15130 (2026). https://doi.org/10.1038/s41598-026-46011-0

Mots-clés: cancer de la peau, dermoscopie, apprentissage profond, IA pour l’imagerie médicale, IA explicable