Clear Sky Science · pt

Estrutura FMCW de baixa complexidade para reconhecimento de atividades humanas em condições de dados limitados

Observando a vida diária sem uma câmera

Imagine uma casa que pode perceber discretamente se um idoso caiu ou se alguém parou de se mover por um tempo incomum—sem câmeras, microfones ou dispositivos vestíveis. Este artigo apresenta uma nova maneira de usar pequenos sensores de radar e inteligência artificial eficiente para reconhecer atividades humanas cotidianas em um ambiente semelhante a um quarto, mesmo quando há apenas uma pequena quantidade de dados de treinamento disponível. O objetivo é construir sistemas de monitoramento práticos que preservem a privacidade e que, eventualmente, possam ser executados em dispositivos de baixo custo em residências reais, hospitais e centros de cuidado.

Por que radar em vez de câmeras ou vestíveis?

Muitos sistemas atuais de monitoramento de atividades dependem de dispositivos vestíveis, como smartwatches, ou de câmeras de vídeo colocadas ao redor do cômodo. Vestíveis podem ser desconfortáveis, precisam de recarga e frequentemente são esquecidos ou removidos, especialmente durante o sono ou o banho. Câmeras levantam preocupações óbvias de privacidade e podem falhar em condições de pouca luz ou quando a pessoa está atrás de móveis. O radar oferece uma opção diferente: ele emite ondas de rádio e mede suas reflexões para inferir movimento e posição. O radar de ondas milimétricas pode funcionar no escuro, através de alguns obstáculos e sem revelar a aparência da pessoa, tornando-se uma tecnologia atraente para monitoramento contínuo e respeitoso da vida cotidiana.

Transformando ondas invisíveis em padrões úteis

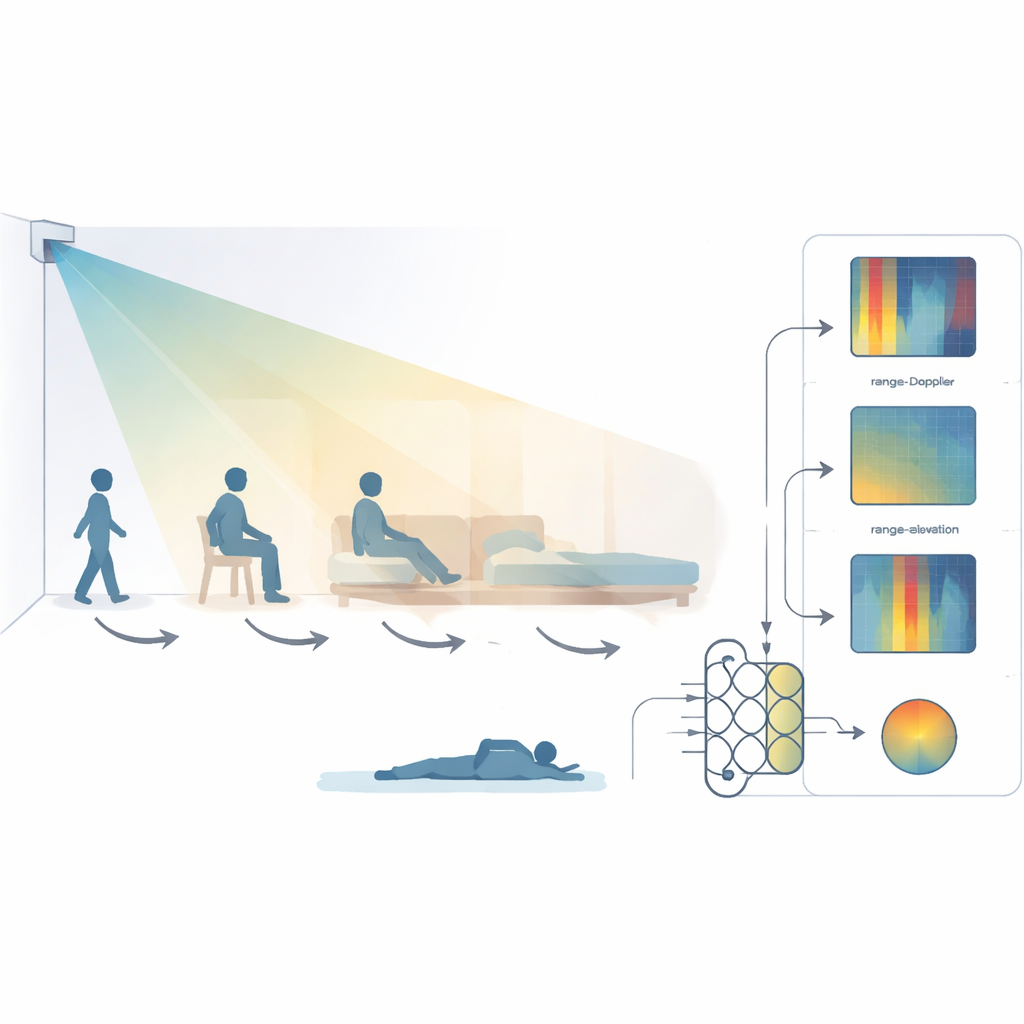

Os pesquisadores usaram um sensor de radar compacto de 60 GHz montado no alto de um cômodo semelhante a um quarto, inclinado para cobrir uma cama, uma cadeira e o chão. Três voluntários participaram de 16 sessões de gravação, realizando sete categorias de atividades: o cômodo vazio, caminhar, sentar na cama, sentar na cadeira, deitar na cama, deitar no chão e transições entre esses estados. Em vez de converter os sinais de radar em imagens, como muitos estudos anteriores fazem, a equipe manteve os dados em uma forma que reflete diretamente grandezas físicas: distância até o radar, velocidade de movimento e direção a partir de diferentes ângulos. A partir de cada quadro de radar, extraíram três tipos de mapas de características—range–Doppler (movimento versus distância), range–azimuth (ângulo horizontal) e range–elevation (ângulo vertical)—e os empilharam em vetores multidimensionais compactos que preservam como o corpo da pessoa se move no espaço ao longo do tempo.

Inteligência leve para dispositivos pequenos

Para interpretar esses padrões de radar, os autores construíram um modelo de aprendizado profundo deliberadamente pequeno e eficiente. Ele combina uma versão simplificada de uma rede popular de reconhecimento de imagens (ResNet-18) com um módulo bidirecional de memória de curto e longo prazo (LSTM), que é um tipo de rede neural recorrente. Convoluções especializadas "depthwise separable" reduzem muito o número de cálculos e parâmetros enquanto ainda capturam detalhes espaciais importantes, e a parte recorrente aprende como as atividades se desenvolvem ao longo de janelas de tempo curtas de meio segundo. Para tornar o sistema mais robusto apesar de dispor de dados de apenas três pessoas, a equipe aplicou aumentos de dados realistas: deslocar ligeiramente a posição ou a velocidade aparentes, escalar e enviesar a intensidade do sinal, inverter a direção do movimento e adicionar ruído suave—imitando como lares reais e pessoas reais variam de um momento para outro.

Quão bem ele reconhece ações cotidianas?

A estrutura foi testada usando duas estratégias de avaliação rigorosas. No teste cross-scene, o modelo foi treinado na maior parte das sessões gravadas e testado em cenários que nunca havia visto antes. No teste leave-one-person-out, foi treinado com dois participantes e testado integralmente no terceiro, avaliando o quão bem generaliza para indivíduos novos. Em uma tarefa desafiadora de sete atividades, o sistema alcançou cerca de 92% de acurácia e quase 90% de F1-score quando cenas foram mantidas fora do treinamento, e cerca de 90% de acurácia em pessoas não vistas. Quando a tarefa foi simplificada para quatro atividades principais—caminhar, sentar na cama, sentar na cadeira e deitar na cama—a acurácia subiu para cerca de 99% nos testes cross-scene. Notavelmente, esse desempenho igualou ou superou redes neurais maiores e mais exigentes computacionalmente, enquanto usava menos de um milhão de parâmetros e um tamanho de modelo reduzido de menos de 7 megabytes.

O que isso pode significar para casas inteligentes futuras

Em termos simples, o estudo mostra que uma pequena unidade de radar e um modelo de IA compacto podem distinguir de forma confiável atividades internas comuns, mesmo com dados de treinamento limitados e sem invadir a privacidade. Ao trabalhar diretamente com características de radar fisicamente significativas e truques de aumento de dados cuidadosamente escolhidos, os autores alcançam precisão e eficiência, tornando sua abordagem adequada para hardware embarcado na borda em vez de servidores volumosos na nuvem. À medida que conjuntos de dados forem ampliados para incluir mais pessoas e comportamentos, esse tipo de monitoramento baseado em radar poderia sustentar futuros quartos inteligentes, quartos de hospital e espaços de vida assistida que observam discretamente a segurança e o bem-estar, respeitando a dignidade e a privacidade das pessoas que atendem.

Citação: Fard, A.S., Mashhadigholamali, M., Zolfaghari, S. et al. Lightweight FMCW radar framework for human activity recognition under limited data conditions. Sci Rep 16, 9650 (2026). https://doi.org/10.1038/s41598-026-44815-8

Palavras-chave: reconhecimento de atividades baseado em radar, radar FMCW de ondas milimétricas, monitoramento residencial inteligente, aprendizado profundo leve, vida assistida por ambiente