Clear Sky Science · de

Leichtgewichtiges FMCW-Radar-Framework zur Erkennung menschlicher Aktivitäten bei begrenzten Daten

Den Alltag beobachten ohne Kamera

Stellen Sie sich ein Zuhause vor, das unauffällig bemerkt, ob eine ältere Person gestürzt ist oder sich ungewöhnlich lange nicht bewegt hat – ganz ohne Kameras, Mikrofone oder Wearables. Dieses Papier stellt einen neuen Ansatz vor, kleine Radarsensoren und effiziente künstliche Intelligenz zu nutzen, um alltägliche menschliche Aktivitäten in einer schlafzimmerähnlichen Umgebung zu erkennen, selbst wenn nur wenig Trainingsdaten zur Verfügung stehen. Ziel ist es, praktische, datenschutzfreundliche Überwachungssysteme zu entwickeln, die schließlich auf kostengünstigen Geräten in echten Wohnungen, Krankenhäusern und Pflegeeinrichtungen laufen können.

Warum Radar statt Kameras oder Wearables?

Viele aktuelle Aktivitätsüberwachungssysteme setzen auf Wearables wie Smartwatches oder auf Kameras im Raum. Wearables können unbequem sein, müssen geladen werden und werden oft vergessen oder abgelegt, besonders beim Schlafen oder Duschen. Kameras werfen offensichtliche Datenschutzfragen auf und können bei schlechten Lichtverhältnissen oder wenn sich eine Person hinter Möbeln befindet versagen. Radar bietet eine Alternative: Es sendet Radiowellen aus und misst deren Reflexionen, um Bewegung und Position zu erschließen. Millimeterwellenradar funktioniert im Dunkeln, durch gewisse Hindernisse und ohne das Aussehen einer Person preiszugeben, was es zu einer attraktiven Technologie für respektvolle, kontinuierliche Überwachung des Alltags macht.

Unsichtbare Wellen in sinnvolle Muster verwandeln

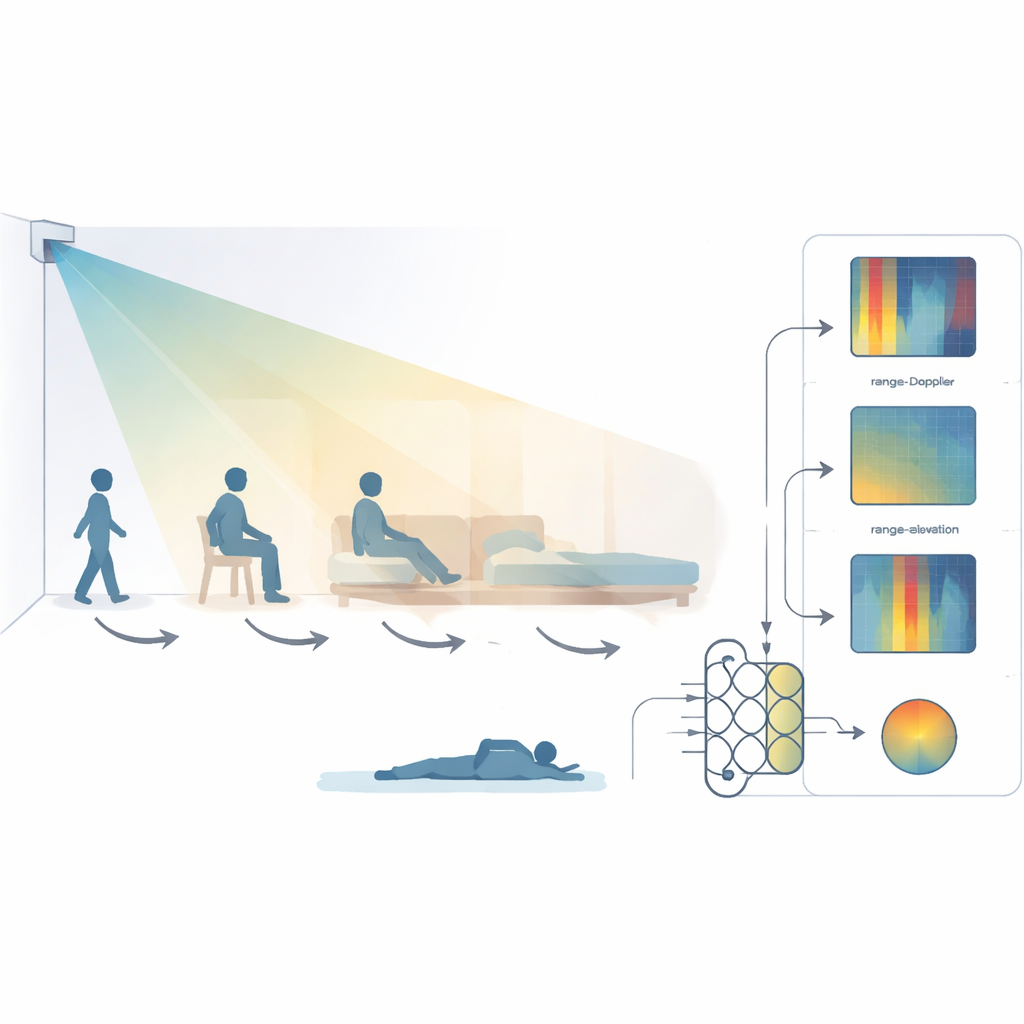

Die Forschenden nutzten einen kompakten 60-GHz-Radarsensor, der hoch in einem schlafzimmerähnlichen Raum montiert und nach unten geneigt war, um Bett, Stuhl und Boden abzudecken. Drei Versuchspersonen nahmen an 16 Aufnahmesitzungen teil und führten sieben Aktivitätskategorien aus: Raum leer, Gehen, Sitzen auf dem Bett, Sitzen auf dem Stuhl, Liegen auf dem Bett, Liegen auf dem Boden und Übergänge zwischen diesen Zuständen. Anstatt die Radarsignale in Bilder zu verwandeln, wie viele frühere Studien, behielt das Team die Daten in einer Form bei, die physikalische Größen direkt widerspiegelt: Entfernung zum Radar, Bewegungsgeschwindigkeit und Richtung aus verschiedenen Winkeln. Aus jedem Radarframe extrahierten sie drei Arten von Merkmalen – Range–Doppler (Bewegung versus Entfernung), Range–Azimut (horizontaler Winkel) und Range–Elevation (vertikaler Winkel) – und stapelten sie zu kompakten mehrdimensionalen Vektoren, die bewahren, wie sich der Körper einer Person räumlich über die Zeit bewegt.

Leichtgewichtige Intelligenz für kleine Geräte

Um diese Radarmuster zu lesen, bauten die Autoren ein Deep-Learning-Modell, das bewusst klein und effizient gestaltet ist. Es kombiniert eine gestraffte Version eines verbreiteten Bilderkennungsnetzwerks (ResNet-18) mit einem bidirektionalen LSTM-Modul, einer Form rekurrenter neuronaler Netze. Spezialisierte „depthwise separable“-Faltungen reduzieren die Anzahl der Berechnungen und Parameter deutlich, erfassen dabei aber weiterhin wichtige räumliche Details; der rekurrente Teil lernt, wie sich Aktivitäten in kurzen Zeitfenstern von einer halben Sekunde entfalten. Um das System trotz Daten von nur drei Personen robuster zu machen, setzte das Team realistische Datenaugmentierungen ein: leichte Verschiebung der scheinbaren Position oder Geschwindigkeit, Skalierung und Verschiebung der Signalstärke, Umkehr der Bewegungsrichtung und Zugabe sanften Rauschens – was Variation in echten Haushalten und bei echten Personen nachahmt.

Wie gut erkennt es alltägliche Aktionen?

Das Framework wurde mit zwei strengen Evaluationsstrategien getestet. Beim Cross-Scene-Test wurde das Modell auf den meisten aufgenommenen Sitzungen trainiert und in Szenen getestet, die es zuvor nicht gesehen hatte. Beim Leave-One-Person-Out-Test wurde auf zwei Personen trainiert und vollständig an der dritten getestet, um die Generalisierbarkeit auf neue Individuen zu prüfen. Bei der anspruchsvollen Aufgabe mit sieben Aktivitäten erreichte das System etwa 92 % Genauigkeit und knapp 90 % F1-Score, wenn Szenen ausgespart wurden, und etwa 90 % Genauigkeit bei unbekannten Personen. Wurde die Aufgabe auf vier Kernaktivitäten – Gehen, Sitzen auf dem Bett, Sitzen auf dem Stuhl und Liegen auf dem Bett – vereinfacht, stieg die Genauigkeit in Cross-Scene-Tests auf rund 99 %. Bemerkenswert ist, dass diese Leistung mit oder über der größerer, rechenintensiverer neuronaler Netze lag, dabei unter einer Million Parametern blieb und eine Modellgröße von unter 7 Megabyte aufwies.

Was das für zukünftige Smart Homes bedeuten könnte

Kurz gesagt zeigt die Studie, dass eine kleine Radareinheit und ein kompaktes KI-Modell häufige Innenraumaktivitäten zuverlässig unterscheiden können, selbst mit begrenzten Trainingsdaten und ohne die Privatsphäre zu verletzen. Indem sie direkt mit physikalisch aussagekräftigen Radarmerkmalen arbeiten und sorgfältig gewählte Augmentierungsmaßnahmen einsetzen, erreichen die Autoren sowohl Genauigkeit als auch Effizienz, wodurch ihr Ansatz für eingebettete Hardware am Edge geeignet ist und nicht für sperrige Server in der Cloud. Mit größeren Datensätzen, die mehr Personen und Verhaltensweisen abdecken, könnte eine solche radarbasierte Überwachung die Grundlage für künftige smarte Schlafzimmer, Krankenhauszimmer und betreute Wohnräume bilden, die Sicherheits- und Wohlbefindensüberwachung leise sicherstellen und gleichzeitig Würde und Privatsphäre der betreuten Personen respektieren.

Zitation: Fard, A.S., Mashhadigholamali, M., Zolfaghari, S. et al. Lightweight FMCW radar framework for human activity recognition under limited data conditions. Sci Rep 16, 9650 (2026). https://doi.org/10.1038/s41598-026-44815-8

Schlüsselwörter: radarbasierte Aktivitätserkennung, FMCW-Millimeterwellenradar, Smart-Home-Überwachung, leichtgewichtige Deep-Learning-Modelle, Ambient Assisted Living