Clear Sky Science · pl

Lekka ramowa metoda radarowa FMCW do rozpoznawania aktywności człowieka przy ograniczonych danych

Obserwowanie codziennego życia bez kamery

Wyobraź sobie dom, który potrafi dyskretnie wykryć, czy osoba starsza upadła albo czy ktoś przestał się poruszać na nietypowo długi czas — bez kamer, mikrofonów czy urządzeń do noszenia. W artykule przedstawiono nowy sposób wykorzystania małych czujników radarowych i efektywnej sztucznej inteligencji do rozpoznawania codziennych czynności w warunkach przypominających sypialnię, nawet przy niewielkiej ilości danych treningowych. Celem jest zbudowanie praktycznych, chroniących prywatność systemów monitorowania, które ostatecznie mogłyby działać na tanich urządzeniach w prawdziwych domach, szpitalach i placówkach opiekuńczych.

Dlaczego radar zamiast kamer czy urządzeń noszonych?

Wiele obecnych systemów monitorowania aktywności opiera się na urządzeniach noszonych, takich jak smartwatche, lub na kamerach w pomieszczeniu. Urządzenia noszone mogą być niewygodne, wymagają ładowania i często są zapominane lub zdejmowane, szczególnie podczas snu czy kąpieli. Kamery budzą oczywiste obawy o prywatność i zawodzą przy słabym oświetleniu lub gdy osoba jest zasłonięta meblami. Radar oferuje inną opcję: wysyła fale radiowe i mierzy ich odbicia, by wywnioskować ruch i pozycję. Radary milimetrowe działają w ciemności, przenikają przez niektóre przeszkody i nie ujawniają wyglądu osoby, co czyni je atrakcyjną technologią do dyskretnego, ciągłego monitorowania codziennego życia z poszanowaniem prywatności.

Przekształcanie niewidzialnych fal w użyteczne wzorce

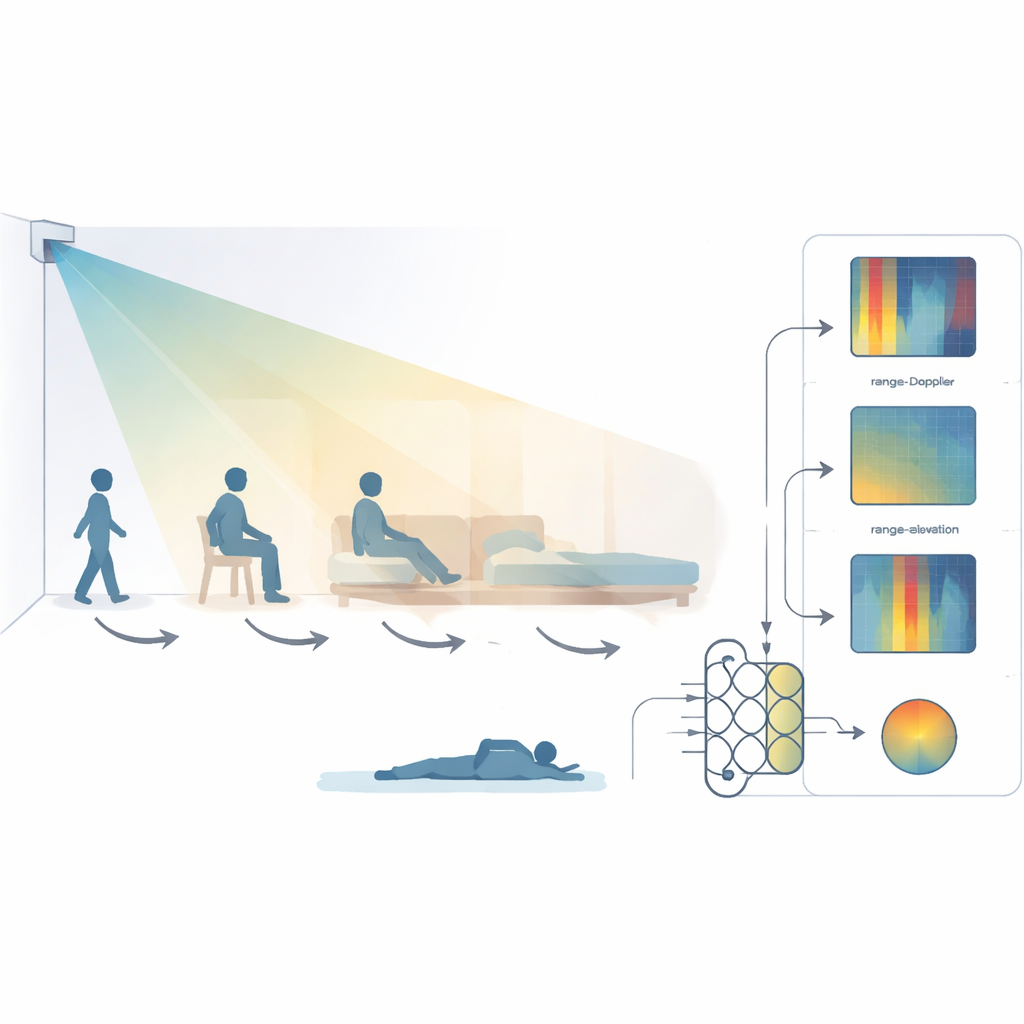

Badacze użyli kompaktowego czujnika radarowego 60 GHz umieszczonego wysoko w pomieszczeniu przypominającym sypialnię, nachylonego w dół tak, by obejmował łóżko, krzesło i podłogę. Trzy osoby wzięły udział w 16 sesjach nagraniowych, wykonując siedem kategorii aktywności: pomieszczenie puste, chodzenie, siedzenie na łóżku, siedzenie na krześle, leżenie na łóżku, leżenie na podłodze oraz przejścia między tymi stanami. Zamiast zamieniać sygnały radarowe w obrazy, jak czynią to wcześniejsze prace, zespół zachował dane w postaci odzwierciedlającej bezpośrednio wielkości fizyczne: odległość od radaru, prędkość ruchu i kierunek z różnych kątów. Z każdej ramki radarowej wyodrębnili trzy rodzaje map cech — range–Doppler (ruch względem odległości), range–azimuth (kąt poziomy) i range–elevation (kąt pionowy) — i ułożyli je w zwarte wielowymiarowe wektory, które zachowują sposób, w jaki ciało porusza się w przestrzeni w czasie.

Lekka inteligencja dla małych urządzeń

Aby odczytywać te wzorce radarowe, autorzy zbudowali model głębokiego uczenia, który jest celowo mały i wydajny. Łączy uproszczoną wersję popularnej sieci do rozpoznawania obrazów (ResNet-18) z dwukierunkową pamięcią długotrwałą typu LSTM, będącą rodzajem rekurencyjnej sieci neuronowej. Specjalizowane konwolucje „depthwise separable” znacznie zmniejszają liczbę obliczeń i parametrów, zachowując przy tym istotne szczegóły przestrzenne, a część rekurencyjna uczy się, jak aktywności przebiegają w krótkich okienkach czasowych trwających pół sekundy. Aby system był bardziej odporny mimo danych pochodzących jedynie od trzech osób, zespół zastosował realistyczną augmentację danych: przesunięcie pozornej pozycji lub prędkości, skalowanie i przesunięcie intensywności sygnału, odwracanie kierunku ruchu oraz dodanie delikatnego szumu — co naśladuje, jak prawdziwe domy i ludzie różnią się z chwili na chwilę.

Jak dobrze rozpoznaje codzienne działania?

Ramę przetestowano przy użyciu dwóch surowych strategii oceny. W testach cross-scene model trenowano na większości sesji nagraniowych i testowano na scenach, których wcześniej nie widział. W testach leave-one-person-out trenowano na dwóch osobach i testowano w całości na trzeciej, sprawdzając, jak dobrze model uogólnia się na nowe osoby. W wymagającym zadaniu obejmującym siedem aktywności system osiągnął około 92% dokładności i niemal 90% miary F1 przy trzymaniu scen poza zbiorem treningowym oraz około 90% dokładności na nieznanych osobach. Gdy zadanie uproszczono do czterech podstawowych aktywności — chodzenie, siedzenie na łóżku, siedzenie na krześle i leżenie na łóżku — dokładność wzrosła do około 99% w testach cross-scene. Co istotne, wydajność ta dorównywała lub przewyższała większe, bardziej wymagające obliczeniowo sieci neuronowe, przy użyciu mniej niż miliona parametrów i niewielkiego rozmiaru modelu poniżej 7 megabajtów.

Co to może znaczyć dla przyszłych inteligentnych domów

Mówiąc prosto, badanie pokazuje, że mała jednostka radarowa i zwarty model AI potrafią wiarygodnie rozróżniać typowe czynności domowe, nawet przy ograniczonych danych treningowych i bez naruszania prywatności. Pracując bezpośrednio z fizycznie znaczącymi cechami radarowymi i stosując starannie dobrane techniki augmentacji, autorzy osiągają zarówno dokładność, jak i efektywność, co czyni ich podejście odpowiednim dla wbudowanego sprzętu brzegowego, zamiast korzystania z ciężkich serwerów w chmurze. W miarę rozszerzania zestawów danych o więcej osób i zachowań, tego typu monitorowanie oparte na radarze mogłoby stanowić podstawę przyszłych inteligentnych sypialni, sal szpitalnych i przestrzeni wspomaganego życia, które dyskretnie dbają o bezpieczeństwo i dobre samopoczucie, szanując przy tym godność i prywatność użytkowników.

Cytowanie: Fard, A.S., Mashhadigholamali, M., Zolfaghari, S. et al. Lightweight FMCW radar framework for human activity recognition under limited data conditions. Sci Rep 16, 9650 (2026). https://doi.org/10.1038/s41598-026-44815-8

Słowa kluczowe: rozpoznawanie aktywności na podstawie radaru, radar FMCW w paśmie milimetrowym, monitorowanie inteligentnego domu, lekka głęboka sieć neuronowa, wsparcie życia w środowisku codziennym