Clear Sky Science · pt

As características mais importantes em modelos aditivos generalizados podem ser grupos de características

Por que grupos podem importar mais do que pistas isoladas

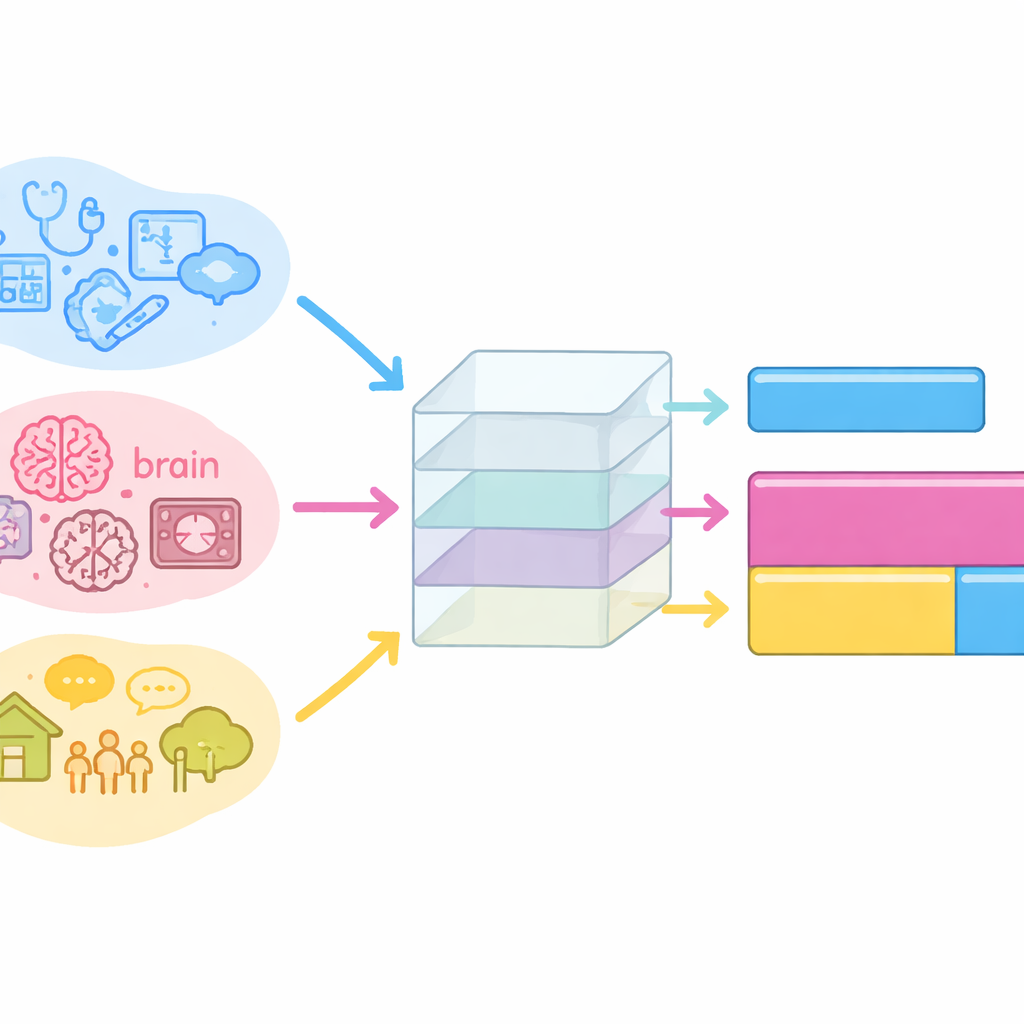

Modelos preditivos modernos frequentemente vasculham centenas de medidas, de exames cerebrais a estatísticas de bairros, para prever desfechos de saúde. Normalmente perguntamos qual fator isolado importa mais: idade, um exame laboratorial ou talvez uma região cerebral. Este artigo argumenta que essa perspectiva é estreita demais. Em muitos problemas médicos reais, o que realmente impulsiona as previsões é o sinal combinado de grupos de características relacionadas, não qualquer característica isolada. Os autores propõem uma maneira rápida de medir quão importantes esses grupos são em uma classe amplamente usada de modelos transparentes, e mostram que essa perspectiva de grupo revela insights médicos que, de outra forma, seriam perdidos.

Olhando além de fatores de risco isolados

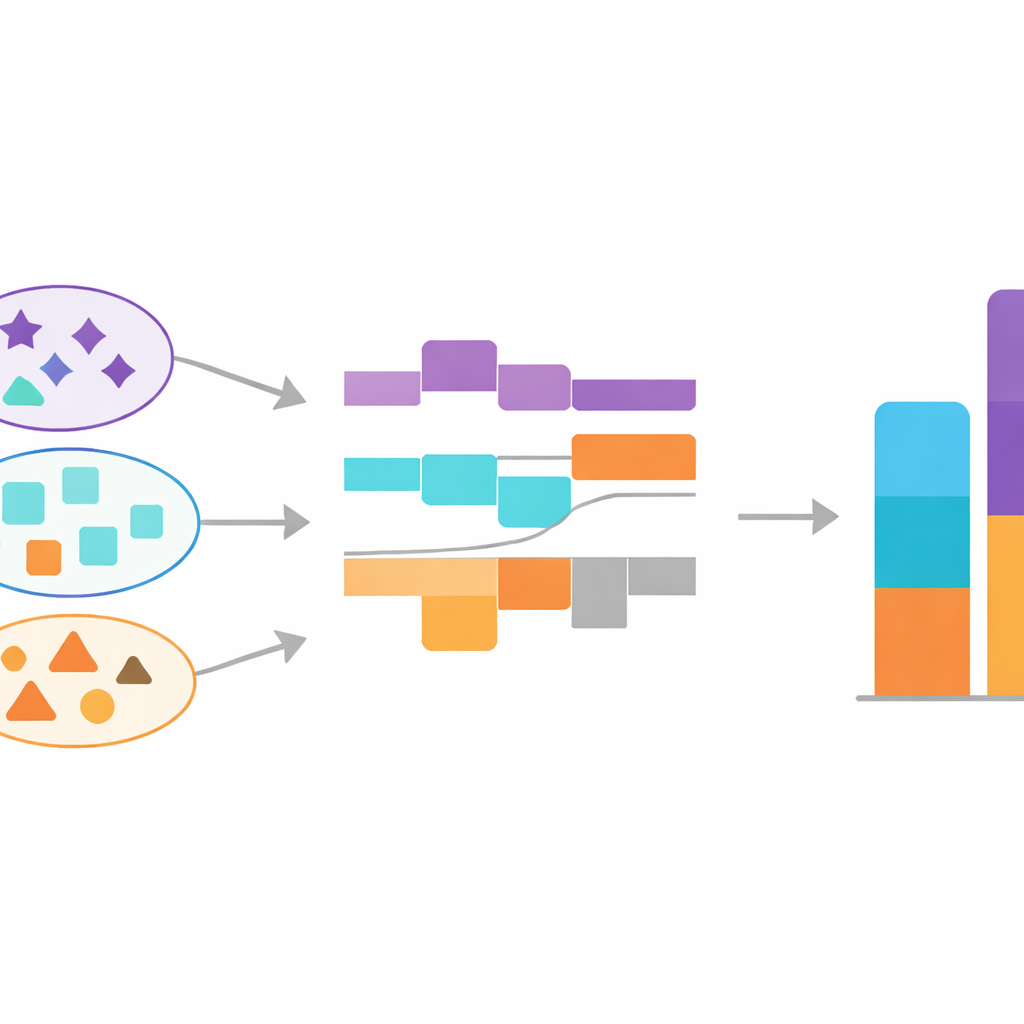

A maioria das ferramentas de interpretabilidade hoje classifica características individuais pelo quanto influenciam as previsões de um modelo. Isso funciona razoavelmente bem quando as características são independentes. Mas em dados de saúde, muitas variáveis se movem juntas: experiências traumáticas se aglomeram, redes cerebrais coativam e condições sociais coocorrem. Quando as características são altamente correlacionadas, um modelo costuma espalhar o sinal entre elas, atribuindo a cada uma uma pontuação modesta mesmo que, juntas, carreguem forte poder preditivo. Focar apenas em fatores isolados pode, portanto, ocultar os verdadeiros motores do risco ou até levar à exclusão de medidas úteis durante a seleção de variáveis.

Uma forma simples de medir a influência de um grupo

Os autores se concentram em Modelos Aditivos Generalizados, uma família transparente que inclui modelos lineares e uma variante popular chamada Explainable Boosting Machines. Esses modelos prevêem desfechos somando curvas de contribuição separadas, uma para cada característica e, opcionalmente, para interações entre características. Métodos existentes para medir a influência de grupos, como pontuações baseadas em Shapley ou testes de permutação agrupada, podem ser precisos, mas costumam ser computacionalmente pesados porque exigem muitas versões mascaradas dos dados ou re-treinamento repetido do modelo. Em contraste, o novo método define a importância de um grupo como o tamanho médio da contribuição combinada de todas as suas características (e interações) ao longo dos dados de treinamento. Graças à estrutura aditiva do modelo, isso requer apenas somar funções componentes já existentes, tornando-o rápido, aplicável após o treinamento do modelo e permitindo grupos sobrepostos ou definidos post hoc.

Testando a ideia em cenários controlados

Para entender como a importância de grupo se comporta, os autores desenham experimentos sintéticos nos quais controlam tanto a relação entre características e o alvo quanto o grau de correlação. Em uma configuração, duas características perfeitamente correlacionadas carregam cada uma metade de um sinal aditivo; como esperado, a importância do grupo é aproximadamente a soma de suas pontuações individuais. Em outra, duas características independentes empurram a previsão em direções opostas; a importância do grupo torna-se menor em relação à soma porque seus efeitos às vezes se anulam. Quando as mesmas características opostas são tornadas altamente correlacionadas, o cancelamento fica mais forte e a importância do grupo encolhe dramaticamente, mesmo que cada característica ainda pareça influente individualmente. Esses experimentos mostram que a medida proposta reflete naturalmente como características correlacionadas se reforçam ou se opõem quando atuam em conjunto.

O que dados reais dizem sobre saúde mental e riscos cirúrgicos

Os autores então aplicam o método a dois estudos de caso médicos. Em um grande conjunto de dados de adolescentes que combina imagem cerebral e questionários comportamentais, eles predizem um perfil de sintomas depressivos conhecido como valência negativa. Ao agrupar características em domínios como eventos de vida e trauma, traços de personalidade, testes neuropsicológicos, sono e redes cerebrais, a análise por grupos revela que eventos de vida e trauma e traços de personalidade são os principais motores, com a bateria neuropsicológica também ocupando posição elevada. Muitas questões relacionadas ao trauma são fortemente correlacionadas e cada uma recebe baixa importância individual, mas o grupo de trauma como um todo emerge como o mais informativo. Medidas de redes cerebrais, anteriormente subestimadas por causa de baixas pontuações individuais, também formam um grupo significativo. Em um segundo estudo com mais de 100.000 pacientes de artroplastia de quadril, eles comparam fatores de risco tradicionais como idade, sexo e comorbidades com um grupo que captura determinantes sociais da saúde em nível comunitário. O grupo comunitário, que agrega renda do bairro, apoio social, acesso digital, educação e caminhabilidade, torna-se o preditor único mais importante de mortalidade em 90 dias, superando até a idade e as comorbidades.

Por que isso importa para modelos justos e úteis

Ao mostrar que grupos de variáveis relacionadas podem ser mais preditivos do que qualquer variável isolada, este trabalho desafia o hábito de ler explicações de modelos como listas ranqueadas de características individuais. O método proposto torna prático quantificar quanto domínios inteiros — como histórico de trauma, função cognitiva ou contexto de vizinhança — contribuem para as previsões, mesmo quando seus componentes são numerosos e correlacionados. Para clínicos, formuladores de políticas e cientistas de dados, isso oferece uma visão mais holística e realista do que um modelo aprendeu, destacando, por exemplo, que experiências de vida e ambiente comunitário podem rivalizar ou superar fatores de risco clínicos clássicos. Em resumo, a importância por grupo fornece uma janela mais clara sobre dados de saúde complexos, ajudando a evitar interpretações enganosas e a apoiar decisões mais transparentes e melhores.

Citação: Bosschieter, T., França, L., Wolk, J. et al. The most important features in generalized additive models might be groups of features. Sci Rep 16, 14371 (2026). https://doi.org/10.1038/s41598-026-43928-4

Palavras-chave: importância de característica, aprendizado de máquina interpretável, modelos aditivos generalizados, análise de saúde, determinantes sociais da saúde