Clear Sky Science · es

Las características más importantes en modelos aditivos generalizados podrían ser grupos de características

Por qué los grupos pueden importar más que las pistas individuales

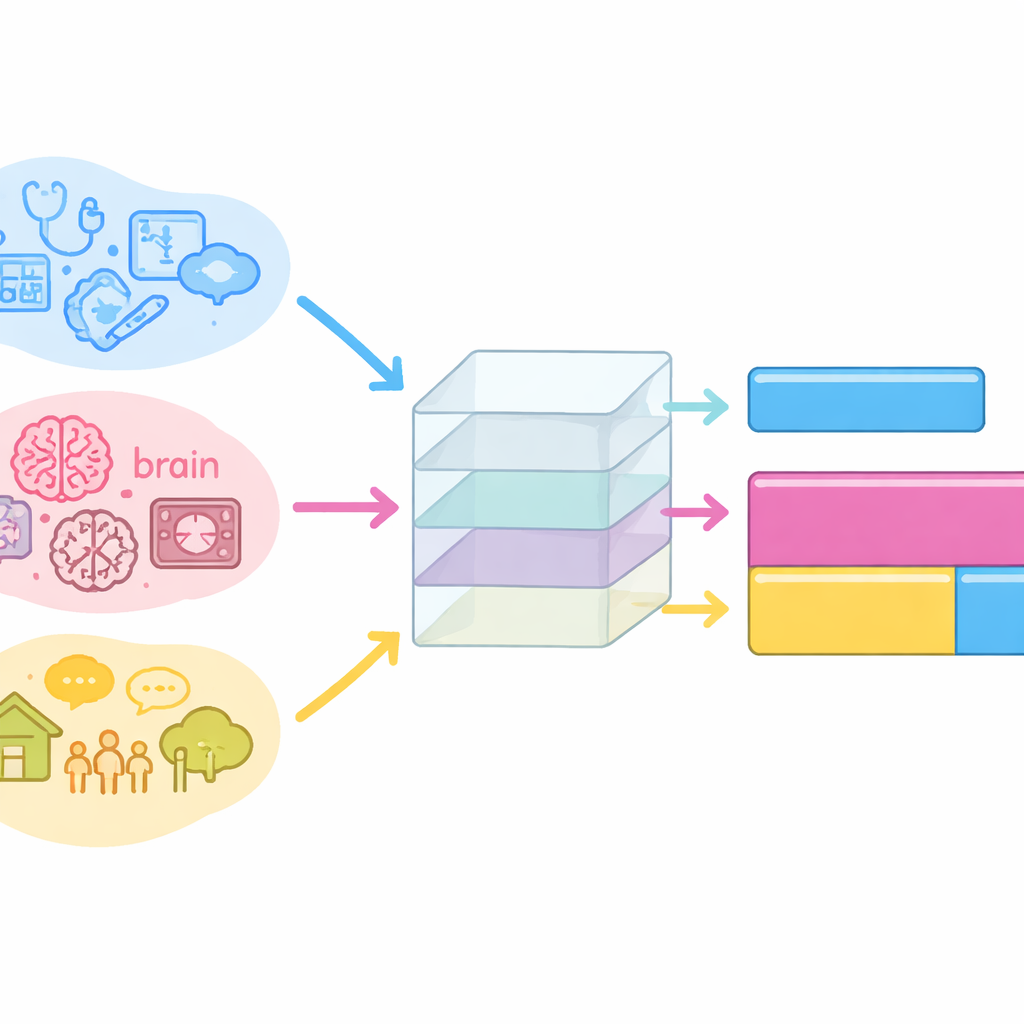

Los modelos predictivos modernos suelen examinar cientos de mediciones, desde exploraciones cerebrales hasta estadísticas vecinales, para prever resultados de salud. Normalmente preguntamos qué factor individual importa más: la edad, un análisis de laboratorio o quizá una región cerebral. Este artículo sostiene que esa perspectiva es demasiado estrecha. En muchos problemas médicos reales, lo que realmente impulsa las predicciones es la señal combinada de grupos de características relacionadas, no una característica aislada. Los autores proponen una forma rápida de medir la importancia de tales grupos en una clase de modelos transparentes de uso extendido, y muestran que esta perspectiva por grupos descubre conocimientos médicos que de otro modo pasarían desapercibidos.

Mirar más allá de los factores de riesgo individuales

La mayoría de herramientas de interpretabilidad actuales ordenan características individuales según cuánto influyen en las predicciones de un modelo. Eso funciona razonablemente bien cuando las características son independientes. Pero en los datos de salud, muchas variables se mueven juntas: las experiencias de trauma se agrupan, las redes cerebrales se coactivan y las condiciones sociales coexisten. Cuando las características están fuertemente correlacionadas, un modelo suele repartir la señal entre ellas, asignando a cada una una puntuación modesta aunque, en conjunto, posean un fuerte poder predictivo. Centrar la atención solo en factores individuales puede, por tanto, ocultar los verdaderos impulsores del riesgo o incluso llevar a eliminar mediciones útiles durante la selección de características.

Una forma simple de medir la influencia de un grupo

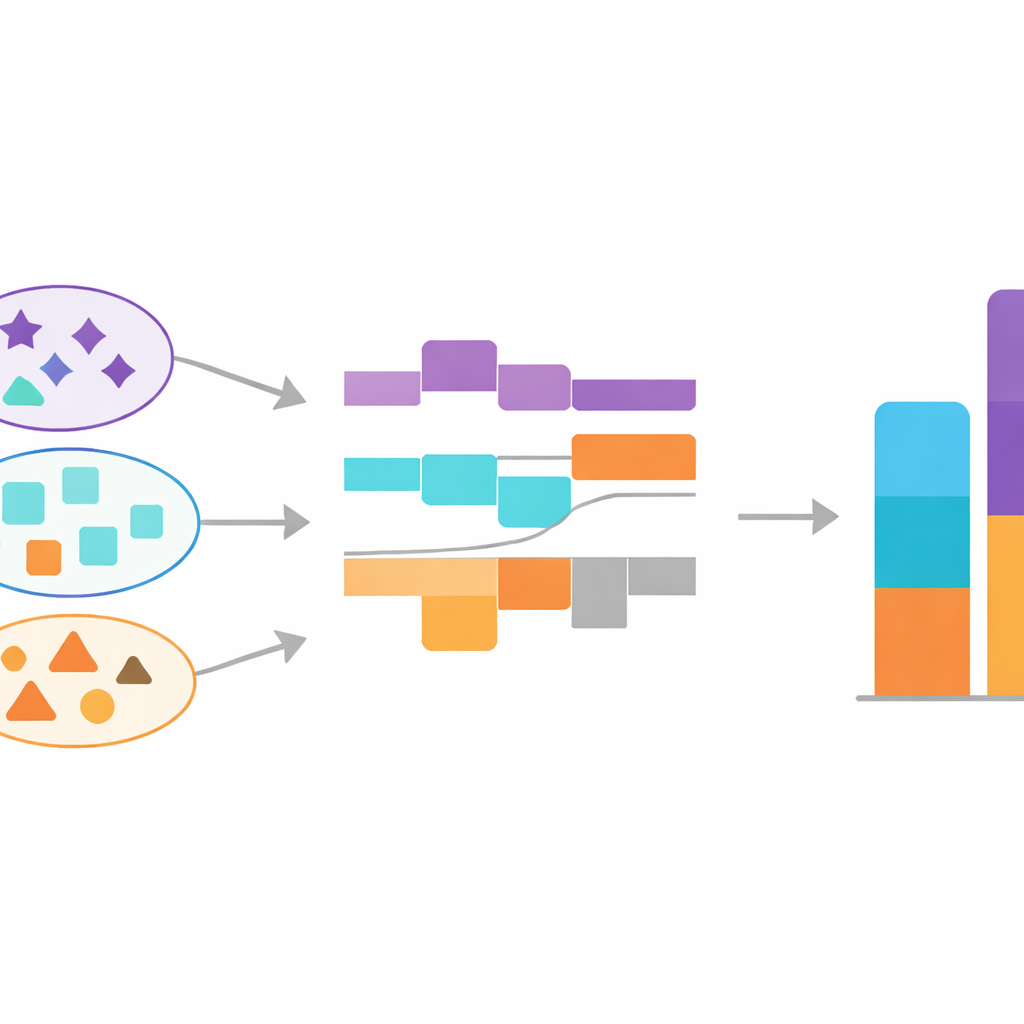

Los autores se centran en los Modelos Aditivos Generalizados, una familia transparente que incluye modelos lineales y una variante popular llamada Explainable Boosting Machines. Estos modelos predicen resultados sumando curvas de contribución separadas, una por cada característica y, opcionalmente, por interacciones entre características. Los métodos existentes para medir la influencia de grupos, como las puntuaciones basadas en Shapley o las pruebas de permutación agrupadas, pueden ser precisos pero suelen ser computacionalmente costosos porque requieren muchas versiones enmascaradas de los datos o volver a entrenar el modelo repetidamente. En contraste, el nuevo método define la importancia de un grupo como el tamaño medio de la contribución combinada de todas sus características (y sus interacciones) a lo largo de los datos de entrenamiento. Gracias a la estructura aditiva del modelo, esto solo requiere sumar las funciones componente ya existentes, por lo que es rápido, funciona después de entrenar el modelo y permite grupos solapados o definidos a posteriori.

Probar la idea en entornos controlados

Para entender cómo se comporta la importancia de grupo, los autores diseñan experimentos sintéticos en los que controlan tanto la relación entre las características y la variable objetivo como la cantidad de correlación. En una configuración, dos características perfectamente correlacionadas llevan cada una la mitad de una señal aditiva; como era de esperar, la importancia de su grupo es aproximadamente la suma de sus puntuaciones individuales. En otra, dos características independientes empujan la predicción en direcciones opuestas; la importancia de su grupo se vuelve menor en relación con la suma, porque sus efectos a veces se cancelan. Cuando esas mismas características opuestas se vuelven altamente correlacionadas, la cancelación se intensifica y la importancia del grupo disminuye drásticamente, aunque cada característica siga pareciendo influyente individualmente. Estos experimentos muestran que la medida propuesta refleja de forma natural cómo las características correlacionadas se refuerzan o se contraponen cuando actúan conjuntamente.

Qué dicen los datos reales sobre salud mental y riesgos quirúrgicos

Los autores pasan luego a dos estudios médicos. En un gran conjunto de datos de adolescentes que combina imágenes cerebrales y cuestionarios conductuales, predicen un perfil de síntomas depresivos conocido como valencia negativa. Al agrupar características en dominios como eventos de vida y trauma, rasgos de personalidad, pruebas neuropsicológicas, sueño y redes cerebrales, el análisis por grupos revela que los eventos de vida y trauma y los rasgos de personalidad son los impulsores más fuertes, con la batería neuropsicológica también en una posición alta. Muchas preguntas relacionadas con el trauma están altamente correlacionadas y cada una recibe baja importancia individual, pero el grupo de trauma en su conjunto emerge como el más informativo. Las medidas de redes cerebrales, antes subestimadas por sus bajas puntuaciones individuales, también constituyen un grupo significativo. En un segundo estudio con más de 100.000 pacientes de reemplazo de cadera, comparan factores de riesgo tradicionales como edad, sexo y comorbilidades con un grupo que capta determinantes sociales de salud a nivel comunitario. El grupo comunitario, que agrupa renta del vecindario, apoyo social, acceso digital, educación y capacidad de caminar, se convierte en el predictor más importante de la mortalidad a 90 días, superando incluso la edad y las comorbilidades.

Por qué esto importa para modelos justos y útiles

Al mostrar que los grupos de variables relacionadas pueden ser más predictivos que cualquier variable por sí sola, este trabajo cuestiona la costumbre de leer las explicaciones de los modelos como listas ordenadas de características individuales. El método propuesto hace práctico cuantificar cuánto contribuyen dominios enteros —como el historial de trauma, la función cognitiva o el contexto vecinal— a las predicciones, incluso cuando sus componentes son numerosos y están correlacionados. Para clínicos, responsables políticos y científicos de datos, esto ofrece una visión más holística y realista de lo que un modelo ha aprendido, subrayando, por ejemplo, que las experiencias vividas y el entorno comunitario pueden igualar o superar a los factores de riesgo clínicos clásicos. En resumen, la importancia por grupos proporciona una ventana más clara a datos de salud complejos, ayudando a evitar interpretaciones erróneas y respaldando una toma de decisiones más transparente y fundamentada.

Cita: Bosschieter, T., França, L., Wolk, J. et al. The most important features in generalized additive models might be groups of features. Sci Rep 16, 14371 (2026). https://doi.org/10.1038/s41598-026-43928-4

Palabras clave: importancia de características, aprendizaje automático interpretable, modelos aditivos generalizados, análisis en salud, determinantes sociales de la salud