Clear Sky Science · fr

Les caractéristiques les plus importantes dans les modèles additives généralisés peuvent être des groupes de caractéristiques

Pourquoi des groupes peuvent importer plus que des indices isolés

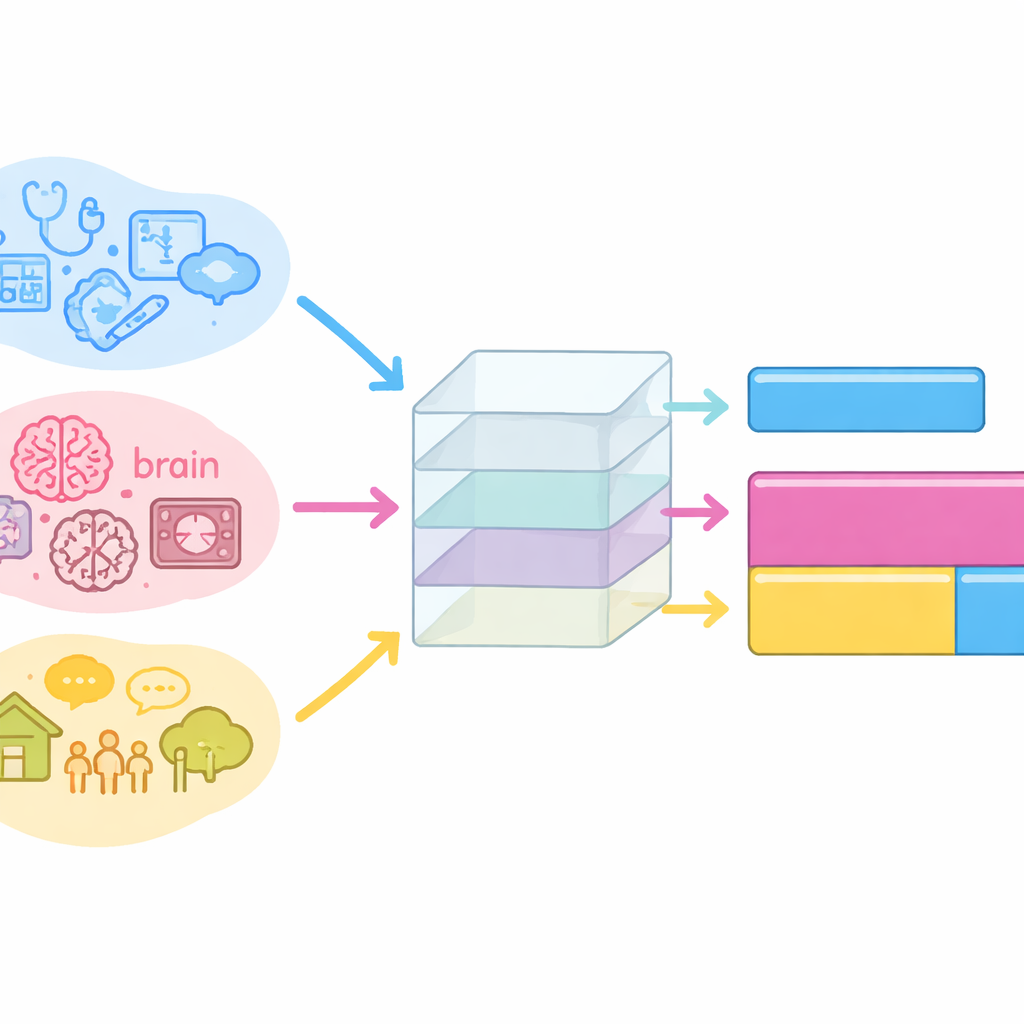

Les modèles prédictifs modernes scrutent souvent des centaines de mesures, des images cérébrales aux statistiques de quartier, pour prévoir des issues de santé. On cherche généralement quel facteur individuel compte le plus : l’âge, un test de laboratoire ou peut‑être une région cérébrale. Cet article soutient que ce point de vue est trop étroit. Dans de nombreux problèmes médicaux réels, ce qui pilote réellement les prédictions est le signal combiné de groupes de caractéristiques apparentées, et non une caractéristique prise isolément. Les auteurs proposent une méthode rapide pour mesurer l’importance de tels groupes dans une classe largement utilisée de modèles transparents, et montrent que cette perspective de groupe révèle des connaissances médicales qui resteraient sinon cachées.

Aller au‑delà des facteurs de risque individuels

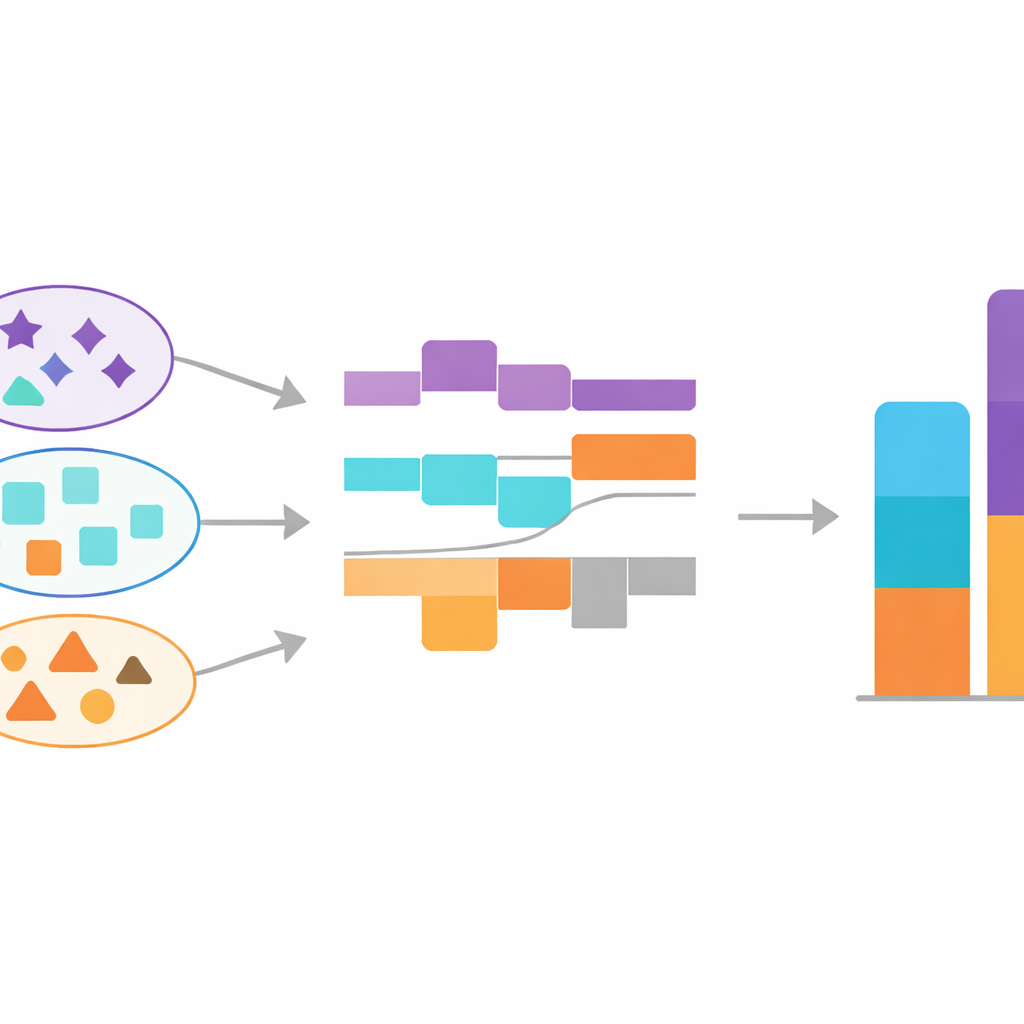

La plupart des outils d’interprétabilité actuels classent les caractéristiques individuelles selon leur influence sur les prédictions d’un modèle. Cela fonctionne assez bien quand les caractéristiques sont indépendantes. Mais dans les données de santé, de nombreuses variables évoluent conjointement : les expériences de traumatisme se regroupent, les réseaux cérébraux s’activent en cooccurrence, et les conditions sociales se présentent souvent ensemble. Lorsque les caractéristiques sont fortement corrélées, un modèle répartit souvent le signal entre elles, attribuant à chacune un score modeste même si, ensemble, elles portent une forte puissance prédictive. Se focaliser uniquement sur des facteurs individuels peut donc masquer les véritables moteurs du risque, ou même conduire à écarter des mesures utiles lors de la sélection de caractéristiques.

Une manière simple de mesurer l’influence d’un groupe

Les auteurs se concentrent sur les modèles additives généralisés, une famille transparente qui inclut les modèles linéaires et une variante populaire appelée Explainable Boosting Machines. Ces modèles prédisent des issues en additionnant des courbes de contribution séparées, une pour chaque caractéristique et, éventuellement, pour les interactions entre caractéristiques. Les méthodes existantes pour mesurer l’influence de groupes, comme les scores basés sur Shapley ou les tests de permutation groupés, peuvent être précises mais souvent coûteuses en calcul car elles exigent de nombreuses versions masquées des données ou plusieurs réentraînements du modèle. En revanche, la nouvelle méthode définit l’importance d’un groupe comme la taille moyenne de la contribution combinée de toutes ses caractéristiques (et interactions) sur les données d’entraînement. Grâce à la structure additive du modèle, cela ne requiert que la somme des fonctions composantes existantes, donc c’est rapide, applicable après l’entraînement du modèle et autorise des groupes qui se chevauchent ou sont définis a posteriori.

Tester l’idée dans des contextes contrôlés

Pour comprendre le comportement de l’importance de groupe, les auteurs conçoivent des expériences synthétiques où ils contrôlent à la fois la relation entre les caractéristiques et la cible, et le degré de corrélation. Dans une configuration, deux caractéristiques parfaitement corrélées portent chacune la moitié d’un signal additif ; comme prévu, leur importance de groupe est approximativement la somme de leurs scores individuels. Dans une autre, deux caractéristiques indépendantes poussent la prédiction en sens opposé ; leur importance de groupe devient plus faible par rapport à la somme, car leurs effets s’annulent par moments. Lorsque ces mêmes caractéristiques antagonistes sont rendues fortement corrélées, l’annulation s’accentue et l’importance de groupe diminue de façon spectaculaire, même si chaque caractéristique semble encore influente individuellement. Ces expériences montrent que la mesure proposée reflète naturellement la façon dont des caractéristiques corrélées se renforcent ou s’opposent mutuellement lorsqu’elles agissent ensemble.

Ce que disent les données réelles sur la santé mentale et les risques chirurgicaux

Les auteurs examinent ensuite deux études de cas médicales. Dans un grand jeu de données d’adolescents combinant imagerie cérébrale et questionnaires comportementaux, ils prédisent un profil de symptômes dépressifs connu sous le nom de valence négative. En regroupant les caractéristiques en domaines tels que les événements de vie et de traumatisme, les traits de personnalité, les tests neuropsychologiques, le sommeil et les réseaux cérébraux, l’analyse de groupe révèle que les événements de vie et de traumatisme ainsi que les traits de personnalité sont les moteurs les plus puissants, la batterie neuropsychologique se classant également haut. De nombreuses questions liées au traumatisme sont fortement corrélées et reçoivent chacune une faible importance individuelle, mais le groupe « traumatisme » émerge comme le plus informatif. Les mesures des réseaux cérébraux, auparavant sous‑estimées à cause de faibles scores au niveau des caractéristiques, forment aussi un groupe significatif. Dans une seconde étude portant sur plus de 100 000 patients ayant subi une prothèse de hanche, ils comparent les facteurs de risque traditionnels comme l’âge, le sexe et les comorbidités à un groupe englobant des déterminants sociaux de la santé au niveau communautaire. Le groupe « communauté », qui regroupe le revenu du quartier, le soutien social, l’accès numérique, l’éducation et la possibilité de se déplacer à pied, devient le prédicteur unique le plus important de la mortalité à 90 jours, dépassant même l’âge et les comorbidités.

Pourquoi c’est important pour des modèles justes et utiles

En montrant que des groupes de variables apparentées peuvent être plus prédictifs que n’importe quelle variable prise isolément, ce travail remet en cause l’habitude de lire les explications de modèles sous forme de listes classées de caractéristiques individuelles. La méthode proposée rend praticable la quantification de la contribution d’entiers domaines — tels que l’histoire des traumatismes, la fonction cognitive ou le contexte de quartier — aux prédictions, même lorsque leurs composantes sont nombreuses et corrélées. Pour cliniciens, décideurs et scientifiques des données, cela offre une vision plus holistique et réaliste de ce qu’un modèle a appris, soulignant, par exemple, que les expériences vécues et l’environnement communautaire peuvent rivaliser ou dépasser les facteurs de risque cliniques classiques. En bref, l’importance de groupe fournit une fenêtre plus claire sur des données de santé complexes, aidant à éviter des interprétations trompeuses et à soutenir une prise de décision plus transparente et meilleure.

Citation: Bosschieter, T., França, L., Wolk, J. et al. The most important features in generalized additive models might be groups of features. Sci Rep 16, 14371 (2026). https://doi.org/10.1038/s41598-026-43928-4

Mots-clés: importance des caractéristiques, apprentissage automatique interprétable, modèles additives généralisés, analyse des soins de santé, déterminants sociaux de la santé