Clear Sky Science · pt

Memória de atenção longo‑curto prazo (LSTAM): um modelo de integração de características globais para previsão conjunta de momentos em reabilitação humana

Ajuda mais inteligente para recuperar o movimento

Quando alguém está reaprendendo a caminhar após uma lesão ou cirurgia, os médicos precisam saber quão intenso é o esforço em cada articulação da perna. Tradicionalmente, isso exige equipamentos volumosos de laboratório e medições cuidadosas, difíceis de aplicar no dia a dia. Este estudo apresenta um novo modelo computacional capaz de estimar essas forças articulares ocultas usando sensores leves colocados no corpo, abrindo caminho para uma reabilitação mais prática e personalizada.

Forças ocultas nos passos do cotidiano

Cada vez que damos um passo, quadril, joelho e tornozelo geram forças de torque chamadas momentos articulares. Essas forças são cruciais para entender se um movimento é seguro, eficiente ou arriscado para nova lesão. Mas os momentos articulares são difíceis de medir diretamente; os laboratórios geralmente dependem de câmeras de captura de movimento, placas de força no chão e modelos detalhados do corpo. Isso torna o processo caro e limitado a centros de pesquisa, embora clínicos e projetistas de dispositivos precisem muito dessas informações para ajustar órteses, exoesqueletos e próteses.

Ouvindo os músculos em vez do chão

Para contornar essa limitação, pesquisadores recorreram a sinais que podem ser medidos na pele. Pequenos sensores registram a atividade elétrica dos músculos (EMG de superfície) e acompanham como as articulações se dobram ao longo do tempo. Métodos anteriores de aprendizado de máquina usaram esses sinais para prever momentos articulares com certo sucesso, mas enfrentavam um problema chave: os dados brutos estão cheios de tremores de curto prazo, ruído por movimento do sensor e picos breves que não refletem o padrão geral de como alguém se move. Modelos que perseguem essas pequenas flutuações podem perder as tendências mais amplas e significativas que descrevem o comportamento real do quadril ao longo de muitos passos.

Uma nova forma de ver o panorama em sinais ruidosos

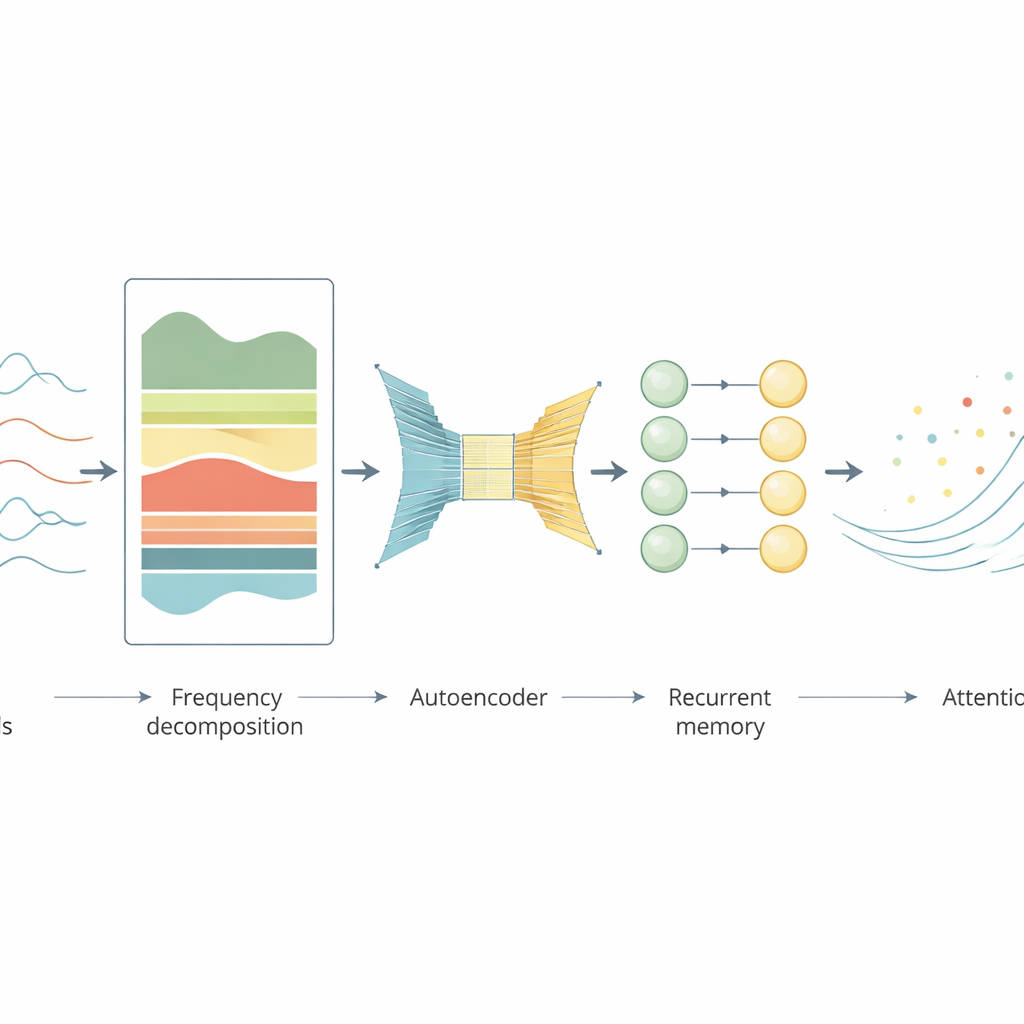

Os autores propõem um modelo que chamam de memória de atenção longo‑curto, ou LSTAM, projetado para focar na estrutura de longo alcance do movimento enquanto suaviza detalhes distrativos. Primeiro, em vez de trabalhar apenas com os sinais no domínio do tempo, o modelo os converte para uma visão em frequência usando uma ferramenta matemática semelhante à divisão de áudio em graves e agudos. Nessa forma, padrões estáveis na coordenação muscular sobressaem, enquanto explosões breves de ruído tornam‑se menos importantes. Em seguida, um autoencoder — uma espécie de compressor inteligente construído com camadas neurais simples e filtros convolucionais — aprende a representar os dados em uma forma mais limpa e de dimensão reduzida que preserva padrões importantes e elimina ondulações locais desnecessárias.

Memória e foco para corpos em movimento

Depois que os sinais são limpos e compactados, a informação alimenta uma rede de memória de longo curto prazo (LSTM), um tipo de modelo recorrente adequado para acompanhar como as coisas evoluem ao longo do tempo. Sobre isso, os autores acrescentam um mecanismo de atenção, que permite ao modelo automaticamente “olhar com mais atenção” para os momentos e componentes de frequência mais informativos — como fases-chave de um passo em que músculos se ligam ou desligam — e dar menos importância a intervalos irrelevantes. Juntas, essas etapas transformam rastros brutos e ruidosos de sensores em uma descrição compacta do movimento de uma pessoa, bem adaptada para prever momentos articulares do quadril.

Colocando o modelo à prova

A equipe avaliou o LSTAM usando um conjunto de dados público de quatorze voluntários saudáveis caminhando em esteira, em terreno plano e em rampas em várias velocidades. Para cada pessoa, o modelo foi treinado com os dados de apenas uma sessão na esteira e então solicitado a predizer os momentos do quadril nas demais provas. Entre os participantes, o LSTAM produziu previsões que acompanharam de perto os momentos articulares calculados em laboratório, com erros menores e maior concordância do que várias alternativas avançadas, incluindo redes LSTM padrão, modelos de convolução temporal e abordagens recentes baseadas em transformers. Os autores também realizaram testes de “ablação”, removendo seletivamente componentes como a etapa de frequência, o autoencoder ou a atenção. Cada remoção degradou o desempenho, mostrando que os três ingredientes eram importantes para capturar os padrões globais nesses sinais biológicos.

O que isso pode significar para o cuidado em reabilitação

Em termos simples, este trabalho mostra que é possível estimar forças invisíveis no quadril usando apenas alguns sensores de músculo e ângulo, sem equipamentos pesados de laboratório, e fazer isso com mais precisão ao ensinar o modelo a prestar atenção a tendências de longo prazo em vez de ruído de curta duração. Essa ferramenta poderia ajudar terapeutas a monitorar a recuperação, ajustar programas de exercício ou controlar dispositivos inteligentes de reabilitação, como exoesqueletos e próteses, para que se movam em harmonia com os próprios músculos do paciente. Embora o estudo tenha se concentrado em adultos saudáveis e em tarefas de caminhada, a mesma abordagem poderia, no futuro, apoiar atividades mais complexas e grupos de pacientes diversos, tornando a avaliação de movimento de alta qualidade mais acessível fora de laboratórios de movimento especializados.

Citação: Xiong, B., Guo, Y., Lou, J. et al. Long short-term attention memory (LSTAM): a global-feature-integrated model for joint moment prediction in human rehabilitation. Sci Rep 16, 13835 (2026). https://doi.org/10.1038/s41598-026-42722-6

Palavras-chave: Eletromiografia, Análise da marcha, Tecnologia de reabilitação, Aprendizado profundo, Sensores vestíveis