Clear Sky Science · es

Memoria de atención a corto y largo plazo (LSTAM): un modelo integrado de características globales para la predicción conjunta del momento articular en la rehabilitación humana

Ayuda más inteligente para curar el movimiento

Cuando alguien aprende a caminar de nuevo tras una lesión o una cirugía, los médicos necesitan saber cuánto esfuerzo está haciendo cada articulación de la pierna. Tradicionalmente, eso requería equipos voluminosos de laboratorio y mediciones cuidadosas, difíciles de usar en la vida cotidiana. Este estudio presenta un nuevo modelo informático que puede estimar esas fuerzas articulares ocultas usando sensores ligeros colocados sobre el cuerpo, abriendo la puerta a una rehabilitación más práctica y personalizada.

Fuerzas ocultas en los pasos de cada día

Cada vez que damos un paso, la cadera, la rodilla y el tobillo generan fuerzas de rotación llamadas momentos articulares. Estas fuerzas son cruciales para entender si un movimiento es seguro, eficiente o presenta riesgo de nueva lesión. Pero los momentos articulares son difíciles de medir directamente; los laboratorios suelen depender de cámaras de captura de movimiento, plataformas de fuerza en el suelo y modelos corporales detallados. Eso hace que el proceso sea caro y se limite en gran medida a centros de investigación, aunque los clínicos y los diseñadores de dispositivos necesitan urgentemente esta información para ajustar órtesis, exoesqueletos y prótesis.

Escuchar a los músculos en lugar del suelo

Para sortear esta limitación, los investigadores han recurrido a señales que sí se pueden medir en la piel. Pequeños sensores registran la actividad eléctrica de los músculos (EMG superficial) y siguen cómo se doblan las articulaciones en el tiempo. Métodos de aprendizaje automático anteriores usaron estas señales para predecir momentos articulares con cierto éxito, pero tropezaron con un problema clave: los datos en bruto contienen muchas variaciones a corto plazo, ruido por el movimiento del sensor y picos breves que no reflejan el patrón general del movimiento. Los modelos que persiguen esas pequeñas fluctuaciones pueden perder las tendencias más amplias y significativas que describen cómo se comporta realmente la cadera de una persona a lo largo de muchos pasos.

Una nueva forma de ver el panorama general en señales ruidosas

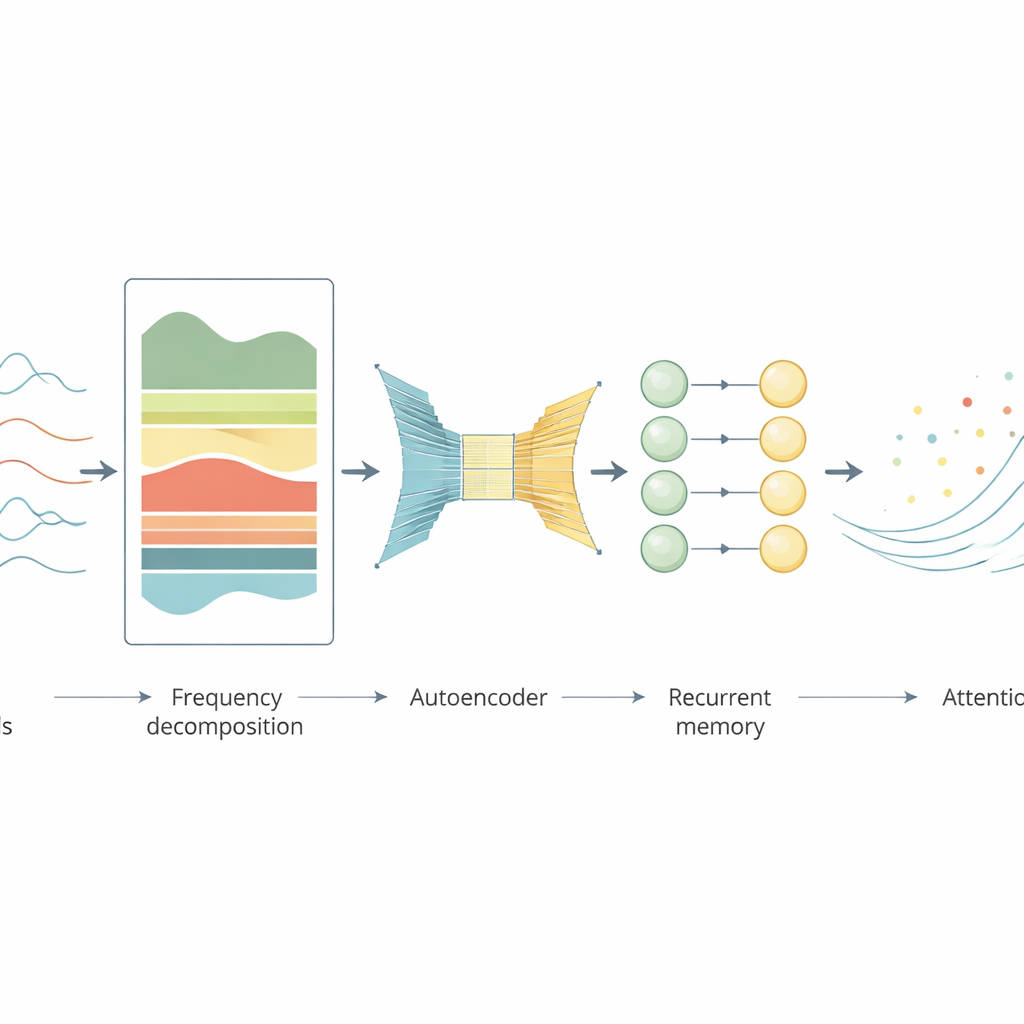

Los autores proponen un modelo al que llaman memoria de atención a corto y largo plazo, o LSTAM, diseñado para centrarse en la estructura de largo alcance del movimiento y minimizar los detalles que distraen. Primero, en lugar de trabajar solo con las señales temporales originales, el modelo las convierte a una vista en frecuencia mediante una herramienta matemática similar a la que divide el audio en graves y agudos. En esta forma, los patrones constantes de coordinación muscular resaltan, mientras que los estallidos breves de ruido se vuelven menos importantes. A continuación, un autoencoder —una especie de compresor inteligente construido con capas neuronales simples y filtros convolucionales— aprende a representar los datos en una forma más limpia y de menor dimensión que preserva patrones importantes y difumina ondulaciones locales innecesarias.

Memoria y foco para cuerpos en movimiento

Tras limpiar y comprimir las señales, la información alimenta una red de memoria a corto y largo plazo (LSTM), un tipo de modelo recurrente bueno para seguir cómo evolucionan las cosas en el tiempo. Sobre esta base, los autores añaden un mecanismo de atención que permite al modelo «mirar con más atención» los momentos y componentes de frecuencia más informativos —como fases clave de un paso en las que los músculos se activan o se apagan— y prestar menos importancia a intervalos irrelevantes. En conjunto, estas etapas transforman trazas de sensores ruidosas y en bruto en una descripción compacta del movimiento de una persona que es adecuada para predecir los momentos de la cadera.

Poniendo el modelo a prueba

El equipo evaluó LSTAM usando un conjunto de datos público de catorce voluntarios sanos caminando en cinta, sobre terreno llano y en rampas a distintas velocidades. Para cada persona, el modelo se entrenó con datos de una sola sesión en cinta y luego se pidió que predijera los momentos de cadera en las pruebas restantes. Entre sujetos, LSTAM produjo de forma consistente predicciones que seguían de cerca los momentos articulares calculados en laboratorio, con errores menores y una mayor concordancia que varias alternativas avanzadas, incluidos las redes LSTM estándar, modelos de convolución temporal y enfoques recientes basados en transformers. Los autores también realizaron pruebas de «ablación», eliminando selectivamente piezas como la etapa de frecuencia, el autoencoder o la atención. Cada eliminación degradó el rendimiento, mostrando que los tres ingredientes eran importantes para capturar los patrones globales en estas señales biológicas.

Qué podría significar esto para la atención rehabilitadora

En términos sencillos, este trabajo demuestra que es posible estimar fuerzas invisibles en la cadera usando solo un puñado de sensores musculares y de ángulo, sin equipos de laboratorio pesados, y hacerlo con mayor precisión enseñando al modelo a fijarse en tendencias a largo plazo en lugar de ruidos efímeros. Una herramienta así podría ayudar a los terapeutas a monitorizar la recuperación, ajustar programas de ejercicio o controlar dispositivos de rehabilitación inteligentes como exoesqueletos y prótesis para que se muevan en armonía con los músculos del paciente. Aunque el estudio se centró en adultos sanos y tareas de marcha, el mismo enfoque podría eventualmente apoyar actividades más complejas y otros grupos de pacientes, haciendo que la evaluación de movimiento de alta calidad sea más accesible fuera de los laboratorios especializados de movimiento.

Cita: Xiong, B., Guo, Y., Lou, J. et al. Long short-term attention memory (LSTAM): a global-feature-integrated model for joint moment prediction in human rehabilitation. Sci Rep 16, 13835 (2026). https://doi.org/10.1038/s41598-026-42722-6

Palabras clave: electromiografía, análisis de la marcha, tecnología de rehabilitación, aprendizaje profundo, sensores portátiles