Clear Sky Science · de

Long short-term attention memory (LSTAM): ein global‑feature‑integriertes Modell zur gemeinsamen Momentvorhersage in der menschlichen Rehabilitation

Intelligenteres Helfen beim Wiedererlernen von Bewegung

Wenn jemand nach einer Verletzung oder Operation das Gehen neu erlernen muss, müssen Ärztinnen und Ärzte wissen, wie stark jedes Gelenk im Bein arbeitet. Traditionell erforderte das sperrige Laborausstattung und sorgfältige Messungen, die im Alltag schwer einzusetzen sind. Diese Studie stellt ein neues Computermodell vor, das diese versteckten Gelenkkräfte mithilfe leichter am Körper getragener Sensoren schätzen kann und damit den Weg für praktischere, personalisierte Rehabilitationsmaßnahmen öffnet.

Verborgene Kräfte in alltäglichen Schritten

Bei jedem Schritt erzeugen Hüfte, Knie und Fußgelenk Drehkräfte, sogenannte Gelenkmomente. Diese Kräfte sind entscheidend, um zu beurteilen, ob eine Bewegung sicher, effizient oder verletzungsanfällig ist. Direkt gemessen werden Gelenkmomente jedoch nur selten; Labore nutzen meist Bewegungsaufnahmekameras, Kraftplatten im Boden und detaillierte Körpermodelle. Das macht den Ablauf teuer und weitgehend auf Forschungseinrichtungen beschränkt, obwohl Kliniker und Geräteentwickler diese Informationen dringend benötigen, um Orthesen, Exoskelette und Prothesen zu optimieren.

Auf Muskeln hören statt auf den Boden

Um diese Einschränkung zu umgehen, greifen Forscher auf Signale zurück, die sich an der Haut messen lassen. Kleine Sensoren zeichnen elektrische Muskelaktivität (oberflächennahe EMG) auf und verfolgen, wie sich Gelenke im Zeitverlauf bewegen. Frühere Methoden aus dem maschinellen Lernen nutzten diese Signale zur Vorhersage von Gelenkmomenten mit mäßigem Erfolg, kämpften jedoch mit einem zentralen Problem: Die Rohdaten enthalten viele kurzfristige Zuckungen, Störgeräusche durch Sensorbewegung und kurze Spitzen, die nicht das Gesamtmuster der Bewegung widerspiegeln. Modelle, die diesen kleinen Schwankungen folgen, können die größeren, aussagekräftigeren Trends über viele Schritte hinweg übersehen.

Eine neue Sicht auf das große Bild in verrauschten Signalen

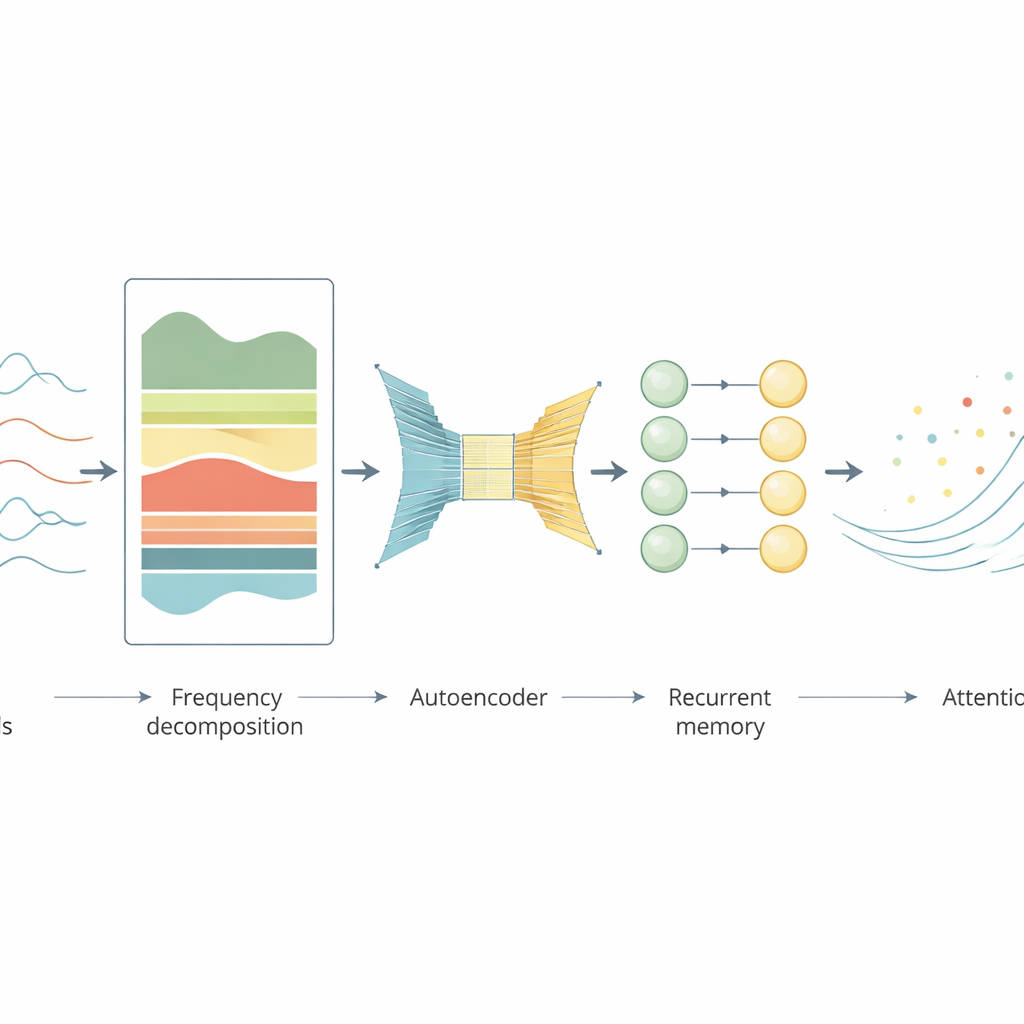

Die Autoren schlagen ein Modell vor, das sie long short‑term attention memory (LSTAM) nennen und das darauf ausgelegt ist, die langfristige Struktur der Bewegung in den Vordergrund zu rücken und ablenkende Details zu dämpfen. Zunächst wandelt das Modell die zeitbasierten Signale in eine Frequenzdarstellung um — vergleichbar mit dem Aufspalten von Audio in Bass und Höhen. In dieser Form treten stabile Muster der Muskelkoordination deutlicher hervor, während kurze Störimpulse an Bedeutung verlieren. Anschließend lernt ein Autoencoder — eine Art intelligenter Kompressor aus einfachen neuronalen Schichten und Faltungsfiltern —, die Daten in einer sauberen, niedrigdimensionalen Darstellung abzubilden, die wichtige Muster bewahrt und unnötige lokale Schwankungen verwischt.

Gedächtnis und Fokus für bewegte Körper

Nachdem die Signale bereinigt und komprimiert wurden, fließen die Informationen in ein Long short‑term memory‑Netzwerk, eine Klasse rekurrenter Modelle, die gut darin ist, zeitliche Entwicklungen nachzuverfolgen. Darauf setzen die Autorinnen und Autoren einen Aufmerksamkeitsmechanismus (Attention), der dem Modell erlaubt, automatisch „intensiver hinzuschauen“ auf die informativsten Zeitpunkte und Frequenzkomponenten — etwa wichtige Phasen eines Schritts, in denen Muskeln an‑ oder abschalten — und weniger auf unbedeutende Intervalle zu achten. Zusammen verwandeln diese Stufen rohe, verrauschte Sensordaten in eine kompakte Beschreibung der Bewegung einer Person, die sich gut eignet, Hüftmomente vorherzusagen.

Das Modell auf die Probe gestellt

Das Team bewertete LSTAM anhand eines öffentlichen Datensatzes von vierzehn gesunden Versuchspersonen, die auf dem Laufband, auf ebenem Untergrund und auf Rampen bei unterschiedlichen Geschwindigkeiten gingen. Für jede Person wurde das Modell mit Daten aus nur einer Laufbandsitzung trainiert und sollte dann Hüftmomente in den verbleibenden Versuchen vorhersagen. Über alle Probanden hinweg lieferte LSTAM durchgängig Vorhersagen, die eng an den im Labor berechneten Gelenkmomenten lagen, mit kleineren Fehlern und besserer Übereinstimmung als mehrere fortgeschrittene Alternativen, darunter Standard‑LSTM‑Netze, zeitliche Faltungsmodelle und neuere transformerbasierte Ansätze. Die Autorinnen und Autoren führten zudem „Ablations“-Tests durch, bei denen Teile wie die Frequenzstufe, der Autoencoder oder die Attention selektiv entfernt wurden. Jede Entfernung verschlechterte die Leistung, was zeigt, dass alle drei Bausteine wichtig sind, um die globalen Muster in diesen biologischen Signalen zu erfassen.

Was das für die Reha‑Versorgung bedeuten könnte

Einfach gesagt zeigt diese Arbeit, dass sich unsichtbare Kräfte an der Hüfte mit nur wenigen Muskel‑ und Winkel‑Sensoren abschätzen lassen, ohne schwere Laborausrüstung, und dass dies genauer gelingt, wenn das Modell lernt, langfristige Trends statt kurzlebigen Störgeräuschen Beachtung zu schenken. Ein solches Werkzeug könnte Therapeutinnen und Therapeuten helfen, den Heilungsverlauf zu überwachen, Trainingsprogramme anzupassen oder intelligente Rehabilitationsgeräte wie Exoskelette und Prothesen so zu steuern, dass sie mit den eigenen Muskeln einer Patientin oder eines Patienten harmonieren. Obwohl die Studie sich auf gesunde Erwachsene und Gehaufgaben konzentrierte, könnte derselbe Ansatz später komplexere Aktivitäten und Patientengruppen unterstützen und hochwertige Bewegungsbeurteilung außerhalb spezialisierter Bewegungslabore zugänglicher machen.

Zitation: Xiong, B., Guo, Y., Lou, J. et al. Long short-term attention memory (LSTAM): a global-feature-integrated model for joint moment prediction in human rehabilitation. Sci Rep 16, 13835 (2026). https://doi.org/10.1038/s41598-026-42722-6

Schlüsselwörter: Elektromyographie, Ganganalyse, Rehabilitationstechnologie, Tiefes Lernen, tragbare Sensoren