Clear Sky Science · pt

Estrutura híbrida de deep learning para restauração de imagens em sistemas FSO afetados por desvanecimento log-normal

Por que isso importa para imagens do dia a dia

À medida que mais aspectos da nossa vida migram para o ambiente online, esperamos que fotos e vídeos cheguem instantaneamente e com nitidez — seja de um scanner médico, uma câmera de segurança ou um satélite. Mas quando essas imagens são transmitidas pelo ar usando feixes de luz, a atmosfera pode embaralhá-las, transformando cenas nítidas em imagens granuladas e lavadas. Este estudo investiga como uma combinação do aprendizado profundo moderno com técnicas clássicas de nitidez pode resgatar essas imagens danificadas, recuperando detalhes finos mesmo quando o canal de transmissão é muito hostil.

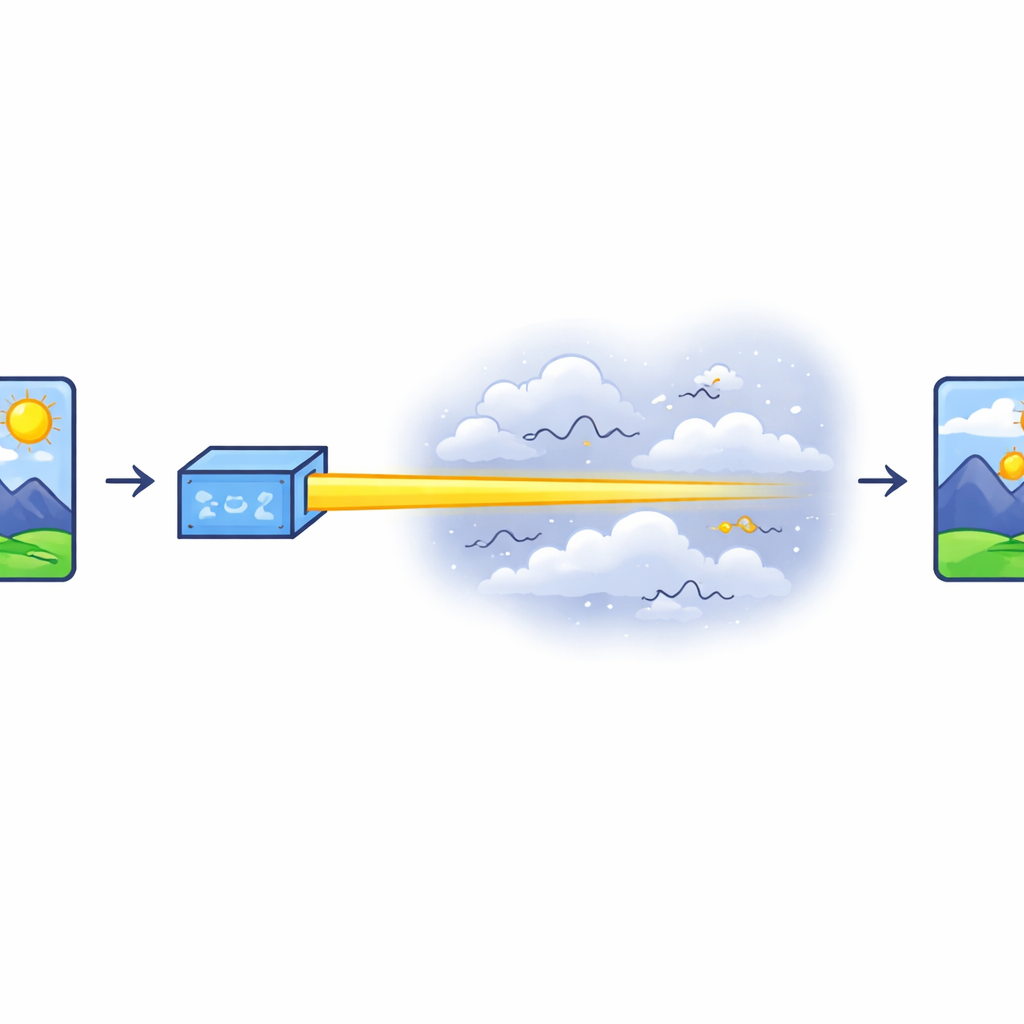

Enviando imagens pelo ar com luz

O trabalho foca na Comunicação Óptica em Espaço Livre (FSO), uma tecnologia que envia dados usando feixes de luz fortemente focalizados em vez de ondas de rádio. A FSO é atraente porque pode transportar enormes quantidades de informação — ideal para imagens e vídeos de alta resolução — sem precisar de licença de rádio. No entanto, o ar entre transmissor e receptor raramente está calmo. Variações de temperatura, vento e turbulência fazem o feixe de luz oscilar e flutuar em intensidade, um fenômeno que os autores descrevem estatisticamente como desvanecimento log-normal. Quando combinado com ruído eletrônico e esquemas de empacotamento de dados densos usados para encaixar mais informação no feixe, essas distorções podem degradar severamente a qualidade da imagem.

Limites dos truques tradicionais de limpeza

Engenheiros há muito tentam combater essas distorções com técnicas como múltiplas antenas (MIMO), esquemas de diversidade que enviam informações similares por caminhos diferentes, óptica adaptativa que remodela o feixe em tempo real e filtros sofisticados como os filtros de Gauss e de Wiener. Embora úteis, esses métodos têm dificuldades quando o ambiente muda rapidamente ou se comporta de maneira complexa e não linear. Eles podem suavizar parte do ruído, mas frequentemente borram bordas e texturas importantes, e não são flexíveis o suficiente para desfazer totalmente o desvanecimento aleatório e rapidamente variável que afeta links FSO no mundo real.

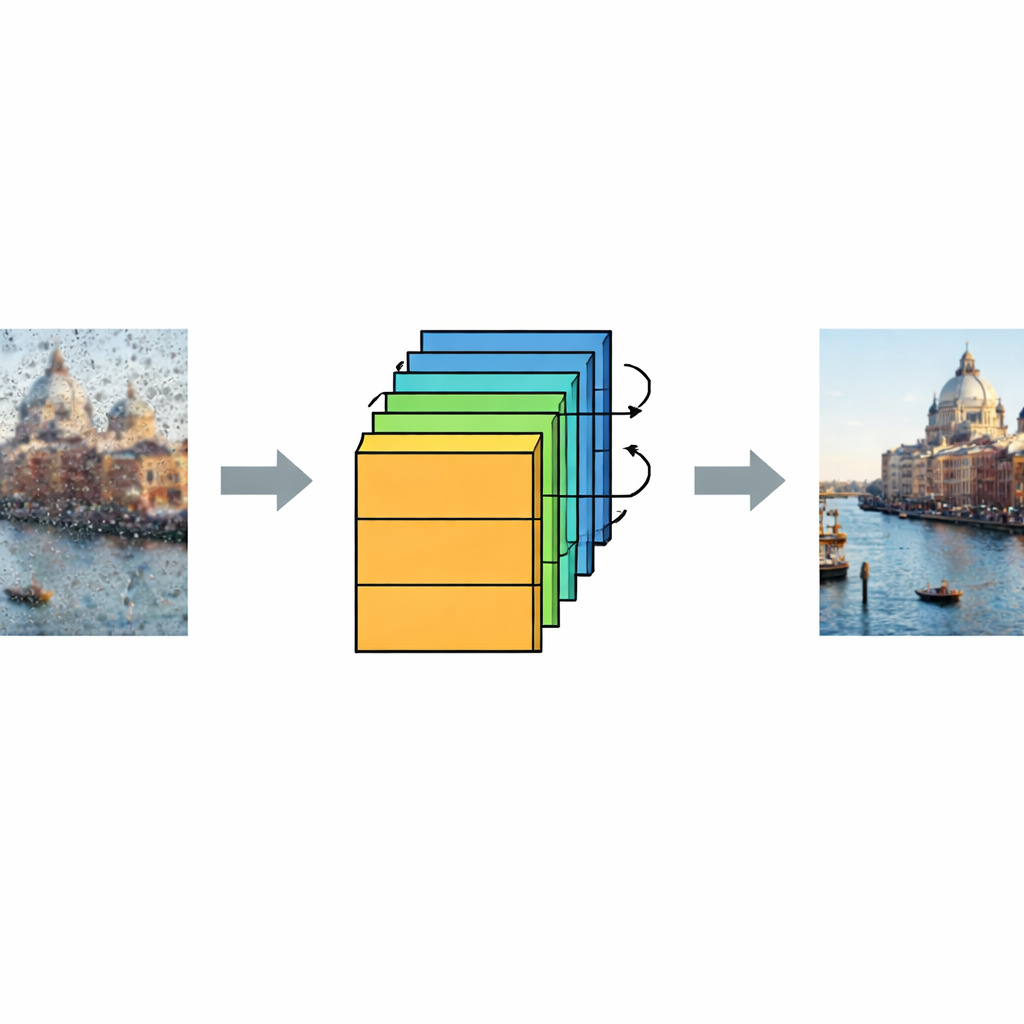

Uma máquina de aprendizado que entende a distorção

Para superar esses limites, os autores projetam uma rede neural convolucional profunda (DCNN) que aprende, a partir de exemplos, como o desvanecimento e o ruído normalmente danificam as imagens. Eles criam um grande conjunto de dados sintéticos com 30.000 imagens usando geradores de imagem por IA e depois simulam matematicamente como um link FSO com desvanecimento log-normal e ruído adicional as corromperia. Metade das imagens é mantida limpa e a outra metade é degradada por desvanecimento e ruído, cobrindo uma ampla gama de condições de relação sinal-ruído. Durante o treinamento, a DCNN vê muitos pares de imagens danificadas e originais e gradualmente aprende a estimar e subtrair o padrão de ruído, usando uma pilha de 22 camadas e blocos residuais repetidos que se especializam em separar a estrutura verdadeira da distorção.

Realçando detalhes e verificando confiabilidade

Depois que a DCNN remove a maior parte do ruído e dos efeitos de desvanecimento, os autores adicionam uma etapa dedicada de nitidez que realça bordas e estruturas finas que podem ter sido suavizadas durante o processo. Esse pipeline em duas etapas — remoção de ruído seguida por nitidez — mostra-se crucial para produzir imagens que não apenas têm boas métricas numéricas, mas também parecem claras para observadores humanos. A equipe avalia a qualidade usando a Relação Sinal-Ruído de Pico (PSNR) e o Erro Quadrático Médio (RMSE), métricas padrão que comparam as imagens restauradas com suas versões originais. Em condições simuladas severas, onde as imagens degradadas podem cair para cerca de 7–9 dB de PSNR, as imagens restauradas sobem para cerca de 67–68 dB, firmemente na faixa “excelente” e muito além do que filtros tradicionais alcançam.

Testando em classificação e casos parecidos com o mundo real

Para garantir que as imagens restauradas não sejam apenas esteticamente melhores, mas também úteis para análises posteriores, os autores treinam redes residuais profundas (ResNet-18, ResNet-50 e ResNet-101) para distinguir entre imagens degradadas e limpas. Esses classificadores alcançam mais de 99,8% de acurácia, confirmando que o conjunto de dados é bem estruturado e que o processo de restauração preserva padrões visuais significativos. O framework também é testado em imagens não vistas durante o treinamento, incluindo um retrato humano real transmitido por um link FSO simulado. Mesmo nesses casos desafiadores, o modelo melhora nitidamente a clareza, demonstrando que aprendeu princípios gerais de restauração em vez de simplesmente memorizar exemplos de treinamento.

O que isso significa para sistemas de imagem futuros

Para um leitor não especialista, a conclusão principal é que os autores construíram um sistema inteligente de “resgate de imagem” capaz de pegar fotos gravemente danificadas transmitidas por ar turbulento e torná-las quase tão boas quanto as originais. Ao combinar uma rede profunda aprendida com uma etapa final de nitidez, o método transforma rostos e cenas ruidosos e desbotados de volta em imagens claras e detalhadas. Essa abordagem pode fortalecer aplicações futuras que vão desde telemedicina e diagnóstico remoto até vigilância e observação da Terra, onde decisões dependem de ver pequenos detalhes de forma confiável apesar de condições adversas de transmissão.

Citação: Soliman, F.A., Ragab, D.A., El-Shafai, W. et al. Hybrid deep learning framework for image restoration in Fso systems affected by log-normal fading. Sci Rep 16, 14653 (2026). https://doi.org/10.1038/s41598-026-39768-x

Palavras-chave: comunicação óptica em espaço livre, remoção de ruído de imagem, aprendizado profundo, turbulência atmosférica, restauração de imagem