Clear Sky Science · it

Framework ibrido di deep learning per il restauro di immagini in sistemi FSO affetti da fading log-normale

Perché è importante per le immagini di tutti i giorni

Man mano che sempre più aspetti della nostra vita si spostano online, ci aspettiamo che foto e video arrivino istantanei e nitidi—sia che provengano da uno scanner medico, da una telecamera di sicurezza o da un satellite. Ma quando queste immagini vengono trasmesse nell’aria tramite fasci di luce, l’atmosfera può alterarle, trasformando scene nitide in immagini granulose e slavate. Questo studio esplora come una combinazione di deep learning moderno e tecniche classiche di affinamento possa recuperare quelle immagini danneggiate, ripristinando dettagli fini anche quando il canale di trasmissione è molto ostile.

Inviare immagini attraverso l’aria con la luce

Il lavoro si concentra sulla comunicazione Free Space Optical (FSO), una tecnologia che trasmette dati usando fasci di luce strettamente focalizzati invece delle onde radio. L’FSO è attraente perché può trasportare enormi quantità di informazione—ideale per immagini e video ad alta risoluzione—senza richiedere una licenza radio. Tuttavia, l’aria tra trasmettitore e ricevitore è raramente calma. Variazioni di temperatura, vento e turbolenze fanno sfarfallare il fascio e ne fanno variare l’intensità, un fenomeno che gli autori descrivono statisticamente come fading log-normale. Se combinato con rumore elettronico e schemi di modulazione densi usati per infilare più informazione nel fascio, questi disturbi possono degradare gravemente la qualità dell’immagine.

Limiti dei rimedi tradizionali

Gli ingegneri hanno a lungo cercato di contrastare questi disturbi con tecniche come multiple antenne (MIMO), schemi di diversità che inviano informazioni simili lungo percorsi diversi, ottiche adattive che rimodellano il fascio in tempo reale e filtri sofisticati come i filtri Gaussiani e di Wiener. Pur essendo utili, questi metodi faticano quando l’ambiente cambia rapidamente o si comporta in modo complesso e non lineare. Possono attenuare parte del rumore ma spesso sfocano bordi e texture importanti, e non sono sufficientemente flessibili per annullare completamente il fading casuale e rapidamente variabile che affligge i collegamenti FSO reali.

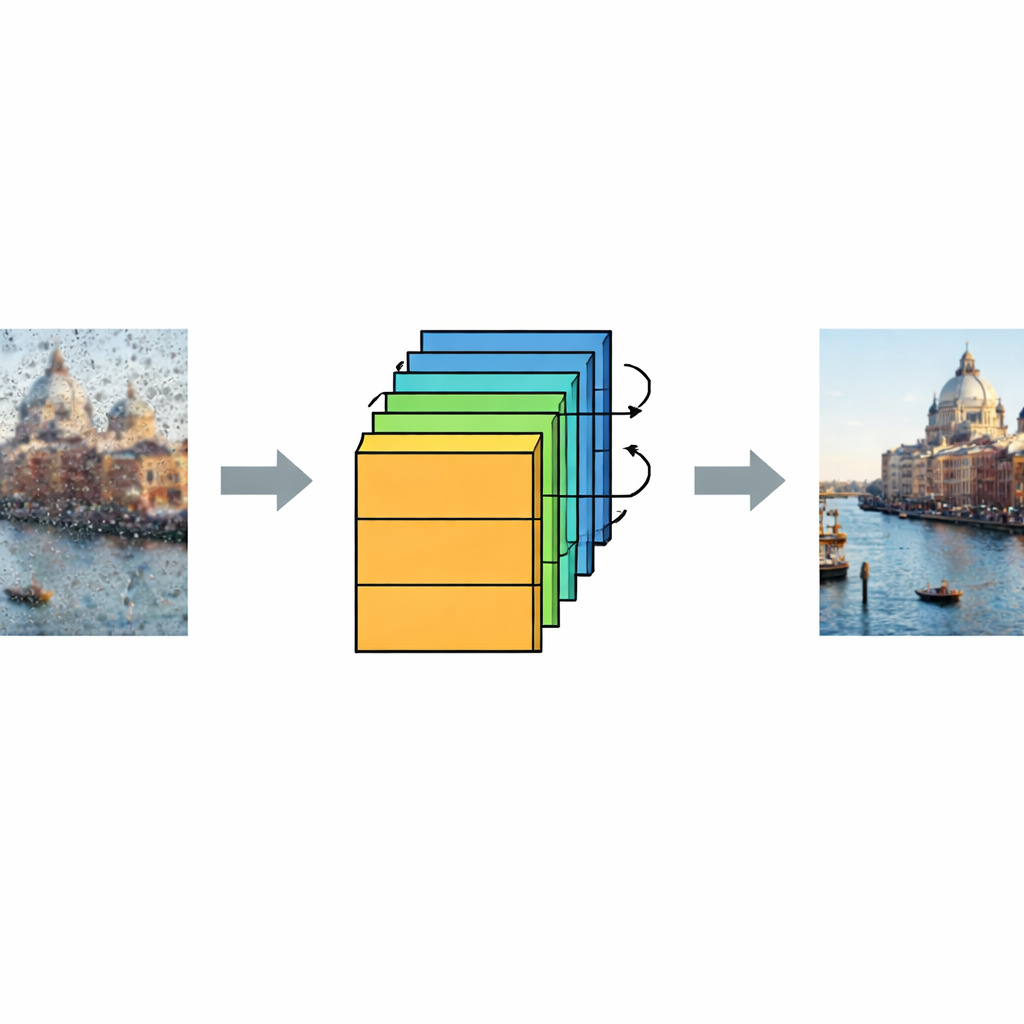

Una macchina che impara a comprendere la distorsione

Per superare questi limiti, gli autori progettano una rete neurale convoluzionale profonda (DCNN) che impara, dagli esempi, come il fading e il rumore danneggiano tipicamente le immagini. Creano un grande dataset sintetico di 30.000 immagini utilizzando generatori di immagini AI, quindi simulano matematicamente come un collegamento FSO con fading log-normale e rumore aggiunto le corromperebbe. Metà delle immagini vengono mantenute pulite e metà degradate e rumorose, coprendo un’ampia gamma di condizioni segnale-rumore. Durante l’addestramento, la DCNN vede molte coppie di immagini danneggiate e originali e impara gradualmente a stimare e sottrarre il pattern di rumore, usando una pila di 22 strati e blocchi residui ripetuti che si specializzano nel separare la struttura reale dalla distorsione.

Affinare i dettagli e verificare l’affidabilità

Dopo che la DCNN rimuove la maggior parte del rumore e degli effetti di fading, gli autori aggiungono uno stadio dedicato di sharpening che esalta bordi e strutture fini che potrebbero essere state ammorbidite durante il processo. Questa pipeline in due fasi—denoising seguito da sharpening—si rivela cruciale per produrre immagini che non solo ottengono buoni punteggi numerici ma risultano anche chiare agli osservatori umani. Il team valuta la qualità usando Peak Signal-to-Noise Ratio (PSNR) e Root Mean Square Error (RMSE), metriche standard che confrontano le immagini restaurate con le versioni originali. In condizioni simulate difficili, dove le immagini degradate possono scendere attorno a 7–9 dB PSNR, le immagini restaurate salgono fino a circa 67–68 dB, decisamente nell’intervallo “eccellente” e ben oltre quanto ottengono i filtri tradizionali.

Test su classificazione e casi simili al mondo reale

Per assicurarsi che le immagini restaurate non siano solo esteticamente migliori ma anche utili per analisi successive, gli autori addestrano reti residuali profonde (ResNet-18, ResNet-50 e ResNet-101) a distinguere tra immagini degradate e pulite. Questi classificatori raggiungono oltre il 99,8% di accuratezza, confermando che il dataset è ben strutturato e che il processo di restauro preserva pattern visivi significativi. Il framework viene inoltre testato su immagini non viste durante l’addestramento, incluso un ritratto umano reale inviato tramite un link FSO simulato. Anche in questi casi sfidanti, il modello migliora nettamente la chiarezza, dimostrando di aver imparato principi generali di restauro piuttosto che aver semplicemente memorizzato esempi di training.

Cosa significa per i sistemi di imaging del futuro

Per un non specialista, la conclusione principale è che gli autori hanno costruito un sistema intelligente di “salvataggio delle immagini” che può prendere foto gravemente danneggiate inviate attraverso aria turbolenta e farle sembrare quasi buone come gli originali. Combinando una rete profonda appresa con un passaggio finale di sharpening, il metodo trasforma volti e scene rumorosi e sfocati in immagini nitide e dettagliate. Questo approccio potrebbe rafforzare applicazioni future che vanno dalla telemedicina e diagnostica remota alla sorveglianza e all’osservazione della Terra, dove le decisioni dipendono dall’essere in grado di vedere piccoli dettagli in modo affidabile nonostante condizioni di trasmissione difficili.

Citazione: Soliman, F.A., Ragab, D.A., El-Shafai, W. et al. Hybrid deep learning framework for image restoration in Fso systems affected by log-normal fading. Sci Rep 16, 14653 (2026). https://doi.org/10.1038/s41598-026-39768-x

Parole chiave: comunicazione ottica in spazio libero, rimozione del rumore delle immagini, deep learning, turbolenza atmosferica, restauro delle immagini