Clear Sky Science · de

Hybrides Deep-Learning-Framework zur Bildwiederherstellung in FSO-Systemen bei log-normaler Auslöschung

Warum das für alltägliche Bilder wichtig ist

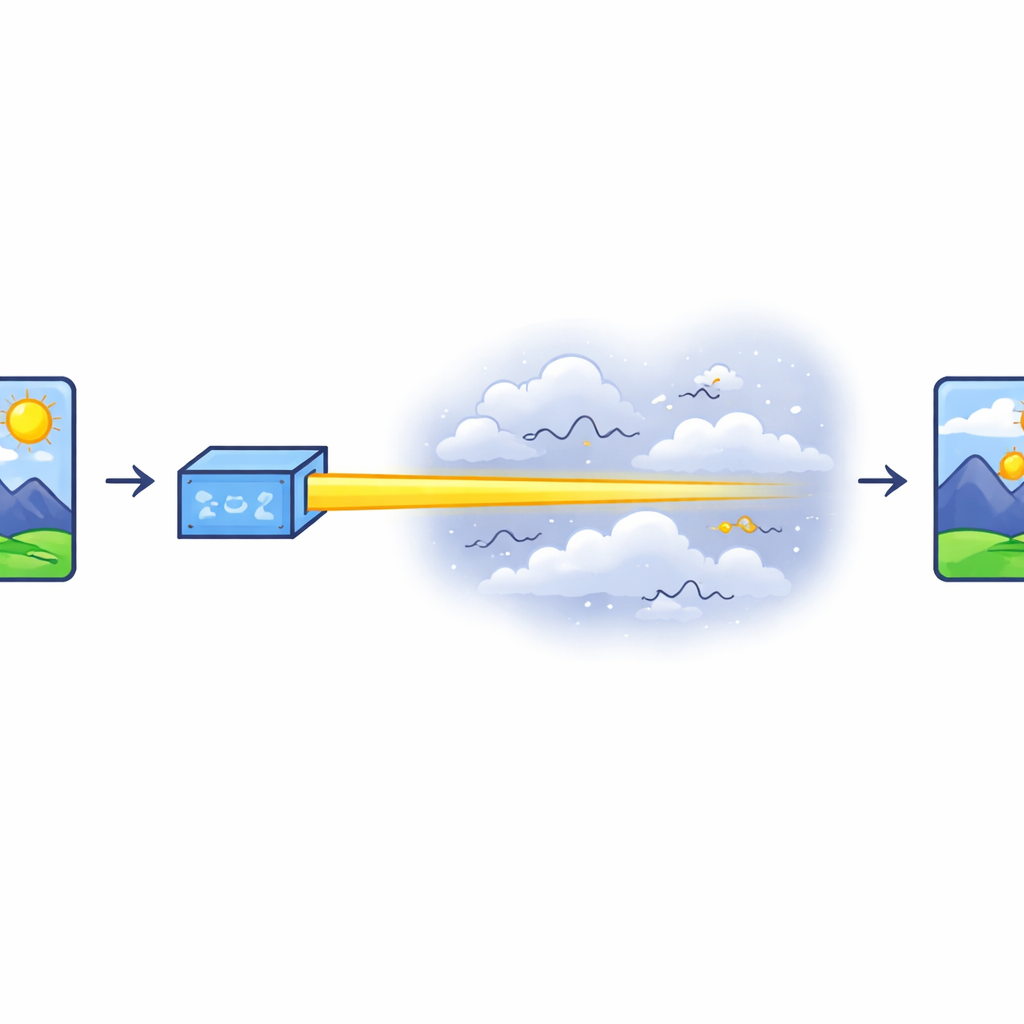

Da immer mehr Bereiche unseres Lebens online stattfinden, erwarten wir, dass Fotos und Videos sofort und klar ankommen – egal, ob sie von einem medizinischen Scanner, einer Überwachungskamera oder einem Satelliten stammen. Werden diese Bilder jedoch per Lichtstrahl durch die Luft gesendet, kann die Atmosphäre sie verfälschen und scharfe Szenen in körnige, ausgebleichte Aufnahmen verwandeln. Diese Studie untersucht, wie eine Kombination aus modernem Deep Learning und klassischen Bildschärfungsverfahren solche beschädigten Bilder retten kann, wobei feine Details selbst bei sehr ungünstigen Übertragungskanälen wiederhergestellt werden.

Bilder per Licht durch die Luft senden

Die Arbeit konzentriert sich auf Free Space Optical (FSO) Kommunikation, eine Technik, die Daten mit eng gebündelten Lichtstrahlen statt mit Radiowellen überträgt. FSO ist attraktiv, weil es große Mengen an Informationen transportieren kann – ideal für hochauflösende Bilder und Video – ohne eine Funklizenz zu benötigen. Die Luft zwischen Sender und Empfänger ist jedoch selten ruhig. Temperaturschwankungen, Wind und Turbulenzen lassen den Lichtstrahl flackern und in der Stärke variieren, ein Phänomen, das die Autoren statistisch als log-normale Auslöschung beschreiben. In Kombination mit elektronischem Rauschen und dichten Kodierschemata, die mehr Daten in den Strahl pressen, können diese Verzerrungen die Bildqualität stark verschlechtern.

Grenzen traditioneller Reinigungsmethoden

Ingenieure versuchen seit langem, diese Verzerrungen mit Techniken wie mehreren Antennen (MIMO), Diversity-Schemata, die ähnliche Informationen über verschiedene Pfade senden, adaptiver Optik, die den Strahl in Echtzeit formt, und ausgefeilten Filtern wie Gauß- und Wiener-Filtern zu bekämpfen. Zwar helfen diese Verfahren, doch stoßen sie an ihre Grenzen, wenn sich die Umgebung schnell ändert oder komplex und nichtlinear reagiert. Sie können Teile des Rauschens glätten, verwischen dabei aber oft wichtige Kanten und Texturen und sind nicht flexibel genug, um die zufällige, schnell schwankende Auslöschung in realen FSO-Verbindungen vollständig rückgängig zu machen.

Eine lernende Maschine, die Verzerrung versteht

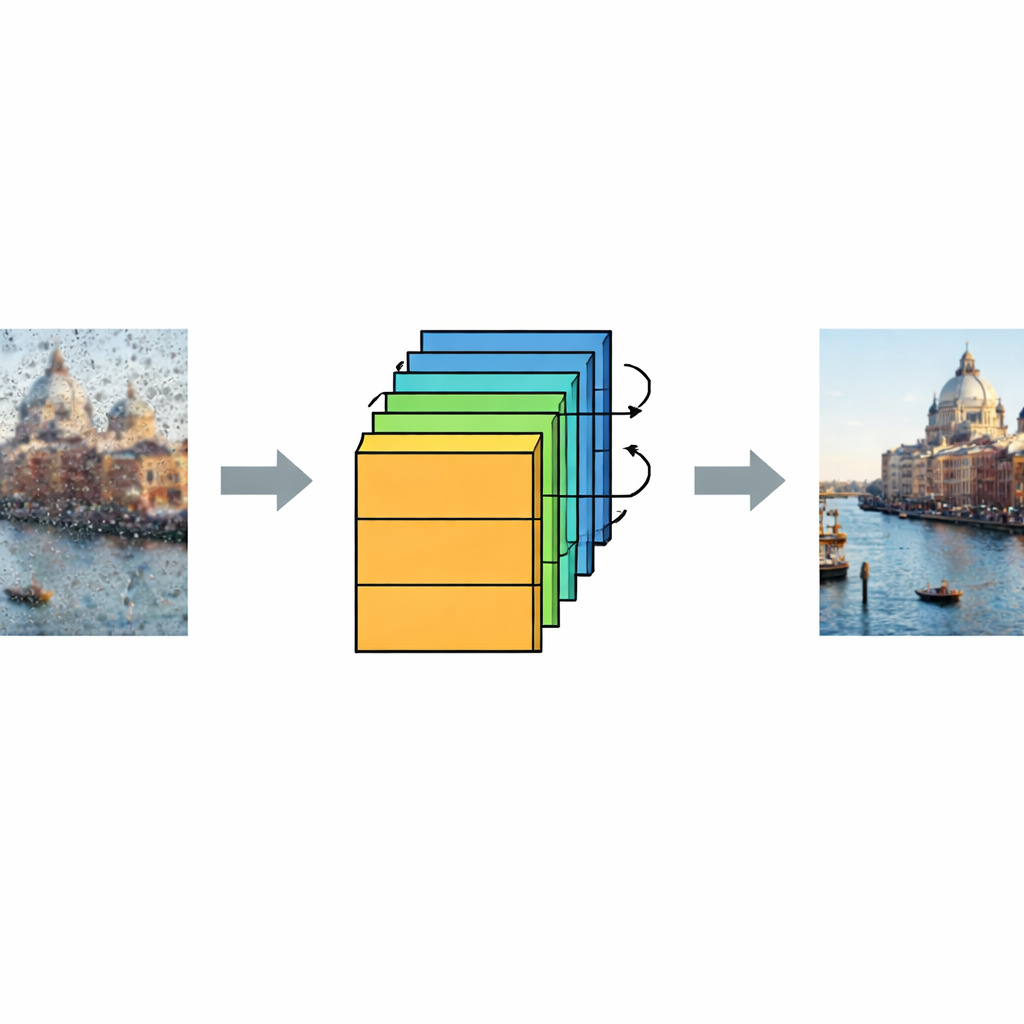

Um diese Grenzen zu überwinden, entwerfen die Autoren ein tiefes konvolutionales neuronales Netz (DCNN), das aus Beispielen lernt, wie Auslöschung und Rauschen Bilder typischerweise beschädigen. Sie erstellen einen großen synthetischen Datensatz von 30.000 Bildern mit KI-Bildgeneratoren und simulieren dann mathematisch, wie ein FSO-Kanal mit log-normaler Auslöschung und zusätzlichem Rauschen diese Bilder korrumpieren würde. Die Hälfte der Bilder bleibt sauber, die andere Hälfte ist ausgebleicht und verrauscht und deckt ein breites Spektrum an Signal-Rausch-Verhältnissen ab. Während des Trainings sieht das DCNN viele Paare aus beschädigten und Originalbildern und lernt schrittweise, das Rauschen zu schätzen und zu subtrahieren, wobei ein Stapel aus 22 Schichten und wiederholte Residualblöcke spezialisiert darauf sind, echte Strukturen von Verzerrungen zu trennen.

Details schärfen und Verlässlichkeit prüfen

Nachdem das DCNN den größten Teil des Rauschens und der Auslöschung entfernt hat, fügen die Autoren einen speziellen Schärfungsschritt hinzu, der Kanten und feine Strukturen hervorhebt, die unterwegs abgeschwächt worden sein könnten. Diese zweistufige Pipeline – Entrauschung gefolgt von Schärfung – erweist sich als entscheidend, um Bilder zu erzeugen, die nicht nur numerisch gut abschneiden, sondern auch für menschliche Betrachter klar aussehen. Das Team bewertet die Qualität mit Peak Signal-to-Noise Ratio (PSNR) und Root Mean Square Error (RMSE), Standardmetriken, die die wiederhergestellten Bilder mit ihren Originalen vergleichen. Unter harten simulierten Bedingungen, bei denen die ausgebleichten Bilder auf etwa 7–9 dB PSNR fallen können, steigen die wiederhergestellten Bilder auf rund 67–68 dB, was deutlich im ‚ausgezeichneten‘ Bereich liegt und weit über dem liegt, was traditionelle Filter erreichen.

Tests für Klassifikation und realitätsnahe Fälle

Um sicherzustellen, dass die wiederhergestellten Bilder nicht nur ästhetisch sind, sondern sich auch für weitere Analysen eignen, trainieren die Autoren tiefe ResNet-Netzwerke (ResNet-18, ResNet-50 und ResNet-101), um zwischen ausgebleichten und sauberen Bildern zu unterscheiden. Diese Klassifikatoren erreichen über 99,8 % Genauigkeit, was bestätigt, dass der Datensatz gut strukturiert ist und der Wiederherstellungsprozess bedeutungsvolle visuelle Muster erhält. Das Framework wird zudem an Bildern getestet, die während des Trainings nicht gesehen wurden, einschließlich eines echten menschlichen Porträts, das durch einen simulierten FSO-Kanal geschickt wurde. Selbst in diesen anspruchsvollen Fällen verbessert das Modell die Bildklarheit deutlich und zeigt, dass es allgemeine Prinzipien der Wiederherstellung gelernt hat, statt nur Trainingsbeispiele zu memorieren.

Was das für zukünftige Bildgebungssysteme bedeutet

Für Nicht-Fachleute lautet die Kernaussage: Die Autoren haben ein intelligentes „Bildrettungs“-System entwickelt, das stark beschädigte Bilder, die durch turbulente Luft gesendet wurden, nehmen und sie fast wieder wie das Original aussehen lassen kann. Durch die Kombination eines gelernten tiefen Netzes mit einem abschließenden Schärfungsschritt verwandelt die Methode verrauschte, ausgebleichte Gesichter und Szenen zurück in klare, detaillierte Bilder. Dieser Ansatz könnte künftige Anwendungen stärken, von Telemedizin und Ferndiagnostik bis hin zu Überwachung und Erdbeobachtung, wo Entscheidungen davon abhängen, kleine Details zuverlässig trotz schwieriger Übertragungsbedingungen zu erkennen.

Zitation: Soliman, F.A., Ragab, D.A., El-Shafai, W. et al. Hybrid deep learning framework for image restoration in Fso systems affected by log-normal fading. Sci Rep 16, 14653 (2026). https://doi.org/10.1038/s41598-026-39768-x

Schlüsselwörter: Freiraumoptische Kommunikation, Bildentrauschung, Deep Learning, atmosphärische Turbulenzen, Bildwiederherstellung