Clear Sky Science · pl

Adaptacyjne planowanie w czujnikach IoT wspomagane przez LLM dla optymalizacji wydajności sieci

Dlaczego inteligentniejsze czujniki mają znaczenie

Miliardy drobnych czujników obserwują dziś nasze domy, miasta, gospodarstwa, fabryki, a nawet nasze ciała. Cicho przesyłają odczyty temperatury, alerty ruchu, tętno i inne dane przez sieci bezprzewodowe. Ten nieustanny strumień informacji może jednak łatwo przytłoczyć system: łącza się zatykają, baterie szybko się wyczerpują, a ważne komunikaty mogą zostać opóźnione lub utracone. W artykule badane jest, jak nowy typ sztucznej inteligencji, oparty na dużych modelach językowych (LLM), może działać jak inteligentny kontroler ruchu dla tych czujników, decydując, co należy wysłać, kiedy i z jaką mocą, aby cała sieć działała płynniej i wydajniej.

Problem z ciągłym monitorowaniem

Współczesny Internet rzeczy (IoT) często działa bardzo prosto: czujniki zbierają dane i wysyłają je ciągle, niezależnie od tego, czy informacja jest nowa, pilna czy w ogóle użyteczna. Gdy tysiące takich urządzeń dzielą tę samą sieć, powtarzające się i nadmiarowe komunikaty zatykają pasmo. Prowadzi to do opóźnień, utraty pakietów i marnowania energii baterii, zwłaszcza w urządzeniach zasilanych bateryjnie lub pracujących w odległych lokalizacjach. Tradycyjne metody sterowania, opierające się na stałych regułach lub podstawowej statystyce, zawodzą, gdy kształt sieci, obciążenie ruchem i warunki radiowe ciągle się zmieniają. W efekcie ważne zdarzenia mogą zostać opóźnione, podczas gdy mało istotne dane zajmują dużą część ograniczonej energii i przepustowości.

Model językowy jako harmonogramujący czujników

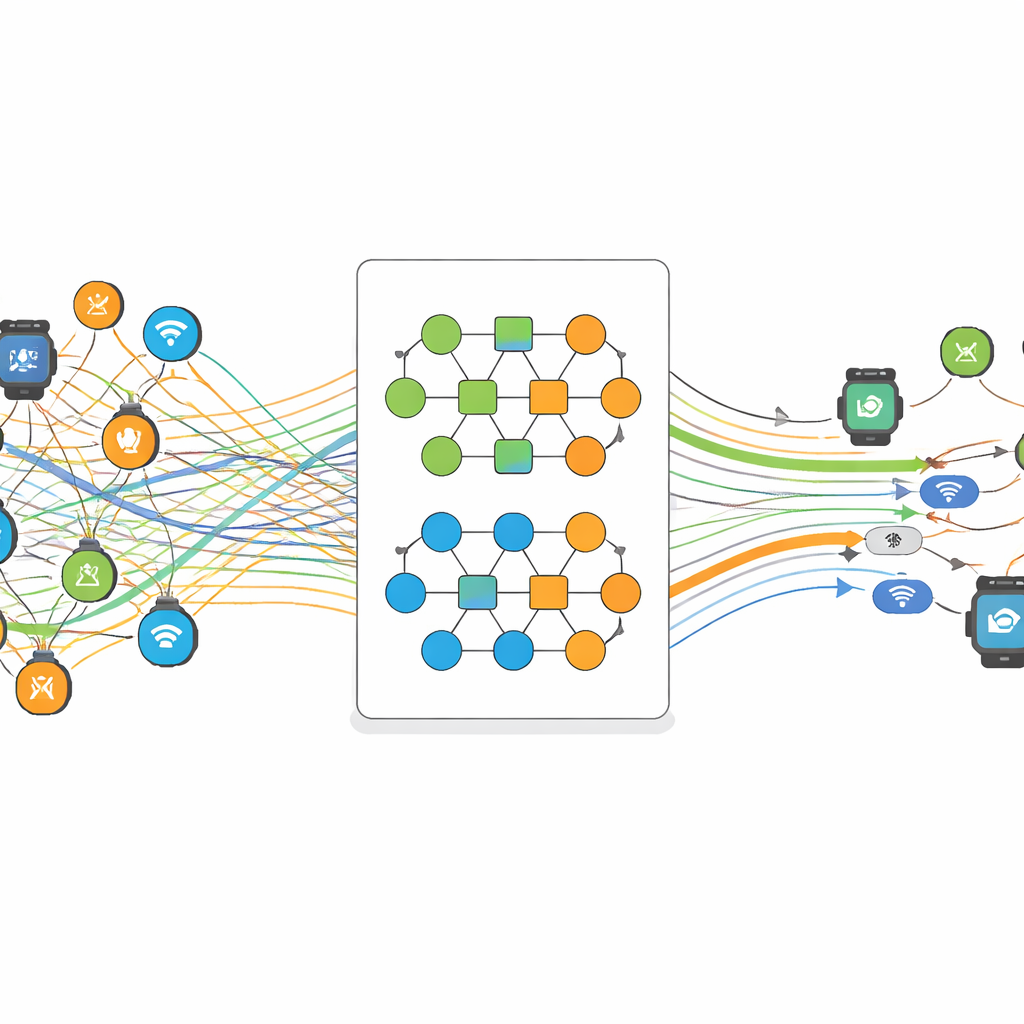

Autorzy proponują schemat nazwany LLM-AS (LLM-Enabled Adaptive Scheduling), który traktuje sieć IoT jak coś, o czym można rozumować w stylu języka naturalnego. Odczyty czujników, poziomy baterii, jakość sygnału i niedawna historia są przekształcane w uporządkowane opisy i przekazywane do LLM (GPT-J-6B) działającego na pobliskim komputerze brzegowym. Zamiast tego, by czujniki podejmowały ślepe, stałe decyzje, LLM analizuje kontekst i zwraca prawdopodobieństwo, czy dany czujnik powinien teraz transmitować, czy poczekać. Osobny algorytm planujący przekształca to zalecenie w rzeczywistą decyzję tak/nie, przestrzegając podstawowych zasad: ważne dane muszą w końcu zostać wysłane, siła sygnału musi być wystarczająca dla niezawodnej transmisji, a baterie nie mogą zostać rozładowane do zera.

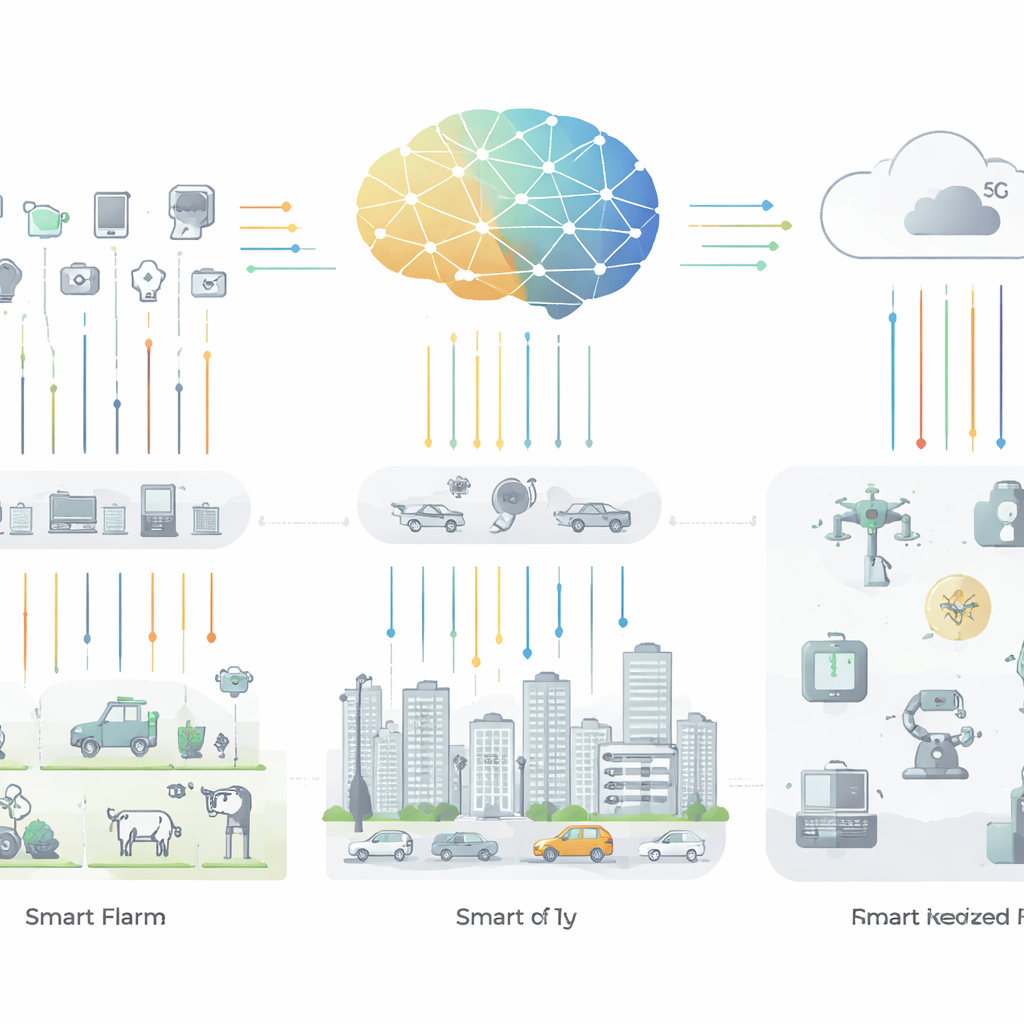

Warstwy inteligentnej kontroli w sieci

LLM-AS jest zorganizowany w cztery warstwy. Na dole warstwa „kognitywnego czujnika” zbiera dane takie jak temperatura, ruch i pozycja. Powyżej znajdują się bramki, które grupują i przekazują te odczyty do węzłów brzegowych. Węzły brzegowe hostują logikę opartą na LLM, która oczyszcza i interpretuje przychodzące dane, ucząc się, które sytuacje są normalne, a które wskazują na problemy, takie jak kongestia, awarie czy nietypowe zachowania. Na szczycie warstwa 5G na krawędzi uruchamia rutyny optymalizacyjne, które równocześnie bilansują trzy cele: redukcję zużycia energii, skrócenie opóźnień i ograniczenie utraty danych. Poprzez ciągłe dostosowywanie, kiedy czujniki transmitują i z jaką mocą, system zmniejsza powtarzalne komunikaty, jednocześnie przechwytując kluczowe zdarzenia istotne dla zastosowań takich jak inteligentne domy czy zdalne monitorowanie zdrowia.

Jak system był testowany

Aby przetestować LLM-AS, badacze wykorzystali znany zbiór rzeczywistych danych z czujników nazwany zbiorem CASAS, który zawiera odczyty z inteligentnych domów i podobnych środowisk. Zbudowali symulacje, w których świadomość kontekstu — czułość modelu na zmiany warunków — mogła być regulowana od bardzo niskiej do bardzo wysokiej. W miarę jak model stawał się bardziej świadomy kontekstu, uczył się unikać wysyłania niepotrzebnych pakietów, zmniejszając średnie zużycie energii na transmisje i skracając opóźnienia. Badanie wykazało, że mediana mocy transmisji poprawiła się niemal o 60 procent, a mediana opóźnienia spadła nawet do 60 procent w porównaniu z punktem odniesienia, który nie korzystał z optymalizacji opartej na LLM. System osiągnął również silne wyniki statystyczne w rozróżnianiu warunków sieci zdrowych od problematycznych, z wysoką precyzją i czułością oraz niskim współczynnikiem błędów, co sugeruje, że jego decyzje są spójne i wiarygodne w wielu scenariuszach.

Co to oznacza dla codziennego życia połączonego urządzeń

Mówiąc prosto, praca ta pokazuje, jak zaawansowany model językowy może działać jak sprytny dyspozytor dla ogromnych flot czujników, decydując, kiedy każdy z nich powinien się odezwać, a kiedy może pozostać cicho. Ograniczając redundantne „plotkowanie”, a jednocześnie zachowując terminowość i dokładność ważnych sygnałów, LLM-AS pomaga oszczędzać żywotność baterii, zmniejszać zatłoczenie i lepiej wykorzystywać pojemność sieci bezprzewodowej. Jeśli podejścia te zostaną udoskonalone i zwalidowane na większej liczbie zbiorów danych oraz w rzeczywistych wdrożeniach, mogą uczynić przyszłe inteligentne domy, szpitale, gospodarstwa i miasta bardziej responsywnymi i niezawodnymi — bez potrzeby ciągłego ręcznego dostrajania ustawień sieciowych.

Cytowanie: Khan, M.N., Lee, S., Lee, S.S. et al. LLM-enabled adaptive scheduling in IoT sensing for optimized network performance. Sci Rep 16, 13007 (2026). https://doi.org/10.1038/s41598-025-32660-0

Słowa kluczowe: Internet rzeczy, harmonogramowanie czujników, energooszczędne sieci, sztuczna inteligencja na krawędzi, duże modele językowe