Clear Sky Science · es

Programación adaptativa habilitada por LLM en la detección IoT para optimizar el rendimiento de la red

Por qué importan los sensores más inteligentes

Miles de millones de diminutos sensores vigilan ahora nuestros hogares, ciudades, granjas, fábricas e incluso nuestros cuerpos. Envían silenciosamente lecturas de temperatura, alertas de movimiento, ritmos cardíacos y más a través de redes inalámbricas. Pero ese flujo continuo de información puede fácilmente saturar el sistema: los enlaces se congestionan, las baterías se agotan rápidamente y los mensajes importantes pueden retrasarse o perderse. Este artículo explora cómo un nuevo tipo de inteligencia artificial, basado en modelos de lenguaje de gran tamaño (LLM), puede actuar como un controlador de tráfico inteligente para esos sensores, decidiendo qué debe enviarse, cuándo y con qué nivel de potencia para que toda la red funcione de forma más fluida y eficiente.

El problema del muestreo siempre activo

El Internet de las Cosas (IoT) actual suele operar de forma muy simple: los sensores recopilan datos y los envían de forma continua, independientemente de si la información es nueva, urgente o incluso útil. Cuando miles de dispositivos comparten la misma red, mensajes repetidos y redundantes saturan el espectro. Esto provoca retrasos, pérdida de paquetes y desperdicio de energía de la batería, especialmente en dispositivos remotos o alimentados por batería. Los métodos de control tradicionales, que dependen de reglas fijas o estadísticas básicas, tienen dificultades cuando la topología de la red, la carga de tráfico y las condiciones de radio cambian con el tiempo. Como resultado, los eventos importantes pueden retrasarse, mientras que los datos poco relevantes consumen gran parte de la energía y el ancho de banda limitados.

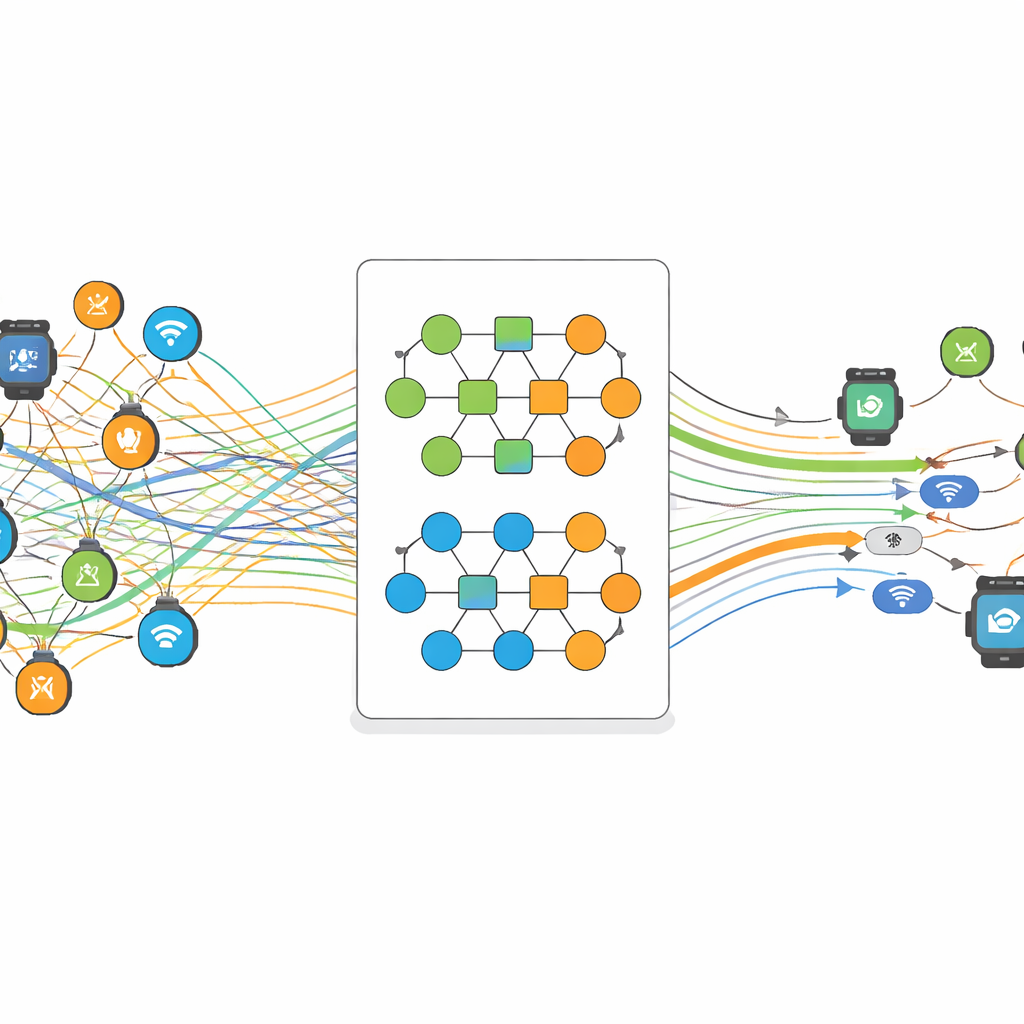

Un modelo de lenguaje como planificador de sensores

Los autores proponen un esquema denominado LLM-AS (Programación Adaptativa habilitada por LLM), que trata la red IoT como algo que puede razonarse en estilo de lenguaje natural. Las lecturas de los sensores, sus niveles de batería, la calidad de la señal y el historial reciente se transforman en descripciones estructuradas y se entregan a un LLM (GPT-J-6B) ejecutándose en un equipo edge cercano. En lugar de que los sensores tomen decisiones ciegas y fijas, el LLM analiza el contexto y emite una probabilidad de que un sensor dado deba transmitir ahora o esperar. Un algoritmo de programación separado transforma esta recomendación en una decisión real de sí o no, obedeciendo reglas básicas: los datos importantes deben enviarse eventualmente, la potencia de la señal debe ser suficiente para una transmisión fiable y las baterías no deben agotarse hasta cero.

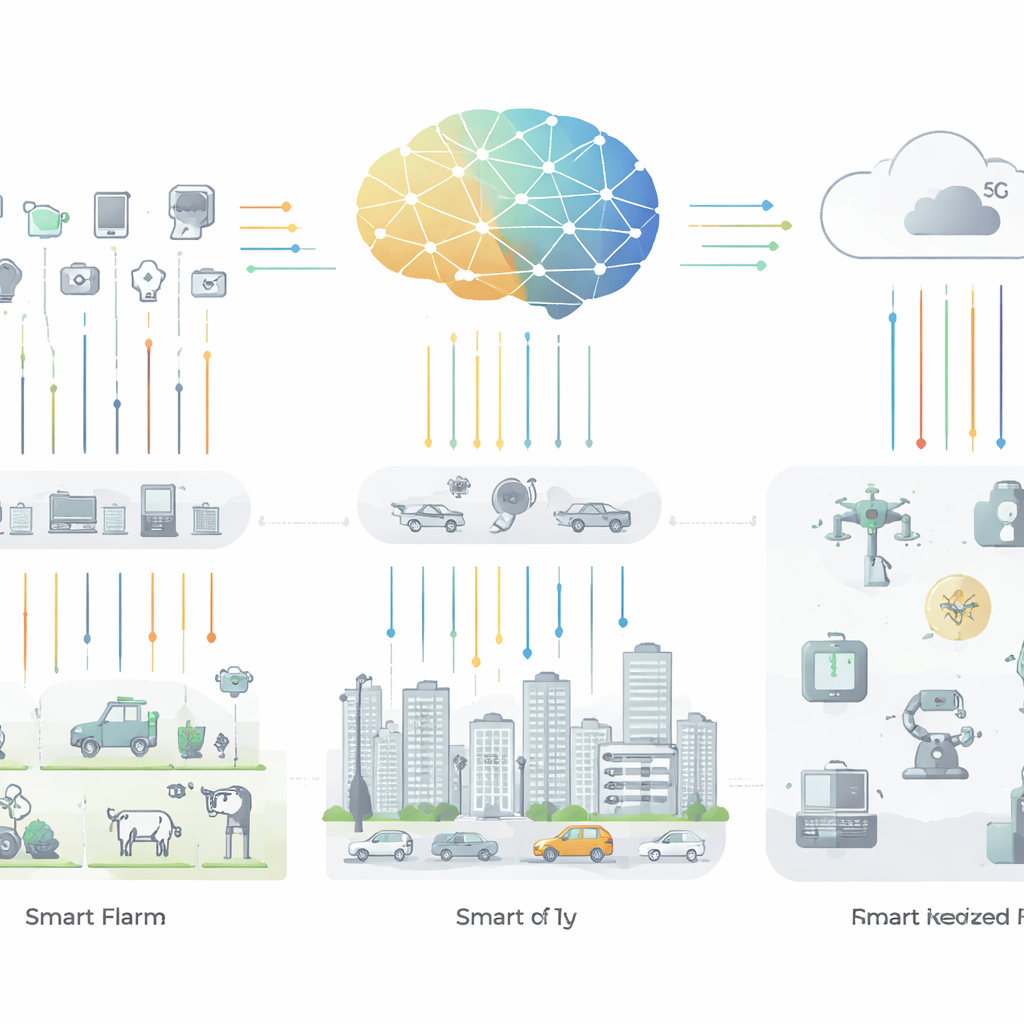

Capas de control inteligente en la red

LLM-AS se organiza en cuatro capas. En la base, una capa de “sensor cognitivo” recopila datos como temperatura, movimiento y ubicación. Encima, dispositivos gateway agrupan y reenvían estas lecturas a nodos edge. Los nodos edge alojan la lógica basada en LLM que limpia e interpreta los datos entrantes, aprendiendo qué situaciones son normales y cuáles indican problemas como congestión, fallos o comportamientos inusuales. En la cima, una capa edge 5G ejecuta rutinas de optimización que equilibran tres objetivos a la vez: reducir el consumo energético, disminuir la latencia y limitar la pérdida de datos. Al ajustar continuamente cuándo transmiten los sensores y con qué potencia, el sistema reduce mensajes repetitivos sin dejar de capturar los eventos clave que importan para aplicaciones como hogares inteligentes y monitorización remota de la salud.

Cómo se probó el sistema

Para evaluar LLM-AS, los investigadores utilizaron una conocida colección de datos reales de sensores llamada conjunto de datos CASAS, que incluye lecturas de hogares inteligentes y entornos similares. Construyeron simulaciones donde la conciencia de contexto—la sensibilidad del modelo a cambios en las condiciones—podía ajustarse de muy baja a muy alta. A medida que el modelo se volvió más consciente del contexto, aprendió a evitar el envío de paquetes innecesarios, reduciendo la energía media utilizada para las transmisiones y acortando las demoras. El estudio informa que la potencia de transmisión mediana mejoró en casi un 60% y la latencia mediana descendió hasta un 60% en comparación con una línea base que no utilizaba la optimización basada en LLM. El sistema también alcanzó sólidas métricas estadísticas para distinguir condiciones de red sanas de problemáticas, con alta precisión y recuperación y una baja tasa de error, lo que sugiere que sus decisiones son coherentes y fiables en muchos escenarios.

Qué significa esto para la vida conectada cotidiana

En términos sencillos, este trabajo muestra cómo un modelo de lenguaje avanzado puede actuar como un despachador inteligente para vastas flotas de sensores, decidiendo cuándo cada uno debe intervenir y cuándo es seguro mantenerse en silencio. Al reducir el ruido redundante y mantener las señales importantes puntuales y precisas, LLM-AS ayuda a preservar la vida de la batería, disminuir la congestión y aprovechar mejor la capacidad inalámbrica. Si se perfecciona y valida con más conjuntos de datos y en despliegues reales, este tipo de enfoques podría hacer que futuros hogares, hospitales, granjas y ciudades inteligentes sean más receptivos y fiables—sin requerir un ajuste humano constante de la configuración de la red.

Cita: Khan, M.N., Lee, S., Lee, S.S. et al. LLM-enabled adaptive scheduling in IoT sensing for optimized network performance. Sci Rep 16, 13007 (2026). https://doi.org/10.1038/s41598-025-32660-0

Palabras clave: Internet de las Cosas, planificación de sensores, redes eficientes en energía, IA en el borde, modelos de lenguaje de gran tamaño