Clear Sky Science · fr

Planification adaptative activée par LLM dans la détection IoT pour optimiser les performances réseau

Pourquoi des capteurs plus intelligents comptent

Des milliards de petits capteurs surveillent désormais nos maisons, villes, exploitations agricoles, usines et même nos corps. Ils transmettent discrètement des mesures de température, des alertes de mouvement, des rythmes cardiaques et bien d’autres données via des réseaux sans fil. Mais ce flux d’informations en continu peut rapidement submerger le système : les liaisons se congestionnent, les batteries se déchargent vite et des messages importants peuvent être retardés ou perdus. Cet article explore comment un nouveau type d’intelligence artificielle, fondé sur des grands modèles de langage (LLM), peut jouer le rôle de contrôleur de trafic intelligent pour ces capteurs, décidant quoi envoyer, quand et à quel niveau de puissance afin que l’ensemble du réseau fonctionne de manière plus fluide et efficace.

Le problème de la détection en permanence

L’Internet des objets (IoT) d’aujourd’hui fonctionne souvent de façon très simple : les capteurs collectent des données et les envoient en continu, que l’information soit nouvelle, urgente ou même utile. Lorsque des milliers de dispositifs partagent le même réseau, des messages répétés et redondants saturent les ondes. Cela entraîne des retards, des paquets perdus et un gaspillage d’énergie des batteries, en particulier pour les dispositifs éloignés ou alimentés sur batterie. Les méthodes de contrôle traditionnelles, fondées sur des règles fixes ou des statistiques élémentaires, peinent à suivre lorsque la topologie du réseau, la charge de trafic et les conditions radio évoluent avec le temps. En conséquence, des événements importants peuvent être retardés, tandis que des données peu pertinentes consomment une grande partie de l’énergie et de la bande passante limitées.

Un modèle de langage comme ordonnanceur de capteurs

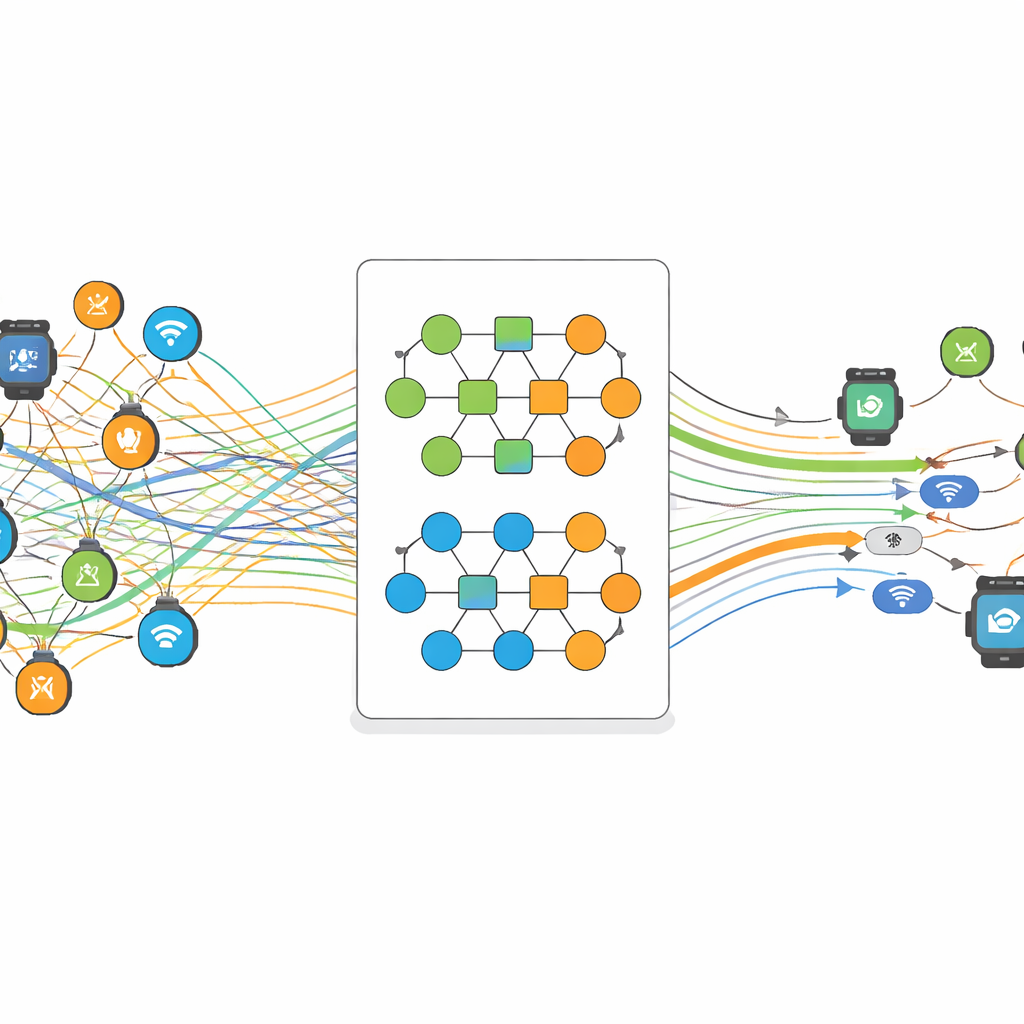

Les auteurs proposent un schéma appelé LLM-AS (LLM-Enabled Adaptive Scheduling), qui considère le réseau IoT comme quelque chose que l’on peut raisonner en langage naturel structuré. Les relevés des capteurs, leurs niveaux de batterie, la qualité du signal et l’historique récent sont transformés en descriptions structurées et fournies à un LLM (GPT-J-6B) exécuté sur un ordinateur de bord proche. Au lieu que les capteurs prennent des décisions aveugles et fixes, le LLM analyse le contexte et produit une probabilité indiquant si un capteur donné doit transmettre maintenant ou attendre. Un algorithme de planification séparé convertit ensuite cette recommandation en une décision binaire effective, tout en respectant des règles de base : les données importantes doivent finir par être envoyées, la puissance du signal doit être suffisante pour une transmission fiable, et les batteries ne doivent pas être vidées jusqu’à zéro.

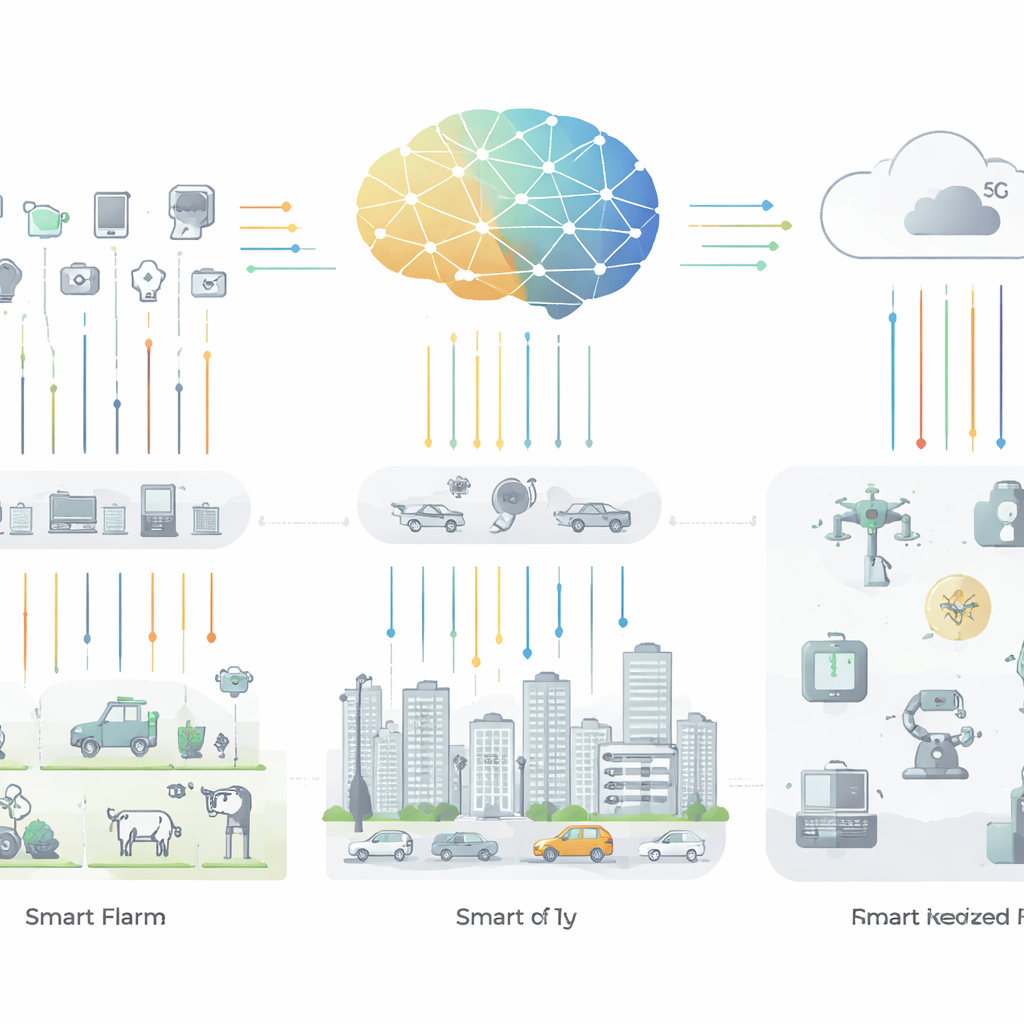

Couches de contrôle intelligent dans le réseau

LLM-AS est organisé en quatre couches. À la base, une couche de « capteurs cognitifs » recueille des données telles que la température, le mouvement et la localisation. Au-dessus, des passerelles regroupent et transmettent ces relevés aux nœuds en périphérie. Les nœuds en périphérie hébergent la logique basée sur le LLM qui nettoie et interprète les données entrantes, apprenant quelles situations sont normales et lesquelles annoncent des problèmes tels que la congestion, des défaillances ou des comportements inhabituels. Au sommet, une couche 5G en périphérie exécute des routines d’optimisation qui équilibrent simultanément trois objectifs : réduire la consommation d’énergie, diminuer les délais et limiter la perte de données. En ajustant en continu quand les capteurs transmettent et avec quelle puissance, le système réduit les messages répétitifs tout en capturant les événements clés importants pour des applications comme les maisons intelligentes et la télésurveillance de la santé.

Comment le système a été testé

Pour tester LLM-AS, les chercheurs ont utilisé une collection reconnue de données réelles de capteurs appelée jeu de données CASAS, qui comprend des relevés provenant de maisons intelligentes et d’environnements similaires. Ils ont construit des simulations où la sensibilité au contexte — la capacité du modèle à détecter les changements de conditions — pouvait être réglée de très faible à très élevée. À mesure que le modèle gagnait en conscience du contexte, il a appris à éviter l’envoi de paquets inutiles, réduisant l’énergie moyenne utilisée pour les transmissions et raccourcissant les délais. L’étude rapporte que la puissance de transmission médiane s’est améliorée de près de 60 % et que le délai médian a chuté jusqu’à 60 % par rapport à une référence qui n’utilisait pas l’optimisation basée sur le LLM. Le système a également atteint de solides scores statistiques pour distinguer des conditions réseau saines de conditions problématiques, avec une précision et un rappel élevés et un faible taux d’erreur, suggérant que ses décisions sont cohérentes et fiables sur de nombreux scénarios.

Ce que cela signifie pour la vie connectée de tous les jours

En termes simples, ce travail montre comment un modèle de langage avancé peut agir comme un répartiteur astucieux pour d’immenses flottes de capteurs, décidant quand chacun doit s’exprimer et quand il est sûr de rester silencieux. En réduisant le bavardage redondant tout en conservant des signaux importants en temps utile et précis, LLM-AS contribue à préserver la durée de vie des batteries, à diminuer la congestion et à mieux exploiter la capacité sans fil. Si ces approches sont affinées et validées sur davantage de jeux de données et en déploiements réels, elles pourraient rendre les futures maisons, hôpitaux, exploitations et villes intelligents plus réactifs et fiables — sans nécessiter de réglages réseau constants par des humains.

Citation: Khan, M.N., Lee, S., Lee, S.S. et al. LLM-enabled adaptive scheduling in IoT sensing for optimized network performance. Sci Rep 16, 13007 (2026). https://doi.org/10.1038/s41598-025-32660-0

Mots-clés: Internet des objets, planification des capteurs, réseaux à faible consommation d'énergie, IA en périphérie, grands modèles de langage