Clear Sky Science · nl

Een dronebeeldendataset voor semantische segmentatie van bodembedekkingen in stads-tuinen voor biodiversiteitsstudies

Waarom stadstuinen van bovenaf ertoe doen

Loop door een buurttuin en je ziet een lappendeken van graspaadjes, moestuinen, mulch, stenen en blootliggende aarde. Al deze “bodembedekkingen” bepalen stilletjes hoe goed tuinen bijen, natuurlijke plaagbestrijding en gezonde grond ondersteunen. Op traditionele kaarten en satellietbeelden vervagen deze fijne details echter. Deze studie laat zien hoe drones en moderne beeldanalysetechnieken inzoomen op stadstuinen met opmerkelijke precisie, en levert een nieuwe open dataset die onderzoekers en planners helpt te begrijpen hoe de bodem onder onze voeten stedelijke biodiversiteit ondersteunt.

Verborgen variatie op de tuingrond

Stadstuinen zijn meer dan decoratieve groene plekken. Hun uiteenlopende bodembedekkingen—zoals kruiden, gras, stro-mulchen, houtsnippers, stenen en blootliggende grond—bieden voedsel en schuilplaatsen voor bestuivers, jachtterrein voor plaagbestrijdende insecten en leefruimte voor bodemdieren. Samen helpen ze nutriënten te laten circuleren, de bodem vast te houden en wildlife te verbinden doorheen anders dichtbebouwde buurten. Omdat deze kenmerken over slechts enkele meters variëren, zijn ze moeilijk vast te leggen met grofmazige satellietbeelden of tijdrovende veldinventarissen, wat een grote informatiekloof achterlaat voor mensen die wilde-dierenvriendelijke steden willen ontwerpen.

Drones als vliezende vergrootglazen

Om deze kloof te dichten vlogen de onderzoekers met een kleine camera-drone over vijf buurttuinen in München, Duitsland, tijdens meerdere bezoeken in 2021 en 2022. Uit 2.521 ruwe foto’s stelden ze 24 ultrascherpe “orthomosaics” samen—kaartachtige beelden waarbij elke pixel op de grond slechts 3,2 tot 7,9 millimeter groot is. Deze mozaïeken tonen individuele planten, paadjes en mulchlagen in hoge detailresolutie. Het team tekende vervolgens met de hand duizenden gebieden na en labelde acht veelvoorkomende typen bodembedekking: gras, kruidachtige planten, litter zoals dode bladeren, blootliggende grond, steen, stro, massief hout (zoals planken en stammen) en losse houtsnippers. De resulterende label-lagen fungeren als referentekaarten voor wat de camera daadwerkelijk op de grond ziet.

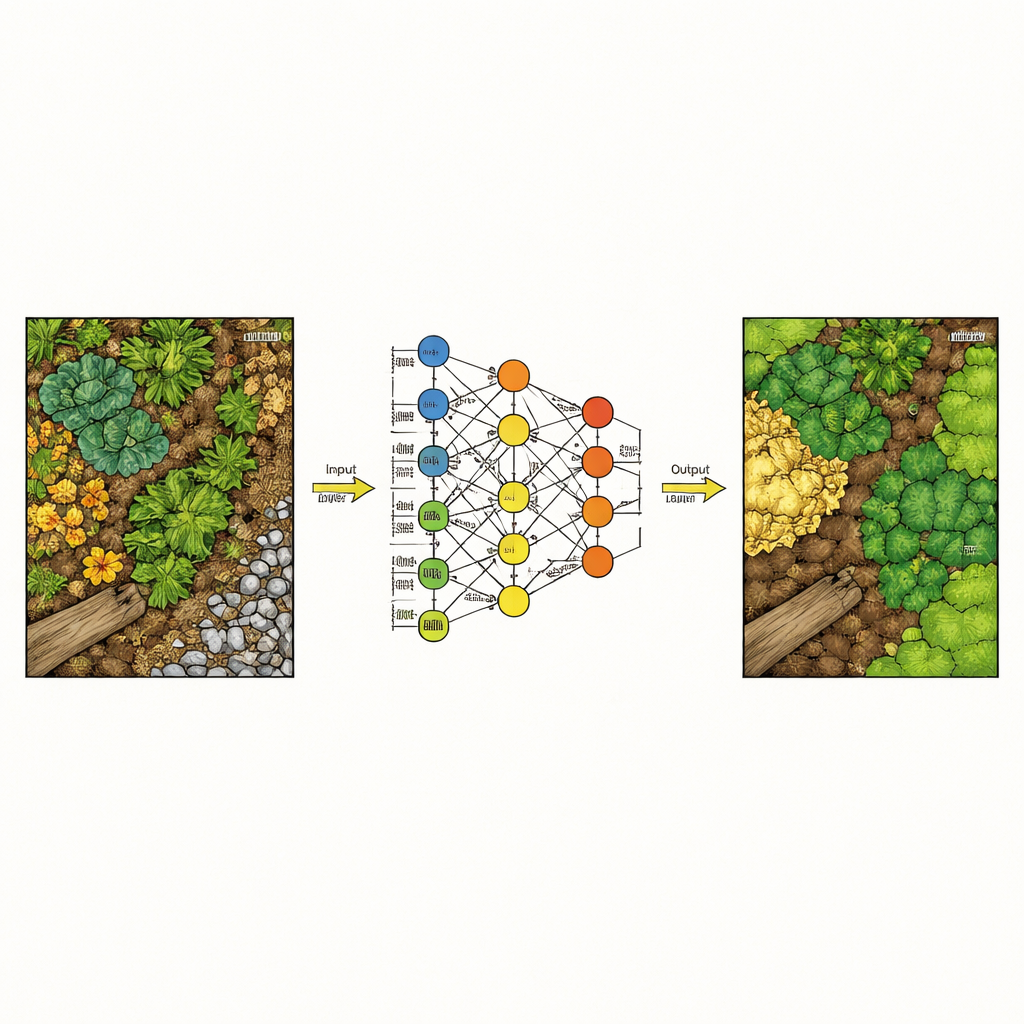

Computers leren tuingronden te lezen

Met deze gelabelde beelden testte het team hoe goed verschillende computermodellen automatisch elk type bodembedekking per pixel kunnen herkennen. Ze vergeleken traditionele technieken, die steunen op handgemaakte textuur- en kleurmaten, met deep-learningbenaderingen die patronen direct uit beeldpatches leren. Om de taak realistisch te houden, verdeelden ze de 24 mozaïeken in aparte trainings-, validatie- en testgroepen zodat modellen altijd werden geëvalueerd op tuinbeelden die ze tijdens het trainen nooit hadden “gezien”. Twee deep-learningmodellen—UNet en vooral DeepLabV3+—presteerden duidelijk beter dan klassieke methoden zoals Random Forests en gradient-boosted trees, en wezen ongeveer 93% van de pixels correct toe en maakten beter onderscheid bij visueel lastige gevallen zoals grond versus steen.

Wat de nieuwe dataset biedt

De kern van dit werk is een vrij beschikbare dataset in plaats van één afgewerkte kaart. Ze bevat de volledige drone-mozaïeken, bijbehorende labelmasks en een op patches gebaseerde versie die gemakkelijker in moderne neurale netwerken te gebruiken is. Een begeleidende metadatatafel vermeldt details zoals vlieghoogte, afbeeldingsgrootte en verwerkingsinstellingen, waardoor de data herbruikbaar is voor vele doeleinden. Onderzoekers kunnen nieuwe algoritmen bouwen, verschillende modelleringsstrategieën vergelijken of deze kaarten combineren met andere informatie—zoals insectentellingen of bodemmonsters—om te onderzoeken hoe specifieke combinaties van bodembedekking bepaalde ecologische voordelen ondersteunen.

Van pixels naar groenere steden

Voor niet-specialisten is de belangrijkste conclusie dat drones nu het fijnmazige weefsel van stadstuinen in voldoende detail kunnen in kaart brengen zodat computers kunnen aangeven waar gras eindigt en houtsnippers beginnen. De studie toont aan dat deep-learningmodellen dit visuele mozaïek kunnen omzetten in betrouwbare kaarten van bodembedekking, die op hun beurt kunnen bijdragen aan beter tuinontwerp en beheer voor biodiversiteit, plaagbestrijding en bodemgezondheid. Door hun data en code openbaar te maken, leggen de auteurs een fundament voor toekomstige hulpmiddelen die tuiniers, stadsplanners en ecologen kunnen helpen zien hoe kleine ontwerpkeuzes op de grond opschalen naar gezondere stedelijke ecosystemen.

Bronvermelding: Afrasiabian, Y., Lu, C., Belwalkar, A. et al. A drone imagery dataset for semantic segmentation of urban garden ground covers in biodiversity studies. Sci Data 13, 590 (2026). https://doi.org/10.1038/s41597-026-07152-z

Trefwoorden: stads-tuinen, dronebeelden, semantische segmentatie, bodembedekking, biodiversiteitsmonitoring