Clear Sky Science · de

Ein Datensatz mit Drohnenbildern zur semantischen Segmentierung von Bodenbedeckungen in Stadtgärten für Biodiversitätsstudien

Warum Stadtgärten aus der Vogelperspektive wichtig sind

Wenn Sie durch einen Gemeinschaftsgarten gehen, sehen Sie ein Mosaik aus Graswegen, Gemüsebeeten, Mulch, Steinen und nackter Erde. All diese „Bodenbedeckungen“ beeinflussen still und leise, wie gut Gärten Bienen unterstützen, die natürliche Schädlingsbekämpfung fördern und einen gesunden Boden erhalten. Auf herkömmlichen Karten und Satellitenbildern gehen diese feinen Details jedoch oft verloren. Diese Studie zeigt, wie Drohnen und moderne Bildanalysemethoden Stadtgärten bis ins Detail erfassen können und stellt einen neuen offenen Datensatz bereit, der Forschenden und Planenden hilft zu verstehen, wie der Boden unter unseren Füßen die städtische Biodiversität stützt.

Verborgene Vielfalt auf dem Gartengrund

Stadtgärten sind mehr als dekorative Grünflächen. Ihre verschiedenen Bodenbedeckungen — wie Kräuter, Rasen, Strohmulch, Holzschnitzel, Steine und freiliegender Boden — bieten Nahrung und Unterschlupf für Bestäuber, Jagdgründe für schädlingsvertilgende Insekten und Lebensraum für Bodenorganismen. Zusammen helfen sie beim Nährstoffkreislauf, halten den Boden an Ort und Stelle und verbinden die Tierwelt über sonst zugebaute Nachbarschaften hinweg. Da diese Strukturen schon über wenige Meter stark variieren, lassen sie sich nur schwer mit grobkörnigen Satellitenbildern oder zeitaufwändigen Feldbegehungen erfassen, was eine große Informationslücke für Personen hinterlässt, die tierfreundliche Städte gestalten möchten.

Drohnen als fliegende Vergrößerungsgläser

Um diese Lücke zu schließen, flogen die Forschenden eine kleine, mit Kamera ausgestattete Drohne über fünf Gemeinschaftsgärten in München, Deutschland, bei mehreren Einsätzen in 2021 und 2022. Aus 2.521 Rohaufnahmen erzeugten sie 24 ultrahochauflösende „Orthomosaike“ — kartengleiche Bilder, in denen jedes Pixel auf dem Boden nur 3,2 bis 7,9 Millimeter breit ist. Diese Mosaike zeigen einzelne Pflanzen, Wege und Mulchschichten in hoher Detailtiefe. Das Team zeichnete anschließend von Hand tausende Bereiche nach und kennzeichnete acht häufige Bodenbedeckungstypen: Gras, krautige Pflanzen, Streu wie abgestorbene Blätter, nackter Boden, Stein, Stroh, massives Holz (wie Bretter und Stämme) und lose Holzschnitzel. Die resultierenden Beschriftungslayer dienen als Referenzkarten dafür, was die Kamera tatsächlich am Boden sieht.

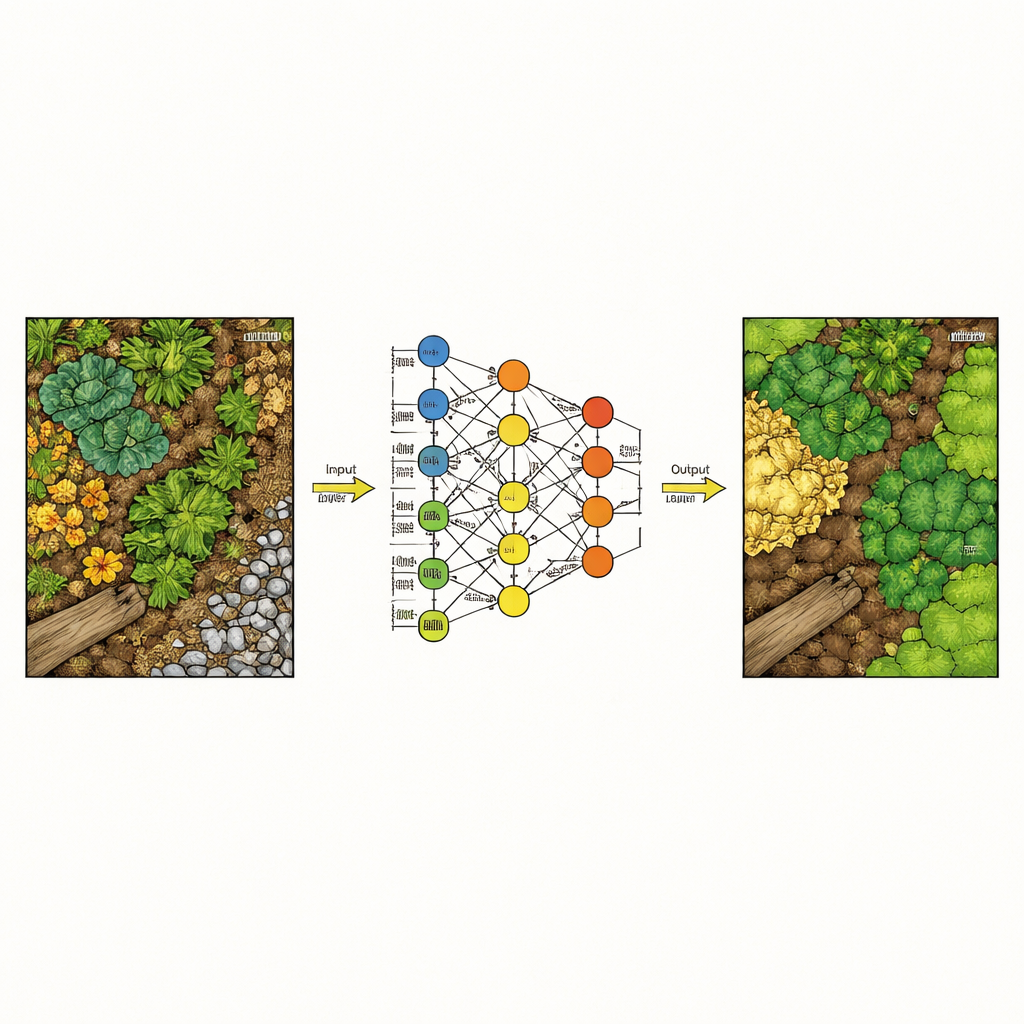

Computern das Lesen von Gartenmustern beibringen

Mit diesen beschrifteten Bildern testete das Team, wie gut verschiedene Computermodelle jeden Bodenbedeckungstyp pixelgenau automatisch erkennen können. Sie verglichen traditionelle Verfahren, die auf handgestalteten Textur- und Farbmerkmalen beruhen, mit Deep-Learning-Ansätzen, die Muster direkt aus Bildausschnitten erlernen. Um die Aufgabe realistisch zu halten, teilten sie die 24 Mosaike in separate Trainings-, Validierungs- und Testgruppen, sodass Modelle stets an Gartenbildern evaluiert wurden, die sie während des Trainings nie „gesehen“ hatten. Zwei Deep-Learning-Modelle — UNet und besonders DeepLabV3+ — übertrafen deutlich klassische Methoden wie Random Forests und gradientenverstärkte Bäume; sie ordneten insgesamt etwa 93 % der Pixel korrekt zu und konnten visuell schwierige Unterscheidungen wie Boden versus Stein deutlich besser handhaben.

Was der neue Datensatz bietet

Der Kern dieser Arbeit ist ein offen verfügbarer Datensatz und nicht eine einzige fertige Karte. Er umfasst die vollständigen Drohnenmosaike, passende Beschriftungs-Masken und eine patch-basierte Version, die sich leichter in moderne Neuronale Netze einspeisen lässt. Eine begleitende Metadatentabelle listet Details wie Flughöhe, Bildgröße und Verarbeitungsparameter auf, sodass die Daten für viele Zwecke wiederverwendbar sind. Forschende können neue Algorithmen entwickeln, verschiedene Modellierungsstrategien vergleichen oder diese Karten mit anderen Informationen — etwa Insektenzählungen oder Bodenproben — kombinieren, um zu untersuchen, wie bestimmte Mischungen von Bodenbedeckungen spezifische ökologische Vorteile unterstützen.

Von Pixeln zu grüneren Städten

Für Nicht-Fachleute ist die wichtigste Erkenntnis, dass Drohnen inzwischen das feinkörnige Gefüge von Stadtgärten so detailliert abbilden können, dass Computer erkennen, wo Rasen endet und Holzschnitzel beginnen. Die Studie zeigt, dass Deep-Learning-Modelle dieses visuelle Mosaik in zuverlässige Karten von Bodenbedeckungen übersetzen können, die wiederum bessere Gestaltung und Pflege von Gärten für Biodiversität, Schädlingskontrolle und Bodengesundheit informieren können. Indem die Autorinnen und Autoren ihre Daten und ihren Code öffentlich zugänglich machen, schaffen sie eine Grundlage für zukünftige Werkzeuge, die Gärtnern, Stadtplanenden und Ökologen helfen könnten zu sehen, wie kleine Designentscheidungen am Boden zu gesünderen urbanen Ökosystemen beitragen.

Zitation: Afrasiabian, Y., Lu, C., Belwalkar, A. et al. A drone imagery dataset for semantic segmentation of urban garden ground covers in biodiversity studies. Sci Data 13, 590 (2026). https://doi.org/10.1038/s41597-026-07152-z

Schlüsselwörter: Stadtgärten, Drohnenbilder, semantische Segmentierung, Bodenbedeckung, Biodiversitätsüberwachung