Clear Sky Science · fr

Un jeu de données d’images par drone pour la segmentation sémantique des couverts de sol des jardins urbains dans les études sur la biodiversité

Pourquoi les jardins de la ville vus d’en haut comptent

En traversant un jardin communautaire, on observe un patchwork de chemins en pelouse, de carrés potagers, de paillage, de pierres et de terre nue. Tous ces « couverts du sol » influencent discrètement la capacité des jardins à soutenir les abeilles, le contrôle naturel des ravageurs et la santé des sols. Pourtant, sur les cartes traditionnelles et les images satellites, ces détails fins se confondent. Cette étude montre comment les drones et les techniques modernes d’analyse d’images peuvent zoomer sur les jardins urbains avec un niveau de détail remarquable, en fournissant un nouveau jeu de données ouvert qui aide chercheurs et urbanistes à comprendre comment le sol sous nos pieds soutient la biodiversité en ville.

Une diversité cachée sur le plancher du jardin

Les jardins urbains sont plus que de simples taches de verdure décoratives. Leurs différents couverts du sol — comme les plantes aromatiques, la pelouse, les paillages de paille, les copeaux de bois, les pierres et la terre exposée — offrent nourriture et abri aux pollinisateurs, des terrains de chasse pour les insectes prédateurs des ravageurs et des habitats pour les organismes du sol. Ensemble, ils contribuent au cycle des nutriments, maintiennent la tenue des sols et relient la faune à travers des quartiers autrement bétonnés. Parce que ces éléments varient sur quelques mètres seulement, ils sont difficiles à saisir avec des images satellites grossières ou des relevés de terrain chronophages, créant une lacune d’information importante pour qui veut concevoir des villes favorables à la faune.

Les drones comme loupes volantes

Pour combler cette lacune, les chercheurs ont fait voler un petit drone équipé d’une caméra au-dessus de cinq jardins communautaires à Munich, en Allemagne, lors de plusieurs visites en 2021 et 2022. À partir de 2 521 photographies brutes, ils ont assemblé 24 « orthomosaïques » ultra-nettes — des images cartographiques dans lesquelles chaque pixel au sol représente seulement 3,2 à 7,9 millimètres. Ces mosaïques révèlent les plantes individuelles, les chemins et les couches de paillage avec un grand niveau de détail. L’équipe a ensuite tracé à la main des milliers de régions, étiquetant huit types courants de couverts du sol : herbe, plantes herbacées, litière comme les feuilles mortes, terre nue, pierre, paille, bois massif (planches et troncs) et copeaux de bois. Les couches d’étiquettes obtenues servent de cartes de référence pour ce que la caméra voit réellement au sol.

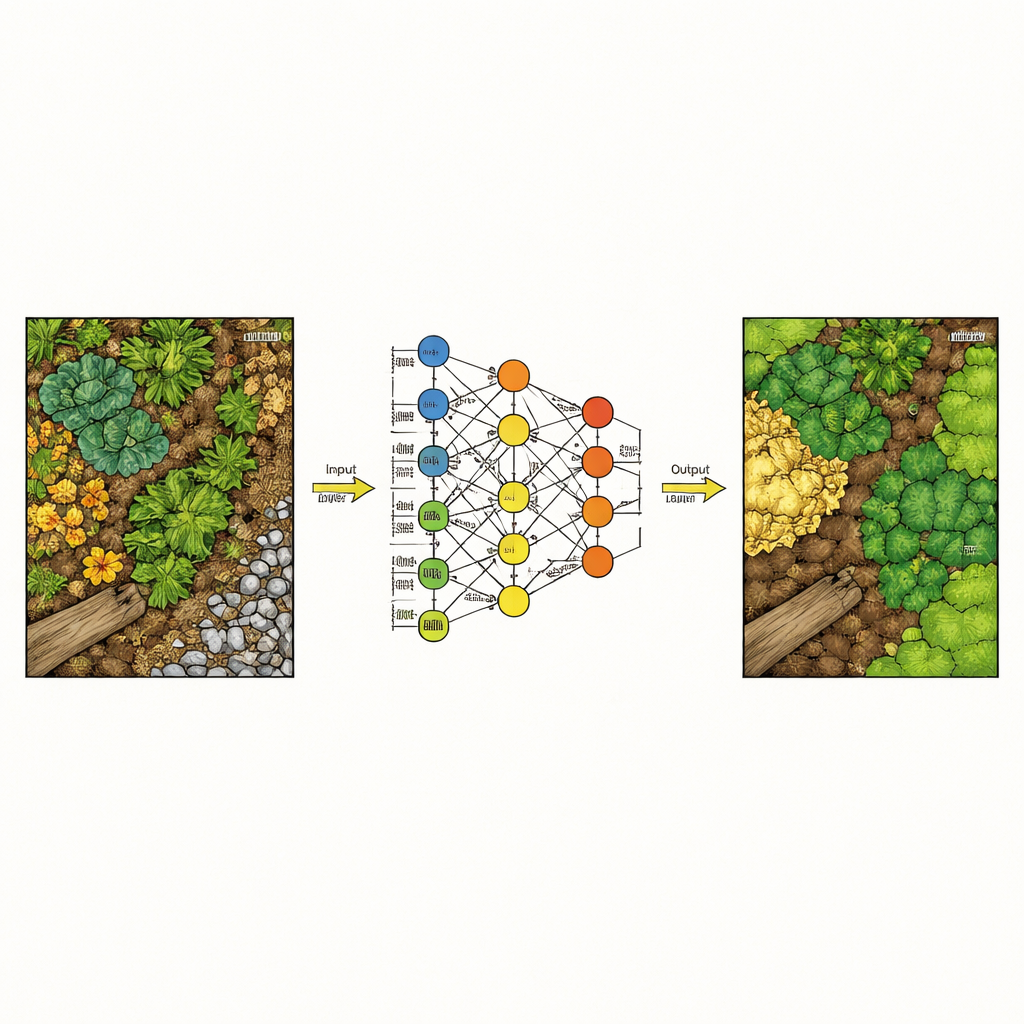

Apprendre aux ordinateurs à lire les motifs du jardin

Avec ces images annotées, l’équipe a évalué la capacité de différents modèles informatiques à reconnaître automatiquement chaque type de couvert du sol, pixel par pixel. Ils ont comparé des techniques traditionnelles, qui reposent sur des mesures de texture et de couleur conçues manuellement, à des approches d’apprentissage profond qui apprennent les motifs directement à partir des fragments d’image. Pour garder la tâche réaliste, ils ont divisé les 24 mosaïques en ensembles d’entraînement, de validation et de test distincts, de sorte que les modèles étaient toujours évalués sur des images de jardins qu’ils n’avaient jamais « vues » pendant l’entraînement. Deux modèles d’apprentissage profond — UNet et en particulier DeepLabV3+ — ont nettement surpassé les méthodes classiques comme les Forêts Aléatoires et les arbres à gradient boosté, attribuant correctement environ 93 % des pixels au total et traitant beaucoup mieux des distinctions visuelles délicates telles que terre contre pierre.

Ce que propose le nouveau jeu de données

Le cœur de ce travail est un jeu de données ouvert plutôt qu’une carte finie unique. Il inclut les mosaïques complètes issues du drone, les masques d’étiquettes correspondants et une version par fragments (patches) plus facile à ingérer par les réseaux neuronaux modernes. Une table de métadonnées compagnon recense des détails tels que la hauteur de vol, la taille des images et les paramètres de traitement, rendant les données réutilisables pour de nombreux usages. Les chercheurs peuvent développer de nouveaux algorithmes, comparer différentes stratégies de modélisation ou combiner ces cartes avec d’autres informations — comme des dénombrements d’insectes ou des échantillons de sol — pour explorer comment des mélanges spécifiques de couverts du sol soutiennent des bénéfices écologiques particuliers.

Des pixels à des villes plus vertes

Pour les non-spécialistes, l’essentiel est que les drones peuvent désormais cartographier la trame fine des jardins urbains avec suffisamment de précision pour que des ordinateurs distinguent où la pelouse s’arrête et où commencent les copeaux de bois. L’étude montre que les modèles d’apprentissage profond peuvent traduire cette mosaïque visuelle en cartes fiables des couverts du sol, qui peuvent à leur tour éclairer une meilleure conception et gestion des jardins pour la biodiversité, le contrôle des ravageurs et la santé des sols. En rendant leurs données et leur code publics, les auteurs fournissent une base pour des outils futurs qui pourraient aider jardiniers, urbanistes et écologues à voir comment de petits choix de conception sur le terrain se traduisent à grande échelle par des écosystèmes urbains plus sains.

Citation: Afrasiabian, Y., Lu, C., Belwalkar, A. et al. A drone imagery dataset for semantic segmentation of urban garden ground covers in biodiversity studies. Sci Data 13, 590 (2026). https://doi.org/10.1038/s41597-026-07152-z

Mots-clés: jardins urbains, images par drone, segmentation sémantique, couverts du sol, suivi de la biodiversité