Clear Sky Science · it

Validità e equità della valutazione della competenza globale PISA 2018: una valutazione basata su argomentazioni tramite modelli esplicativi di risposta agli item

Perché questo studio conta nella vita quotidiana

Gli adolescenti di oggi crescono in un mondo dove notizie, amici e opportunità lavorative attraversano i confini nazionali. Le scuole cercano di prepararli a orientarsi tra culture diverse, selezionare informazioni online e collaborare con persone diverse da loro. Il Programme for International Student Assessment (PISA) ha cercato di misurare questa “competenza globale” nel 2018. Questo studio pone una domanda semplice ma importante: possiamo fidarci di quei punteggi per dire chi è davvero competente a livello globale, e sono equi per gruppi diversi di studenti?

Uno sguardo ravvicinato a un test scolastico mondiale

Il test PISA 2018 sulla competenza globale è stato somministrato a quindicenni in molti paesi ed è stato considerato un indicatore chiave di quanto i sistemi educativi preparino i giovani a un mondo interconnesso. Tuttavia ricercatori e educatori hanno espresso preoccupazioni sul fatto che il concetto di competenza globale sia difficile da definire e possa essere influenzato da visioni occidentali e bias culturali. Questo articolo si concentra sugli studenti canadesi che hanno sostenuto il test e ispeziona attentamente le domande e i risultati. L’autore utilizza un approccio strutturato alla validità: prima verifica se le risposte sono valutate in modo coerente, poi se i punteggi risulterebbero simili tra diverse versioni del test, se concordano con altri indicatori di competenza globale e infine se trattano ragazzi e ragazze in modo equo.

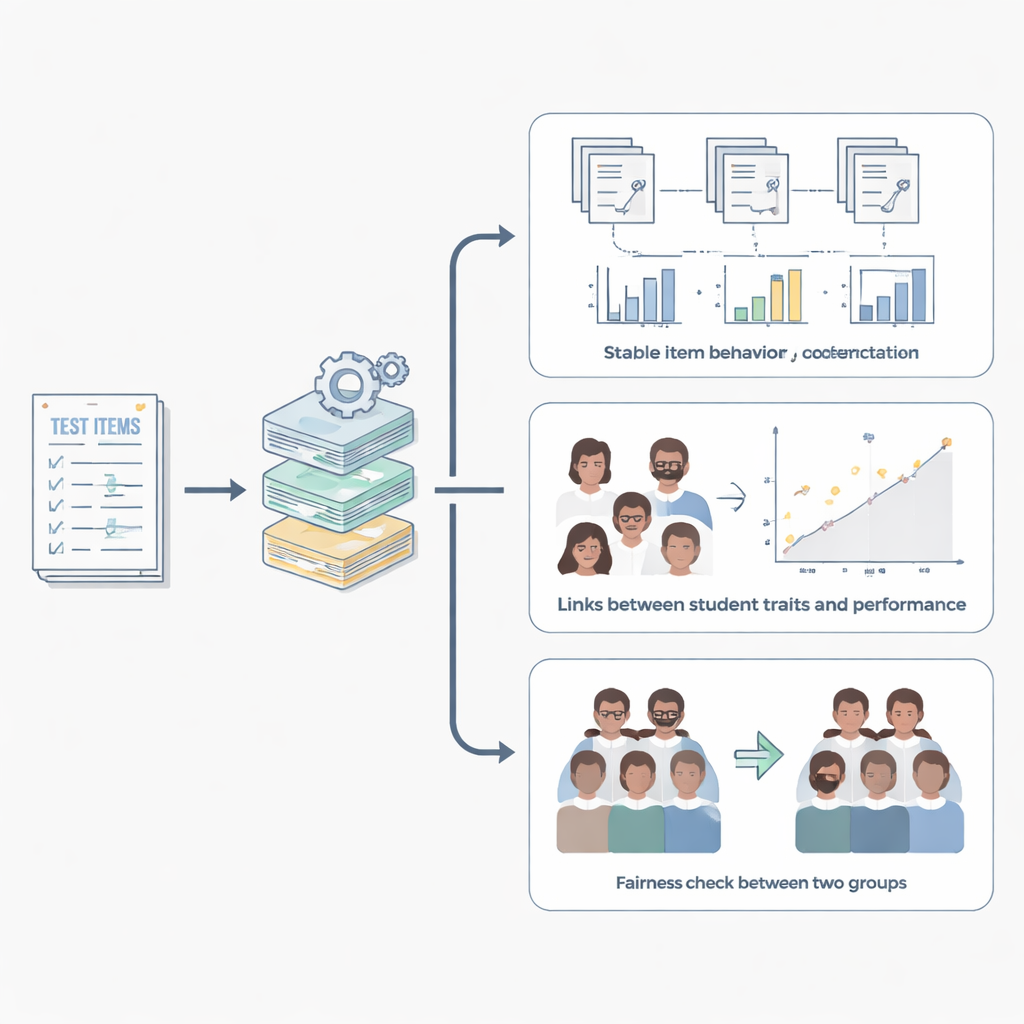

Come sono stati analizzati il test e gli studenti

Il ricercatore ha impiegato una famiglia moderna di metodi statistici che considera non solo se gli studenti rispondono correttamente agli item, ma anche come caratteristiche del test e degli studenti influenzino la difficoltà di ciascuna domanda. Gli item di competenza globale di PISA sono raggruppati in brevi sequenze narrative chiamate “testlet” e sono somministrati in diversi fascicoli, o forme. Lo studio ha trattato separatamente ogni gruppo di fascicoli, ha imputato con cautela piccole quantità di dati mancanti e poi ha combinato i risultati tra i gruppi usando la meta-analisi. Oltre ai punteggi del test, sono state considerate le risposte degli studenti a domande del questionario su fiducia nel gestire questioni globali, rispetto per persone di altre culture, consapevolezza nella comunicazione interculturale e atteggiamenti verso gli immigrati.

Cosa ha rilevato lo studio sulla qualità dei punteggi

L’analisi ha mostrato che i raggruppamenti narrativi di domande non distorcevano, di per sé, la apparente difficoltà degli item. In altre parole, semplicemente porre domande insieme in uno scenario non alterava fortemente i risultati una volta tenuto conto dell’abilità complessiva. Alcuni fascicoli, tuttavia, rendevano gli item leggermente più difficili di altri, suggerendo che la versione del test ricevuta può spostare i punteggi di poco verso l’alto o verso il basso. A livello di studente, chi dichiarava maggiore fiducia nel gestire questioni globali, più rispetto per la diversità culturale e maggiore sensibilità alla comunicazione interculturale tendeva a ottenere risultati migliori nei compiti cognitivi. Questi legami sono risultati generalmente stabili tra i diversi fascicoli. Non tutti i tratti correlati si sono comportati come previsto: alcune misure di mentalità globale o di consapevolezza delle questioni mondiali avevano connessioni deboli o addirittura leggermente negative con la prestazione al test, sottolineando la complessità e le molteplici sfaccettature della competenza globale.

Verifica dell’equità tra ragazze e ragazzi

Lo studio ha inoltre esaminato se specifiche domande conferivano un vantaggio ingiusto a ragazze o ragazzi una volta controllata l’abilità complessiva. Per la maggior parte degli item, le differenze tra i generi sono risultate piccole e incoerenti, il che significa che le domande si comportavano in modo simile per entrambi i gruppi. Alcune domande, tuttavia, mostravano vantaggi moderati o grandi, più spesso a favore delle ragazze e occasionalmente a favore dei ragazzi. Questi casi erano pochi ma sufficientemente coerenti tra le forme del test da meritare una revisione più attenta. Fondamentalmente, non è emersa alcuna evidenza che il test nel suo complesso fosse sbilanciato contro un genere, ma alcune domande individuali potrebbero essere affinate o sostituite in versioni future.

Cosa significa questo per l’uso dei punteggi di competenza globale

Per chi non è del mondo dei test, la conclusione è che i punteggi PISA 2018 sulla competenza globale per gli studenti canadesi sono in gran parte affidabili: catturano una capacità reale collegata al modo in cui i giovani pensano e rispondono a situazioni globali e interculturali, e lo fanno in modo generalmente equo. Allo stesso tempo, lo studio mette in evidenza che dettagli di progettazione del test — come quale fascicolo riceve uno studente e come sono definite le caratteristiche del questionario — possono influenzare sottilmente i risultati. Mostra che misurare qualcosa di ricco come la competenza globale è possibile ma richiede attenzione costante a come sono scritte le domande, come sono raggruppate e come funzionano per diversi tipi di studenti.

Citazione: Yavuz, E. Validity and fairness of the PISA 2018 Global Competence assessment: an argument-based evaluation via explanatory item response models. Humanit Soc Sci Commun 13, 570 (2026). https://doi.org/10.1057/s41599-026-06979-6

Parole chiave: competenza globale, PISA 2018, valutazione educativa, equità dei test, modellizzazione delle risposte agli item