Clear Sky Science · es

Validez y equidad de la evaluación de Competencia Global en PISA 2018: una evaluación basada en argumentos mediante modelos explicativos de respuesta al ítem

Por qué este estudio importa en la vida cotidiana

Los adolescentes de hoy crecen en un mundo en el que las noticias, las amistades y los empleos futuros traspasan fronteras nacionales. Las escuelas intentan prepararlos para moverse entre culturas diferentes, filtrar información en línea y colaborar con personas distintas a ellos. El Programa para la Evaluación Internacional de los Alumnos (PISA) trató de medir esta “competencia global” en 2018. Este estudio plantea una pregunta simple pero importante: ¿podemos confiar en esos puntajes para decir quiénes son realmente competentes a nivel global, y son justos para distintos grupos de estudiantes?

Examinando de cerca una prueba escolar mundial

La prueba de competencia global de PISA 2018 fue realizada por jóvenes de 15 años en muchos países y se consideró un indicador clave de cuánto preparan los sistemas educativos a las nuevas generaciones para un mundo interconectado. Sin embargo, investigadores y docentes han expresado inquietudes de que el concepto de competencia global sea difícil de delimitar y que pueda estar teñido por visiones occidentales y sesgos culturales. Este trabajo se centra en los estudiantes canadienses que hicieron la prueba e inspecciona con atención las preguntas y los resultados. El autor utiliza un enfoque estructurado de validez: primero pregunta si las respuestas se puntúan de manera consistente, luego si los puntajes serían similares entre las distintas versiones de la prueba, si concuerdan con otros indicadores de competencia global y, finalmente, si tratan de forma equitativa a chicos y chicas.

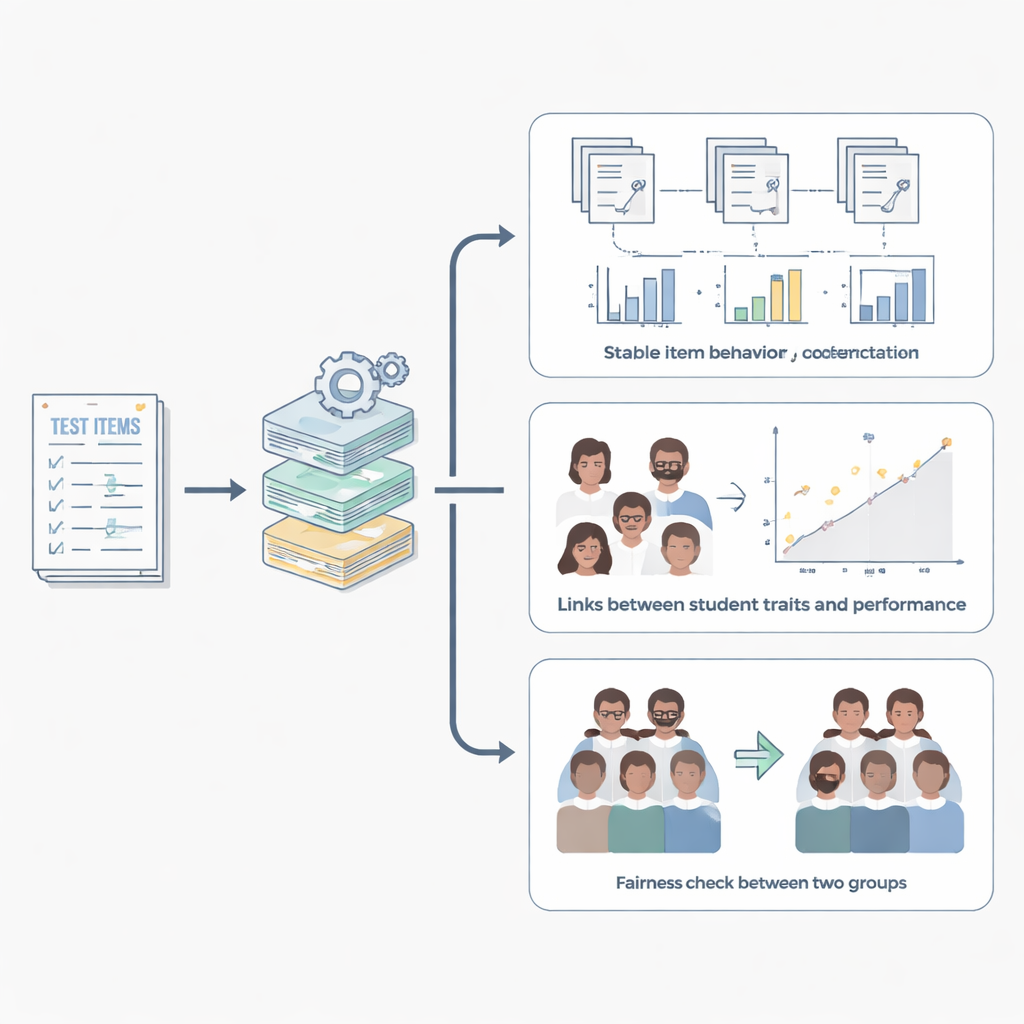

Cómo se analizaron la prueba y los estudiantes

El investigador empleó una familia moderna de métodos estadísticos que mira no solo si los estudiantes responden correctamente o erróneamente, sino también cómo las características de la prueba y de los estudiantes afectan la dificultad de cada ítem. Los ítems de competencia global de PISA están agrupados en pequeños conjuntos narrativos llamados “testlets” y se administran en distintos cuadernillos o formas. El estudio trató cada grupo de cuadernillos por separado, completó pequeñas cantidades de datos faltantes con imputación cautelosa y luego combinó los resultados entre grupos mediante metaanálisis. Además de las puntuaciones de la prueba, se utilizaron las respuestas de los estudiantes a encuestas sobre confianza para abordar temas globales, respeto por personas de otras culturas, conciencia de la comunicación intercultural y actitudes hacia las personas inmigrantes.

Qué encontró el estudio sobre la calidad de los puntajes

El análisis mostró que las agrupaciones basadas en historias no distorsionaron por sí solas la aparente dificultad de los ítems. En otras palabras, colocar preguntas juntas en un escenario no sesionó los resultados de forma notable una vez que se consideró la habilidad global. Algunos cuadernillos, sin embargo, hicieron que los ítems resultaran ligeramente más difíciles que otros, lo que sugiere que la forma que recibía un estudiante puede empujar los puntajes hacia arriba o hacia abajo en cierta medida. A nivel del estudiante, quienes declararon mayor confianza para tratar cuestiones globales, más respeto por la diversidad cultural y mayor sensibilidad hacia la comunicación intercultural tendieron a obtener mejores resultados en las tareas cognitivas. Estos vínculos fueron en general estables entre los distintos cuadernillos. No todos los rasgos relacionados se comportaron como se esperaba: algunas medidas de sentirse con una mentalidad global o de estar al tanto de asuntos mundiales mostraron conexiones débiles o incluso ligeramente negativas con el rendimiento, lo que subraya lo complejo y multicapa que es realmente el concepto de competencia global.

Comprobando la equidad entre chicas y chicos

El estudio también examinó si ciertas preguntas daban una ventaja injusta a chicas o chicos una vez controlada la habilidad general. Para la mayoría de los ítems, las diferencias entre géneros fueron mínimas e inconsistentes, lo que indica que las preguntas se comportaban de manera similar para ambos grupos. Un puñado de preguntas mostró ventajas moderadas o fuertes, con mayor frecuencia a favor de las chicas y ocasionalmente de los chicos. Fueron pocas en número, pero lo bastante consistentes entre las formas de la prueba como para justificar una revisión más detallada. De forma crucial, no hubo indicios de que la prueba en su conjunto estuviera inclinada contra ninguno de los géneros, aunque algunos ítems individuales podrían refinarse o reemplazarse en versiones futuras.

Qué significa esto para el uso de los puntajes de competencia global

Para los lectores ajenos al mundo de las evaluaciones, la conclusión es que los puntajes de competencia global de PISA 2018 para estudiantes canadienses son en su mayoría sólidos: captan una habilidad real vinculada a cómo los jóvenes piensan y responden ante situaciones globales e interculturales, y lo hacen de maneras ampliamente justas. Al mismo tiempo, el estudio destaca que detalles del diseño de la prueba —como cuál cuadernillo recibe un estudiante y cómo se definen los rasgos en la encuesta— pueden modelar los resultados de forma sutil. Muestra que medir algo tan rico como la competencia global es posible, pero exige atención constante a cómo se redactan las preguntas, cómo se agrupan y cómo funcionan para distintos tipos de estudiantes.

Cita: Yavuz, E. Validity and fairness of the PISA 2018 Global Competence assessment: an argument-based evaluation via explanatory item response models. Humanit Soc Sci Commun 13, 570 (2026). https://doi.org/10.1057/s41599-026-06979-6

Palabras clave: competencia global, PISA 2018, evaluación educativa, equidad en las pruebas, modelado de respuesta al ítem