Clear Sky Science · fr

Validité et équité de l’évaluation de la compétence mondiale PISA 2018 : une évaluation fondée sur les arguments via des modèles explicatifs de réponse aux items

Pourquoi cette étude compte dans la vie quotidienne

Les adolescents d’aujourd’hui grandissent dans un monde où l’actualité, les amis et les emplois franchissent les frontières nationales. Les écoles cherchent à les préparer à naviguer entre différentes cultures, à trier l’information en ligne et à travailler avec des personnes différentes d’eux. Le Programme international pour le suivi des acquis des élèves (PISA) a tenté de mesurer cette « compétence mondiale » en 2018. Cette étude pose une question simple mais importante : peut-on faire confiance à ces scores pour dire qui est réellement compétent à l’échelle mondiale, et sont-ils équitables pour différents groupes d’élèves ?

Regarder de près un test scolaire mondial

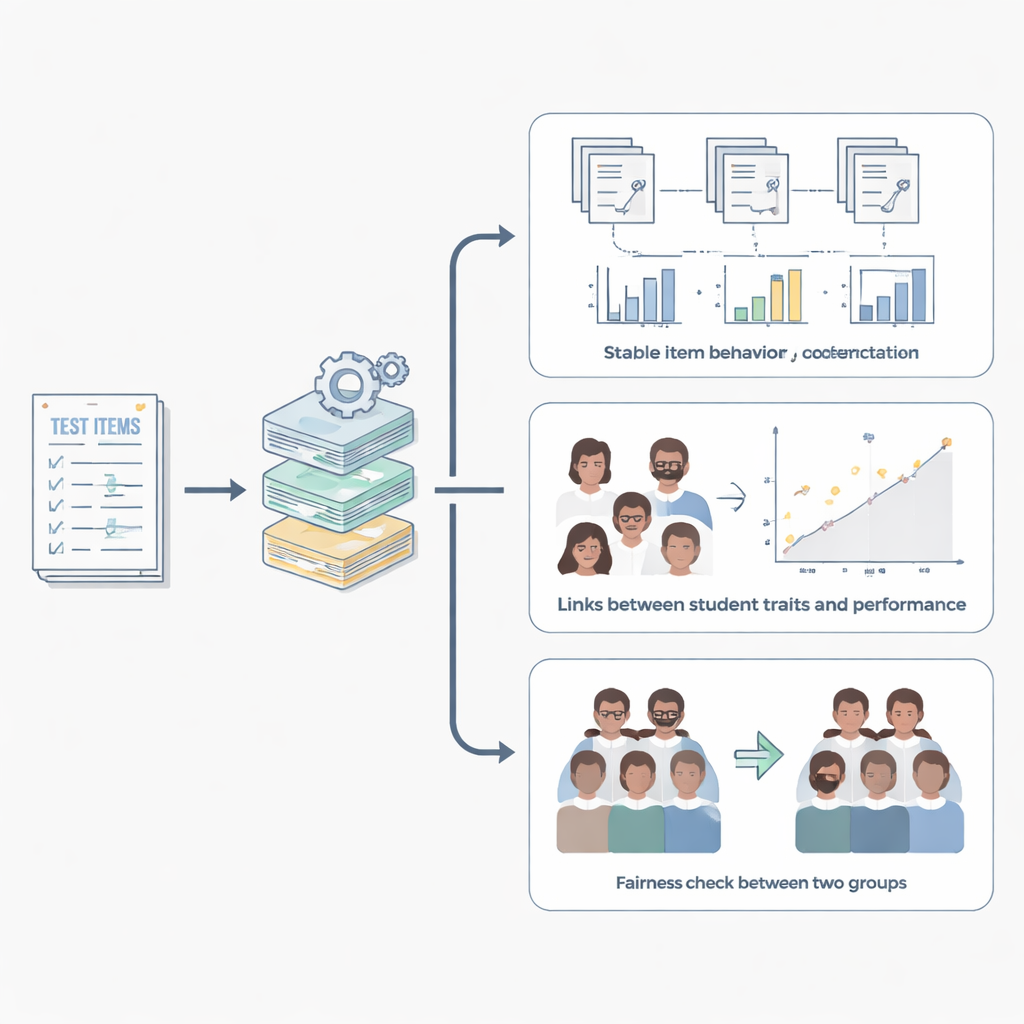

Le test PISA 2018 sur la compétence mondiale a été passé par des élèves de 15 ans dans de nombreux pays et a été traité comme un indicateur clé de la capacité des systèmes éducatifs à préparer les jeunes à un monde interconnecté. Pourtant, chercheurs et enseignants s’inquiètent du fait que la notion de compétence mondiale soit difficile à cerner et puisse être teintée de points de vue occidentaux et de biais culturels. Cet article se concentre sur les élèves canadiens ayant passé le test et examine attentivement les questions et les résultats. L’auteur utilise une approche structurée de la validité : vérifier d’abord si les réponses sont notées de manière cohérente, ensuite si les scores seraient similaires entre différentes versions du test, si les scores concordent avec d’autres signes de compétence mondiale, et enfin si le test traite les filles et les garçons de façon équitable.

Comment le test et les élèves ont été analysés

Le chercheur a utilisé une famille de méthodes statistiques modernes qui examine non seulement si les élèves réussissent ou échouent les items, mais aussi comment des caractéristiques du test et des élèves influent sur la difficulté de chaque question. Les items de compétence mondiale de PISA sont regroupés en petits ensembles narratifs appelés « testlets » et sont administrés dans différents livrets, ou formes. L’étude a traité chaque groupe de livrets séparément, a comblé de petites quantités de données manquantes par imputation prudente, puis a combiné les résultats entre groupes au moyen d’une méta-analyse. Outre les scores de l’épreuve, l’étude a utilisé les réponses des élèves à des questions d’enquête sur la confiance à traiter des enjeux mondiaux, le respect des personnes d’autres cultures, la conscience de la communication interculturelle et les attitudes envers les immigrés.

Ce que l’étude a révélé sur la qualité des scores

L’analyse a montré que les regroupements narratifs des questions ne déformaient pas, en eux-mêmes, la perception de la difficulté des items. Autrement dit, le fait de placer des questions ensemble dans un scénario n’influençait pas fortement les résultats une fois l’aptitude globale prise en compte. Certains livrets, cependant, rendaient les items légèrement plus difficiles que d’autres, ce qui suggère que la forme reçue par un élève peut faire varier légèrement les scores. Au niveau des élèves, ceux qui déclaraient une plus grande confiance pour traiter des enjeux mondiaux, un plus grand respect de la diversité culturelle et une sensibilité accrue à la communication interculturelle avaient tendance à mieux réussir les tâches cognitives. Ces liens restaient généralement stables entre les différents livrets. Toutes les caractéristiques liées n’ont pas pour autant eu le comportement attendu : certaines mesures du sentiment d’ouverture au monde ou de conscience des enjeux mondiaux présentaient des liens faibles voire légèrement négatifs avec la performance au test, soulignant la complexité et la multiplicité des facettes de la compétence mondiale.

Vérifier l’équité entre filles et garçons

L’étude a également examiné si certaines questions favorisaient injustement les filles ou les garçons une fois l’aptitude globale contrôlée. Pour la plupart des items, les différences entre les sexes étaient minimes et incohérentes, ce qui signifie que les questions se comportaient de façon similaire pour les deux groupes. Une poignée d’items montraient cependant des avantages modérés ou importants, favorisant plus souvent les filles et parfois les garçons. Ils étaient peu nombreux mais suffisamment cohérents entre les formes de test pour justifier un examen plus approfondi. Il est essentiel de noter qu’il n’y avait aucun signe indiquant que le test dans son ensemble était biaisé contre l’un ou l’autre sexe, mais que certaines questions individuelles pourraient être raffinées ou remplacées dans de futures versions.

Ce que cela signifie pour l’utilisation des scores de compétence mondiale

Pour les lecteurs extérieurs au monde des tests, la conclusion est que les scores de compétence mondiale PISA 2018 pour les élèves canadiens sont majoritairement valides : ils captent une aptitude réelle liée à la façon dont les jeunes réfléchissent et réagissent aux situations mondiales et interculturelles, et ce, de manière globalement équitable. En même temps, l’étude souligne que des détails de conception du test — tels que le livret reçu par un élève et la définition des traits mesurés par l’enquête — peuvent façonner les résultats de façon subtile. Elle montre que mesurer quelque chose d’aussi riche que la compétence mondiale est possible, mais exige une attention permanente à la formulation des questions, à leur regroupement et à leur fonctionnement pour différents profils d’élèves.

Citation: Yavuz, E. Validity and fairness of the PISA 2018 Global Competence assessment: an argument-based evaluation via explanatory item response models. Humanit Soc Sci Commun 13, 570 (2026). https://doi.org/10.1057/s41599-026-06979-6

Mots-clés: compétence mondiale, PISA 2018, évaluation éducative, équité des tests, modélisation des réponses aux items