Clear Sky Science · it

SynthEHR-eviction: potenziare l’individuazione delle SDoH correlate allo sfratto con dati EHR sintetici aumentati da LLM

Perché i problemi abitativi appartengono alle cartelle cliniche

Essere costretti a lasciare la propria casa può devastare la salute, ma la maggior parte dei sistemi sanitari quasi non se ne accorge quando succede. Questo articolo descrive un nuovo metodo per insegnare all’intelligenza artificiale a individuare segnali di sfratto e difficoltà sociali correlate all’interno delle note cliniche. Trasformando una piccola quantità di lavoro di esperti in un ampio set di addestramento realistico, l’approccio potrebbe aiutare i sistemi sanitari a identificare prima le persone a rischio e a metterle in contatto con servizi abitativi e supporto sociale.

Quando la perdita di una casa danneggia la salute

Lo sfratto non si limita a cambiare un indirizzo. È associato alla senzatetto, alla disoccupazione, alla depressione e persino a tassi di mortalità più elevati, con impatti particolarmente pesanti sui gruppi marginalizzati e durante crisi come la pandemia di COVID-19. Eppure, nelle cartelle cliniche elettroniche odierne, le informazioni sulla perdita dell’abitazione o sulle minacce di sfratto compaiono di solito solo nelle note in testo libero, non in caselle o codici standardizzati. Questo rende difficile per ospedali, ricercatori e responsabili politici vedere dove avvengono gli sfratti, chi è maggiormente colpito e quando intervenire.

Costruire storie di pazienti “sintetiche” realistiche

Poiché le note cliniche reali che menzionano esplicitamente lo sfratto sono rare e sensibili, gli autori hanno creato una pipeline chiamata SynthEHR-Eviction per generare esempi realistici ma completamente sintetici. Sono partiti dalle sezioni di storia sociale di note di dimissione ospedaliera reali e hanno usato grandi modelli linguistici — sistemi di IA addestrati su massicce raccolte di testi — per riscriverle in modo che ciascuna nota riflettesse una specifica situazione abitativa o sociale. Gli esperti hanno definito con cura 14 categorie, includendo fasi dettagliate dello sfratto come “in sospeso”, “accordo reciproco per terminare il contratto” e “sfratto passato vs. attuale”, oltre a problematiche correlate come senzatetto, insicurezza alimentare e difficoltà a pagare le bollette. Attraverso un processo iterativo con l’intervento umano, i clinici hanno rivisto campioni di output, segnalato errori e fornito feedback strutturato inserito nel processo di prompting fino a quando ogni “aumentatore” IA ha prodotto note altamente accurate con ambiguità minima. Il risultato è stato un ampio dataset pubblico contenente 8.000 note sintetiche per l’addestramento più oltre 600 note di test accuratamente etichettate che mescolano casi sintetici con esempi reali de-identificati tratti da grandi banche dati di ricerca.

Insegnare ai computer a leggere fra le righe

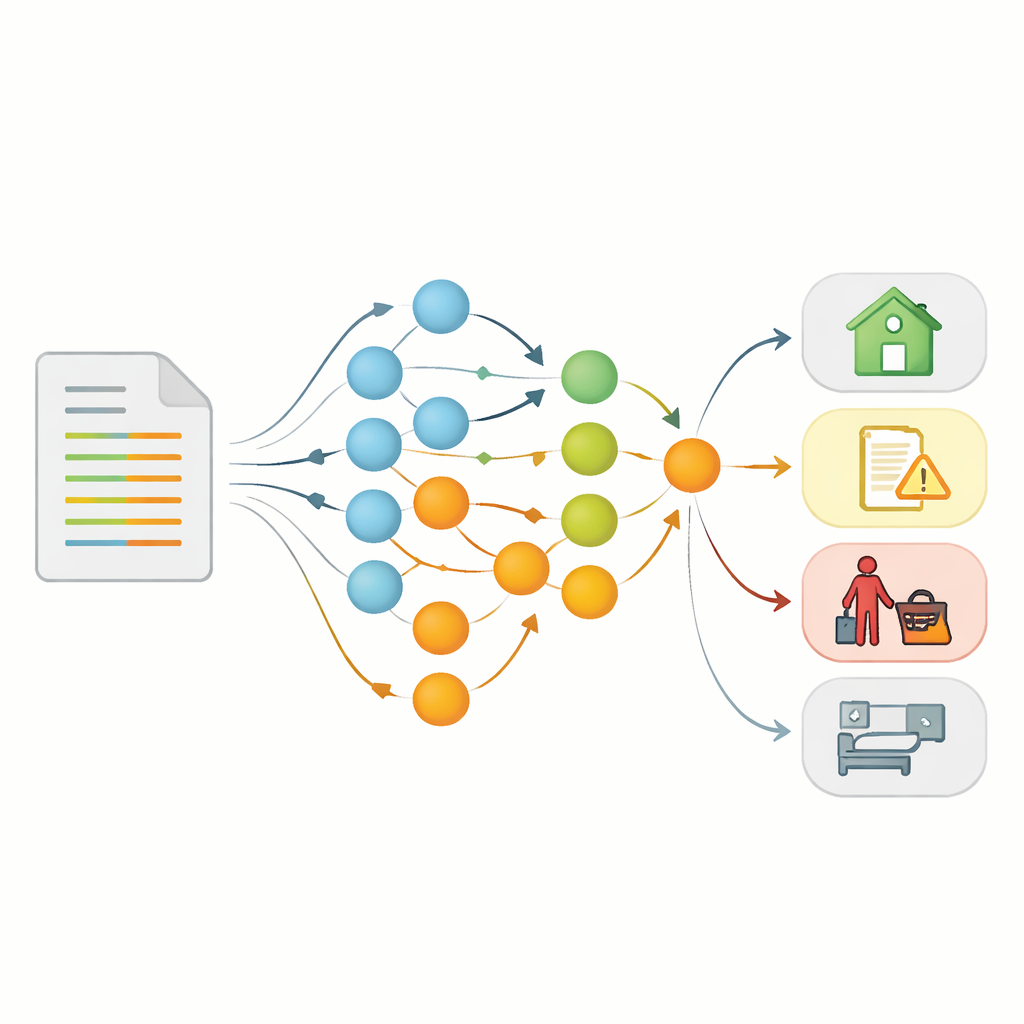

Sulla base di queste storie sintetiche, il team ha costruito un sistema di annotazione automatizzato che non solo assegna una categoria ma produce anche una spiegazione passo dopo passo del suo ragionamento. Usando un framework chiamato DSPy, hanno ottimizzato i prompt in modo che l’IA decida prima se una nota riguarda effettivamente uno sfratto, quindi la instradi verso un classificatore dettagliato per gli sfratti o verso un classificatore per altri rischi sociali come i trasporti o l’insicurezza alimentare. Questo disegno rispecchia come un lettore umano potrebbe prima chiedersi “Si parla di sfratto?” e solo poi inserire il caso in categorie più specifiche. Per ridurre il lavoro manuale, i ricercatori hanno confrontato la riscrittura e l’etichettatura completamente umane di 8.000 note — oltre 260 ore di lavoro — con il loro flusso di lavoro assistito dall’IA, che ha raggiunto una qualità dei dati comparabile con meno di sei ore di tempo esperto, una riduzione dell’80%.

Quanto bene funzionano i modelli

Dotati di SynthEHR-Eviction, gli autori hanno quindi messo a punto una gamma di modelli linguistici open-source e li hanno confrontati con sistemi commerciali e modelli biomedici più datati. Per il compito semplice di decidere se lo sfratto fosse menzionato o meno, molti modelli hanno ottenuto buoni risultati, ma i grandi modelli linguistici rifiniti e una variante ottimizzata di GPT-4 hanno raggiunto i punteggi più alti. La prova più difficile era distinguere fra sette stati sfumati di sfratto e un insieme separato di rischi sociali non legati allo sfratto su tre dataset: note sintetiche, note ospedaliere reali e lunghi rapporti di casi accademici. Qui, modelli open fine-tuned come Qwen2.5 e LLaMA-3 hanno eguagliato o leggermente superato le prestazioni di GPT-4 ottimizzato, raggiungendo macro‑F1 — un equilibrio complessivo tra precisione e richiamo — intorno a 0,89 per lo sfratto e oltre 0,90 per gli altri rischi sociali. Anche modelli più piccoli con solo tre miliardi di parametri hanno performato bene una volta rifiniti, suggerendo che sistemi capaci ma economici possono essere dispiegati in contesti con risorse di calcolo limitate.

Perché le tracce di ragionamento e i dati reali restano importanti

Lo studio mostra che le spiegazioni aiutano alcuni modelli più che altri. Quando i dati di addestramento includevano brevi ragionamenti espliciti sul perché una nota segnalava un certo stato di sfratto, i modelli più piccoli sono migliorati in modo evidente, mentre i modelli più grandi sono cambiati poco, il che suggerisce che questi ultimi avevano già codificato gran parte di questa logica. Queste tracce di ragionamento rendono inoltre più facile la revisione delle decisioni del modello da parte degli esperti, sebbene gli autori mettano in guardia sul fatto che le spiegazioni non sono sempre perfettamente fedeli a come il modello prende effettivamente le decisioni. Un’altra scoperta chiave è che i modelli addestrati solo su note sintetiche inciampano quando si confrontano con la scrittura reale e disordinata del mondo clinico. Semplicemente mescolare una quota modesta di note ospedaliere reali o rapporti di casi ha migliorato nettamente le prestazioni su quei domini, sottolineando che i dati sintetici sono potenti ma non sufficienti da soli.

Dall rischio nascosto all’aiuto visibile

Nel complesso, l’articolo dimostra che dati sintetici accuratamente progettati, combinati con una supervisione mirata di esperti, possono trasformare menzioni sparse di sfratto e altre difficoltà in segnali strutturati che i computer possono rilevare su larga scala. In termini semplici, il sistema impara a leggere fra le righe delle note dei medici e a segnalare quando un paziente sta affrontando o ha affrontato la perdita dell’abitazione o tensioni sociali correlate. Se integrati nelle cartelle cliniche elettroniche, tali strumenti potrebbero aiutare medici e assistenti sociali a individuare le persone a rischio in anticipo e a metterle in contatto con aiuti abitativi, consulenza finanziaria o supporto per i trasporti. Rendendo più visibile il lato sociale e spesso nascosto della malattia, SynthEHR-Eviction offre un percorso verso un’assistenza sanitaria che vede e risponde alle circostanze complete della vita dei pazienti.

Citazione: Yao, Z., Zhao, Y., Mitra, A. et al. SynthEHR-eviction: enhancing eviction SDoH detection with LLM-augmented synthetic EHR data. npj Digit. Med. 9, 292 (2026). https://doi.org/10.1038/s41746-026-02473-0

Parole chiave: sfratto, determinanti sociali della salute, cartelle cliniche elettroniche, dati sintetici, elaborazione del linguaggio naturale clinico